Perception-R1: Pioneering Perception Policy with Reinforcement Learning

作者: En Yu, Kangheng Lin, Liang Zhao, Jisheng Yin, Yana Wei, Yuang Peng, Haoran Wei, Jianjian Sun, Chunrui Han, Zheng Ge, Xiangyu Zhang, Daxin Jiang, Jingyu Wang, Wenbing Tao

分类: cs.CV, cs.CL

发布日期: 2025-04-10

备注: Github page: https://github.com/linkangheng/PR1

💡 一句话要点

Perception-R1:利用强化学习提升多模态大语言模型感知策略,显著提高视觉感知任务性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多模态大语言模型 强化学习 视觉感知 感知策略学习 奖励设计 目标检测 图像理解

📋 核心要点

- 现有方法在视觉感知任务中,直接应用强化学习进行后训练,效果并不稳定,需要深入理解强化学习在视觉感知中的作用。

- Perception-R1通过分析感知复杂性和奖励设计对强化学习效果的影响,提出了一个可扩展的强化学习框架,用于多模态大语言模型的后训练。

- 实验结果表明,Perception-R1在多个视觉感知任务上取得了显著的性能提升,例如在COCO2017 val数据集上AP提升了31.9%。

📝 摘要(中文)

受DeepSeek-R1的启发,本文探索了基于规则的强化学习(RL)在多模态大语言模型(MLLM)后训练中用于感知策略学习的潜力。初步实验表明,通过RL引入思维过程并非在所有视觉感知任务中都能带来一致的性能提升。因此,本文深入研究了RL在视觉感知中的作用,发现感知复杂性是决定RL有效性的主要因素,奖励设计在逼近模型感知上限方面起着关键作用。基于这些发现,本文提出了Perception-R1,一个在MLLM后训练中使用GRPO的可扩展RL框架。在标准的Qwen2.5-VL-3B-Instruct模型上,Perception-R1在RefCOCO+上实现了+4.2%的提升,在PixMo-Count上实现了+17.9%的提升,在PageOCR上实现了+4.2%的提升,并且首次在COCO2017 val上实现了31.9%的AP,为感知策略学习建立了一个强大的基线。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLM)在视觉感知任务中,直接应用强化学习进行后训练时,性能提升不稳定甚至下降的问题。现有方法缺乏对强化学习在视觉感知中作用的深入理解,导致无法有效利用强化学习来提升模型性能。

核心思路:论文的核心思路是深入分析影响强化学习效果的关键因素,包括感知复杂性和奖励设计,并基于此设计一个可扩展的强化学习框架。通过精细化的奖励设计和针对性的训练策略,使模型能够更好地学习感知策略,从而提升视觉感知任务的性能。

技术框架:Perception-R1框架主要包含以下几个阶段:1) 使用多模态大语言模型作为基础模型,例如Qwen2.5-VL-3B-Instruct;2) 设计针对不同视觉感知任务的奖励函数,奖励函数的设计需要考虑感知复杂性;3) 使用GRPO(未知)算法进行强化学习训练,优化模型的感知策略;4) 在多个视觉感知任务上进行评估,验证框架的有效性。

关键创新:论文的关键创新在于:1) 深入分析了感知复杂性和奖励设计对强化学习效果的影响,为强化学习在视觉感知中的应用提供了理论指导;2) 提出了Perception-R1框架,该框架具有可扩展性,可以应用于不同的视觉感知任务;3) 通过实验验证了Perception-R1框架的有效性,并在多个数据集上取得了显著的性能提升。与现有方法相比,Perception-R1更加注重对强化学习过程的理解和控制,从而能够更有效地提升模型性能。

关键设计:论文中关于奖励函数的设计是关键的技术细节。奖励函数需要根据不同的视觉感知任务进行精细化设计,以引导模型学习正确的感知策略。例如,对于目标检测任务,奖励函数可以考虑检测框的准确率、召回率等指标。此外,论文还使用了GRPO算法进行强化学习训练,具体的参数设置未知。

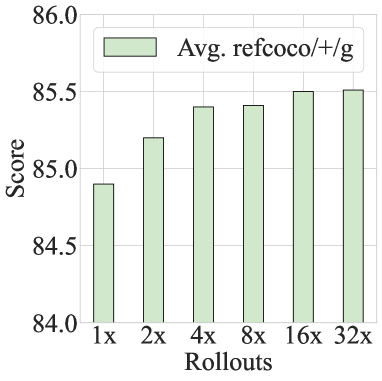

🖼️ 关键图片

📊 实验亮点

Perception-R1在多个视觉感知任务上取得了显著的性能提升。例如,在RefCOCO+上实现了+4.2%的提升,在PixMo-Count上实现了+17.9%的提升,在PageOCR上实现了+4.2%的提升,并且首次在COCO2017 val上实现了31.9%的AP。这些结果表明,Perception-R1是一种有效的感知策略学习方法。

🎯 应用场景

Perception-R1的研究成果可以应用于各种需要视觉感知的场景,例如自动驾驶、机器人导航、图像搜索、智能监控等。通过提升多模态大语言模型的视觉感知能力,可以使这些应用更加智能、可靠和高效。该研究还有助于推动人工智能技术在实际生活中的应用。

📄 摘要(原文)

Inspired by the success of DeepSeek-R1, we explore the potential of rule-based reinforcement learning (RL) in MLLM post-training for perception policy learning. While promising, our initial experiments reveal that incorporating a thinking process through RL does not consistently lead to performance gains across all visual perception tasks. This leads us to delve into the essential role of RL in the context of visual perception. In this work, we return to the fundamentals and explore the effects of RL on different perception tasks. We observe that the perceptual complexity is a major factor in determining the effectiveness of RL. We also observe that reward design plays a crucial role in further approching the upper limit of model perception. To leverage these findings, we propose Perception-R1, a scalable RL framework using GRPO during MLLM post-training. With a standard Qwen2.5-VL-3B-Instruct, Perception-R1 achieves +4.2% on RefCOCO+, +17.9% on PixMo-Count, +4.2% on PageOCR, and notably, 31.9% AP on COCO2017 val for the first time, establishing a strong baseline for perception policy learning.