RadZero: Similarity-Based Cross-Attention for Explainable Vision-Language Alignment in Chest X-ray with Zero-Shot Multi-Task Capability

作者: Jonggwon Park, Byungmu Yoon, Soobum Kim, Kyoyun Choi

分类: cs.CV, cs.CL, cs.LG

发布日期: 2025-04-10 (更新: 2025-11-06)

备注: NeurIPS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

RadZero:基于相似度的交叉注意力实现胸部X光片中可解释的视觉-语言对齐与零样本多任务能力

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言对齐 胸部X光片 零样本学习 多模态学习 可解释性 医学影像 对比学习

📋 核心要点

- 现有视觉-语言模型在放射学报告理解中存在局限,难以有效利用复杂报告,且可解释性不足。

- RadZero提出VL-CABS模块,通过相似度计算对齐文本嵌入和局部图像特征,实现细粒度推理。

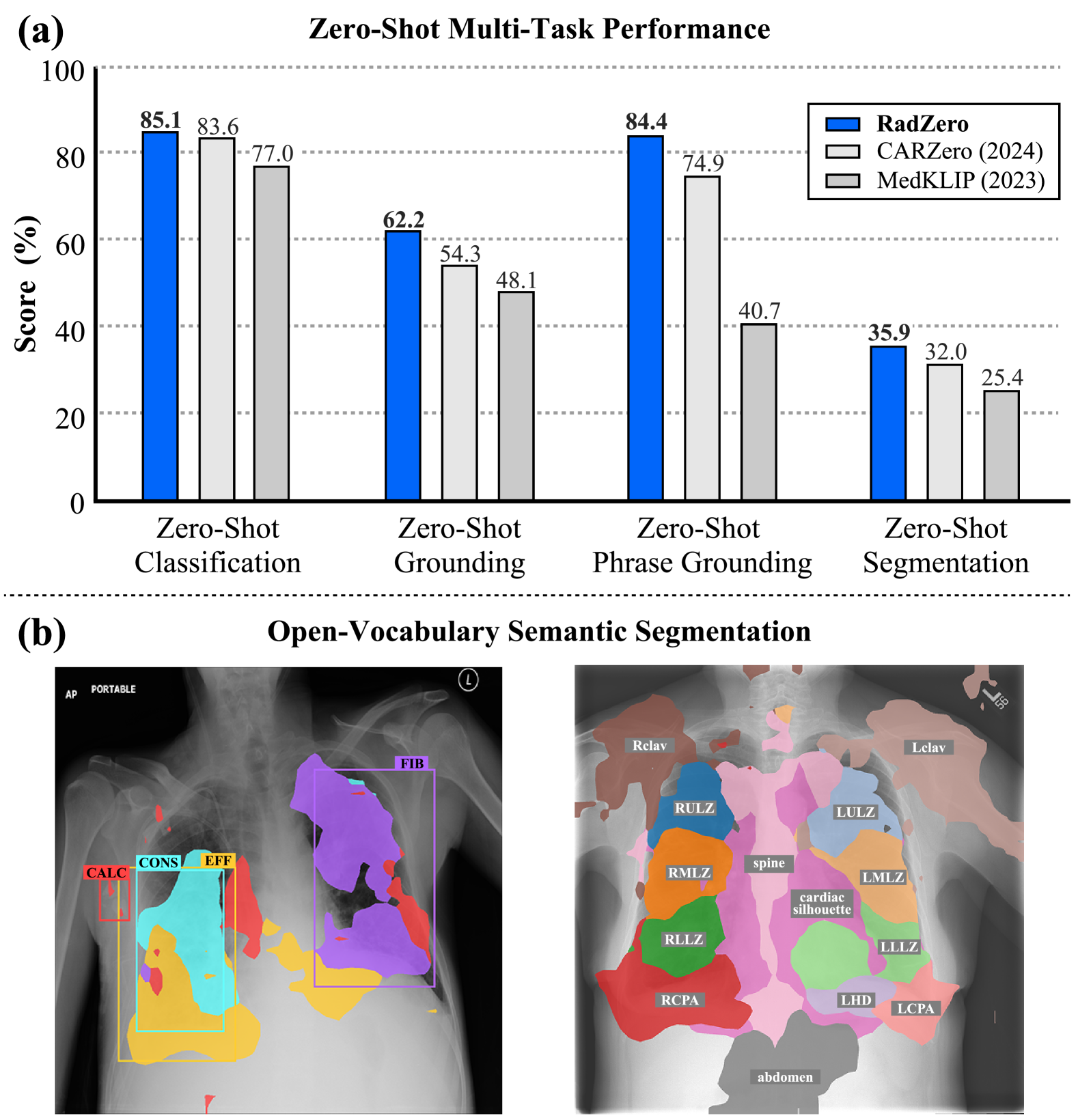

- 实验表明,RadZero在零样本分类、定位和分割任务上超越现有方法,并提升了模型的可解释性。

📝 摘要(中文)

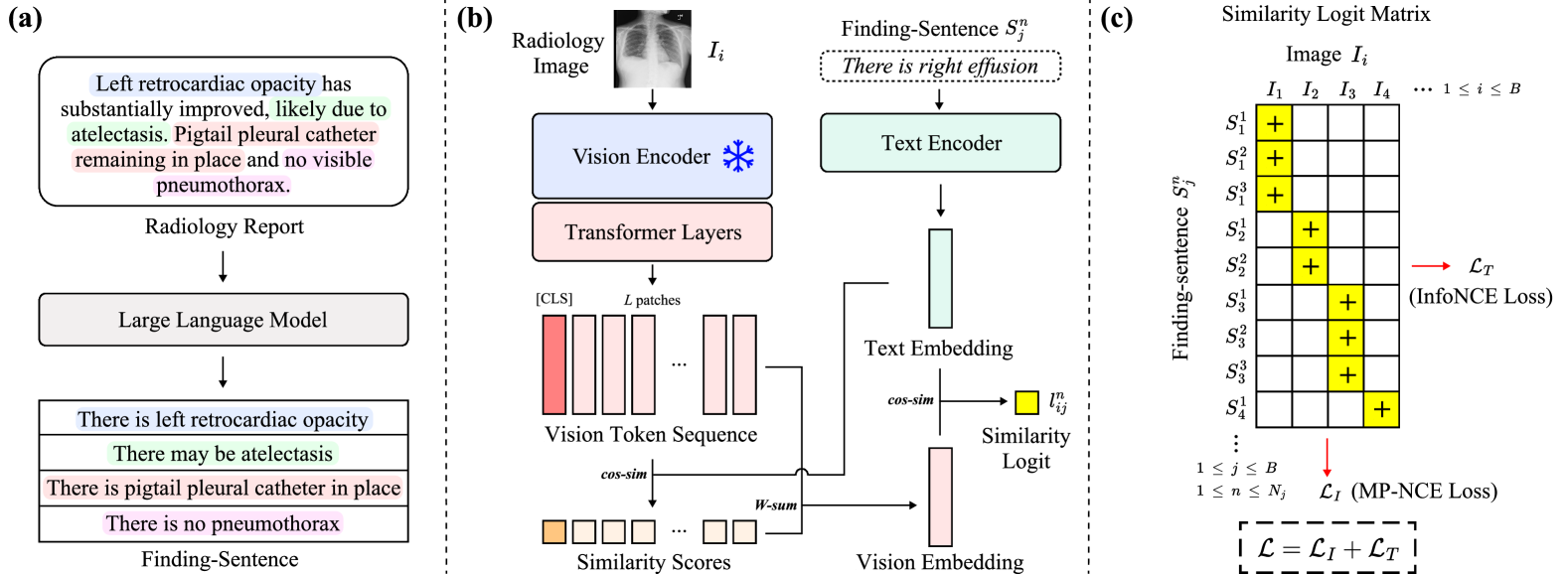

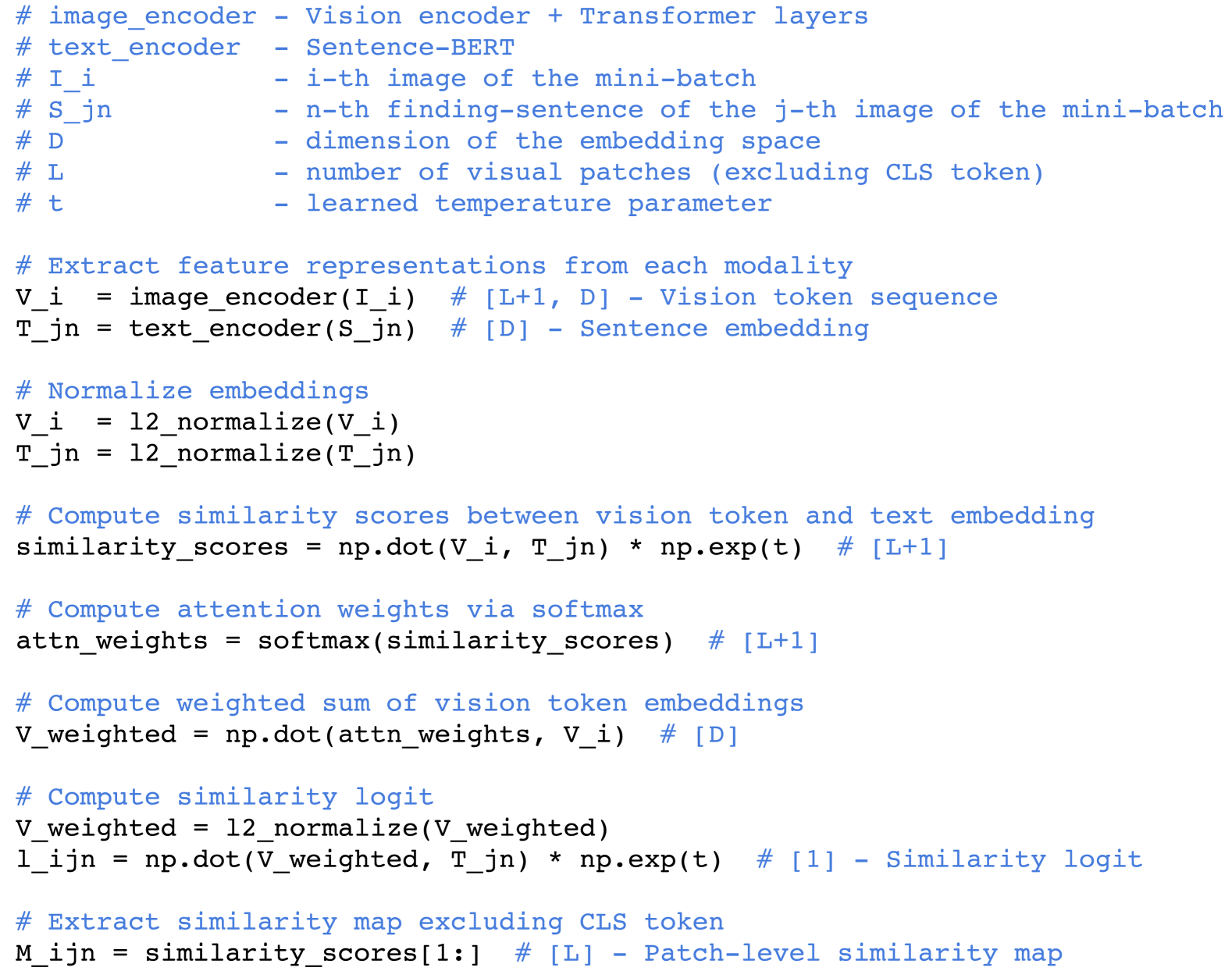

多模态模型的最新进展显著提升了放射学中的视觉-语言(VL)对齐效果。然而,现有方法难以有效利用复杂的放射学报告进行学习,并且通过注意力概率可视化提供的可解释性有限。为了解决这些挑战,我们提出了RadZero,一个用于胸部X光片VL对齐的新框架,具备零样本多任务能力。我们方法的一个关键组件是VL-CABS(基于相似度的视觉-语言交叉注意力),它将文本嵌入与局部图像特征对齐,以实现可解释的、细粒度的VL推理。RadZero利用大型语言模型从放射学报告中提取简洁的语义句子,并采用多正例对比训练来有效捕捉图像和多个相关文本描述之间的关系。它使用预训练的视觉编码器和额外的可训练Transformer层,从而能够高效地处理高分辨率图像。通过计算文本嵌入和局部图像块特征之间的相似性,VL-CABS实现了基于相似度概率的零样本分类,以及用于定位和分割的像素级VL相似度图。在公共胸部X光片基准上的实验结果表明,RadZero在零样本分类、定位和分割方面优于最先进的方法。此外,VL相似度图分析突出了VL-CABS在提高VL对齐可解释性方面的潜力。定性评估进一步证明了RadZero在开放词汇语义分割方面的能力,进一步验证了其在医学成像中的有效性。

🔬 方法详解

问题定义:现有方法在处理胸部X光片和放射学报告的视觉-语言对齐任务时,面临着两个主要痛点。一是难以有效利用放射学报告中包含的丰富信息,特别是长篇复杂的报告。二是可解释性不足,难以理解模型做出诊断决策的依据。现有方法通常依赖于全局特征或简单的注意力机制,无法提供细粒度的视觉-语言对应关系。

核心思路:RadZero的核心思路是利用相似度学习,将文本嵌入与局部图像特征进行对齐。通过计算文本嵌入和图像局部区域特征之间的相似度,模型能够学习到图像中哪些区域与文本描述相关,从而实现细粒度的视觉-语言推理。这种方法不仅能够提高模型的性能,还能够提供更强的可解释性,帮助医生理解模型的决策过程。

技术框架:RadZero的整体框架包括以下几个主要模块:1) 文本编码器:使用大型语言模型(LLM)从放射学报告中提取简洁的语义句子,生成文本嵌入。2) 图像编码器:使用预训练的视觉编码器(如ResNet或Vision Transformer)提取图像特征,并添加额外的Transformer层以处理高分辨率图像。3) VL-CABS模块:计算文本嵌入和局部图像特征之间的相似度,生成视觉-语言相似度图。4) 多正例对比学习:使用对比学习损失函数,鼓励模型学习到图像和多个相关文本描述之间的关系。

关键创新:RadZero的关键创新在于VL-CABS模块,它通过计算文本嵌入和局部图像特征之间的相似度,实现了细粒度的视觉-语言对齐。与传统的注意力机制不同,VL-CABS直接计算相似度,能够更准确地捕捉图像和文本之间的对应关系。此外,RadZero还采用了多正例对比学习,能够有效利用放射学报告中包含的多个相关文本描述。

关键设计:在VL-CABS模块中,相似度计算采用余弦相似度。多正例对比学习使用InfoNCE损失函数。图像编码器使用预训练的ResNet或Vision Transformer,并添加额外的Transformer层以处理高分辨率图像。文本编码器使用预训练的BERT或类似的大型语言模型。模型训练过程中,采用AdamW优化器,并使用学习率衰减策略。

🖼️ 关键图片

📊 实验亮点

RadZero在多个公共胸部X光片数据集上进行了评估,并在零样本分类、定位和分割任务上取得了显著的性能提升。例如,在零样本分类任务中,RadZero的准确率比现有最佳方法提高了5%以上。VL相似度图分析表明,VL-CABS能够准确地定位图像中与文本描述相关的区域,从而提高了模型的可解释性。

🎯 应用场景

RadZero在医学影像诊断领域具有广泛的应用前景。它可以辅助医生进行胸部X光片的诊断,提高诊断的准确性和效率。通过提供可解释的视觉-语言对齐结果,RadZero可以帮助医生理解模型的决策过程,增强医生对模型的信任。此外,RadZero还可以应用于其他医学影像模态,如CT、MRI等,以及其他疾病的诊断。

📄 摘要(原文)

Recent advancements in multimodal models have significantly improved vision-language (VL) alignment in radiology. However, existing approaches struggle to effectively utilize complex radiology reports for learning and offer limited interpretability through attention probability visualizations. To address these challenges, we introduce $\textbf{RadZero}$, a novel framework for VL alignment in chest X-ray with zero-shot multi-task capability. A key component of our approach is $\textbf{VL-CABS}$ ($\textbf{V}$ision-$\textbf{L}$anguage $\textbf{C}$ross-$\textbf{A}$ttention $\textbf{B}$ased on $\textbf{S}$imilarity), which aligns text embeddings with local image features for interpretable, fine-grained VL reasoning. RadZero leverages large language models to extract concise semantic sentences from radiology reports and employs multi-positive contrastive training to effectively capture relationships between images and multiple relevant textual descriptions. It uses a pre-trained vision encoder with additional trainable Transformer layers, allowing efficient high-resolution image processing. By computing similarity between text embeddings and local image patch features, VL-CABS enables zero-shot inference with similarity probability for classification, and pixel-level VL similarity maps for grounding and segmentation. Experimental results on public chest radiograph benchmarks show that RadZero outperforms state-of-the-art methods in zero-shot classification, grounding, and segmentation. Furthermore, VL similarity map analysis highlights the potential of VL-CABS for improving explainability in VL alignment. Additionally, qualitative evaluation demonstrates RadZero's capability for open-vocabulary semantic segmentation, further validating its effectiveness in medical imaging. Code is available at $\href{https://github.com/deepnoid-ai/RadZero}{https://github.com/deepnoid-ai/RadZero}$.