Perception in Reflection

作者: Yana Wei, Liang Zhao, Kangheng Lin, En Yu, Yuang Peng, Runpei Dong, Jianjian Sun, Haoran Wei, Zheng Ge, Xiangyu Zhang, Vishal M. Patel

分类: cs.CV

发布日期: 2025-04-09

💡 一句话要点

提出反射感知(RePer)框架,提升大型视觉语言模型(LVLMs)的感知能力。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 反射感知 迭代学习 图像理解 多模态学习

📋 核心要点

- 现有大型视觉语言模型(LVLMs)在初始感知阶段存在不足,难以达到理想的感知效果。

- 论文提出反射感知(RePer)框架,通过策略模型和评论模型的交替迭代,实现视觉感知的逐步优化。

- 实验结果表明,RePer在图像理解、字幕精度和减少幻觉方面均有显著提升,并能更好对齐人类视觉焦点。

📝 摘要(中文)

本文提出了一种反射感知范式,旨在超越当前大型视觉语言模型(LVLMs)的局限性,这些模型通常无法在初始阶段实现完美的感知。具体来说,我们提出了反射感知(RePer),这是一种双模型反射机制,系统地在策略模型和评论模型之间交替,从而能够迭代地改进视觉感知。该框架由反射感知学习(RPL)提供支持,RPL通过有条不紊地构建视觉反射数据集和反射非似然训练来增强内在的反射能力。全面的实验评估表明,RePer在图像理解、字幕精度和减少幻觉方面都有可量化的改进。值得注意的是,RePer实现了模型注意力模式与人类视觉焦点之间的强大对齐,而RPL优化了细粒度和自由形式的偏好对齐。这些进步确立了反射感知作为未来多模态代理的强大范式,特别是在需要复杂推理和多步骤操作的任务中。

🔬 方法详解

问题定义:现有的大型视觉语言模型(LVLMs)在复杂场景下的感知能力不足,容易产生幻觉,无法准确理解图像内容,导致下游任务性能受限。现有方法缺乏有效的机制来迭代修正感知错误,难以实现精细化的视觉理解。

核心思路:论文的核心思路是引入一种“反射”机制,模仿人类的自我反思过程,通过策略模型生成感知结果,然后由评论模型评估并提供反馈,策略模型根据反馈不断修正,从而迭代提升感知能力。这种双模型交互的方式能够有效地发现和纠正感知错误。

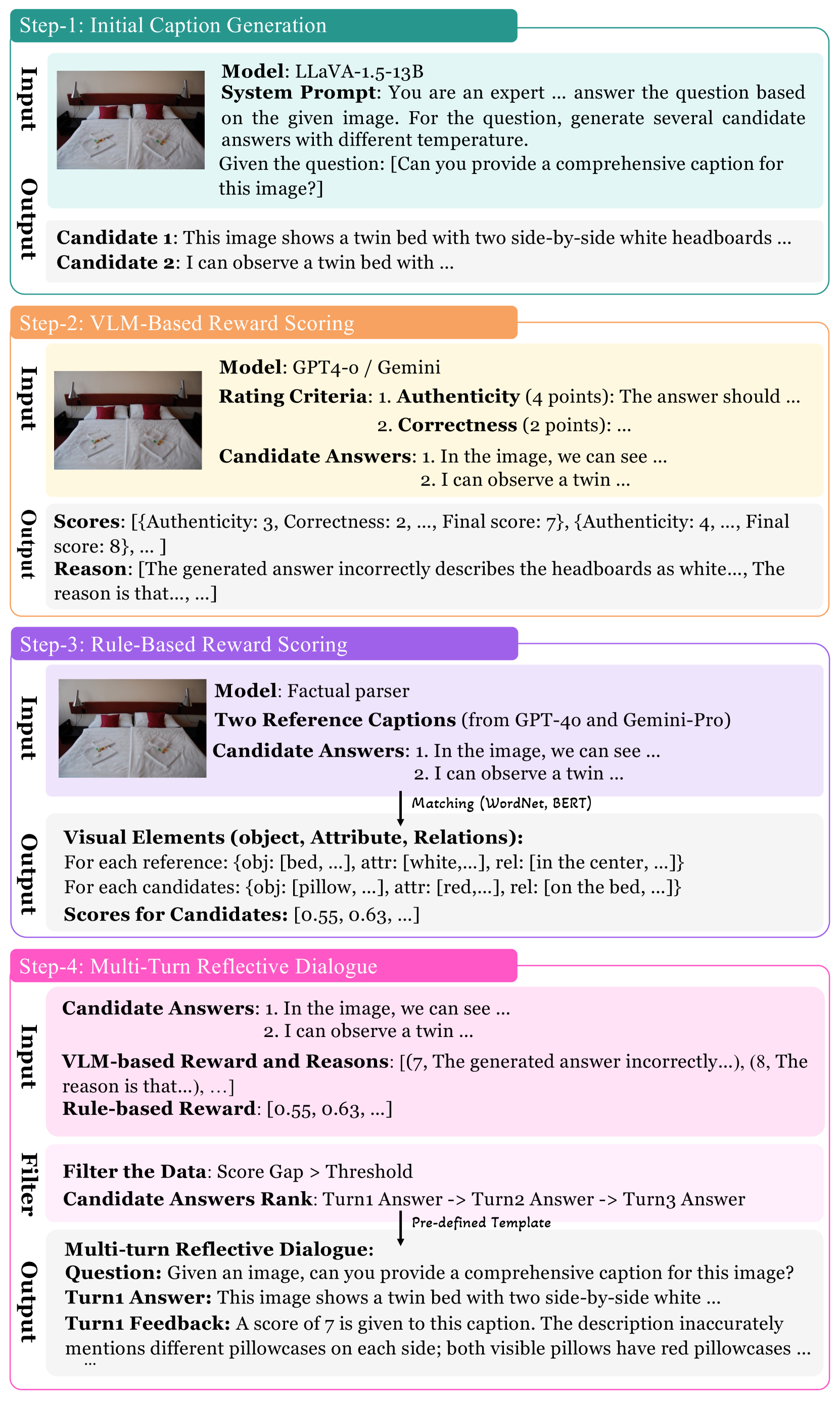

技术框架:RePer框架包含两个主要模块:策略模型和评论模型。策略模型负责生成对图像的初始感知结果(例如,图像描述)。评论模型则负责评估策略模型的输出,并提供反馈信号,例如,指出描述中的错误或不准确之处。策略模型根据评论模型的反馈,调整自身的参数,从而改进后续的感知结果。整个过程迭代进行,直到达到满意的感知水平。此外,还引入了反射感知学习(RPL),通过构建视觉反射数据集和反射非似然训练,增强模型的反射能力。

关键创新:RePer的关键创新在于引入了双模型反射机制,将策略模型和评论模型结合起来,通过迭代反馈的方式提升视觉感知能力。与传统的单模型方法相比,RePer能够更有效地发现和纠正感知错误,从而提高图像理解的准确性和鲁棒性。反射感知学习(RPL)也是一个重要的创新,它通过专门设计的数据集和训练方法,增强了模型的自我反思能力。

关键设计:反射感知学习(RPL)中,视觉反射数据集的构建方式未知。反射非似然训练的具体损失函数设计未知。策略模型和评论模型的具体网络结构未知。迭代次数和停止准则未知。

🖼️ 关键图片

📊 实验亮点

RePer在图像理解、字幕精度和减少幻觉方面均有显著提升。模型注意力模式与人类视觉焦点实现了强大的对齐,表明RePer能够更准确地捕捉图像中的关键信息。RPL优化了细粒度和自由形式的偏好对齐,进一步提升了模型的感知能力。具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可应用于智能机器人、自动驾驶、智能监控等领域。通过提升视觉语言模型的感知能力,可以使机器人在复杂环境中更好地理解和交互,提高自动化系统的智能化水平。未来,该技术有望在多模态人机交互、智能辅助决策等领域发挥重要作用。

📄 摘要(原文)

We present a perception in reflection paradigm designed to transcend the limitations of current large vision-language models (LVLMs), which are expected yet often fail to achieve perfect perception initially. Specifically, we propose Reflective Perception (RePer), a dual-model reflection mechanism that systematically alternates between policy and critic models, enables iterative refinement of visual perception. This framework is powered by Reflective Perceptual Learning (RPL), which reinforces intrinsic reflective capabilities through a methodically constructed visual reflection dataset and reflective unlikelihood training. Comprehensive experimental evaluation demonstrates RePer's quantifiable improvements in image understanding, captioning precision, and hallucination reduction. Notably, RePer achieves strong alignment between model attention patterns and human visual focus, while RPL optimizes fine-grained and free-form preference alignment. These advancements establish perception in reflection as a robust paradigm for future multimodal agents, particularly in tasks requiring complex reasoning and multi-step manipulation.