Explaining Low Perception Model Competency with High-Competency Counterfactuals

作者: Sara Pohland, Claire Tomlin

分类: cs.CV, cs.AI, cs.LG

发布日期: 2025-04-07

期刊: Explainable Artificial Intelligence. xAI 2025. Communications in Computer and Information Science, vol 2580

DOI: 10.1007/978-3-032-08333-3

💡 一句话要点

提出五种生成高置信度反事实图像的方法,解释低感知模型能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 反事实图像 模型解释性 低模型能力 多模态学习 图像分类 不确定性估计

📋 核心要点

- 现有方法缺乏解释分类器预测不确定性的能力,无法有效诊断模型失效的原因。

- 利用反事实图像,通过生成高置信度的图像变体,来解释模型为何对原始图像缺乏信心。

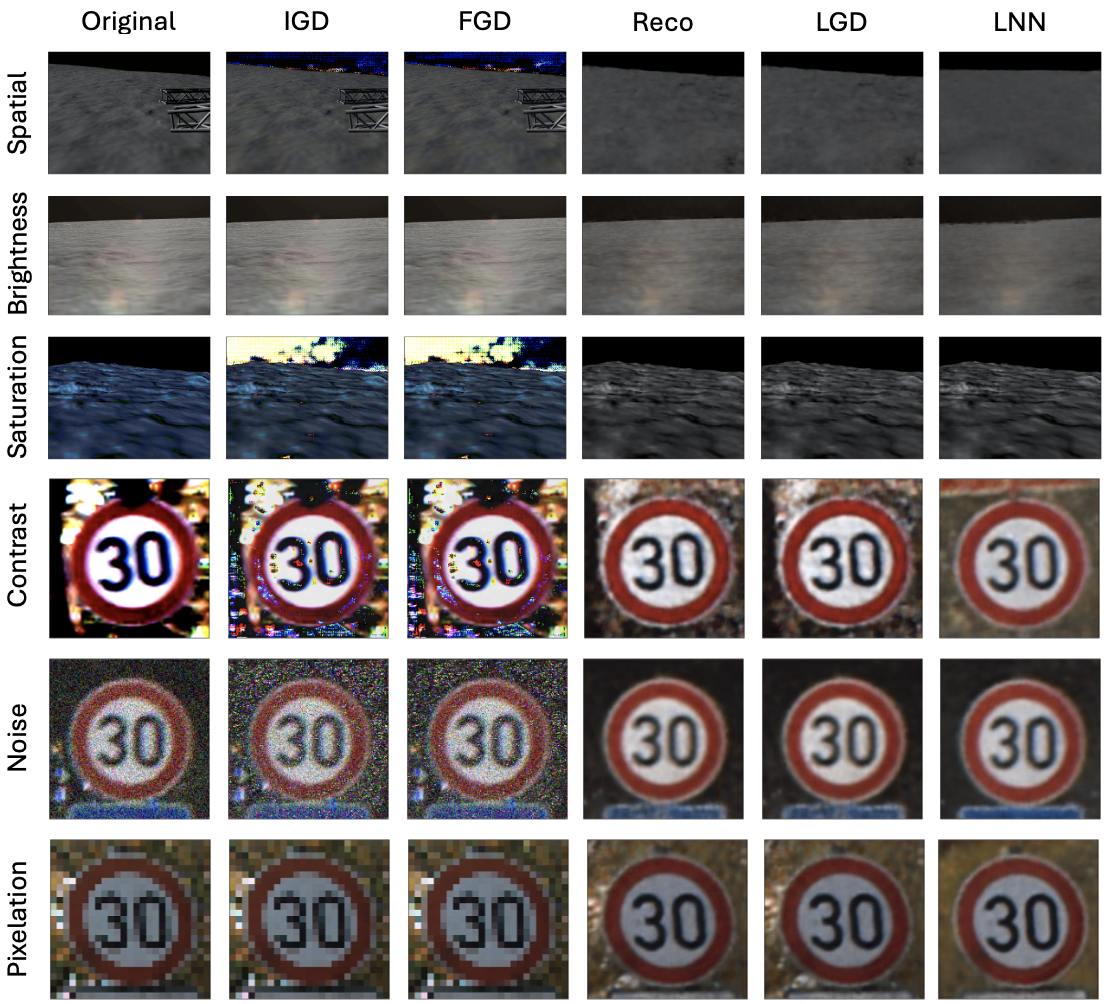

- 实验表明,自编码器重建(Reco)、潜在梯度下降(LGD)和潜在最近邻(LNN)方法效果最佳,并能提升MLLM的解释能力。

📝 摘要(中文)

现有的图像分类模型解释方法主要关注模型如何做出决策,而鲜少关注模型缺乏预测信心的原因。由于模型缺乏信心的原因多种多样,因此模型不仅应指示其不确定性水平,还应解释其不确定性的原因。反事实图像已被用于可视化对图像的更改,以生成不同的分类决策。本文探索使用反事实图像来解释低模型能力(一种衡量置信度的广义预测不确定性形式)。为此,我们开发了五种生成高能力反事实图像的新方法,即图像梯度下降(IGD)、特征梯度下降(FGD)、自编码器重建(Reco)、潜在梯度下降(LGD)和潜在最近邻(LNN)。我们在包含六种已知低模型能力原因的图像的两个独特数据集上评估了这些方法,发现 Reco、LGD 和 LNN 是最有希望的反事实生成方法。我们进一步评估了预训练的多模态大型语言模型(MLLM)如何利用这三种方法来生成低模型能力的语言解释。我们发现,在语言模型查询中包含反事实图像大大提高了模型生成对低模型能力原因的准确解释的能力,从而证明了反事实图像在解释低感知模型能力中的效用。

🔬 方法详解

问题定义:论文旨在解决图像分类模型在预测时缺乏信心的问题,即“低模型能力”。现有方法主要关注解释模型如何做出决策,而忽略了解释模型为何不确定。这种不确定性可能源于多种因素,例如图像质量差、遮挡、噪声等,现有方法无法有效诊断这些问题。

核心思路:论文的核心思路是利用反事实图像来解释低模型能力。具体来说,通过生成与原始图像相似但模型具有高置信度的反事实图像,可以揭示导致模型不确定性的关键因素。例如,如果模型对模糊的图像缺乏信心,那么清晰化的反事实图像就能解释这种不确定性。

技术框架:整体框架包括以下几个阶段:1) 输入原始图像;2) 使用五种不同的方法(IGD, FGD, Reco, LGD, LNN)生成高能力反事实图像;3) 使用预训练的多模态大型语言模型(MLLM),结合原始图像和反事实图像,生成对低模型能力的语言解释;4) 评估不同方法生成的反事实图像对MLLM解释能力的提升效果。

关键创新:论文的关键创新在于提出了五种生成高能力反事实图像的新方法,并将其应用于解释低模型能力。这些方法涵盖了图像空间、特征空间和潜在空间,为生成反事实图像提供了多样化的选择。此外,论文还探索了如何利用反事实图像来提升多模态大型语言模型的解释能力。

关键设计:五种反事实图像生成方法各有特点: * Image Gradient Descent (IGD): 直接在图像像素空间使用梯度下降,优化目标是提高模型置信度。 * Feature Gradient Descent (FGD): 在模型的中间特征层使用梯度下降,优化目标是提高模型置信度。 * Autoencoder Reconstruction (Reco): 使用自编码器重建图像,期望去除噪声或伪影,提高模型置信度。 * Latent Gradient Descent (LGD): 在自编码器的潜在空间使用梯度下降,优化目标是提高模型置信度。 * Latent Nearest Neighbors (LNN): 在自编码器的潜在空间寻找最近邻,期望找到高置信度的相似图像。

🖼️ 关键图片

📊 实验亮点

实验结果表明,自编码器重建(Reco)、潜在梯度下降(LGD)和潜在最近邻(LNN)方法在生成高能力反事实图像方面表现最佳。将这些方法生成的反事实图像输入多模态大型语言模型(MLLM)后,MLLM生成对低模型能力原因的准确解释的能力显著提高,证明了反事实图像在解释低感知模型能力中的有效性。具体提升幅度未知。

🎯 应用场景

该研究成果可应用于自动驾驶、医疗影像诊断、安防监控等领域。通过解释模型的不确定性,可以提高模型的可信度和安全性,辅助人类决策。例如,在自动驾驶中,如果模型对某个交通标志识别不确定,可以通过生成反事实图像来分析原因,并采取相应的安全措施。未来,该方法可以扩展到其他感知任务和模型,例如目标检测、语义分割等。

📄 摘要(原文)

There exist many methods to explain how an image classification model generates its decision, but very little work has explored methods to explain why a classifier might lack confidence in its prediction. As there are various reasons the classifier might lose confidence, it would be valuable for this model to not only indicate its level of uncertainty but also explain why it is uncertain. Counterfactual images have been used to visualize changes that could be made to an image to generate a different classification decision. In this work, we explore the use of counterfactuals to offer an explanation for low model competency--a generalized form of predictive uncertainty that measures confidence. Toward this end, we develop five novel methods to generate high-competency counterfactual images, namely Image Gradient Descent (IGD), Feature Gradient Descent (FGD), Autoencoder Reconstruction (Reco), Latent Gradient Descent (LGD), and Latent Nearest Neighbors (LNN). We evaluate these methods across two unique datasets containing images with six known causes for low model competency and find Reco, LGD, and LNN to be the most promising methods for counterfactual generation. We further evaluate how these three methods can be utilized by pre-trained Multimodal Large Language Models (MLLMs) to generate language explanations for low model competency. We find that the inclusion of a counterfactual image in the language model query greatly increases the ability of the model to generate an accurate explanation for the cause of low model competency, thus demonstrating the utility of counterfactual images in explaining low perception model competency.