Targetless LiDAR-Camera Calibration with Neural Gaussian Splatting

作者: Haebeom Jung, Namtae Kim, Jungwoo Kim, Jaesik Park

分类: cs.CV

发布日期: 2025-04-06 (更新: 2025-10-09)

备注: Project page: https://zang09.github.io/tlc-calib-site

💡 一句话要点

提出基于神经高斯溅射的无目标LiDAR-相机联合标定方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: LiDAR-相机标定 无目标标定 神经高斯溅射 多传感器融合 自动驾驶

📋 核心要点

- 传统LiDAR-相机标定依赖物理目标,部署困难且易受传感器漂移影响,需要定期重新标定。

- 论文提出TLC-Calib,通过神经高斯表示联合优化传感器位姿,实现无目标、鲁棒的标定。

- 实验表明,该方法在多个数据集上优于现有无目标方法,并在渲染质量上超越了提供的标定。

📝 摘要(中文)

精确的LiDAR-相机标定对于多传感器系统至关重要。然而,传统方法通常依赖于物理目标,这在实际部署中是不切实际的。此外,即使是精心标定的外参也会因传感器漂移或外部干扰而随时间退化,需要定期重新标定。为了解决这些挑战,我们提出了一种无目标LiDAR-相机标定(TLC-Calib)方法,该方法使用基于神经高斯的场景表示联合优化传感器位姿。可靠的LiDAR点被冻结为锚定高斯,以保持全局结构,而辅助高斯则防止噪声初始化下的局部过拟合。我们完全可微的流水线通过光度和几何正则化实现了鲁棒和泛化的标定,在KITTI-360、Waymo和FAST-LIVO2上始终优于现有的无目标方法,甚至超过了提供的标定在渲染质量上的表现。

🔬 方法详解

问题定义:论文旨在解决LiDAR-相机标定中对物理目标的依赖问题,以及传感器漂移导致的标定精度下降问题。现有方法要么需要预先设计的标定板,要么在实际场景中难以保证精度和鲁棒性。这些痛点限制了多传感器系统在复杂环境中的应用。

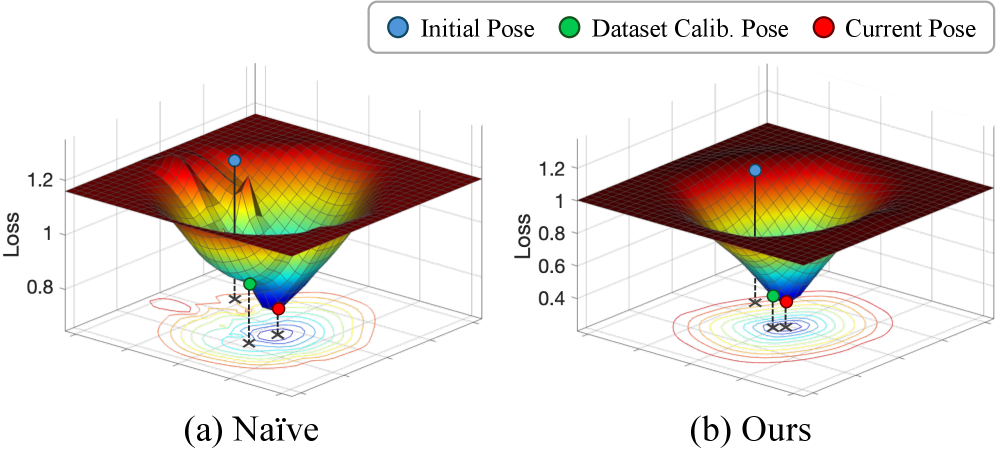

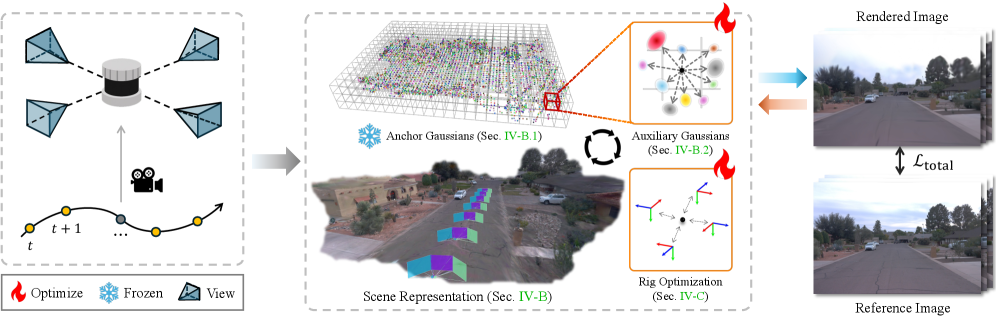

核心思路:论文的核心思路是利用神经高斯溅射(Neural Gaussian Splatting, NGS)来表示场景,并将其与LiDAR点云和相机图像进行对齐。通过优化NGS的参数以及LiDAR和相机的相对位姿,实现无目标的标定。这种方法避免了对特定标定物的依赖,并且能够利用场景的几何和光度信息来提高标定精度。

技术框架:TLC-Calib的整体框架包含以下几个主要步骤:1) 使用LiDAR点云初始化场景的全局结构,并将可靠的点冻结为锚定高斯。2) 添加辅助高斯来增强局部细节,并防止在噪声初始化下的过拟合。3) 构建一个完全可微的流水线,该流水线包含光度损失和几何损失,用于优化NGS参数和传感器位姿。4) 通过迭代优化,最终得到精确的LiDAR-相机标定结果。

关键创新:该方法最重要的创新点在于将神经高斯溅射引入到LiDAR-相机标定中,实现了无目标的标定。与传统方法相比,该方法不需要预先设计的标定板,并且能够利用场景的几何和光度信息来提高标定精度。此外,通过冻结锚定高斯和添加辅助高斯,可以有效地提高标定的鲁棒性和泛化能力。

关键设计:在技术细节方面,论文采用了以下关键设计:1) 使用光度损失来约束渲染图像与真实图像的一致性。2) 使用几何损失来约束LiDAR点云与NGS表示的场景的一致性。3) 通过冻结锚定高斯来保持全局结构,并使用辅助高斯来增强局部细节。4) 采用Adam优化器进行迭代优化,并设置合适的学习率和迭代次数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TLC-Calib在KITTI-360、Waymo和FAST-LIVO2数据集上均优于现有的无目标标定方法。在渲染质量方面,甚至超越了数据集提供的标定结果。这表明该方法具有很强的鲁棒性和泛化能力,能够在不同的场景和传感器配置下实现精确的标定。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、三维重建、增强现实等领域。精确的LiDAR-相机标定是这些应用的基础,能够提高感知系统的准确性和可靠性。该方法无需特定标定物,降低了部署成本,并能适应动态环境,具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

Accurate LiDAR-camera calibration is crucial for multi-sensor systems. However, traditional methods often rely on physical targets, which are impractical for real-world deployment. Moreover, even carefully calibrated extrinsics can degrade over time due to sensor drift or external disturbances, necessitating periodic recalibration. To address these challenges, we present a Targetless LiDAR-Camera Calibration (TLC-Calib) that jointly optimizes sensor poses with a neural Gaussian-based scene representation. Reliable LiDAR points are frozen as anchor Gaussians to preserve global structure, while auxiliary Gaussians prevent local overfitting under noisy initialization. Our fully differentiable pipeline with photometric and geometric regularization achieves robust and generalizable calibration, consistently outperforming existing targetless methods on KITTI-360, Waymo, and FAST-LIVO2, and surpassing even the provided calibrations in rendering quality.