Simultaneous Motion And Noise Estimation with Event Cameras

作者: Shintaro Shiba, Yoshimitsu Aoki, Guillermo Gallego

分类: cs.CV, cs.AI, eess.IV

发布日期: 2025-04-05 (更新: 2025-08-01)

备注: 13 pages, 13 figures, 6 tables, Project page https://github.com/tub-rip/ESMD

期刊: IEEE/CVF International Conference on Computer Vision (ICCV), 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出事件相机运动与噪声同步估计方法,提升去噪和运动估计性能

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 事件相机 去噪 运动估计 噪声估计 对比度最大化

📋 核心要点

- 事件相机噪声难以建模,传统去噪方法忽略了运动信息与噪声的内在联系,导致性能受限。

- 提出一种运动与噪声同步估计框架,将运动估计融入去噪过程,利用运动信息辅助噪声抑制。

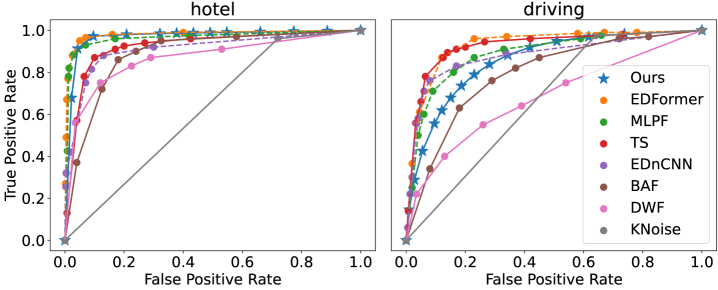

- 实验表明,该方法在去噪基准测试中达到SOTA或具有竞争力的结果,并在运动估计和强度重建任务中有效。

📝 摘要(中文)

事件相机是一种新兴的视觉传感器,其噪声特性难以描述。现有的事件相机去噪方法通常是孤立设计的,因此将其他任务(如运动估计)分开考虑(即在去噪后按顺序进行)。然而,运动是事件数据的内在组成部分,因为没有运动就无法感知场景边缘。据我们所知,我们提出了第一个同时估计各种形式的运动(例如,自运动、光流)和噪声的方法。该方法具有灵活性,因为它允许用任何其他运动估计器(如深度神经网络)替换广泛使用的对比度最大化框架的单步运动估计。实验表明,该方法在E-MLB去噪基准上取得了最先进的结果,并在DND21基准上取得了有竞争力的结果,同时证明了其在运动估计和强度重建任务中的有效性。我们的方法推进了事件数据去噪理论,并通过开源代码扩展了实际的去噪用例。

🔬 方法详解

问题定义:事件相机产生的事件流数据包含大量噪声,这些噪声会严重影响后续的视觉任务,如运动估计、三维重建等。现有的去噪方法通常将去噪和运动估计作为两个独立的步骤进行,忽略了事件数据中运动和噪声之间的内在联系。此外,事件相机的噪声特性难以准确建模,使得去噪任务更具挑战性。

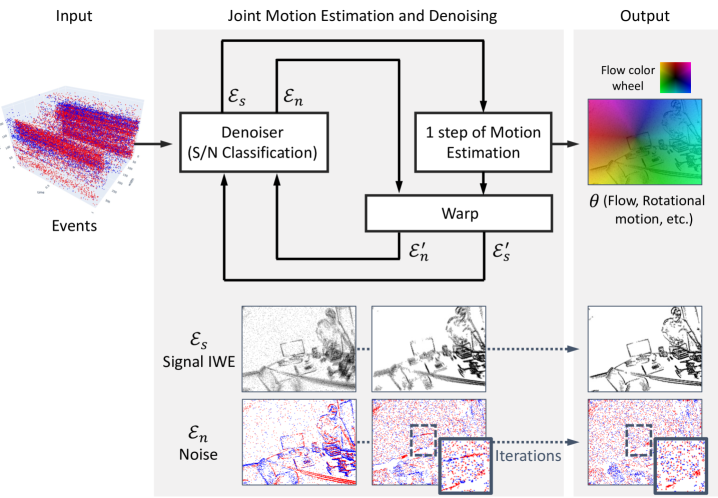

核心思路:该论文的核心思路是将运动估计和噪声估计融合到一个统一的框架中,同时优化运动参数和噪声模型。作者认为,事件的产生与场景的运动密切相关,因此可以利用运动信息来辅助噪声的抑制。通过同步估计运动和噪声,可以避免传统方法中因噪声干扰而导致的运动估计误差,从而提高去噪的准确性。

技术框架:该方法基于对比度最大化(Contrast Maximization)框架,但允许使用任何运动估计器替换原有的单步运动估计。整体流程如下:首先,输入事件流数据;然后,使用一个运动估计器(可以是传统的对比度最大化方法,也可以是深度神经网络)估计场景的运动参数;接着,利用估计的运动参数和事件数据,同时优化噪声模型和运动参数;最后,输出去噪后的事件流数据和估计的运动参数。

关键创新:该论文最重要的技术创新点在于提出了运动与噪声同步估计的框架。与传统方法相比,该框架能够充分利用运动信息来辅助噪声抑制,从而提高去噪的准确性。此外,该框架具有很强的灵活性,可以方便地集成不同的运动估计器,从而适应不同的应用场景。

关键设计:该方法的关键设计包括:1) 使用参数化的噪声模型来描述事件相机的噪声特性;2) 设计一个联合损失函数,同时优化运动参数和噪声模型的参数;3) 使用迭代优化算法来求解联合损失函数,从而得到最优的运动参数和噪声模型。具体的损失函数设计和优化算法的选择取决于所使用的运动估计器和噪声模型。

🖼️ 关键图片

📊 实验亮点

该方法在E-MLB去噪基准测试中取得了state-of-the-art的结果,表明其在事件数据去噪方面具有显著的优势。同时,在DND21基准测试中也取得了具有竞争力的结果。此外,该方法在运动估计和强度重建任务中也表现出良好的性能,验证了其在多个视觉任务中的有效性。

🎯 应用场景

该研究成果可应用于各种基于事件相机的视觉任务,如机器人导航、自动驾驶、增强现实等。通过提高事件数据的质量,可以提升这些应用在复杂环境下的鲁棒性和准确性。此外,该方法还可以用于事件相机的标定和校准,从而提高事件相机的测量精度。

📄 摘要(原文)

Event cameras are emerging vision sensors whose noise is challenging to characterize. Existing denoising methods for event cameras are often designed in isolation and thus consider other tasks, such as motion estimation, separately (i.e., sequentially after denoising). However, motion is an intrinsic part of event data, since scene edges cannot be sensed without motion. We propose, to the best of our knowledge, the first method that simultaneously estimates motion in its various forms (e.g., ego-motion, optical flow) and noise. The method is flexible, as it allows replacing the one-step motion estimation of the widely-used Contrast Maximization framework with any other motion estimator, such as deep neural networks. The experiments show that the proposed method achieves state-of-the-art results on the E-MLB denoising benchmark and competitive results on the DND21 benchmark, while demonstrating effectiveness across motion estimation and intensity reconstruction tasks. Our approach advances event-data denoising theory and expands practical denoising use-cases via open-source code. Project page: https://github.com/tub-rip/ESMD