OmniTalker: One-shot Real-time Text-Driven Talking Audio-Video Generation With Multimodal Style Mimicking

作者: Zhongjian Wang, Peng Zhang, Jinwei Qi, Guangyuan Wang, Chaonan Ji, Sheng Xu, Bang Zhang, Liefeng Bo

分类: cs.CV

发布日期: 2025-04-03 (更新: 2025-06-03)

备注: Project Page https://humanaigc.github.io/omnitalker

💡 一句话要点

OmniTalker:基于文本的实时说话人音视频生成,实现多模态风格模仿

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文本驱动生成 说话人生成 音视频同步 扩散Transformer 风格迁移

📋 核心要点

- 现有说话人生成方法在音频驱动方面取得了显著进展,但文本驱动的方法仍有待探索,面临风格迁移和实时性挑战。

- OmniTalker采用双分支扩散Transformer架构,通过跨模态融合和掩码填充策略,在无需显式风格提取的情况下,同时捕获音频和视觉风格。

- 实验结果表明,OmniTalker在生成质量、风格一致性和音视频同步方面优于现有方法,并实现了25 FPS的实时推理速度。

📝 摘要(中文)

本文提出OmniTalker,一个统一的框架,能够从输入文本中联合生成同步的说话人音视频内容,同时模仿目标人物的说话和面部运动风格,包括语音特征、头部运动和面部动态。该框架采用双分支扩散Transformer(DiT)架构,一个分支用于音频生成,另一个分支用于视频合成。在浅层,引入跨模态融合模块来整合两种模态的信息。在更深层,每个模态独立处理,生成的音频由声码器解码,视频使用基于GAN的高质量视觉渲染器渲染。利用DiT通过掩码填充策略实现的上下文学习能力,该模型可以同时捕获音频和视觉风格,而无需显式的风格提取模块。得益于DiT主干的效率和优化的视觉渲染器,OmniTalker实现了25 FPS的实时推理。据我们所知,OmniTalker是第一个能够实时联合建模语音和面部风格的one-shot框架。大量实验表明,它在生成质量方面优于现有方法,尤其是在保持风格一致性和确保精确的音视频同步方面,同时保持高效的推理。

🔬 方法详解

问题定义:现有文本驱动的说话人生成方法在风格迁移和实时性方面存在挑战。风格迁移方面,难以准确捕捉目标人物的语音和面部风格。实时性方面,现有方法通常计算复杂度高,难以满足实时应用的需求。

核心思路:OmniTalker的核心思路是利用双分支扩散Transformer(DiT)架构,分别处理音频和视频模态,并通过跨模态融合模块在浅层进行信息交互。同时,利用DiT的上下文学习能力,通过掩码填充策略,隐式地学习和迁移目标人物的风格,避免了显式的风格提取过程,从而提高了效率和灵活性。

技术框架:OmniTalker框架包含两个主要分支:音频生成分支和视频生成分支。两个分支都基于扩散Transformer(DiT)架构。在浅层,通过跨模态融合模块将文本信息融入到音频和视频分支中。在更深层,两个分支独立处理各自的模态信息。音频分支的输出通过声码器解码成音频,视频分支的输出通过基于GAN的视觉渲染器生成最终的视频。

关键创新:OmniTalker的关键创新在于:1) 提出了一种统一的框架,能够从文本同时生成同步的说话人音视频内容;2) 利用DiT的上下文学习能力,通过掩码填充策略,隐式地学习和迁移目标人物的风格,避免了显式的风格提取过程;3) 通过优化DiT架构和视觉渲染器,实现了实时推理速度。

关键设计:OmniTalker的关键设计包括:1) 双分支DiT架构,分别处理音频和视频模态;2) 跨模态融合模块,用于在浅层进行信息交互;3) 基于GAN的视觉渲染器,用于生成高质量的视频;4) 掩码填充策略,用于隐式地学习和迁移目标人物的风格。具体的参数设置、损失函数和网络结构等细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

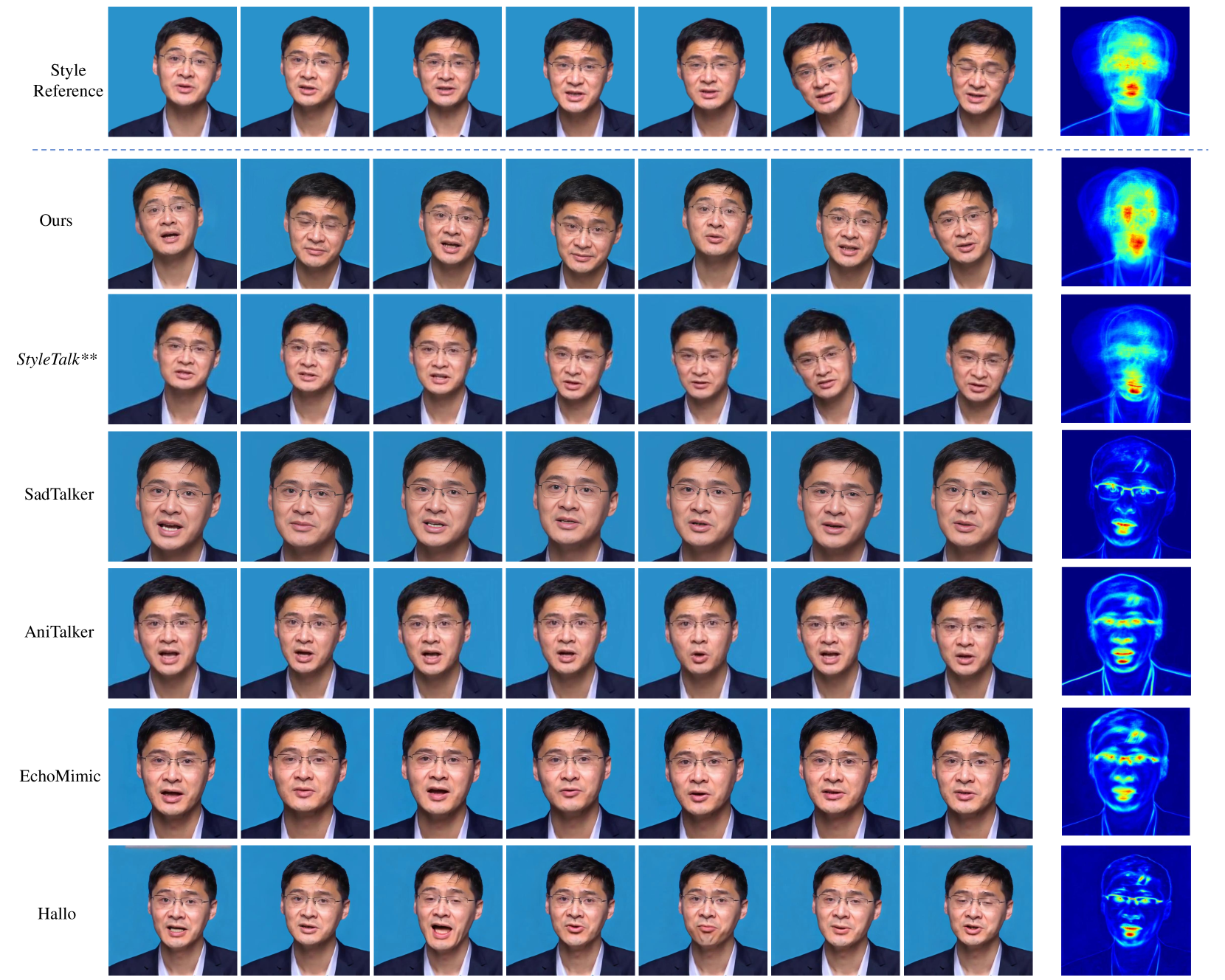

OmniTalker在实验中表现出优异的性能,能够生成高质量、风格一致且音视频同步的说话人内容。与现有方法相比,OmniTalker在风格保持和音视频同步方面取得了显著提升。更重要的是,OmniTalker实现了25 FPS的实时推理速度,使其能够应用于实时交互场景。

🎯 应用场景

OmniTalker具有广泛的应用前景,包括虚拟助手、游戏角色生成、在线教育、电影制作等领域。它可以根据文本内容,快速生成具有特定人物风格的说话人音视频,从而提高内容创作的效率和质量。此外,OmniTalker还可以用于个性化定制的音视频内容生成,满足不同用户的需求。

📄 摘要(原文)

Although significant progress has been made in audio-driven talking head generation, text-driven methods remain underexplored. In this work, we present OmniTalker, a unified framework that jointly generates synchronized talking audio-video content from input text while emulating the speaking and facial movement styles of the target identity, including speech characteristics, head motion, and facial dynamics. Our framework adopts a dual-branch diffusion transformer (DiT) architecture, with one branch dedicated to audio generation and the other to video synthesis. At the shallow layers, cross-modal fusion modules are introduced to integrate information between the two modalities. In deeper layers, each modality is processed independently, with the generated audio decoded by a vocoder and the video rendered using a GAN-based high-quality visual renderer. Leveraging the in-context learning capability of DiT through a masked-infilling strategy, our model can simultaneously capture both audio and visual styles without requiring explicit style extraction modules. Thanks to the efficiency of the DiT backbone and the optimized visual renderer, OmniTalker achieves real-time inference at 25 FPS. To the best of our knowledge, OmniTalker is the first one-shot framework capable of jointly modeling speech and facial styles in real time. Extensive experiments demonstrate its superiority over existing methods in terms of generation quality, particularly in preserving style consistency and ensuring precise audio-video synchronization, all while maintaining efficient inference.