All-day Depth Completion via Thermal-LiDAR Fusion

作者: Janghyun Kim, Minseong Kweon, Jinsun Park, Ukcheol Shin

分类: cs.CV, cs.RO

发布日期: 2025-04-03

💡 一句话要点

提出基于对比学习和伪监督的COPS框架,实现全天候热成像-LiDAR深度补全。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 深度补全 热成像 LiDAR 对比学习 伪监督 深度基础模型 恶劣环境 多模态融合

📋 核心要点

- 现有深度补全方法依赖RGB图像,在弱光、雨天等恶劣环境下性能受限,且真实深度图存在缺失导致监督不足。

- 论文提出COPS框架,利用热成像相机在恶劣环境下的优势,结合对比学习和伪监督策略提升深度补全效果。

- 实验表明,COPS框架能有效提升深度边界清晰度,提高深度补全精度,并在MS$^2$和ViViD数据集上进行了验证。

📝 摘要(中文)

深度补全旨在从稀疏LiDAR数据和RGB图像估计稠密深度图,并在光照良好的条件下表现出色。然而,由于RGB传感器的局限性,现有方法在恶劣环境(如暴雨和弱光)下难以获得可靠性能。此外,真实深度图在暴雨等恶劣天气下通常存在大量缺失测量,导致监督不足。相比之下,热成像相机在这种条件下能提供清晰可靠的可见性,但热成像-LiDAR深度补全的研究仍未充分探索。热成像的模糊、低对比度和噪声等特性带来了不清晰的深度边界问题。为了解决这些挑战,我们首先通过在MS$^2$和ViViD数据集上进行广泛的基准测试,评估了热成像-LiDAR深度补全在不同光照、天气和环境条件下的可行性和鲁棒性。此外,我们提出了一个利用对比学习和伪监督(COPS)的框架,通过两种关键方式利用深度基础模型来增强深度边界清晰度并提高补全精度。首先,COPS通过使用单目深度基础模型挖掘正负样本,在不同的深度点之间强制执行深度感知的对比损失,以锐化深度边界。其次,它通过利用基础模型预测作为稠密深度先验,缓解了来自真实深度图的不完整监督问题。我们还对热成像-LiDAR深度补全中的关键挑战进行了深入分析,以帮助理解该任务并鼓励未来的研究。

🔬 方法详解

问题定义:论文旨在解决恶劣天气和光照条件下,基于RGB图像的深度补全方法性能下降的问题。现有方法依赖RGB图像,在雨天、弱光等场景下图像质量差,导致深度补全结果不准确。此外,真实深度图本身也可能存在缺失,造成监督信息不足。

核心思路:论文的核心思路是利用热成像相机在恶劣环境下的鲁棒性,结合LiDAR数据进行深度补全。同时,利用深度基础模型提供的先验知识,通过对比学习锐化深度边界,并通过伪监督缓解真实深度图缺失带来的监督不足问题。

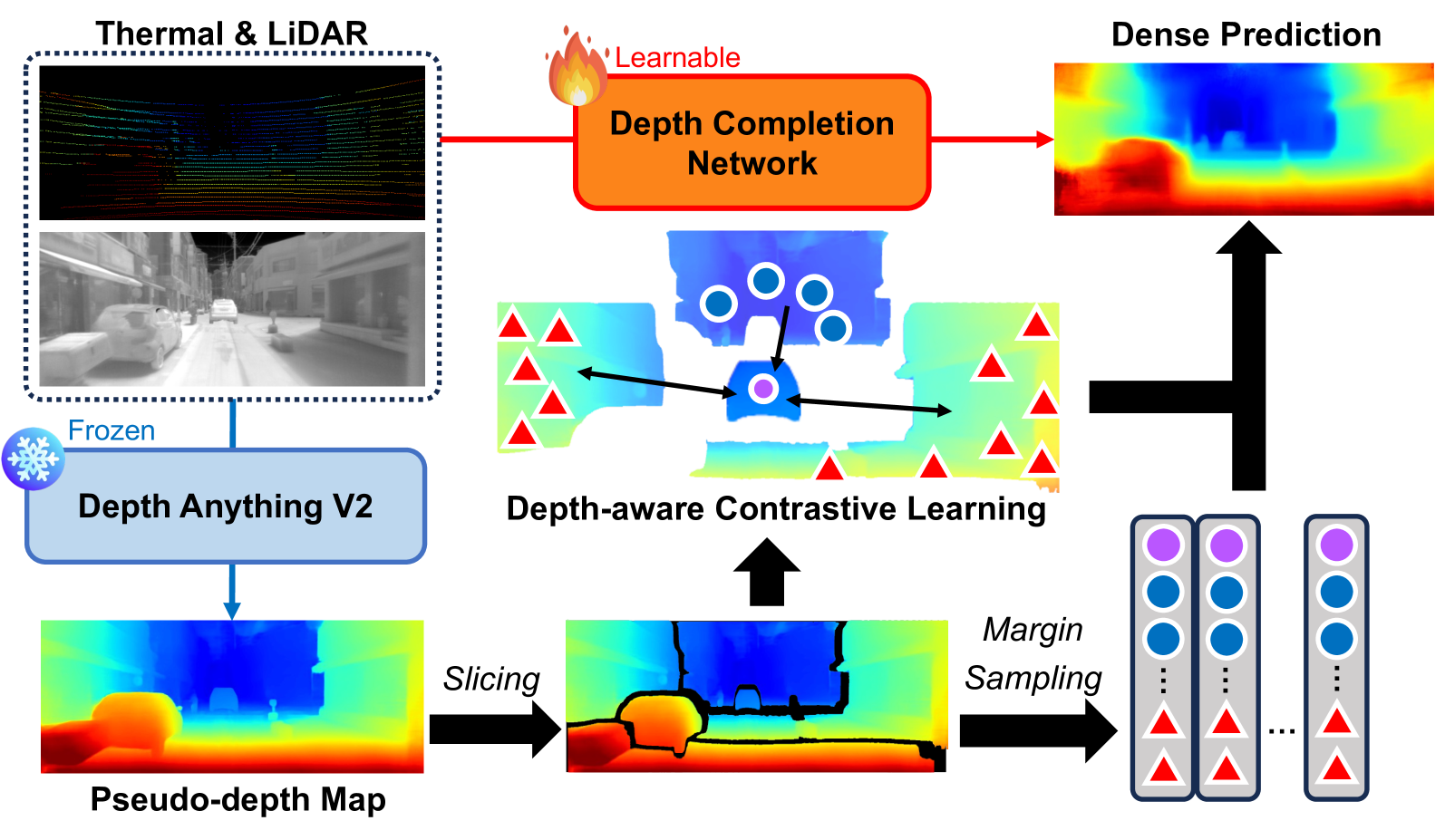

技术框架:COPS框架包含以下主要模块:1) 特征提取模块,用于提取热成像和LiDAR数据的特征;2) 对比学习模块,利用深度基础模型挖掘正负样本,计算深度感知的对比损失,锐化深度边界;3) 伪监督模块,利用深度基础模型预测的稠密深度图作为先验,补充真实深度图的缺失部分;4) 深度补全模块,融合提取的特征和先验信息,生成最终的稠密深度图。

关键创新:论文的关键创新在于:1) 首次探索了热成像-LiDAR深度补全的可行性,并进行了全面的基准测试;2) 提出了基于对比学习和伪监督的COPS框架,有效提升了深度边界清晰度和补全精度;3) 利用深度基础模型提供的先验知识,缓解了真实深度图缺失带来的监督不足问题。

关键设计:对比学习模块使用深度基础模型提取的深度特征作为指导,构建正负样本对,并计算InfoNCE损失。伪监督模块使用深度基础模型预测的深度图作为额外的监督信号,与真实深度图一起训练深度补全网络。损失函数包括深度回归损失、对比损失和伪监督损失,通过加权求和进行优化。

🖼️ 关键图片

📊 实验亮点

论文在MS$^2$和ViViD数据集上进行了实验,结果表明,COPS框架能够显著提升深度补全的精度和鲁棒性。相较于现有方法,COPS在恶劣天气和光照条件下的性能提升尤为明显。具体性能数据未知,但摘要强调了COPS在深度边界清晰度和补全精度上的提升。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、智能安防等领域。在恶劣天气和光照条件下,能够提供更准确、更可靠的深度信息,提高系统的环境感知能力和安全性。例如,在雨雾天气中,自动驾驶车辆可以利用该技术更准确地识别障碍物,避免交通事故。

📄 摘要(原文)

Depth completion, which estimates dense depth from sparse LiDAR and RGB images, has demonstrated outstanding performance in well-lit conditions. However, due to the limitations of RGB sensors, existing methods often struggle to achieve reliable performance in harsh environments, such as heavy rain and low-light conditions. Furthermore, we observe that ground truth depth maps often suffer from large missing measurements in adverse weather conditions such as heavy rain, leading to insufficient supervision. In contrast, thermal cameras are known for providing clear and reliable visibility in such conditions, yet research on thermal-LiDAR depth completion remains underexplored. Moreover, the characteristics of thermal images, such as blurriness, low contrast, and noise, bring unclear depth boundary problems. To address these challenges, we first evaluate the feasibility and robustness of thermal-LiDAR depth completion across diverse lighting (eg., well-lit, low-light), weather (eg., clear-sky, rainy), and environment (eg., indoor, outdoor) conditions, by conducting extensive benchmarks on the MS$^2$ and ViViD datasets. In addition, we propose a framework that utilizes COntrastive learning and Pseudo-Supervision (COPS) to enhance depth boundary clarity and improve completion accuracy by leveraging a depth foundation model in two key ways. First, COPS enforces a depth-aware contrastive loss between different depth points by mining positive and negative samples using a monocular depth foundation model to sharpen depth boundaries. Second, it mitigates the issue of incomplete supervision from ground truth depth maps by leveraging foundation model predictions as dense depth priors. We also provide in-depth analyses of the key challenges in thermal-LiDAR depth completion to aid in understanding the task and encourage future research.