UAVTwin: Neural Digital Twins for UAVs using Gaussian Splatting

作者: Jaehoon Choi, Dongki Jung, Yonghan Lee, Sungmin Eum, Dinesh Manocha, Heesung Kwon

分类: cs.CV

发布日期: 2025-04-02

💡 一句话要点

UAVTwin:利用高斯溅射为无人机创建神经数字孪生,实现数据增强

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 无人机 数字孪生 3D高斯溅射 数据增强 神经渲染 人体检测 合成数据

📋 核心要点

- 现有基于3DGS的建模方法在处理具有动态对象和外观变化的真实环境时,容易产生伪影,限制了其在无人机感知中的应用。

- UAVTwin通过结合3DGS重建背景和可控的合成人类模型,生成高保真数字孪生,从而实现无人机视角下的数据增强。

- 实验结果表明,UAVTwin在神经渲染质量和人体检测任务中均取得了显著提升,验证了其有效性。

📝 摘要(中文)

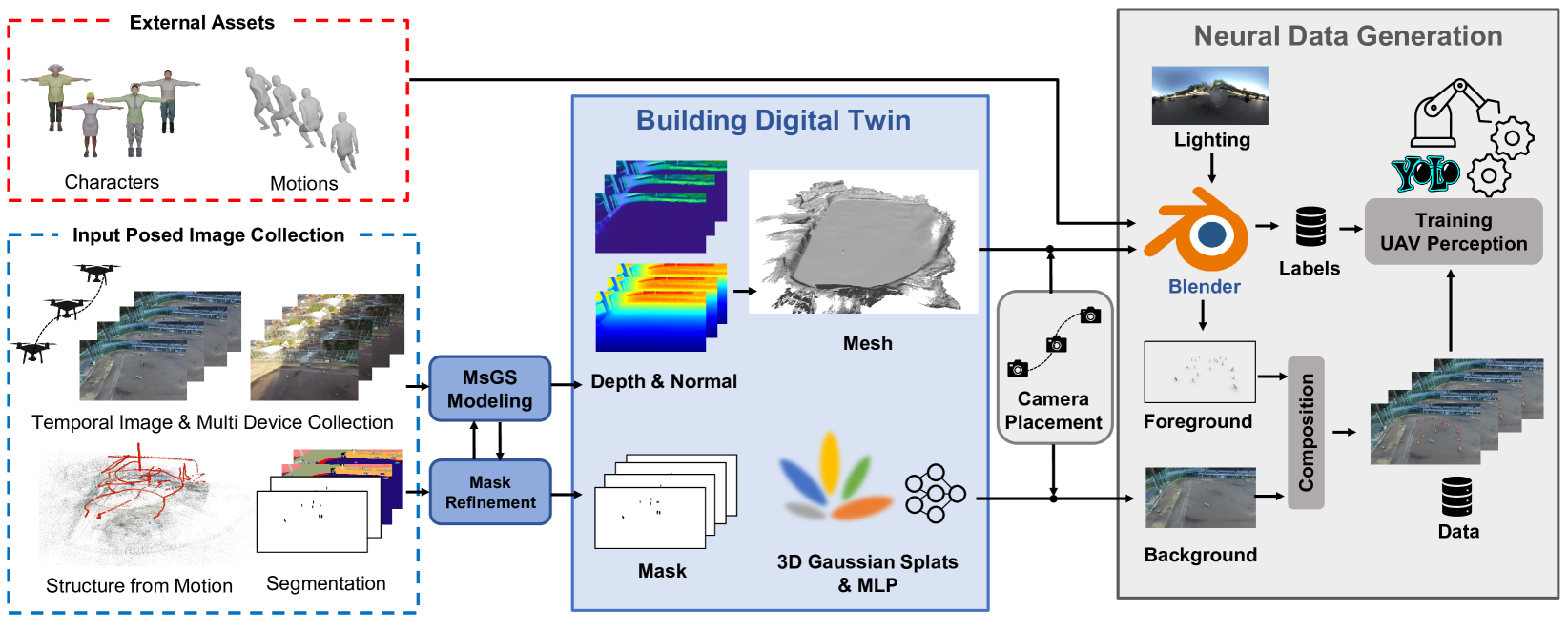

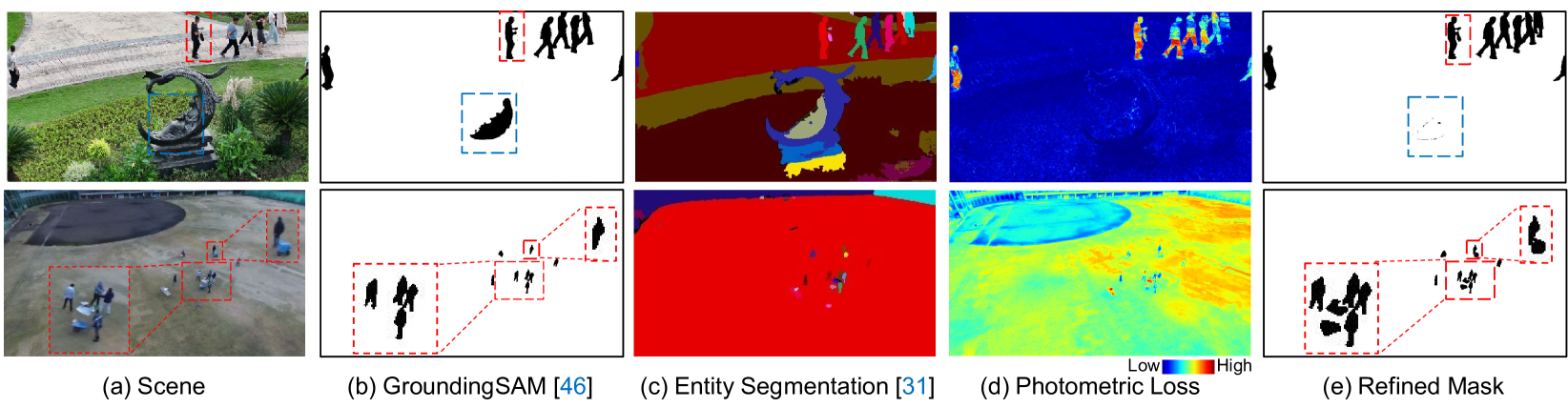

本文提出UAVTwin,一种从真实环境创建数字孪生并促进数据增强的方法,用于训练嵌入在无人机(UAV)中的下游模型。该方法专注于从无人机视角合成前景组件,例如复杂场景背景中运动的各种人类实例。通过集成3D高斯溅射(3DGS)来重建背景,并结合可控的合成人类模型,这些模型在多个姿势中展示不同的外观和动作来实现这一目标。据我们所知,UAVTwin是第一个基于无人机的感知方法,能够生成基于3DGS的高保真数字孪生。该方法通过数据增强显著增强了下游模型,适用于具有多个动态对象和显著外观变化的真实环境,这些因素通常会在基于3DGS的建模中引入伪影。为了解决这些挑战,我们提出了一种新颖的外观建模策略和一个掩码细化模块,以增强3D高斯溅射的训练。实验表明,与最近的方法相比,神经渲染的PSNR提高了1.23 dB。此外,通过在人体检测任务中mAP提高了2.5%到13.7%,验证了数据增强的有效性。

🔬 方法详解

问题定义:论文旨在解决无人机在复杂动态环境中进行感知时,由于数据不足和3DGS建模伪影导致性能下降的问题。现有方法难以在包含运动人物和外观变化的环境中生成高质量的数字孪生,从而限制了无人机下游任务的性能。

核心思路:论文的核心思路是利用3DGS重建静态背景,并结合可控的合成人类模型,生成包含动态前景对象的高保真数字孪生。通过数据增强,提升无人机感知模型在真实场景中的泛化能力。

技术框架:UAVTwin的整体框架包含以下几个主要模块:1) 使用3DGS重建静态背景;2) 引入可控的合成人类模型,并将其与3DGS背景融合;3) 提出新颖的外观建模策略,以处理外观变化;4) 设计掩码细化模块,以减少3DGS建模伪影。

关键创新:论文的关键创新在于:1) 提出了一种针对无人机视角的数字孪生生成方法,能够处理复杂的动态场景;2) 提出了一种新颖的外观建模策略,用于处理外观变化;3) 设计了一个掩码细化模块,用于减少3DGS建模伪影。与现有方法相比,UAVTwin能够生成更高质量的数字孪生,并显著提升下游任务的性能。

关键设计:论文的关键设计包括:1) 外观建模策略:具体实现细节未知;2) 掩码细化模块:具体实现细节未知;3) 损失函数:用于优化3DGS参数和合成人类模型的融合效果,具体形式未知;4) 数据增强策略:如何将合成数据与真实数据结合进行训练,具体细节未知。

🖼️ 关键图片

📊 实验亮点

UAVTwin在神经渲染质量方面取得了显著提升,PSNR比现有方法提高了1.23 dB。此外,通过数据增强,UAVTwin在人体检测任务中实现了2.5%到13.7%的mAP提升,验证了其在提升下游任务性能方面的有效性。这些实验结果表明,UAVTwin能够生成高质量的数字孪生,并显著提升无人机感知模型的性能。

🎯 应用场景

UAVTwin可应用于无人机巡检、安防监控、物流配送等领域。通过生成高质量的数字孪生,可以为无人机提供更丰富的训练数据,提升其在复杂环境中的感知能力,从而提高无人机任务的效率和安全性。未来,该技术有望扩展到其他机器人平台,例如自动驾驶汽车和移动机器人。

📄 摘要(原文)

We present UAVTwin, a method for creating digital twins from real-world environments and facilitating data augmentation for training downstream models embedded in unmanned aerial vehicles (UAVs). Specifically, our approach focuses on synthesizing foreground components, such as various human instances in motion within complex scene backgrounds, from UAV perspectives. This is achieved by integrating 3D Gaussian Splatting (3DGS) for reconstructing backgrounds along with controllable synthetic human models that display diverse appearances and actions in multiple poses. To the best of our knowledge, UAVTwin is the first approach for UAV-based perception that is capable of generating high-fidelity digital twins based on 3DGS. The proposed work significantly enhances downstream models through data augmentation for real-world environments with multiple dynamic objects and significant appearance variations-both of which typically introduce artifacts in 3DGS-based modeling. To tackle these challenges, we propose a novel appearance modeling strategy and a mask refinement module to enhance the training of 3D Gaussian Splatting. We demonstrate the high quality of neural rendering by achieving a 1.23 dB improvement in PSNR compared to recent methods. Furthermore, we validate the effectiveness of data augmentation by showing a 2.5% to 13.7% improvement in mAP for the human detection task.