Towards Understanding How Knowledge Evolves in Large Vision-Language Models

作者: Sudong Wang, Yunjian Zhang, Yao Zhu, Jianing Li, Zizhe Wang, Yanwei Liu, Xiangyang Ji

分类: cs.CV, cs.LG

发布日期: 2025-03-31 (更新: 2025-04-07)

备注: Accepted by CVPR 2025

🔗 代码/项目: GITHUB

💡 一句话要点

揭示大规模视觉语言模型中知识演化轨迹,为理解其内在机制提供新视角。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 知识演化 可解释性 多模态学习 深度学习

📋 核心要点

- 现有对LVLM内部机制的理解不足,限制了其能力的进一步提升,需要深入研究其知识演化过程。

- 论文设计新颖策略,从单token概率、token概率分布和特征编码三个层面分析LVLM内部知识的演化。

- 研究识别出知识演化的关键层和突变层,并将演化过程划分为快速演化、稳定和突变三个阶段。

📝 摘要(中文)

大型视觉语言模型(LVLMs)正逐渐成为众多人工智能应用的基础。然而,理解其内部工作机制一直困扰着研究人员,进而限制了其能力的进一步提升。本文旨在研究多模态知识如何在LVLMs中演化并最终诱导自然语言的产生。我们设计了一系列新颖的策略来分析LVLMs内部的知识,并从三个层面深入研究多模态知识的演化,包括单token概率、token概率分布和特征编码。在此过程中,我们识别出知识演化中的两个关键节点:关键层和突变层,将演化过程分为三个阶段:快速演化、稳定和突变。我们的研究首次揭示了LVLMs中知识演化的轨迹,为理解其底层机制提供了一个新的视角。

🔬 方法详解

问题定义:现有方法难以解释大型视觉语言模型(LVLMs)的内部工作机制,特别是多模态知识如何演化并最终生成自然语言。这阻碍了对LVLMs更深入的理解和进一步的性能提升。因此,该论文旨在揭示LVLMs中知识演化的轨迹,从而为理解其底层机制提供新的视角。

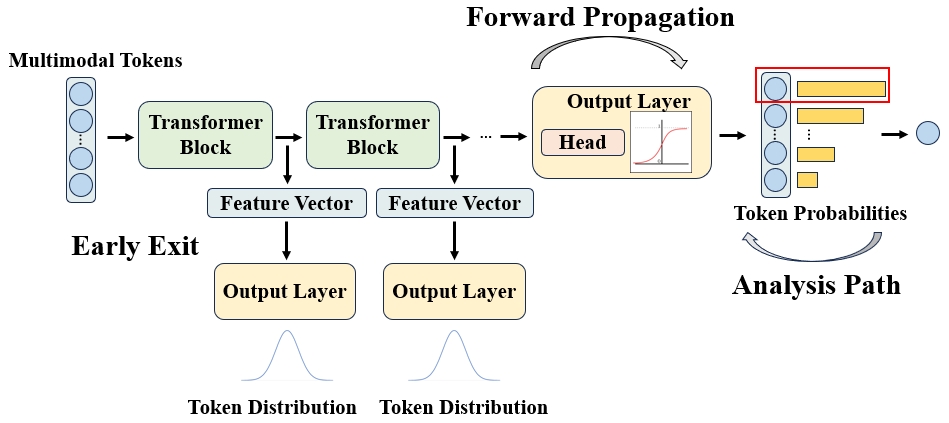

核心思路:该论文的核心思路是通过分析LVLMs内部不同层级的表征变化来追踪知识的演化过程。具体来说,它从单token概率、token概率分布和特征编码三个层面入手,观察这些指标在不同网络层中的变化趋势,从而推断知识的演化阶段和关键节点。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择目标LVLM模型;2) 设计分析策略,包括单token概率分析、token概率分布分析和特征编码分析;3) 通过前向传播获取模型在不同层的输出;4) 分析不同层级的表征变化,识别关键层和突变层;5) 将知识演化过程划分为快速演化、稳定和突变三个阶段。

关键创新:该论文的关键创新在于首次提出了研究LVLMs中知识演化轨迹的方法,并识别出知识演化过程中的关键层和突变层。通过多层级的分析,揭示了知识在LVLMs内部的演化规律,为理解其底层机制提供了新的思路。

关键设计:论文的关键设计包括:1) 选择具有代表性的LVLM模型作为研究对象;2) 设计了针对单token概率、token概率分布和特征编码的分析方法,以捕捉不同层级的知识变化;3) 定义了关键层和突变层的概念,并提出了相应的识别方法;4) 将知识演化过程划分为三个阶段,并分析了每个阶段的特点。

🖼️ 关键图片

📊 实验亮点

该研究首次揭示了LVLMs中知识演化的轨迹,识别出知识演化过程中的关键层和突变层,并将演化过程划分为快速演化、稳定和突变三个阶段。这些发现为理解LVLMs的底层机制提供了新的视角,并为未来的研究方向提供了指导。

🎯 应用场景

该研究成果可应用于提升LVLMs的可解释性和可控性。通过理解知识的演化过程,可以更好地优化模型结构、训练策略和知识注入方法,从而提升LVLMs在图像描述、视觉问答等任务中的性能。此外,该研究也有助于开发更安全、可靠的AI系统。

📄 摘要(原文)

Large Vision-Language Models (LVLMs) are gradually becoming the foundation for many artificial intelligence applications. However, understanding their internal working mechanisms has continued to puzzle researchers, which in turn limits the further enhancement of their capabilities. In this paper, we seek to investigate how multimodal knowledge evolves and eventually induces natural languages in LVLMs. We design a series of novel strategies for analyzing internal knowledge within LVLMs, and delve into the evolution of multimodal knowledge from three levels, including single token probabilities, token probability distributions, and feature encodings. In this process, we identify two key nodes in knowledge evolution: the critical layers and the mutation layers, dividing the evolution process into three stages: rapid evolution, stabilization, and mutation. Our research is the first to reveal the trajectory of knowledge evolution in LVLMs, providing a fresh perspective for understanding their underlying mechanisms. Our codes are available at https://github.com/XIAO4579/Vlm-interpretability.