AI-Assisted Colonoscopy: Polyp Detection and Segmentation using Foundation Models

作者: Uxue Delaquintana-Aramendi, Leire Benito-del-Valle, Aitor Alvarez-Gila, Javier Pascau, Luisa F Sánchez-Peralta, Artzai Picón, J Blas Pagador, Cristina L Saratxaga

分类: eess.IV, cs.CV

发布日期: 2025-03-31

备注: This work has been submitted to the IEEE TMI for possible publication

💡 一句话要点

利用Foundation Model进行AI辅助结肠镜息肉检测与分割

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 结肠镜检查 息肉检测 息肉分割 Foundation Model 零样本学习

📋 核心要点

- 结肠镜检查中息肉漏检率高,深度学习模型有潜力辅助医生提高检测率,但需要解决数据标注稀缺问题。

- 论文探索了Foundation Model在息肉检测和分割中的应用,利用其零样本/少样本学习能力,减少对大量标注数据的依赖。

- 实验结果表明,领域特定的Foundation Model(如MedSAM)或经过微调的通用模型,性能优于传统模型,甚至在零样本场景下超越微调模型。

📝 摘要(中文)

在结肠镜检查中,深度学习模型辅助检测可发现高达80%的遗漏息肉。Foundation Model在此类算法的探索中展现出潜力,其零样本或少样本学习能力有助于推广到新数据或任务,无需大量微调。这在医学成像领域尤为有利,因为传统训练所需的大型标注数据集稀缺。本文对Foundation Model在息肉分割方面的性能进行了全面评估,包括检测和分割。研究使用了三个不同的结肠镜数据集,比较了DINOv2、YOLO-World、GroundingDINO、SAM和MedSAM五个不同的Foundation Model与YOLOv8和Mask R-CNN两个基准网络的性能。结果表明,Foundation Model在息肉表征方面的成功高度依赖于领域专业化。对于医学应用的最佳性能,领域特定模型至关重要,通用模型需要微调才能获得有效结果。通过这种专业化,Foundation Model表现出优于最先进的检测和分割模型的性能,一些模型甚至在零样本评估中表现出色,优于在未见数据上进行微调的模型。

🔬 方法详解

问题定义:论文旨在解决结肠镜检查中息肉检测率不足的问题。现有方法依赖于大量标注数据进行训练,但在医学图像领域,高质量的标注数据获取成本高昂且耗时。因此,如何利用有限的标注数据或无需标注数据,实现高效准确的息肉检测与分割是关键挑战。

核心思路:论文的核心思路是利用Foundation Model强大的泛化能力,通过零样本或少样本学习,减少对大量标注数据的依赖。通过对比不同类型的Foundation Model在息肉检测与分割任务上的表现,探索领域专业化和微调对模型性能的影响。

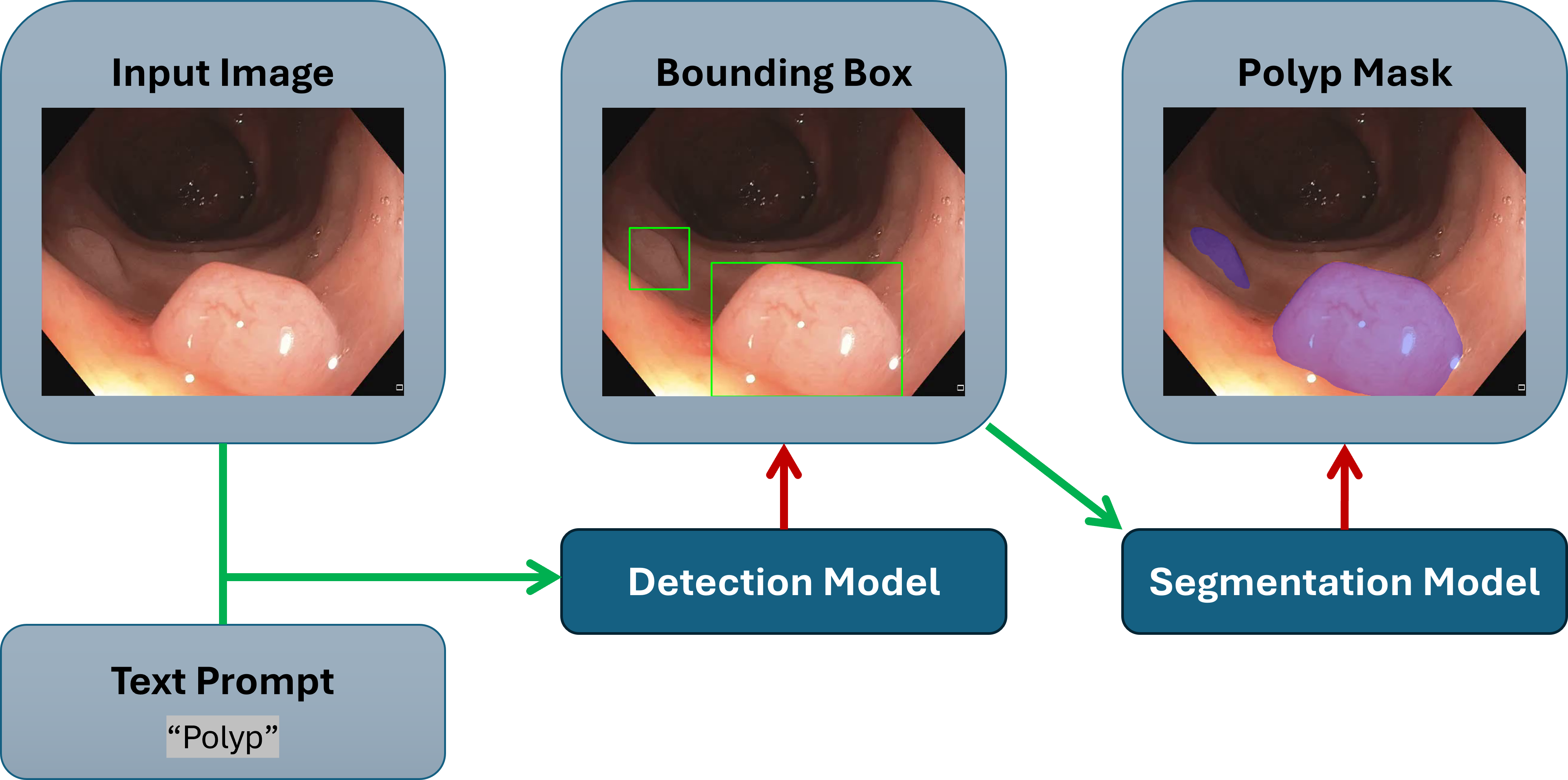

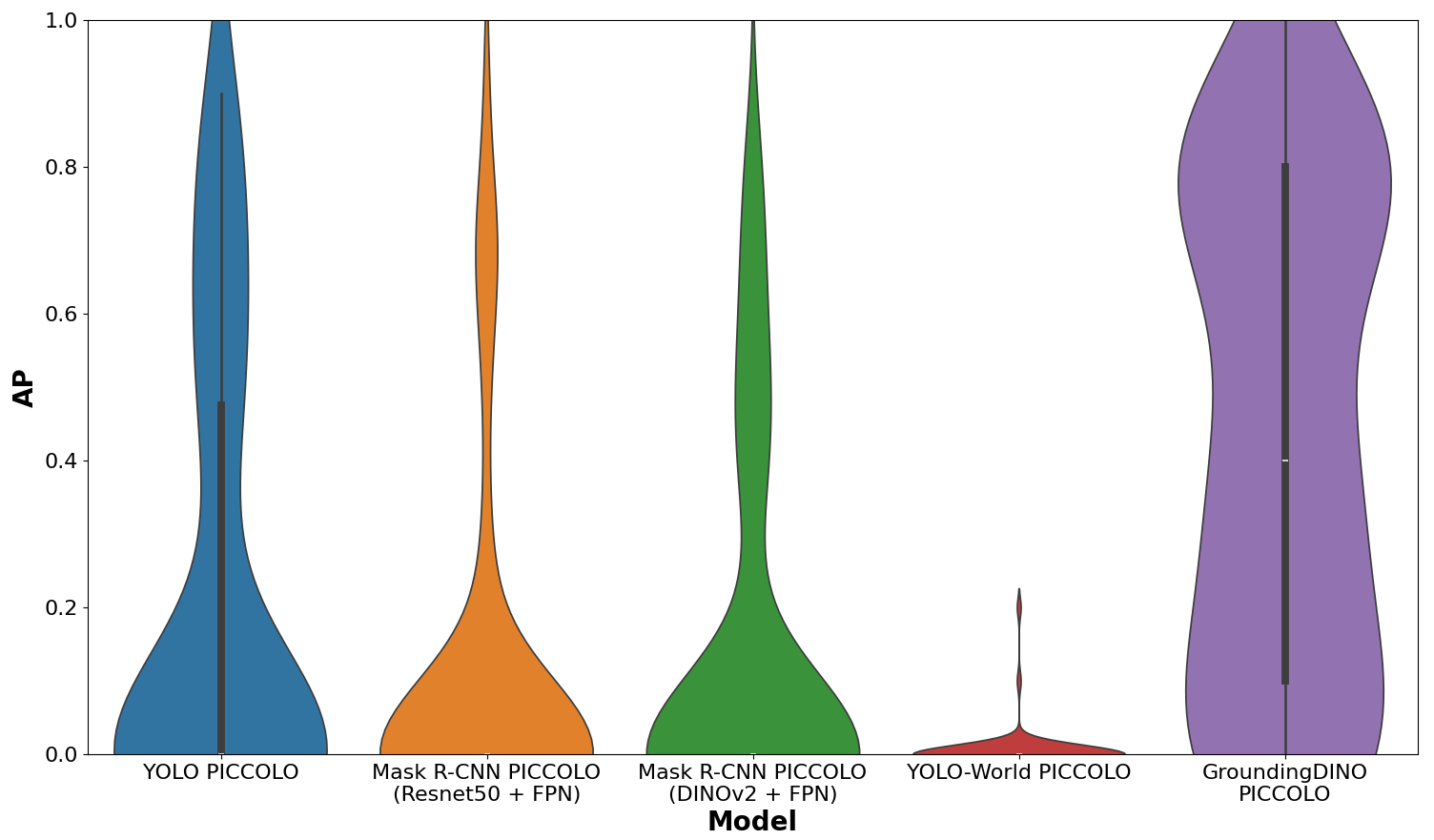

技术框架:论文采用对比实验的方式,评估了五种Foundation Model(DINOv2、YOLO-World、GroundingDINO、SAM和MedSAM)在三个结肠镜数据集上的性能。同时,选取YOLOv8和Mask R-CNN作为基准模型进行对比。实验流程包括:数据预处理、模型训练(或零样本推理)、性能评估。评估指标包括检测精度和分割精度。

关键创新:论文的关键创新在于对Foundation Model在息肉检测与分割任务上的全面评估。通过对比不同模型的性能,揭示了领域专业化对Foundation Model在医学图像应用中的重要性。此外,论文还验证了Foundation Model在零样本学习方面的潜力,为减少医学图像标注成本提供了新的思路。

关键设计:论文的关键设计包括:1) 选择具有代表性的Foundation Model,涵盖了不同类型的模型结构和训练方式;2) 使用多个结肠镜数据集进行评估,以验证模型的泛化能力;3) 采用标准的评估指标,如Dice系数、IoU等,以客观评价模型的性能;4) 对比零样本学习和微调学习的效果,以分析领域专业化对模型性能的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,领域特定的Foundation Model(如MedSAM)在息肉检测和分割任务中表现出色,优于通用Foundation Model和传统模型。在某些情况下,MedSAM甚至在零样本评估中超越了经过微调的YOLOv8和Mask R-CNN模型,证明了Foundation Model在医学图像分析中的巨大潜力。

🎯 应用场景

该研究成果可应用于AI辅助结肠镜检查系统,帮助医生更准确、更高效地检测和分割息肉,降低漏诊率,提高结肠癌的早期诊断率。此外,该研究也为Foundation Model在其他医学图像分析任务中的应用提供了参考,有助于推动AI技术在医疗领域的普及。

📄 摘要(原文)

In colonoscopy, 80% of the missed polyps could be detected with the help of Deep Learning models. In the search for algorithms capable of addressing this challenge, foundation models emerge as promising candidates. Their zero-shot or few-shot learning capabilities, facilitate generalization to new data or tasks without extensive fine-tuning. A concept that is particularly advantageous in the medical imaging domain, where large annotated datasets for traditional training are scarce. In this context, a comprehensive evaluation of foundation models for polyp segmentation was conducted, assessing both detection and delimitation. For the study, three different colonoscopy datasets have been employed to compare the performance of five different foundation models, DINOv2, YOLO-World, GroundingDINO, SAM and MedSAM, against two benchmark networks, YOLOv8 and Mask R-CNN. Results show that the success of foundation models in polyp characterization is highly dependent on domain specialization. For optimal performance in medical applications, domain-specific models are essential, and generic models require fine-tuning to achieve effective results. Through this specialization, foundation models demonstrated superior performance compared to state-of-the-art detection and segmentation models, with some models even excelling in zero-shot evaluation; outperforming fine-tuned models on unseen data.