Blurry-Edges: Photon-Limited Depth Estimation from Defocused Boundaries

作者: Wei Xu, Charles James Wagner, Junjie Luo, Qi Guo

分类: cs.CV

发布日期: 2025-03-30 (更新: 2025-12-08)

备注: Accepted to CVPR 2025. Project page: https://blurry-edges.qiguo.org/

💡 一句话要点

提出基于模糊边缘表示的深度学习方法,解决光子受限图像的深度估计问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 离焦深度估计 光子受限成像 深度学习 图像表示 模糊边缘

📋 核心要点

- 现有基于离焦深度(DfD)的方法对噪声敏感,难以在光子受限图像中准确估计深度。

- 论文提出一种新的图像块表示“模糊边缘”,并设计深度网络预测该表示,从而实现稳健的深度估计。

- 实验结果表明,该方法在光子受限图像上优于现有DfD方法,实现了更高的深度估计精度。

📝 摘要(中文)

本文提出了一种新的方法,用于从光子受限的离焦图像中稳健地测量物体深度,尤其是在离焦边界处。该方法基于一种新的图像块表示,称为“模糊边缘”(Blurry-Edges),它显式地存储和可视化了丰富的低层图像块信息,包括边界、颜色和平滑度。我们设计了一个深度神经网络架构,用于从一对不同离焦图像中预测模糊边缘表示,然后利用推导出的闭式DfD关系计算深度。在合成和真实数据上的实验结果表明,与各种最先进的DfD方法相比,我们的方法在光子受限图像上实现了最高的深度估计精度。

🔬 方法详解

问题定义:论文旨在解决在光子受限条件下,从离焦图像中准确估计物体深度的问题。传统的DfD方法依赖于精确的离焦模糊估计,但在光子受限的低信噪比图像中,模糊估计变得非常困难,导致深度估计精度下降。

核心思路:论文的核心思路是利用一种新的图像块表示“模糊边缘”(Blurry-Edges)来显式地编码图像的低层信息,包括边界、颜色和平滑度。通过学习从不同离焦图像到模糊边缘表示的映射,可以更稳健地提取深度信息,降低噪声的影响。

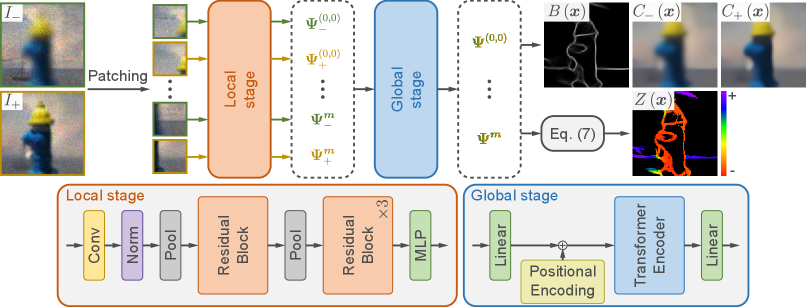

技术框架:整体框架包含两个主要阶段:首先,使用一个深度神经网络从一对不同离焦的输入图像中预测对应的模糊边缘表示。然后,利用论文推导出的闭式DfD关系,从预测的模糊边缘表示中计算深度图。

关键创新:最重要的创新点在于“模糊边缘”表示的提出。它不同于传统的图像块表示,能够更有效地捕捉离焦模糊带来的边缘信息变化,从而提高深度估计的鲁棒性。此外,论文还推导了一个闭式DfD关系,可以直接从模糊边缘表示中计算深度,避免了复杂的优化过程。

关键设计:网络结构未知,但可以推测使用了卷积神经网络(CNN)来学习从输入图像到模糊边缘表示的映射。损失函数的设计可能包括重建损失,用于保证预测的模糊边缘表示与真实值之间的相似性,以及深度损失,用于约束预测深度图的准确性。模糊边缘表示的具体参数设置未知,但应该包含边界强度、颜色信息和平滑度等特征。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成和真实光子受限图像上均取得了显著的性能提升。与一系列最先进的DfD方法相比,该方法实现了最高的深度估计精度。具体的性能数据和提升幅度在论文中给出,但摘要中未明确提及。

🎯 应用场景

该研究成果可应用于低光照成像、显微成像、水下成像等领域,这些场景通常面临光子数量有限的问题。该方法能够提高在这些场景下深度估计的准确性和鲁棒性,从而为三维重建、目标识别和场景理解等任务提供更好的支持。未来,该方法有望应用于自动驾驶、机器人导航等领域。

📄 摘要(原文)

Extracting depth information from photon-limited, defocused images is challenging because depth from defocus (DfD) relies on accurate estimation of defocus blur, which is fundamentally sensitive to image noise. We present a novel approach to robustly measure object depths from photon-limited images along the defocused boundaries. It is based on a new image patch representation, Blurry-Edges, that explicitly stores and visualizes a rich set of low-level patch information, including boundaries, color, and smoothness. We develop a deep neural network architecture that predicts the Blurry-Edges representation from a pair of differently defocused images, from which depth can be calculated using a closed-form DfD relation we derive. The experimental results on synthetic and real data show that our method achieves the highest depth estimation accuracy on photon-limited images compared to a broad range of state-of-the-art DfD methods.