OpenDriveVLA: Towards End-to-end Autonomous Driving with Large Vision Language Action Model

作者: Xingcheng Zhou, Xuyuan Han, Feng Yang, Yunpu Ma, Volker Tresp, Alois Knoll

分类: cs.CV

发布日期: 2025-03-30 (更新: 2025-11-21)

💡 一句话要点

OpenDriveVLA:基于大型视觉语言动作模型的端到端自动驾驶

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 端到端自动驾驶 视觉语言模型 多模态融合 轨迹规划 nuScenes数据集

📋 核心要点

- 现有端到端自动驾驶方法难以有效融合多模态信息,尤其是在视觉表征和语言命令的对齐上存在挑战。

- OpenDriveVLA通过分层视觉语言对齐,将2D/3D视觉信息投影到统一语义空间,并结合智能体交互建模,实现精准轨迹规划。

- 在nuScenes数据集上,OpenDriveVLA在轨迹规划和驾驶问答任务中均达到SOTA,验证了其在复杂场景下的驾驶能力。

📝 摘要(中文)

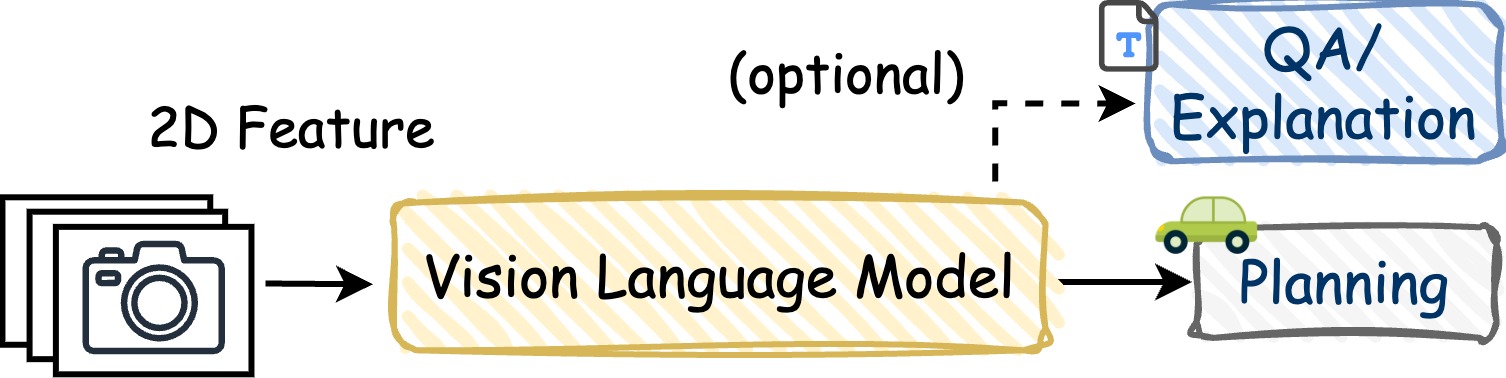

本文提出了OpenDriveVLA,一个基于开源大型语言模型的视觉语言动作模型,专为端到端自动驾驶设计。OpenDriveVLA通过利用多模态输入(包括2D和3D实例感知的视觉表示、自车状态和语言命令)来生成空间定位的驾驶动作。为了弥合驾驶视觉表示和语言嵌入之间的模态差距,我们引入了分层视觉语言对齐过程,将2D和3D结构化视觉tokens投影到统一的语义空间中。此外,我们将结构化的智能体-环境-自车交互建模融入到自回归解码过程中,使模型能够捕获精细的空间依赖性和行为感知的动态,这对于可靠的轨迹规划至关重要。在nuScenes数据集上的大量实验表明,OpenDriveVLA在开放循环轨迹规划和驾驶相关问答任务中取得了最先进的结果。定性分析进一步说明了其遵循高级驾驶命令并在具有挑战性的场景下生成轨迹的能力,突出了其在下一代端到端自动驾驶中的潜力。

🔬 方法详解

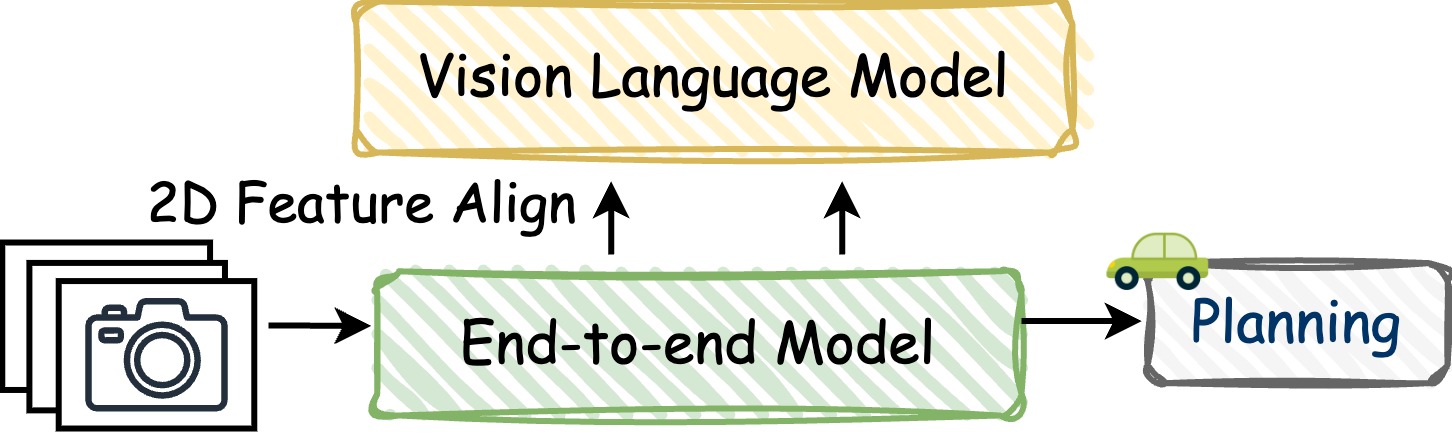

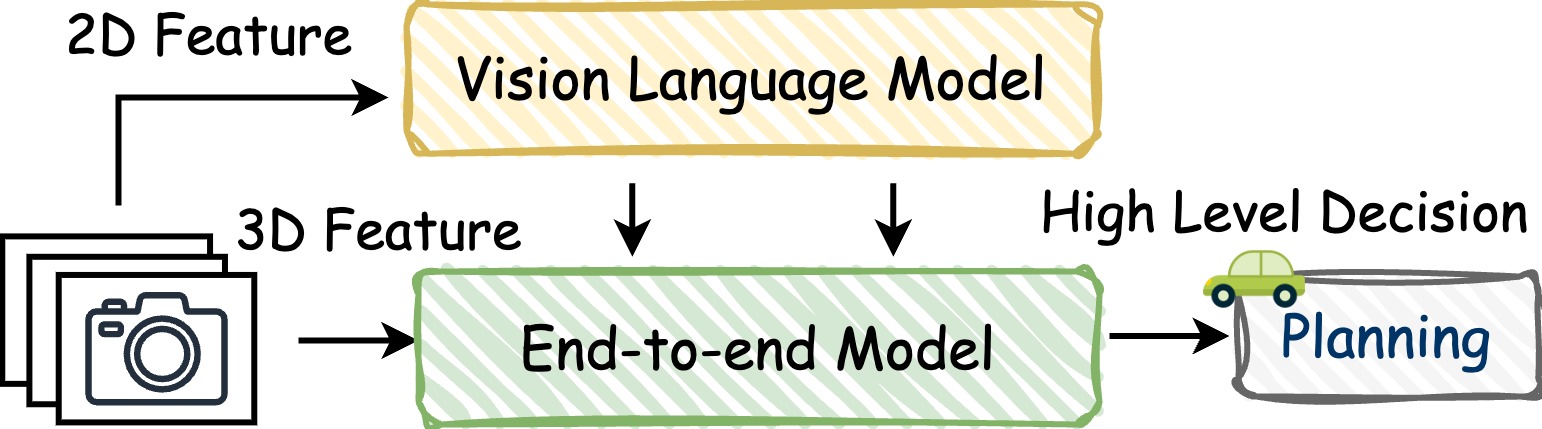

问题定义:端到端自动驾驶面临的挑战在于如何有效地融合来自不同模态的信息,特别是如何将视觉信息(如2D图像和3D点云)与语言命令相结合,从而生成安全可靠的驾驶轨迹。现有方法在处理多模态数据对齐和捕捉细粒度的空间依赖性方面存在不足,导致轨迹规划的准确性和可靠性受到限制。

核心思路:OpenDriveVLA的核心思路是构建一个能够理解视觉和语言信息,并能够基于这些信息生成驾驶动作的视觉语言动作模型。通过分层视觉语言对齐,将不同模态的信息映射到统一的语义空间,从而实现信息的有效融合。同时,通过引入智能体-环境-自车交互建模,捕捉细粒度的空间依赖性和行为感知的动态,提高轨迹规划的准确性和可靠性。

技术框架:OpenDriveVLA的整体架构包括以下几个主要模块:1) 多模态输入模块,用于接收2D图像、3D点云、自车状态和语言命令等输入;2) 视觉语言对齐模块,用于将视觉信息和语言信息映射到统一的语义空间;3) 智能体交互建模模块,用于捕捉细粒度的空间依赖性和行为感知的动态;4) 自回归解码模块,用于生成驾驶动作序列。

关键创新:OpenDriveVLA的关键创新在于以下几个方面:1) 提出了分层视觉语言对齐方法,能够有效地融合不同模态的信息;2) 引入了智能体-环境-自车交互建模,能够捕捉细粒度的空间依赖性和行为感知的动态;3) 构建了一个端到端的视觉语言动作模型,能够直接从多模态输入生成驾驶动作。

关键设计:在视觉语言对齐模块中,采用了Transformer结构,通过自注意力机制实现信息的融合。在智能体交互建模模块中,使用了图神经网络,对智能体之间的关系进行建模。在自回归解码模块中,使用了LSTM网络,生成驾驶动作序列。损失函数包括轨迹预测损失和问答损失,用于优化模型的性能。

🖼️ 关键图片

📊 实验亮点

OpenDriveVLA在nuScenes数据集上取得了显著的成果。在开放循环轨迹规划任务中,OpenDriveVLA的性能优于现有的SOTA方法。在驾驶相关问答任务中,OpenDriveVLA的准确率也达到了SOTA水平。定性分析表明,OpenDriveVLA能够有效地遵循高级驾驶命令,并在具有挑战性的场景下生成合理的驾驶轨迹。

🎯 应用场景

OpenDriveVLA具有广泛的应用前景,可应用于自动驾驶汽车、无人配送车、智能交通系统等领域。该研究成果有助于提高自动驾驶系统的智能化水平和安全性,促进自动驾驶技术的商业化应用。未来,该模型可以进一步扩展到更复杂的驾驶场景,例如城市道路、高速公路等,并可以与其他技术相结合,例如强化学习、模仿学习等,进一步提高自动驾驶系统的性能。

📄 摘要(原文)

We present OpenDriveVLA, a Vision Language Action model designed for end-to-end autonomous driving, built upon open-source large language models. OpenDriveVLA generates spatially grounded driving actions by leveraging multimodal inputs, including 2D and 3D instance-aware visual representations, ego vehicle states, and language commands. To bridge the modality gap between driving visual representations and language embeddings, we introduce a hierarchical vision language alignment process, projecting both 2D and 3D structured visual tokens into a unified semantic space. Furthermore, we incorporate structured agent environment ego interaction modeling into the autoregressive decoding process, enabling the model to capture fine-grained spatial dependencies and behavior-aware dynamics critical for reliable trajectory planning. Extensive experiments on the nuScenes dataset demonstrate that OpenDriveVLA achieves state-of-the-art results across open-loop trajectory planning and driving-related question answering tasks. Qualitative analyses further illustrate its capability to follow high-level driving commands and generate trajectories under challenging scenarios, highlighting its potential for next-generation end-to-end autonomous driving.