Can DeepSeek Reason Like a Surgeon? An Empirical Evaluation for Vision-Language Understanding in Robotic-Assisted Surgery

作者: Boyi Ma, Yanguang Zhao, Jie Wang, Guankun Wang, Kun Yuan, Tong Chen, Long Bai, Hongliang Ren

分类: cs.CV, cs.CL, cs.RO

发布日期: 2025-03-29 (更新: 2025-04-04)

备注: Technical Report

💡 一句话要点

评估DeepSeek模型在机器人辅助手术视觉语言理解中的推理能力

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人手术 视觉语言理解 DeepSeek模型 多模态学习 手术场景理解

📋 核心要点

- 现有通用多模态大模型在机器人手术场景理解方面存在不足,无法满足临床需求。

- 研究探索DeepSeek模型在机器人手术场景中的对话能力,评估其在视觉语言理解任务中的性能。

- 实验表明DeepSeek-VL2在复杂手术场景理解上优于现有模型,但仍需手术专用数据集微调。

📝 摘要(中文)

DeepSeek模型在通用场景理解、问答和文本生成任务中表现出色,这归功于其高效的训练范式和强大的推理能力。本研究探讨了DeepSeek模型在机器人手术场景中的对话能力,重点关注单短语问答、视觉问答和详细描述等任务。单短语问答任务进一步包括手术器械识别、动作理解和空间位置分析等子任务。我们使用公开数据集EndoVis18和CholecT50及其对应的对话数据进行了广泛评估。实验结果表明,与现有的通用多模态大型语言模型相比,DeepSeek-VL2在手术场景中的复杂理解任务上表现更好。此外,尽管DeepSeek-V3纯粹是一个语言模型,但当直接输入图像tokens时,该模型在单句问答任务中表现出更好的性能。然而,总体而言,DeepSeek模型仍然无法满足临床对手术场景理解的要求。在通用提示下,DeepSeek模型缺乏有效分析全局手术概念的能力,并且无法提供对手术场景的详细见解。基于我们的观察,我们认为,如果没有在手术专用数据集上进行微调,DeepSeek模型尚未准备好用于手术环境中的视觉语言任务。

🔬 方法详解

问题定义:论文旨在评估DeepSeek系列模型在机器人辅助手术场景下的视觉语言理解能力。现有通用多模态大模型虽然在通用场景表现良好,但在理解复杂的手术场景,例如识别手术器械、理解手术动作和空间关系等方面存在不足,无法满足临床需求。这些模型缺乏对手术全局概念的有效分析和对手术场景的详细洞察力。

核心思路:论文的核心思路是通过在机器人手术相关的视觉语言任务上评估DeepSeek模型的性能,来判断其是否具备在手术场景中进行有效推理的能力。通过对比DeepSeek模型与其他通用多模态模型的表现,以及分析其在不同任务上的优缺点,从而确定DeepSeek模型是否可以直接应用于手术场景,或者需要进一步的微调。

技术框架:研究采用了一种实证评估的方法,主要流程包括:1) 选择DeepSeek系列模型(DeepSeek-VL2和DeepSeek-V3);2) 选择公开的机器人手术数据集(EndoVis18和CholecT50)及其对应的对话数据;3) 设计不同的视觉语言任务,包括单短语问答(包含手术器械识别、动作理解和空间位置分析等子任务)、视觉问答和详细描述;4) 使用通用提示对模型进行评估,并分析其在不同任务上的表现。

关键创新:论文的关键创新在于首次将DeepSeek系列模型应用于机器人手术场景的视觉语言理解任务,并对其性能进行了全面的评估。研究发现,DeepSeek-VL2在复杂手术场景理解任务上优于其他通用多模态模型,并且即使是纯语言模型DeepSeek-V3,在直接输入图像tokens时也能在单句问答任务中表现出一定的性能。

关键设计:研究的关键设计在于任务的设计和评估指标的选择。任务设计涵盖了手术场景中常见的视觉语言理解需求,例如器械识别、动作理解和空间关系分析。评估指标则侧重于考察模型在这些任务上的准确性和详细程度。此外,研究还采用了通用提示,以评估模型在没有特定微调的情况下,是否具备对手术场景的理解能力。

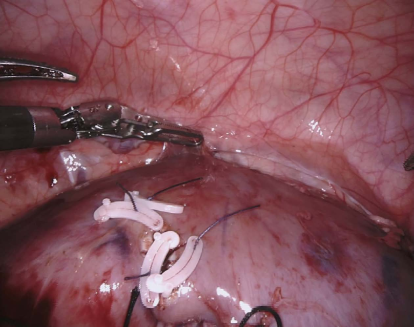

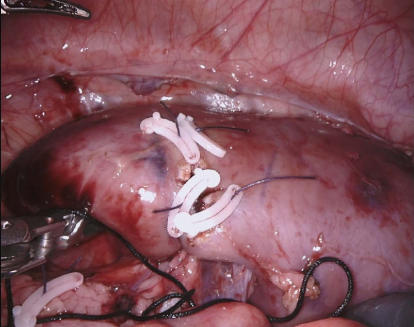

🖼️ 关键图片

📊 实验亮点

实验结果表明,DeepSeek-VL2在复杂手术场景理解任务上优于现有的通用多模态大型语言模型。尽管DeepSeek-V3是纯语言模型,但直接输入图像tokens后,在单句问答任务中表现出更好的性能。然而,DeepSeek模型在通用提示下,缺乏有效分析全局手术概念的能力,需要手术专用数据集进行微调。

🎯 应用场景

该研究成果可应用于开发智能手术辅助系统,帮助医生进行手术规划、术中导航和术后评估。通过提升AI模型对手术场景的理解能力,可以减少手术失误,提高手术效率,并为患者提供更安全、更精准的医疗服务。未来的研究方向包括对手术专用数据集进行微调,以进一步提升模型在手术场景中的性能。

📄 摘要(原文)

The DeepSeek models have shown exceptional performance in general scene understanding, question-answering (QA), and text generation tasks, owing to their efficient training paradigm and strong reasoning capabilities. In this study, we investigate the dialogue capabilities of the DeepSeek model in robotic surgery scenarios, focusing on tasks such as Single Phrase QA, Visual QA, and Detailed Description. The Single Phrase QA tasks further include sub-tasks such as surgical instrument recognition, action understanding, and spatial position analysis. We conduct extensive evaluations using publicly available datasets, including EndoVis18 and CholecT50, along with their corresponding dialogue data. Our empirical study shows that, compared to existing general-purpose multimodal large language models, DeepSeek-VL2 performs better on complex understanding tasks in surgical scenes. Additionally, although DeepSeek-V3 is purely a language model, we find that when image tokens are directly inputted, the model demonstrates better performance on single-sentence QA tasks. However, overall, the DeepSeek models still fall short of meeting the clinical requirements for understanding surgical scenes. Under general prompts, DeepSeek models lack the ability to effectively analyze global surgical concepts and fail to provide detailed insights into surgical scenarios. Based on our observations, we argue that the DeepSeek models are not ready for vision-language tasks in surgical contexts without fine-tuning on surgery-specific datasets.