Dataset Distillation of 3D Point Clouds via Distribution Matching

作者: Jae-Young Yim, Dongwook Kim, Jae-Young Sim

分类: cs.CV

发布日期: 2025-03-28 (更新: 2025-12-13)

💡 一句话要点

提出基于分布匹配的3D点云数据集蒸馏方法,提升小规模数据集训练性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 3D点云 数据集蒸馏 分布匹配 语义对齐 旋转不变性 深度学习 模型压缩

📋 核心要点

- 现有3D点云数据集蒸馏方法不足,难以处理点云的无序性和旋转不变性。

- 提出基于分布匹配的框架,联合优化几何结构和方向,解决语义错位和旋转变化问题。

- 实验结果表明,该方法在准确性和跨架构泛化能力方面优于现有方法。

📝 摘要(中文)

大规模数据集通常是训练深度神经网络所必需的,但这增加了计算复杂度,阻碍了实际应用。最近,图像和文本的数据集蒸馏吸引了大量关注,它将原始数据集缩减为合成数据集,以减轻训练的计算负担,同时保留重要的任务相关信息。然而,3D点云的数据集蒸馏在很大程度上仍未被探索,因为点云表现出与图像根本不同的特征,这使得数据集蒸馏更具挑战性。在本文中,我们提出了一种基于分布匹配的3D点云蒸馏框架,该框架联合优化合成3D对象的几何结构和方向。为了解决由点云无序索引引起的语义错位问题,我们引入了在每个通道的排序特征上计算的语义对齐分布匹配损失。此外,为了解决旋转变化问题,我们在更新合成数据集以更好地与原始特征分布对齐的同时,联合学习最佳旋转角度。在广泛使用的基准数据集上的大量实验表明,所提出的方法始终优于现有的数据集蒸馏方法,实现了卓越的准确性和强大的跨架构泛化能力。

🔬 方法详解

问题定义:现有的数据集蒸馏方法在图像和文本领域取得了显著进展,但直接应用于3D点云时面临挑战。点云的无序性和旋转不变性导致语义错位,使得合成数据集难以捕捉原始数据的本质特征。此外,点云数据量大,计算复杂度高,进一步增加了蒸馏的难度。

核心思路:本文的核心思路是通过分布匹配,使合成数据集的特征分布尽可能接近原始数据集的特征分布。具体来说,不仅要匹配几何结构的分布,还要匹配点云的方向分布。通过联合优化几何结构和方向,可以更有效地保留原始数据集中的任务相关信息。

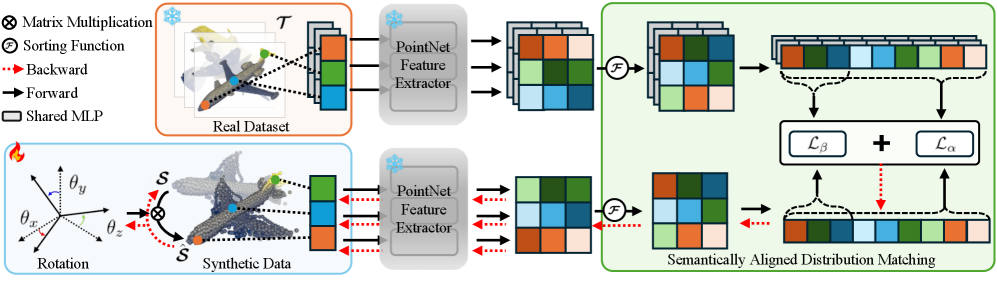

技术框架:该方法包含以下主要步骤:1) 初始化一个小的合成数据集。2) 提取原始数据集和合成数据集的特征。3) 计算语义对齐的分布匹配损失,该损失考虑了点云的无序性。4) 联合学习最佳旋转角度,以解决旋转变化问题。5) 使用优化器更新合成数据集,使其特征分布更接近原始数据集的特征分布。重复步骤2-5,直到收敛。

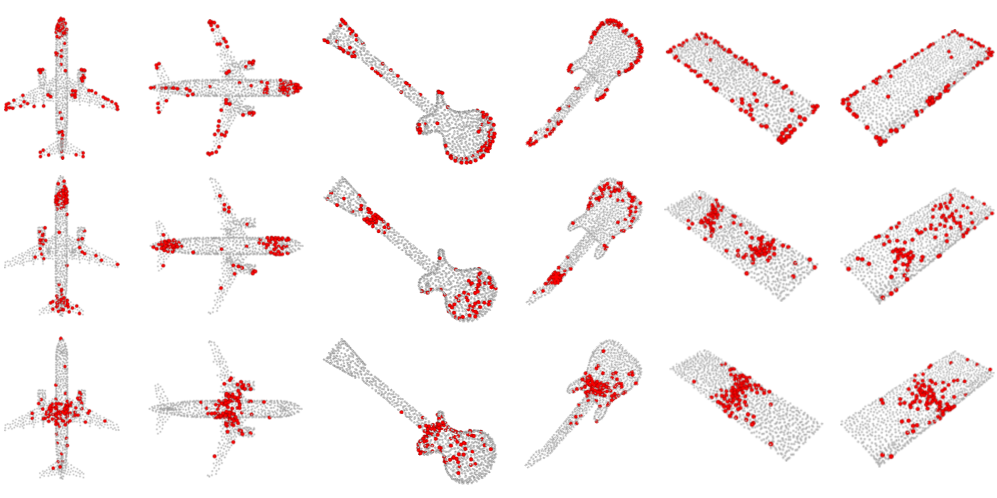

关键创新:该方法的关键创新在于提出了语义对齐的分布匹配损失和联合学习旋转角度的机制。语义对齐的分布匹配损失通过在每个通道的排序特征上计算损失,解决了点云无序性导致的语义错位问题。联合学习旋转角度的机制通过在更新合成数据集的同时优化旋转角度,解决了旋转变化问题。

关键设计:语义对齐分布匹配损失的关键在于对每个通道的特征进行排序,然后计算排序后的特征之间的距离。联合学习旋转角度的关键在于使用可微的旋转矩阵,以便可以通过梯度下降优化旋转角度。此外,该方法还使用了多种正则化技术,以防止过拟合。

🖼️ 关键图片

📊 实验亮点

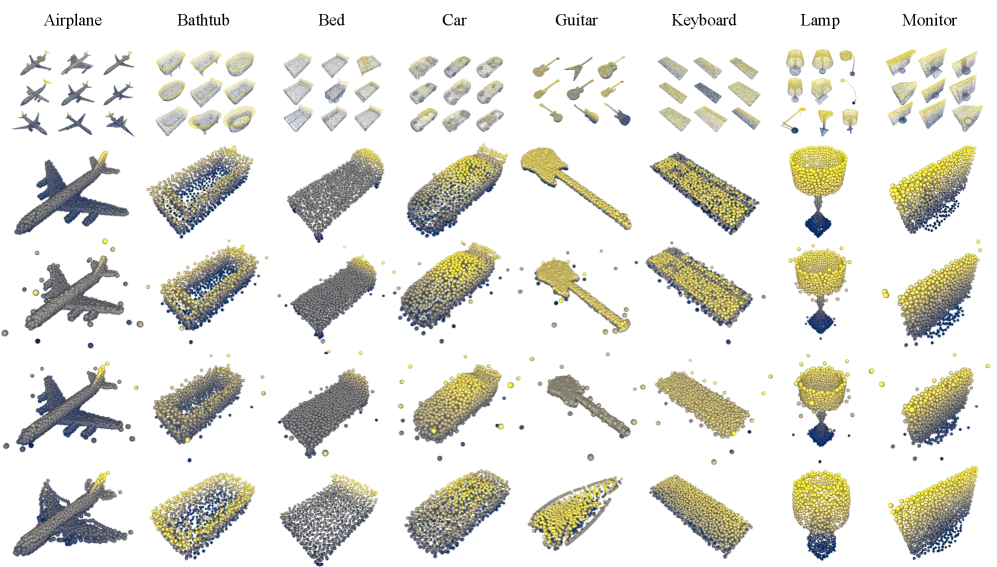

实验结果表明,该方法在ModelNet40和ScanObjectNN等基准数据集上取得了显著的性能提升。例如,在ModelNet40数据集上,使用10%的蒸馏数据训练的模型,其准确率优于使用原始数据集训练的基线模型。此外,该方法还表现出强大的跨架构泛化能力,即使用在不同网络结构上训练的模型,其性能仍然优于其他数据集蒸馏方法。

🎯 应用场景

该研究成果可应用于资源受限场景下的3D物体识别、场景理解等任务。例如,在移动机器人或嵌入式设备上,可以使用蒸馏后的轻量级数据集进行快速准确的3D感知。此外,该方法还可以用于数据隐私保护,通过合成数据集进行模型训练,避免直接使用原始敏感数据。未来,该技术有望推动3D视觉在更多实际场景中的应用。

📄 摘要(原文)

Large-scale datasets are usually required to train deep neural networks, but it increases the computational complexity hindering the practical applications. Recently, dataset distillation for images and texts has been attracting a lot of attention, that reduces the original dataset to a synthetic dataset to alleviate the computational burden of training while preserving essential task-relevant information. However, the dataset distillation for 3D point clouds remains largely unexplored, as the point clouds exhibit fundamentally different characteristics from that of images, making the dataset distillation more challenging. In this paper, we propose a distribution matching-based distillation framework for 3D point clouds that jointly optimizes the geometric structures as well as the orientations of the synthetic 3D objects. To address the semantic misalignment caused by unordered indexing of points, we introduce a Semantically Aligned Distribution Matching loss computed on the sorted features in each channel. Moreover, to address the rotation variation, we jointly learn the optimal rotation angles while updating the synthetic dataset to better align with the original feature distribution. Extensive experiments on widely used benchmark datasets demonstrate that the proposed method consistently outperforms existing dataset distillation methods, achieving superior accuracy and strong cross-architecture generalization.