Deep Depth Estimation from Thermal Image: Dataset, Benchmark, and Challenges

作者: Ukcheol Shin, Jinsun Park

分类: cs.CV, cs.RO

发布日期: 2025-03-28

备注: MS^2 dataset: https://sites.google.com/view/multi-spectral-stereo-dataset, Source code: https://github.com/UkcheolShin/SupDepth4Thermal

🔗 代码/项目: GITHUB

💡 一句话要点

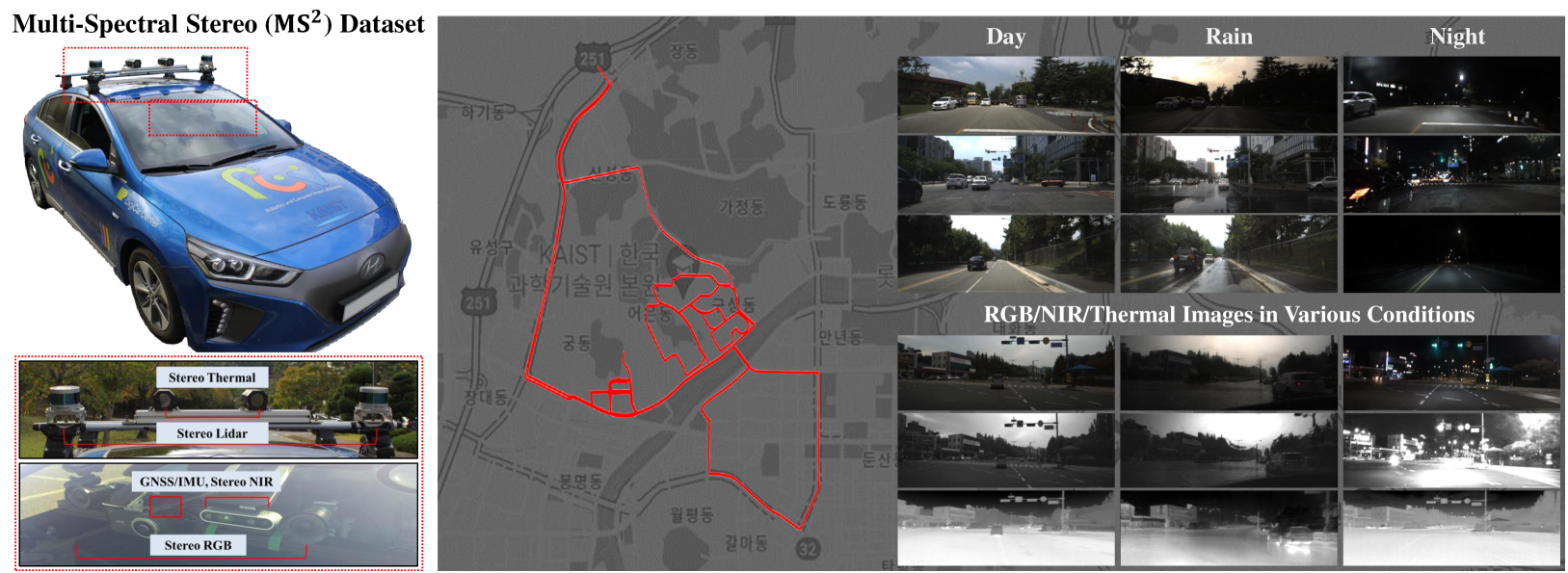

提出大规模多光谱立体数据集MS$^2$,并建立热成像深度估计基准。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 热成像 深度估计 多光谱数据 数据集 自动驾驶 机器人 基准测试 恶劣天气

📋 核心要点

- 现有视觉感知算法在恶劣天气和光照条件下表现不佳,限制了自动驾驶和机器人的应用。

- 论文提出MS$^2$数据集,包含多光谱数据和深度真值,旨在促进热成像深度估计的研究。

- 论文评估了多种深度估计网络在MS$^2$数据集上的性能,并分析了不同模态的优缺点。

📝 摘要(中文)

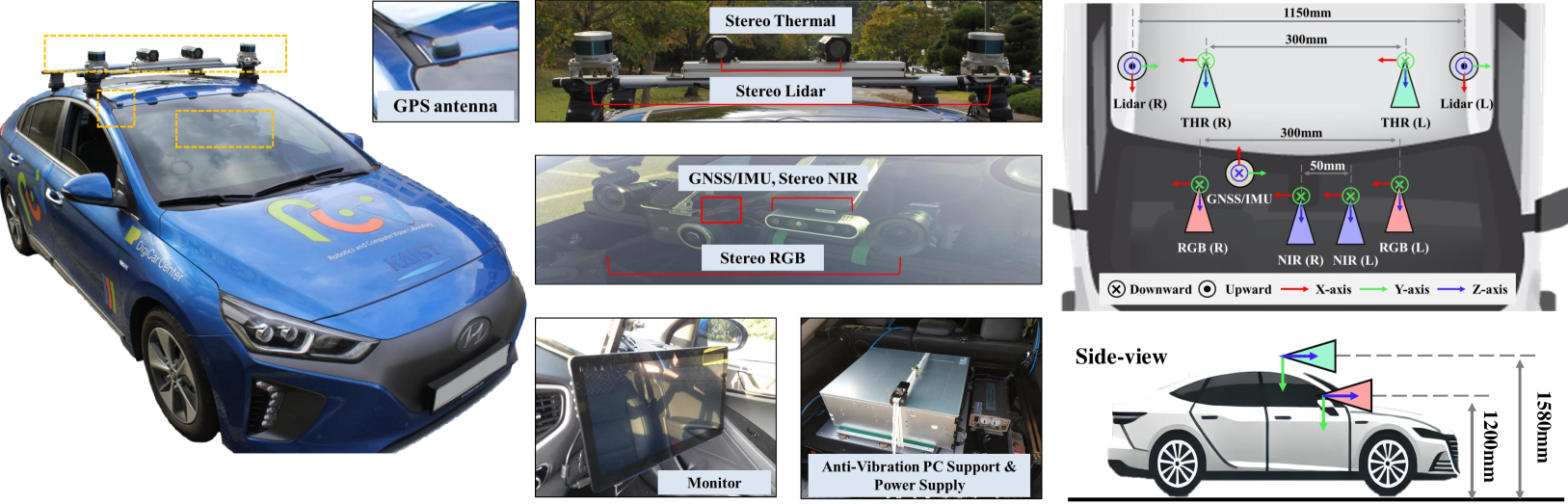

在恶劣天气和光照条件下实现鲁棒且精确的空间感知对于自动驾驶车辆和机器人至关重要。然而,现有的依赖可见光谱的感知算法极易受到天气和光照条件的影响。长波红外相机(即热成像相机)可能是实现高水平鲁棒性的潜在解决方案。然而,缺乏大规模数据集和标准化基准仍然是热成像鲁棒视觉感知研究进展的重大瓶颈。为此,本文提供了一个大规模多光谱立体(MS$^2$)数据集,该数据集包含立体RGB、立体NIR、立体热成像、立体LiDAR数据以及GNSS/IMU信息以及半稠密深度真值。MS$^2$数据集包括在不同地点(例如,城市、住宅区、校园和高速公路)在不同时间(例如,早晨、白天和夜间)以及各种天气条件(例如,晴天、多云和下雨)下捕获的162K同步多模态数据对。其次,我们对RGB、NIR和热成像模态的单目和立体深度估计网络进行了全面评估,以在MS$^2$深度测试集(例如,白天、夜晚和下雨)上建立标准化基准结果。最后,我们提供了深入的分析,并讨论了基准结果揭示的挑战,例如恶劣条件下每种模态的性能可变性、不同传感器模态之间的域偏移以及热感知的潜在研究方向。我们的数据集和源代码可在https://sites.google.com/view/multi-spectral-stereo-dataset和https://github.com/UkcheolShin/SupDepth4Thermal公开获取。

🔬 方法详解

问题定义:论文旨在解决在恶劣天气和光照条件下,传统视觉感知系统性能下降的问题。现有方法依赖可见光,易受环境影响,而热成像技术具有一定的鲁棒性,但缺乏大规模数据集和统一的评估基准,阻碍了相关研究的进展。

核心思路:论文的核心思路是构建一个大规模、多模态的数据集MS$^2$,包含RGB、NIR、热成像和LiDAR数据,并提供深度真值。通过该数据集,可以训练和评估基于热成像的深度估计模型,并建立统一的基准,促进该领域的研究。

技术框架:论文主要包含数据集构建和基准测试两部分。数据集构建方面,采集了包含多种场景、时间和天气条件下的多模态数据,并使用LiDAR数据生成半稠密深度真值。基准测试方面,选择了多种单目和立体深度估计网络,在MS$^2$数据集上进行训练和测试,并分析了不同模态和场景下的性能表现。

关键创新:论文的关键创新在于构建了大规模多光谱立体数据集MS$^2$,该数据集是目前最大的公开热成像深度估计数据集之一。此外,论文还建立了基于MS$^2$数据集的深度估计基准,为后续研究提供了参考。

关键设计:数据集采集过程中,保证了多模态数据的同步性,并使用了高精度的LiDAR传感器生成深度真值。在基准测试中,选择了多种具有代表性的深度估计网络,并针对不同模态的数据特点进行了参数调整。论文还设计了多种评估指标,全面评估了模型的性能。

🖼️ 关键图片

📊 实验亮点

论文在MS$^2$数据集上对多种深度估计网络进行了评估,结果表明,热成像在夜间和雨天等恶劣条件下表现出较好的鲁棒性。然而,不同模态之间存在域偏移,需要进一步研究多模态融合方法。该基准测试为后续研究提供了参考。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、安防监控等领域。在恶劣天气或光照条件下,基于热成像的深度估计技术可以提供可靠的环境感知信息,提高系统的鲁棒性和安全性。未来,该技术有望在更多领域得到应用,例如灾害救援、工业检测等。

📄 摘要(原文)

Achieving robust and accurate spatial perception under adverse weather and lighting conditions is crucial for the high-level autonomy of self-driving vehicles and robots. However, existing perception algorithms relying on the visible spectrum are highly affected by weather and lighting conditions. A long-wave infrared camera (i.e., thermal imaging camera) can be a potential solution to achieve high-level robustness. However, the absence of large-scale datasets and standardized benchmarks remains a significant bottleneck to progress in active research for robust visual perception from thermal images. To this end, this manuscript provides a large-scale Multi-Spectral Stereo (MS$^2$) dataset that consists of stereo RGB, stereo NIR, stereo thermal, stereo LiDAR data, and GNSS/IMU information along with semi-dense depth ground truth. MS$^2$ dataset includes 162K synchronized multi-modal data pairs captured across diverse locations (e.g., urban city, residential area, campus, and high-way road) at different times (e.g., morning, daytime, and nighttime) and under various weather conditions (e.g., clear-sky, cloudy, and rainy). Secondly, we conduct a thorough evaluation of monocular and stereo depth estimation networks across RGB, NIR, and thermal modalities to establish standardized benchmark results on MS$^2$ depth test sets (e.g., day, night, and rainy). Lastly, we provide in-depth analyses and discuss the challenges revealed by the benchmark results, such as the performance variability for each modality under adverse conditions, domain shift between different sensor modalities, and potential research direction for thermal perception. Our dataset and source code are publicly available at https://sites.google.com/view/multi-spectral-stereo-dataset and https://github.com/UkcheolShin/SupDepth4Thermal.