Reconstructing Humans with a Biomechanically Accurate Skeleton

作者: Yan Xia, Xiaowei Zhou, Etienne Vouga, Qixing Huang, Georgios Pavlakos

分类: cs.CV

发布日期: 2025-03-27

备注: CVPR 2025. Project Webpage: https://isshikihugh.github.io/HSMR/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

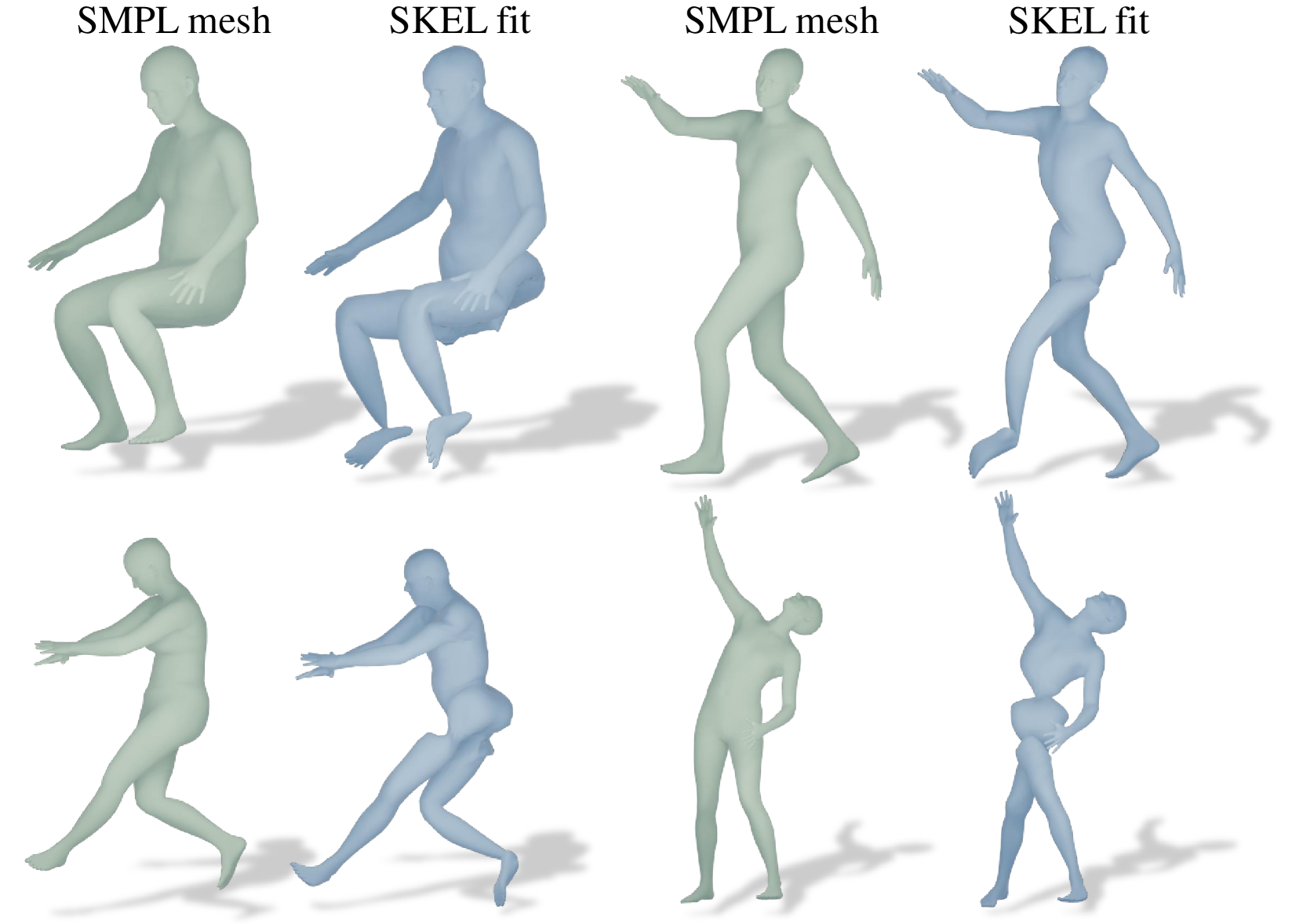

提出基于生物力学骨骼模型的单图人体三维重建方法,提升极端姿态下的重建效果。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 三维人体重建 生物力学模型 Transformer网络 伪标签学习 姿态估计

📋 核心要点

- 现有3D人体重建方法在极端姿态和视角下表现不佳,且常违反关节角度限制,产生不自然的旋转。

- 本文提出一种基于生物力学精确骨骼模型的人体重建方法,利用Transformer网络估计模型参数,并迭代优化伪标签。

- 实验表明,该方法在标准benchmark上具有竞争力,在极端姿态下显著优于现有方法,并能生成更自然的关节旋转。

📝 摘要(中文)

本文提出了一种基于生物力学精确骨骼模型,从单张图像中重建3D人体的方法。为了实现这一目标,我们训练了一个Transformer网络,该网络以图像作为输入,并估计模型的参数。由于缺乏该任务的训练数据,我们构建了一个pipeline来为单张图像生成伪ground truth模型参数,并实现了一个迭代细化这些伪标签的训练过程。与最先进的3D人体网格恢复方法相比,我们的模型在标准benchmark上取得了具有竞争力的性能,并且在极端3D姿势和视角设置下明显优于它们。此外,我们表明以前的重建方法经常违反关节角度限制,导致不自然的旋转。相比之下,我们的方法利用了生物力学上合理的自由度,从而实现了更真实的关节旋转估计。我们在多个人体姿势估计benchmark上验证了我们的方法。代码、模型和数据可在以下网址获取:https://isshikihugh.github.io/HSMR/

🔬 方法详解

问题定义:论文旨在解决单张图像三维人体重建问题,尤其关注现有方法在极端姿态和视角下重建效果差,以及重建结果不符合生物力学约束,导致关节角度超出合理范围的问题。现有方法难以保证重建结果的自然性和真实性。

核心思路:论文的核心思路是利用一个生物力学精确的骨骼模型作为先验知识,约束重建过程。通过学习图像到模型参数的映射,并结合伪标签迭代优化策略,使得重建结果既能符合图像内容,又能满足生物力学约束,从而提升极端姿态下的重建效果和自然性。

技术框架:整体框架包含以下几个主要部分:1) 数据生成pipeline:用于生成带有生物力学骨骼模型参数的伪标签数据。2) Transformer网络:用于学习图像到骨骼模型参数的映射。3) 迭代训练过程:通过不断优化伪标签和模型参数,提升重建精度。具体流程是:首先利用数据生成pipeline生成伪标签,然后训练Transformer网络,接着利用训练好的网络预测新的模型参数,并用这些参数更新伪标签,最后重复训练过程。

关键创新:最重要的技术创新点在于将生物力学骨骼模型作为先验知识引入到三维人体重建中。与以往方法直接预测三维网格或关节点坐标不同,该方法预测的是生物力学骨骼模型的参数,从而保证了重建结果的生物力学合理性。此外,迭代训练过程也有效地提升了模型在缺乏真实标签数据情况下的性能。

关键设计:在网络结构方面,使用了Transformer网络,利用其强大的特征提取和建模能力。在损失函数方面,可能使用了包括重建误差、关节角度约束等多种损失函数的组合,以保证重建精度和生物力学合理性。伪标签生成pipeline的具体实现细节(例如,如何估计初始模型参数,如何进行优化等)也是关键设计之一。具体的参数设置和网络结构细节需要在论文原文中查找。

🖼️ 关键图片

📊 实验亮点

论文在标准benchmark上取得了具有竞争力的性能,并在极端3D姿势和视角设置下明显优于现有方法。更重要的是,该方法能够生成更符合生物力学约束的关节旋转,避免了不自然的姿态。虽然论文中没有给出具体的性能数据,但强调了在极端姿态下的显著提升,以及生物力学合理性的改进。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、游戏、动画制作、运动分析、医疗康复等领域。通过更准确、更自然的三维人体重建,可以提升用户体验,实现更逼真的人机交互,并为相关领域的分析和应用提供更可靠的数据基础。未来,该技术有望应用于智能监控、自动驾驶等领域,实现对人体行为的理解和分析。

📄 摘要(原文)

In this paper, we introduce a method for reconstructing 3D humans from a single image using a biomechanically accurate skeleton model. To achieve this, we train a transformer that takes an image as input and estimates the parameters of the model. Due to the lack of training data for this task, we build a pipeline to produce pseudo ground truth model parameters for single images and implement a training procedure that iteratively refines these pseudo labels. Compared to state-of-the-art methods for 3D human mesh recovery, our model achieves competitive performance on standard benchmarks, while it significantly outperforms them in settings with extreme 3D poses and viewpoints. Additionally, we show that previous reconstruction methods frequently violate joint angle limits, leading to unnatural rotations. In contrast, our approach leverages the biomechanically plausible degrees of freedom making more realistic joint rotation estimates. We validate our approach across multiple human pose estimation benchmarks. We make the code, models and data available at: https://isshikihugh.github.io/HSMR/