Flip Learning: Weakly Supervised Erase to Segment Nodules in Breast Ultrasound

作者: Yuhao Huang, Ao Chang, Haoran Dou, Xing Tao, Xinrui Zhou, Yan Cao, Ruobing Huang, Alejandro F Frangi, Lingyun Bao, Xin Yang, Dong Ni

分类: cs.CV, cs.AI, cs.LG

发布日期: 2025-03-26 (更新: 2025-11-03)

备注: Accepted by Medical Image Analysis. 24 pages, 13 figures, 20 tabels

💡 一句话要点

提出基于翻转学习的弱监督乳腺超声结节分割方法,仅需2D/3D包围盒标注。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 弱监督学习 乳腺超声 结节分割 强化学习 翻转学习 多智能体 课程学习

📋 核心要点

- 现有弱监督分割方法依赖不准确激活图或低效伪掩码生成,难以实现乳腺超声结节的精确分割。

- 提出翻转学习框架,利用多智能体强化学习从包围盒中擦除目标,实现分类标签翻转,预测分割掩码。

- 在BUS和ABUS数据集上验证,翻转学习优于现有WSS方法和基础模型,性能与全监督学习相当。

📝 摘要(中文)

精确分割2D乳腺超声(BUS)和3D自动乳腺超声(ABUS)中的结节对于临床诊断和治疗计划至关重要。因此,开发自动结节分割系统可以增强用户独立性并加快临床分析。与全监督学习不同,弱监督分割(WSS)可以简化费力而复杂的标注过程。然而,当前的WSS方法在实现精确的结节分割方面面临挑战,因为它们中的许多方法依赖于不准确的激活图或低效的伪掩码生成算法。在本研究中,我们提出了一种新颖的基于多智能体强化学习的WSS框架,称为翻转学习,该框架仅依赖于2D/3D包围盒进行精确分割。具体来说,采用多个智能体从包围盒中擦除目标,以促进分类标签翻转,擦除的区域用作预测的分割掩码。经过大量内部BUS和ABUS数据集的验证,我们的翻转学习方法优于最先进的WSS方法和基础模型,并且实现了与全监督学习算法相当的性能。

🔬 方法详解

问题定义:论文旨在解决乳腺超声图像(BUS和ABUS)中结节的精确分割问题。现有弱监督分割方法依赖于不准确的激活图或低效的伪掩码生成算法,导致分割精度不足,无法满足临床需求。人工标注耗时费力,限制了模型的训练数据规模。

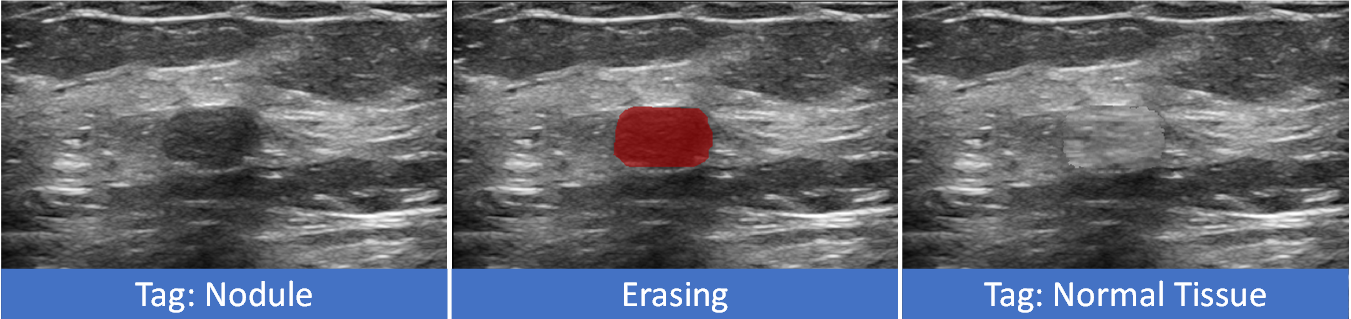

核心思路:论文的核心思路是利用多智能体强化学习,通过“擦除”包围盒内的目标区域来促使分类标签翻转,并将擦除的区域作为预测的分割掩码。这种“擦除”过程模拟了人工分割的过程,通过不断调整擦除策略,最终得到精确的分割结果。

技术框架:翻转学习框架包含以下主要模块:1) 环境编码:使用超像素/超体素对图像进行编码,构建标准化环境,捕捉边界先验信息。2) 多智能体:多个智能体并行工作,负责从包围盒中擦除目标区域。3) 奖励函数:设计分类得分奖励和两个强度分布奖励,引导智能体精确擦除,避免欠分割和过分割。4) 课程学习:采用渐进式课程学习策略,使智能体逐步适应更具挑战性的环境,提高学习效率。

关键创新:该方法的核心创新在于使用多智能体强化学习进行弱监督分割,通过“擦除”操作实现标签翻转,避免了对激活图或伪掩码的依赖。此外,精心设计的奖励函数和课程学习策略进一步提高了分割精度和学习效率。与现有方法相比,该方法更直接地模拟了人工分割过程,具有更强的可解释性和鲁棒性。

关键设计:1) 环境编码:采用超像素/超体素,降低了状态空间维度,加速学习过程。2) 奖励函数:分类得分奖励鼓励智能体擦除对分类影响最大的区域;强度分布奖励则约束擦除区域的强度分布,避免过度擦除或擦除到背景区域。3) 课程学习:从简单到复杂,逐步增加擦除难度,提高智能体的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的翻转学习方法在BUS和ABUS数据集上均优于现有的弱监督分割方法和基础模型。与最先进的WSS方法相比,分割精度显著提高,并且达到了与全监督学习算法相当的性能水平。这表明该方法在弱监督条件下能够有效地学习到精确的结节分割模型。

🎯 应用场景

该研究成果可应用于乳腺癌的辅助诊断和治疗计划制定。通过自动精确地分割乳腺超声图像中的结节,可以帮助医生更准确地评估肿瘤的大小、形状和位置,从而提高诊断准确率和治疗效果。此外,该方法还可以应用于大规模乳腺超声图像的筛查,提高筛查效率,降低漏诊率。未来,该技术有望集成到临床工作流程中,提升乳腺癌诊疗水平。

📄 摘要(原文)

Accurate segmentation of nodules in both 2D breast ultrasound (BUS) and 3D automated breast ultrasound (ABUS) is crucial for clinical diagnosis and treatment planning. Therefore, developing an automated system for nodule segmentation can enhance user independence and expedite clinical analysis. Unlike fully-supervised learning, weakly-supervised segmentation (WSS) can streamline the laborious and intricate annotation process. However, current WSS methods face challenges in achieving precise nodule segmentation, as many of them depend on inaccurate activation maps or inefficient pseudo-mask generation algorithms. In this study, we introduce a novel multi-agent reinforcement learning-based WSS framework called Flip Learning, which relies solely on 2D/3D boxes for accurate segmentation. Specifically, multiple agents are employed to erase the target from the box to facilitate classification tag flipping, with the erased region serving as the predicted segmentation mask. The key contributions of this research are as follows: (1) Adoption of a superpixel/supervoxel-based approach to encode the standardized environment, capturing boundary priors and expediting the learning process. (2) Introduction of three meticulously designed rewards, comprising a classification score reward and two intensity distribution rewards, to steer the agents' erasing process precisely, thereby avoiding both under- and over-segmentation. (3) Implementation of a progressive curriculum learning strategy to enable agents to interact with the environment in a progressively challenging manner, thereby enhancing learning efficiency. Extensively validated on the large in-house BUS and ABUS datasets, our Flip Learning method outperforms state-of-the-art WSS methods and foundation models, and achieves comparable performance as fully-supervised learning algorithms.