PRIMAL: Physically Reactive and Interactive Motor Model for Avatar Learning

作者: Yan Zhang, Yao Feng, Alpár Cseke, Nitin Saini, Nathan Bajandas, Nicolas Heron, Michael J. Black

分类: cs.CV, cs.AI

发布日期: 2025-03-21 (更新: 2025-08-02)

备注: ICCV'25 camera ready; main paper and appendix; 19 pages in total

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

PRIMAL:用于Avatar学习的物理交互式运动模型,提升真实感和响应性。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Avatar学习 运动生成 物理交互 生成式模型 无监督学习

📋 核心要点

- 现有运动生成方法缺乏真实人体运动的响应性和真实感,难以实现自然交互。

- PRIMAL通过两阶段学习范式,首先无监督预训练生成式运动基础,然后通过适配器微调适应特定任务。

- 实验表明,PRIMAL优于现有方法,并在Unreal Engine中实现了高度响应和自然的实时角色动画系统。

📝 摘要(中文)

本文提出了一种交互式Avatar的运动系统,将其建模为一个生成式运动模型,该模型能够以持续、逼真、可控和响应的方式驱动身体在3D空间中运动。尽管人体运动生成已得到广泛研究,但许多现有方法缺乏真实人体运动的响应性和真实感。受到近期基础模型进展的启发,我们提出了PRIMAL,它采用两阶段范式进行学习。在预训练阶段,该模型从大量亚秒级运动片段中学习身体运动,提供了一个生成基础,更复杂的运动由此构建。此训练是完全无监督的,无需任何标注。在推理过程中,给定单帧初始状态,预训练模型不仅可以生成无界、逼真且可控的运动,还能使Avatar实时响应诱导的冲量。在适应阶段,我们采用一种新颖的类似ControlNet的适配器来高效地微调基础模型,使其适应新的任务,例如少样本个性化动作生成和空间目标到达。评估表明,我们提出的方法优于最先进的基线。我们利用该模型在Unreal Engine中创建了一个实时角色动画系统,该系统感觉高度响应和自然。代码、模型和更多结果可在以下网址获得:https://yz-cnsdqz.github.io/eigenmotion/PRIMAL

🔬 方法详解

问题定义:论文旨在解决现有Avatar运动生成方法在响应性和真实感方面的不足。现有方法难以生成能够实时响应外部冲击并保持自然运动状态的Avatar动画,限制了其在交互式应用中的应用。

核心思路:论文的核心思路是利用大规模无监督运动数据预训练一个生成式运动模型,使其具备生成自然运动的基础能力。然后,通过一个可适配的模块,针对特定任务(如个性化动作生成和目标到达)对预训练模型进行微调,从而实现Avatar运动的快速适应和控制。

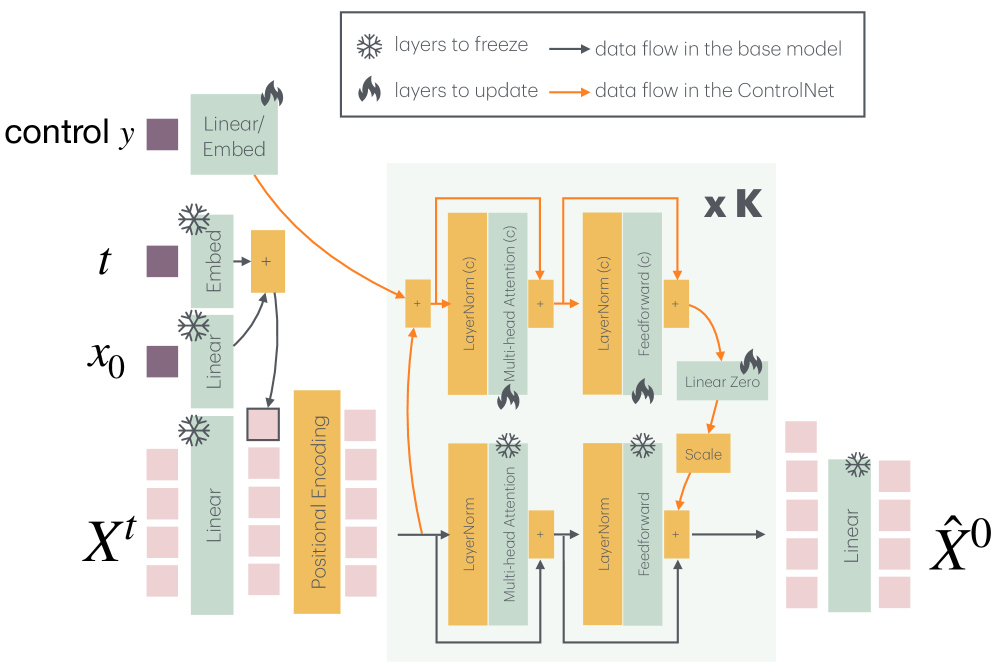

技术框架:PRIMAL采用两阶段训练框架。第一阶段是预训练阶段,使用大量无标注的亚秒级运动片段训练一个生成式运动模型。第二阶段是适应阶段,使用一个类似ControlNet的适配器,对预训练模型进行微调,使其适应特定任务。在推理阶段,给定初始状态,模型可以生成无限的、逼真的、可控的运动,并实时响应外部冲击。

关键创新:PRIMAL的关键创新在于其两阶段学习范式和ControlNet-like适配器的使用。预训练阶段利用大规模无监督数据学习运动的内在规律,避免了对大量标注数据的依赖。ControlNet-like适配器允许对预训练模型进行高效的微调,使其能够快速适应新的任务,而无需从头开始训练。

关键设计:预训练阶段使用Transformer架构学习运动片段之间的依赖关系。适配器模块的设计借鉴了ControlNet的思想,通过添加额外的卷积层来控制生成过程,同时保持预训练模型的生成能力。损失函数的设计包括运动学损失、动力学损失和对抗损失,以保证生成运动的真实性和自然性。具体参数设置和网络结构细节在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

论文提出的PRIMAL方法在Avatar运动生成方面取得了显著的成果。实验结果表明,PRIMAL在运动真实感、响应性和可控性方面均优于现有方法。特别是在实时角色动画系统中,PRIMAL能够生成高度响应和自然的运动,显著提升了用户体验。具体的性能数据和对比基线在论文中有详细描述(未知)。

🎯 应用场景

PRIMAL具有广泛的应用前景,包括虚拟现实、游戏、机器人控制和人机交互等领域。它可以用于创建更逼真、更具交互性的虚拟角色,提升用户体验。此外,该模型还可以用于机器人运动规划,使其能够更好地适应复杂环境并与人类进行协作。未来,PRIMAL有望成为构建下一代交互式Avatar和智能机器人的关键技术。

📄 摘要(原文)

We formulate the motor system of an interactive avatar as a generative motion model that can drive the body to move through 3D space in a perpetual, realistic, controllable, and responsive manner. Although human motion generation has been extensively studied, many existing methods lack the responsiveness and realism of real human movements. Inspired by recent advances in foundation models, we propose PRIMAL, which is learned with a two-stage paradigm. In the pretraining stage, the model learns body movements from a large number of sub-second motion segments, providing a generative foundation from which more complex motions are built. This training is fully unsupervised without annotations. Given a single-frame initial state during inference, the pretrained model not only generates unbounded, realistic, and controllable motion, but also enables the avatar to be responsive to induced impulses in real time. In the adaptation phase, we employ a novel ControlNet-like adaptor to fine-tune the base model efficiently, adapting it to new tasks such as few-shot personalized action generation and spatial target reaching. Evaluations show that our proposed method outperforms state-of-the-art baselines. We leverage the model to create a real-time character animation system in Unreal Engine that feels highly responsive and natural. Code, models, and more results are available at: https://yz-cnsdqz.github.io/eigenmotion/PRIMAL