TaoAvatar: Real-Time Lifelike Full-Body Talking Avatars for Augmented Reality via 3D Gaussian Splatting

作者: Jianchuan Chen, Jingchuan Hu, Gaige Wang, Zhonghua Jiang, Tiansong Zhou, Zhiwen Chen, Chengfei Lv

分类: cs.CV

发布日期: 2025-03-21 (更新: 2025-07-23)

备注: Accepted by CVPR 2025 (Highlight), project page: https://PixelAI-Team.github.io/TaoAvatar

💡 一句话要点

TaoAvatar:基于3D高斯溅射的实时逼真全身可交互增强现实化身

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 全身化身 增强现实 实时渲染 知识蒸馏 参数化人体模型 StyleUnet

📋 核心要点

- 现有全身可交互化身方法难以精细控制面部表情和身体动作,且细节不足,无法在移动设备上实时运行。

- TaoAvatar通过绑定高斯函数到参数化人体模板,并结合StyleUnet预训练和知识蒸馏,实现高保真和轻量化。

- 实验表明,TaoAvatar在保持实时性的同时,实现了最先进的渲染质量,并在Apple Vision Pro上达到90 FPS。

📝 摘要(中文)

本文提出TaoAvatar,一种基于3D高斯溅射(3DGS)的高保真、轻量级全身可交互化身,能够由多种信号驱动,适用于增强现实应用。该方法首先创建一个个性化的服装人体参数化模板,将高斯函数绑定以表示外观。然后,预训练一个基于StyleUnet的网络来处理复杂的、与姿势相关的非刚性形变,该网络可以捕捉高频外观细节,但资源消耗过大,不适合移动设备。为了解决这个问题,我们使用蒸馏技术将非刚性形变“烘焙”到一个轻量级的基于MLP的网络中,并开发混合形状来补偿细节。大量实验表明,TaoAvatar在各种设备上实现了最先进的渲染质量,同时保持实时性能,例如在Apple Vision Pro等高清立体设备上保持90 FPS。

🔬 方法详解

问题定义:现有3D全身可交互化身方法在增强现实应用中面临挑战,主要痛点在于:1)难以实现对细粒度面部表情和身体运动的精确控制;2)渲染细节不足,真实感欠佳;3)计算复杂度高,难以在移动设备上实时运行,限制了其在AR设备上的应用。

核心思路:TaoAvatar的核心思路是将高保真渲染与轻量化模型相结合,以实现实时逼真的全身可交互化身。具体而言,利用3D高斯溅射(3DGS)技术实现高质量渲染,并通过知识蒸馏将复杂形变信息迁移到轻量级MLP网络,从而降低计算复杂度,使其能够在移动设备上实时运行。同时,引入blend shapes来补偿细节损失。

技术框架:TaoAvatar的整体框架包含以下几个主要阶段:1) 参数化人体模板构建:创建一个个性化的服装人体参数化模板,并将3D高斯函数绑定到该模板,以表示化身的外观。2) StyleUnet预训练:使用StyleUnet网络学习复杂的、与姿势相关的非刚性形变,捕捉高频外观细节。3) 知识蒸馏:将StyleUnet网络的知识蒸馏到一个轻量级的基于MLP的网络中,以降低计算复杂度。4) Blend Shapes补偿:开发blend shapes来补偿由于知识蒸馏造成的细节损失。5) 实时渲染:在目标设备上实时渲染化身。

关键创新:TaoAvatar的关键创新在于:1) 基于3DGS的全身化身表示:利用3DGS实现高保真渲染,同时便于控制和优化。2) 知识蒸馏加速:通过知识蒸馏将复杂形变信息迁移到轻量级MLP网络,显著降低计算复杂度,实现实时渲染。3) Blend Shapes细节补偿:使用blend shapes补偿细节损失,进一步提升渲染质量。

关键设计:在参数化人体模板构建阶段,需要选择合适的参数化模型(如SMPL)。StyleUnet网络的结构和训练方式对形变捕捉能力至关重要。知识蒸馏过程中,需要设计合适的损失函数来保证MLP网络能够准确地学习StyleUnet网络的知识。Blend shapes的设计需要考虑细节补偿的范围和程度。此外,3DGS的参数初始化和优化策略也会影响最终的渲染效果。

🖼️ 关键图片

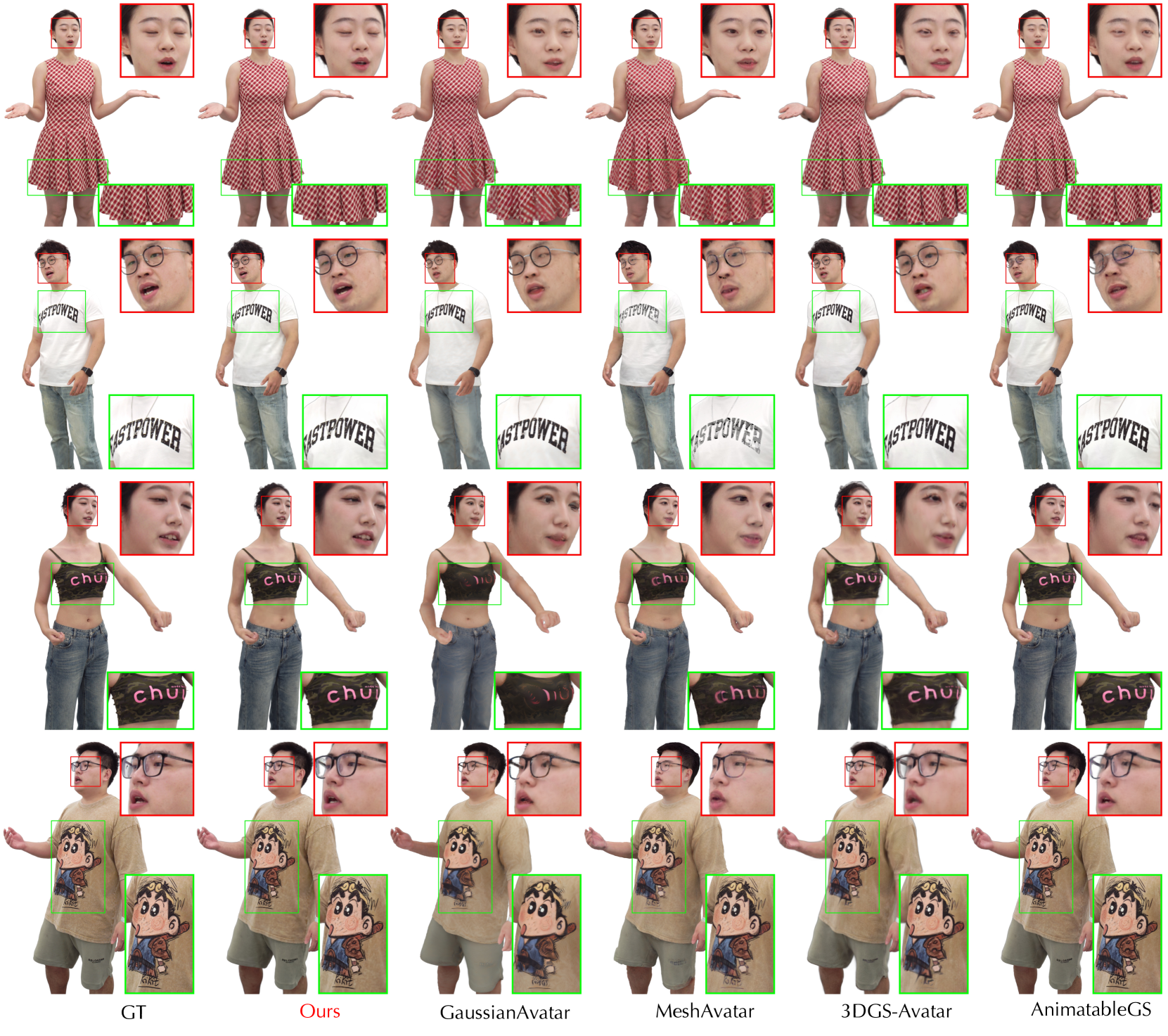

📊 实验亮点

TaoAvatar在实验中表现出卓越的性能。在渲染质量方面,TaoAvatar实现了最先进的水平。在实时性方面,TaoAvatar能够在各种设备上实时运行,例如在Apple Vision Pro等高清立体设备上保持90 FPS。这些实验结果表明,TaoAvatar在渲染质量和实时性之间取得了良好的平衡,使其成为AR应用的理想选择。

🎯 应用场景

TaoAvatar在增强现实领域具有广泛的应用前景,包括电商直播、远程协作、虚拟社交、游戏娱乐等。它可以用于创建逼真的虚拟形象,增强用户在AR环境中的沉浸感和交互体验。例如,用户可以使用TaoAvatar进行虚拟试衣、远程会议、虚拟演出等活动,从而提升用户体验和效率。未来,随着AR技术的不断发展,TaoAvatar有望成为AR应用的重要组成部分。

📄 摘要(原文)

Realistic 3D full-body talking avatars hold great potential in AR, with applications ranging from e-commerce live streaming to holographic communication. Despite advances in 3D Gaussian Splatting (3DGS) for lifelike avatar creation, existing methods struggle with fine-grained control of facial expressions and body movements in full-body talking tasks. Additionally, they often lack sufficient details and cannot run in real-time on mobile devices. We present TaoAvatar, a high-fidelity, lightweight, 3DGS-based full-body talking avatar driven by various signals. Our approach starts by creating a personalized clothed human parametric template that binds Gaussians to represent appearances. We then pre-train a StyleUnet-based network to handle complex pose-dependent non-rigid deformation, which can capture high-frequency appearance details but is too resource-intensive for mobile devices. To overcome this, we "bake" the non-rigid deformations into a lightweight MLP-based network using a distillation technique and develop blend shapes to compensate for details. Extensive experiments show that TaoAvatar achieves state-of-the-art rendering quality while running in real-time across various devices, maintaining 90 FPS on high-definition stereo devices such as the Apple Vision Pro.