Dynamic Point Maps: A Versatile Representation for Dynamic 3D Reconstruction

作者: Edgar Sucar, Zihang Lai, Eldar Insafutdinov, Andrea Vedaldi

分类: cs.CV

发布日期: 2025-03-20

备注: Web page: https://www.robots.ox.ac.uk/~vgg/research/dynamic-point-maps/

💡 一句话要点

提出动态点图(DPM),用于动态3D重建中的运动分割、场景流估计和物体跟踪。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景理解 动态点云重建 场景流估计 物体姿态跟踪 多视图几何

📋 核心要点

- 传统多视图几何方法难以处理动态场景,限制了其在现实世界中的应用。

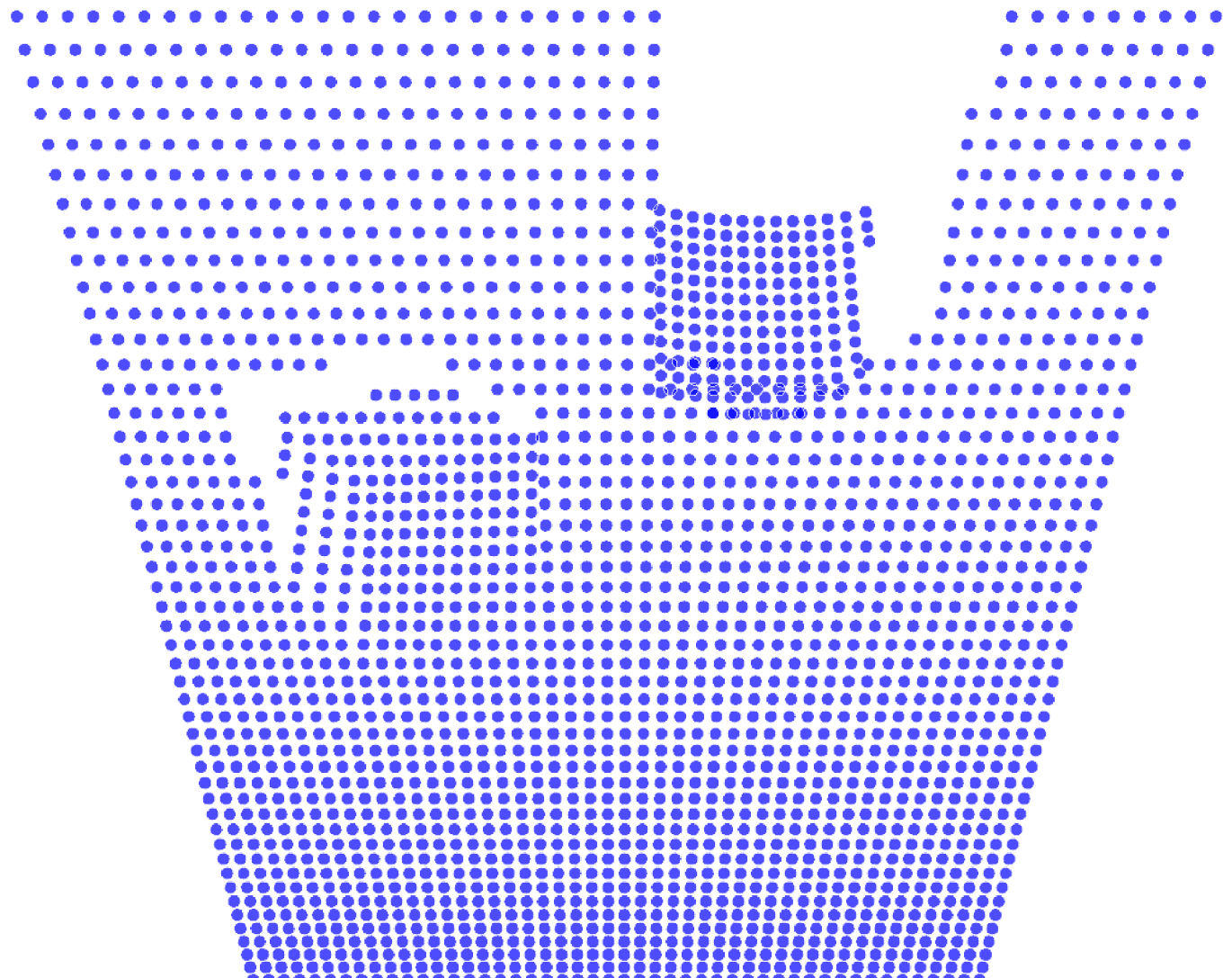

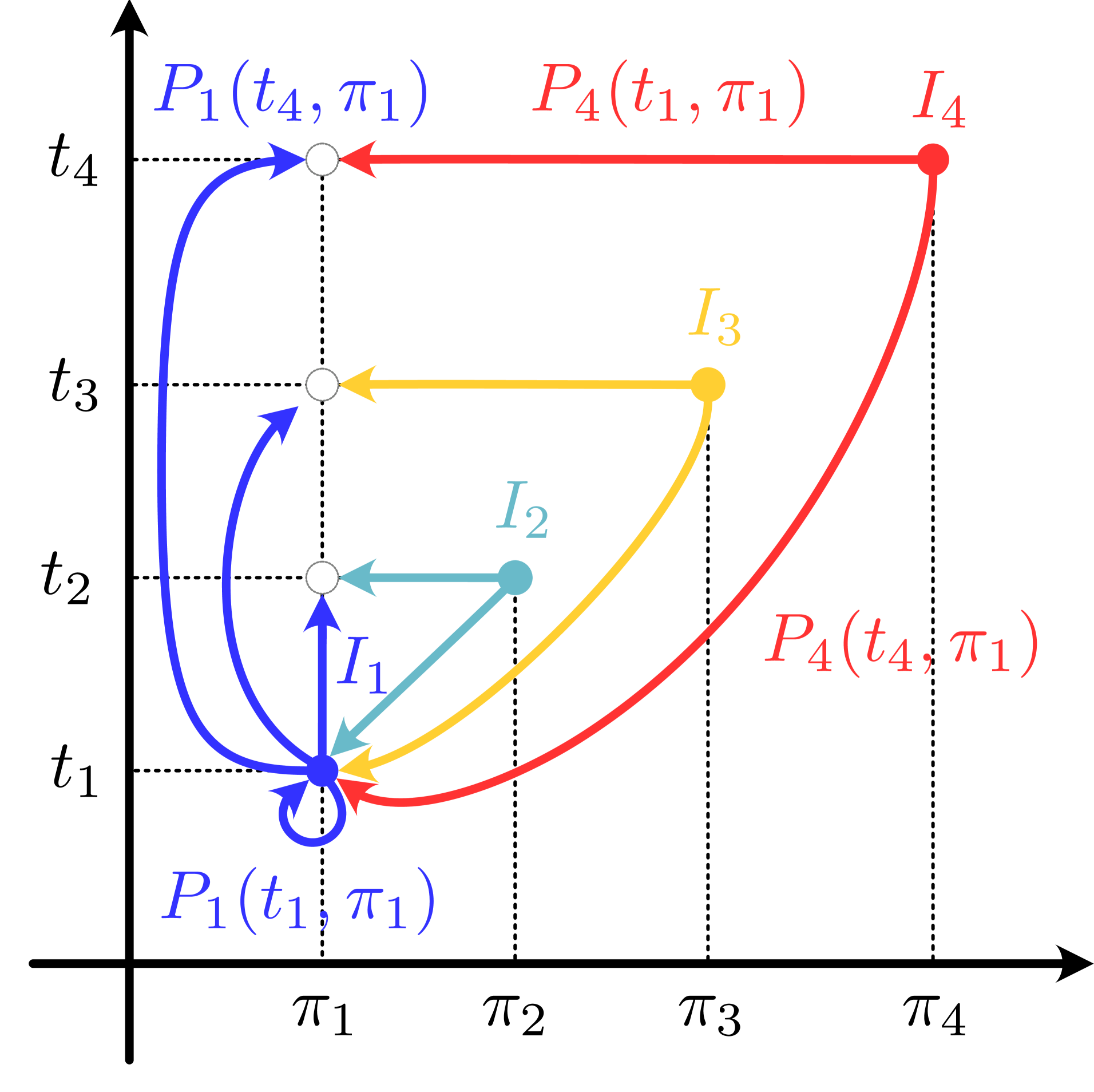

- 提出动态点图(DPM)表示,利用不同时空参考系的点云组合来捕捉动态信息。

- 在多个动态场景理解任务上验证了DPM的有效性,并取得了state-of-the-art的结果。

📝 摘要(中文)

本文提出动态点图(DPM)的概念,扩展了标准点图以支持4D任务,例如运动分割、场景流估计、3D物体跟踪和2D对应。核心思想是,当引入时间维度时,可以使用多个可能的空间和时间参考来定义点图。论文确定了这些组合的一个最小子集,可以通过网络回归来解决上述子任务。通过在合成和真实数据混合数据集上训练DPM预测器,并在视频深度预测、动态点云重建、3D场景流和物体姿态跟踪等多个基准上进行评估,实现了最先进的性能。代码、模型和其他结果可在https://www.robots.ox.ac.uk/~vgg/research/dynamic-point-maps/ 获取。

🔬 方法详解

问题定义:现有的多视图几何方法,如DUSt3R,虽然在静态场景的相机内外参估计、3D重建和图像对应方面表现出色,但无法处理动态场景。动态场景中物体的运动和形变使得传统的静态点云表示不再适用,需要一种能够捕捉时间信息的表示方法。

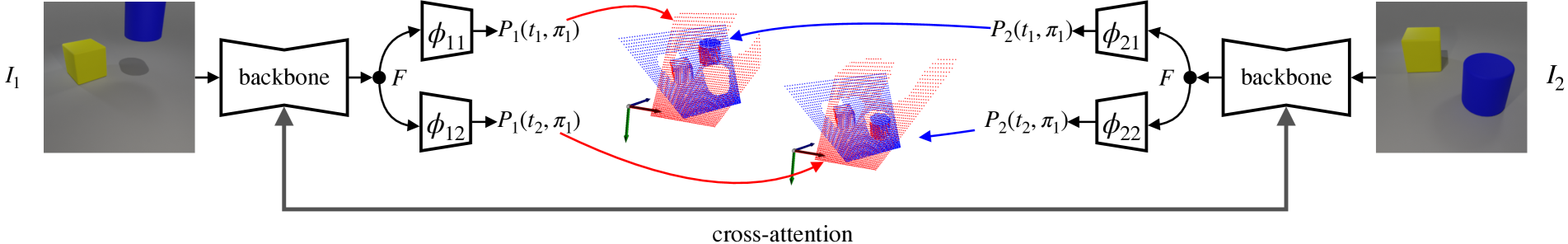

核心思路:论文的核心思路是扩展静态点图的概念到动态场景,提出动态点图(DPM)。DPM通过在不同的时空参考系下定义点云,从而能够捕捉场景中的运动信息。关键在于选择合适的时空参考系组合,使得网络能够有效地学习和预测这些点图。

技术框架:DPM预测器的训练和应用流程大致如下:首先,输入多视角视频帧;然后,DPM预测器(一个神经网络)预测一系列DPM,每个DPM对应于一个特定的时空参考系;最后,基于预测的DPM,可以解决各种4D任务,如运动分割、场景流估计、3D物体跟踪等。

关键创新:关键创新在于动态点图(DPM)的表示方法,它将时间维度纳入考虑,并利用不同的时空参考系来捕捉动态信息。与传统的静态点云表示相比,DPM能够更好地处理动态场景,并为各种4D任务提供了一种通用的表示。

关键设计:论文的关键设计包括:1) 选择合适的时空参考系组合,以最小化计算量并最大化信息量;2) 设计合适的网络结构来预测DPM;3) 设计合适的损失函数来训练DPM预测器。具体的网络结构和损失函数细节在论文中没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文在视频深度预测、动态点云重建、3D场景流和物体姿态跟踪等多个基准上进行了评估,并取得了state-of-the-art的性能。具体的性能数据和对比基线在论文中没有详细给出,属于未知信息。但摘要明确指出,DPM在这些任务上超越了现有方法。

🎯 应用场景

动态点图(DPM)在自动驾驶、机器人导航、增强现实等领域具有广泛的应用前景。例如,在自动驾驶中,DPM可以用于感知周围环境中的运动物体,并预测它们的未来轨迹,从而提高驾驶安全性。在机器人导航中,DPM可以用于构建动态环境地图,并帮助机器人规划路径。

📄 摘要(原文)

DUSt3R has recently shown that one can reduce many tasks in multi-view geometry, including estimating camera intrinsics and extrinsics, reconstructing the scene in 3D, and establishing image correspondences, to the prediction of a pair of viewpoint-invariant point maps, i.e., pixel-aligned point clouds defined in a common reference frame. This formulation is elegant and powerful, but unable to tackle dynamic scenes. To address this challenge, we introduce the concept of Dynamic Point Maps (DPM), extending standard point maps to support 4D tasks such as motion segmentation, scene flow estimation, 3D object tracking, and 2D correspondence. Our key intuition is that, when time is introduced, there are several possible spatial and time references that can be used to define the point maps. We identify a minimal subset of such combinations that can be regressed by a network to solve the sub tasks mentioned above. We train a DPM predictor on a mixture of synthetic and real data and evaluate it across diverse benchmarks for video depth prediction, dynamic point cloud reconstruction, 3D scene flow and object pose tracking, achieving state-of-the-art performance. Code, models and additional results are available at https://www.robots.ox.ac.uk/~vgg/research/dynamic-point-maps/.