SceneMI: Motion In-betweening for Modeling Human-Scene Interactions

作者: Inwoo Hwang, Bing Zhou, Young Min Kim, Jian Wang, Chuan Guo

分类: cs.CV

发布日期: 2025-03-20 (更新: 2025-07-25)

备注: Accepted to ICCV 2025. Project page: http://inwoohwang.me/SceneMI

💡 一句话要点

SceneMI:提出场景感知的运动插值框架,用于建模人-场景交互

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction) 支柱八:物理动画 (Physics-based Animation)

关键词: 人-场景交互 运动插值 扩散模型 场景感知 关键帧动画 3D场景 运动重建

📋 核心要点

- 现有HSI建模方法在可控性和灵活性方面存在局限性,难以满足实际应用需求。

- SceneMI将HSI建模重新定义为场景感知的运动插值,利用扩散模型的去噪能力处理噪声数据。

- 实验表明SceneMI在关键帧插值和真实世界数据集上表现出色,并可应用于单目视频的HSI重建。

📝 摘要(中文)

建模人-场景交互(HSI)对于理解和模拟日常人类行为至关重要。最近利用生成模型的方法在该领域取得了一些进展;然而,它们在实际应用中的可控性和灵活性方面受到限制。为了解决这些挑战,我们建议将HSI建模问题重新定义为场景感知的运动插值——一个更易于处理和更实用的任务。我们提出了SceneMI,一个支持多种实际应用的框架,包括3D场景中关键帧引导的角色动画,以及增强不完善的HSI数据的运动质量。SceneMI采用双场景描述符来全面编码全局和局部场景上下文。此外,我们的框架利用扩散模型固有的去噪特性来泛化到嘈杂的关键帧。实验结果表明,SceneMI在场景感知的关键帧插值和推广到真实世界的GIMO数据集方面是有效的,在该数据集中,运动和场景由嘈杂的IMU传感器和智能手机获取。我们进一步展示了SceneMI在单目视频中HSI重建中的适用性。

🔬 方法详解

问题定义:现有的人-场景交互(HSI)建模方法,特别是基于生成模型的方法,在可控性和灵活性上存在不足。这限制了它们在真实世界场景中的应用,例如,难以根据用户指定的关键帧生成自然的交互动画,或者难以处理由噪声传感器获取的不完美数据。

核心思路:论文的核心思路是将复杂的HSI建模问题分解为更易于处理的“场景感知的运动插值”任务。通过在给定的场景上下文和关键帧约束下,生成中间帧的运动,从而实现对HSI的建模和控制。这种方法利用了运动的连续性和场景的约束性,使得模型更容易学习和泛化。

技术框架:SceneMI框架主要包含以下几个模块:1) 双场景描述符:用于编码全局和局部场景上下文信息。2) 运动插值模块:基于扩散模型,根据场景描述符和关键帧信息生成中间帧的运动。3) 损失函数:用于训练模型,包括运动平滑性损失、关键帧约束损失和场景交互损失等。整体流程是,首先使用双场景描述符提取场景特征,然后将场景特征和关键帧信息输入到运动插值模块,生成中间帧的运动,最后使用损失函数对模型进行优化。

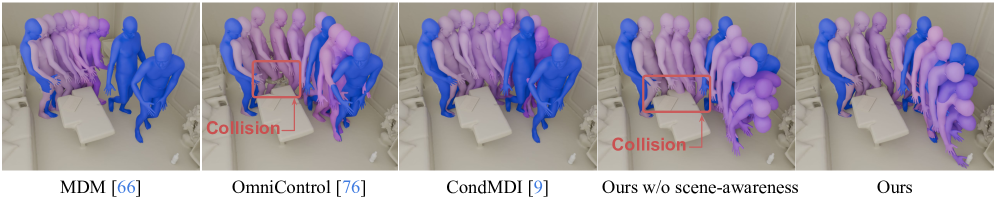

关键创新:SceneMI的关键创新在于:1) 将HSI建模问题重新定义为场景感知的运动插值任务,降低了问题的复杂度。2) 提出了双场景描述符,能够更全面地编码场景上下文信息。3) 利用扩散模型的去噪特性,增强了模型对噪声数据的鲁棒性。与现有方法相比,SceneMI在可控性、灵活性和鲁棒性方面都具有优势。

关键设计:双场景描述符包括全局场景描述符(例如,使用预训练的视觉Transformer提取全局场景特征)和局部场景描述符(例如,使用PointNet提取场景中关键点的特征)。运动插值模块采用基于扩散模型的架构,通过逐步去噪的方式生成中间帧的运动。损失函数包括L1损失(用于约束关键帧),运动平滑性损失(例如,使用速度和加速度的L1损失)和场景交互损失(例如,使用碰撞检测来避免穿模)。扩散模型的噪声schedule和采样步数是重要的超参数,需要根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SceneMI在场景感知的关键帧插值任务上取得了显著的性能提升。在GIMO数据集上,SceneMI能够生成更自然、更真实的运动,并且对噪声数据具有很强的鲁棒性。此外,SceneMI在单目视频的HSI重建任务上也表现出色,能够准确地重建人物的运动和场景交互。

🎯 应用场景

SceneMI具有广泛的应用前景,包括:1) 3D场景中关键帧引导的角色动画生成,可以用于游戏开发、电影制作等领域。2) 增强不完善的HSI数据的运动质量,例如,可以用于修复由噪声传感器获取的运动数据。3) 从单目视频中重建HSI,可以用于人体行为分析、智能监控等领域。该研究有望推动人机交互、虚拟现实等领域的发展。

📄 摘要(原文)

Modeling human-scene interactions (HSI) is essential for understanding and simulating everyday human behaviors. Recent approaches utilizing generative modeling have made progress in this domain; however, they are limited in controllability and flexibility for real-world applications. To address these challenges, we propose reformulating the HSI modeling problem as Scene-aware Motion In-betweening - a more tractable and practical task. We introduce SceneMI, a framework that supports several practical applications, including keyframe-guided character animation in 3D scenes and enhancing the motion quality of imperfect HSI data. SceneMI employs dual scene descriptors to comprehensively encode global and local scene context. Furthermore, our framework leverages the inherent denoising nature of diffusion models to generalize on noisy keyframes. Experimental results demonstrate SceneMI's effectiveness in scene-aware keyframe in-betweening and generalization to the real-world GIMO dataset, where motions and scenes are acquired by noisy IMU sensors and smartphones. We further showcase SceneMI's applicability in HSI reconstruction from monocular videos.