Plug-and-Play 1.x-Bit KV Cache Quantization for Video Large Language Models

作者: Keda Tao, Haoxuan You, Yang Sui, Can Qin, Huan Wang

分类: cs.CV

发布日期: 2025-03-20 (更新: 2025-09-29)

备注: 12 pages

💡 一句话要点

VidKV:针对视频大语言模型的即插即用1.x比特KV缓存量化方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频大语言模型 KV缓存量化 低比特量化 混合精度量化 视频理解 模型压缩

📋 核心要点

- 视频大语言模型面临KV缓存占用大量内存的挑战,限制了推理速度和效率。

- VidKV通过混合精度量化key和选择性保留value中的重要tokens,实现了低于2比特的KV缓存压缩。

- 实验表明,VidKV在保持模型性能的同时,显著降低了内存占用,适用于多种VideoLLM模型。

📝 摘要(中文)

视频大语言模型(VideoLLMs)展现了处理更长视频输入和进行复杂推理分析的能力。然而,由于视频帧产生的大量视觉tokens,键值(KV)缓存会显著增加内存需求,成为推理速度和内存使用的瓶颈。KV缓存量化是解决此问题的常用方法。本文发现,VideoLLMs的2比特KV量化几乎不会损害模型性能,但更低比特的KV缓存量化极限尚未被研究。为了填补这一空白,我们引入VidKV,一种即插即用的KV缓存量化方法,将KV缓存压缩到低于2比特。具体来说,(1)对于key,我们提出了一种通道维度上的混合精度量化策略,对异常通道执行2比特量化,对正常通道执行1比特量化并结合FFT;(2)对于value,我们实现了1.58比特量化,同时选择性地过滤语义上显著的视觉tokens以进行有针对性的保留,从而更好地权衡精度和模型性能。重要的是,我们的发现表明,VideoLLMs的value缓存应该以逐通道的方式进行量化,而不是像先前针对LLMs的KV缓存量化工作那样以逐token的方式进行量化。实验结果表明,在LLaVA-OV-7B和Qwen2.5-VL-7B上,VidKV在六个基准测试中有效地将KV缓存压缩到1.5比特和1.58比特精度,与FP16版本相比几乎没有性能下降。

🔬 方法详解

问题定义:视频大语言模型处理长视频时,KV缓存会消耗大量内存,成为推理瓶颈。现有的KV缓存量化方法通常针对LLM设计,直接应用于VideoLLM效果不佳,且对低于2比特的量化研究不足。

核心思路:VidKV的核心在于针对VideoLLM的特性,设计了混合精度Key量化和Value选择性保留策略。通过区分通道重要性,对Key进行差异化量化;通过保留语义显著的Value tokens,在低比特量化下保持模型性能。

技术框架:VidKV是一个即插即用的KV缓存量化方法,可以集成到现有的VideoLLM框架中。它主要包含两个模块:Key量化模块和Value量化模块。Key量化模块采用通道维度的混合精度量化,Value量化模块采用选择性token保留的量化方法。

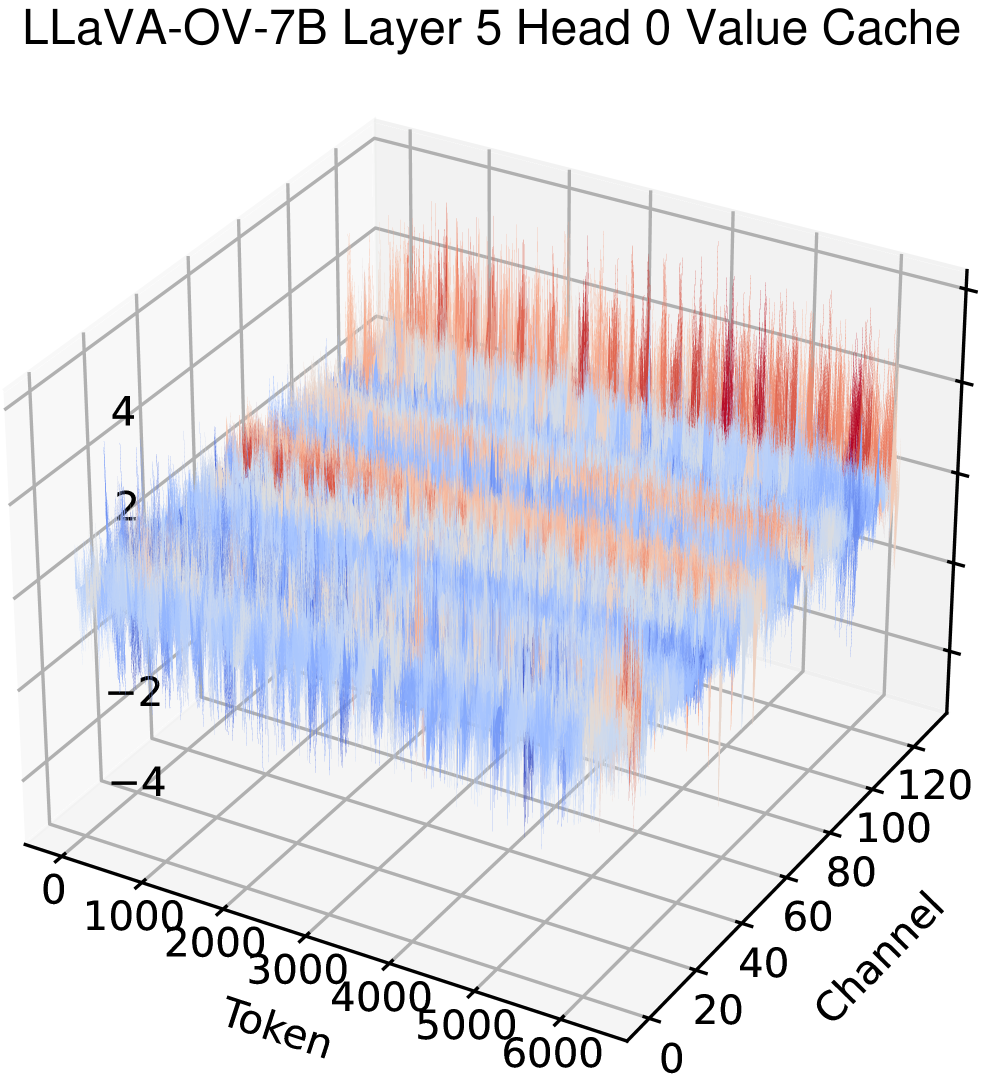

关键创新:VidKV的关键创新在于:1) 针对Key,提出了通道维度的混合精度量化策略,利用FFT对正常通道进行更激进的1比特量化。2) 针对Value,提出了选择性token保留策略,优先保留语义显著的视觉tokens,避免了均匀量化带来的信息损失。3) 发现VideoLLM的Value缓存应该以逐通道的方式进行量化,这与LLM的逐token量化不同。

关键设计:Key量化模块中,异常通道的判断标准和阈值选择是关键。Value量化模块中,语义显著性评分函数的选择和保留比例的确定是关键。论文中使用了具体的FFT实现细节和token选择策略,但具体参数设置可能需要根据不同的VideoLLM进行调整。

🖼️ 关键图片

📊 实验亮点

VidKV在LLaVA-OV-7B和Qwen2.5-VL-7B模型上进行了实验,在六个基准测试中,将KV缓存压缩到1.5比特和1.58比特精度,与FP16版本相比几乎没有性能下降。这表明VidKV能够在显著降低内存占用的同时,保持VideoLLM的性能。

🎯 应用场景

VidKV可应用于各种需要处理长视频输入的视频大语言模型,例如视频理解、视频问答、视频摘要等。通过降低内存占用,VidKV可以提升推理速度,降低部署成本,使得VideoLLM能够在资源受限的设备上运行,加速其在智能监控、自动驾驶、智能家居等领域的应用。

📄 摘要(原文)

Video large language models (VideoLLMs) have demonstrated the capability to process longer video inputs and enable complex reasoning and analysis. However, due to the thousands of visual tokens from the video frames, the key-value (KV) cache can significantly increase memory requirements, becoming a bottleneck for inference speed and memory usage. KV cache quantization is a widely used approach to address this problem. In this paper, we find that 2-bit KV quantization of VideoLLMs can hardly hurt the model performance, while the limit of KV cache quantization in even lower bits has not been investigated. To bridge this gap, we introduce VidKV, a plug-and-play KV cache quantization method to compress the KV cache to lower than 2 bits. Specifically, (1) for key, we propose a mixed-precision quantization strategy in the channel dimension, where we perform 2-bit quantization for anomalous channels and 1-bit quantization combined with FFT for normal channels; (2) for value, we implement 1.58-bit quantization while selectively filtering semantically salient visual tokens for targeted preservation, for a better trade-off between precision and model performance. Importantly, our findings suggest that the value cache of VideoLLMs should be quantized in a per-channel fashion instead of the per-token fashion proposed by prior KV cache quantization works for LLMs. Empirically, extensive results with LLaVA-OV-7B and Qwen2.5-VL-7B on six benchmarks show that VidKV effectively compresses the KV cache to 1.5-bit and 1.58-bit precision with almost no performance drop compared to the FP16 counterparts.