SaMam: Style-aware State Space Model for Arbitrary Image Style Transfer

作者: Hongda Liu, Longguang Wang, Ye Zhang, Ziru Yu, Yulan Guo

分类: cs.CV

发布日期: 2025-03-20

备注: 11 pages, 10 figures, 2 tables

💡 一句话要点

提出SaMam:一种风格感知的状态空间模型,用于任意图像风格迁移

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图像风格迁移 状态空间模型 Mamba 长程依赖 风格感知 局部增强 Zigzag扫描

📋 核心要点

- 现有图像风格迁移方法依赖于CNN或Transformer,但获取全局感受野需要巨大的计算开销。

- SaMam利用Mamba的线性复杂度优势,设计风格感知的状态空间模型,高效建模长程依赖关系。

- SaMam通过局部增强和Zigzag扫描,缓解了SSM的局部像素遗忘、通道冗余和空间不连续性问题,提升了风格迁移效果。

📝 摘要(中文)

本文提出了一种基于Mamba的状态空间模型风格迁移框架,称为SaMam。该框架旨在解决现有风格迁移骨干网络(如CNN和Transformer)在实现全局感受野时计算复杂度过高的问题。SaMam设计了一个Mamba编码器,用于高效地提取内容和风格信息。此外,还开发了一个风格感知的Mamba解码器,以灵活适应各种风格。为了解决现有SSM存在的局部像素遗忘、通道冗余和空间不连续性问题,本文引入了局部增强和Zigzag扫描。实验结果表明,SaMam在准确性和效率方面均优于最先进的方法。

🔬 方法详解

问题定义:图像风格迁移旨在将一幅图像的内容按照另一幅图像的风格进行渲染。现有方法,如基于CNN和Transformer的模型,为了获得高质量的风格化结果,需要较大的感受野。然而,增大感受野通常会导致计算复杂度显著增加,限制了其在实际应用中的可行性。此外,现有的状态空间模型(SSM)在图像处理中存在局部像素遗忘、通道冗余和空间不连续性等问题,影响了风格迁移的质量。

核心思路:本文的核心思路是利用状态空间模型(特别是Mamba)在建模长程依赖关系方面的优势,同时保持较低的计算复杂度。通过设计一个基于Mamba的编码器-解码器结构,高效地提取内容和风格信息,并灵活地适应各种风格。此外,通过引入局部增强和Zigzag扫描,解决现有SSM在图像处理中存在的问题,从而提高风格迁移的质量。

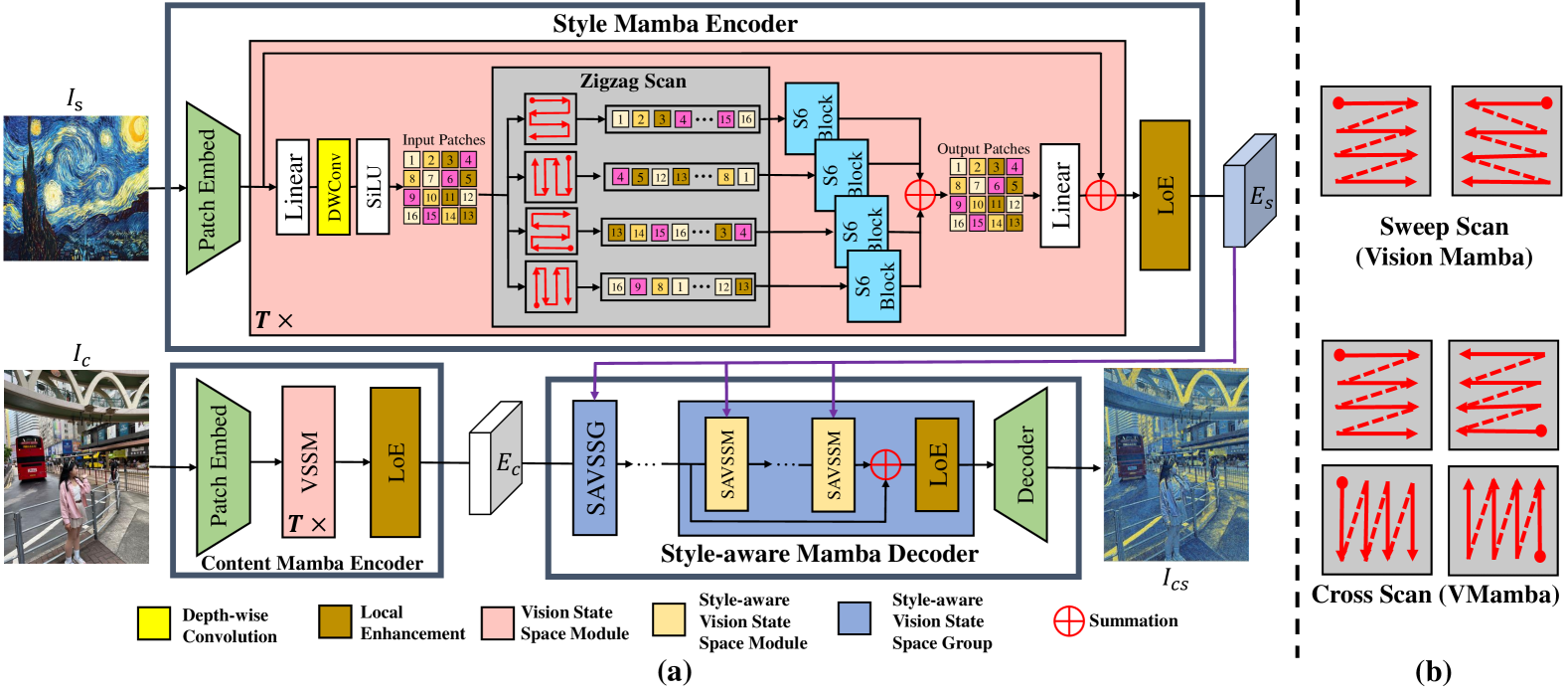

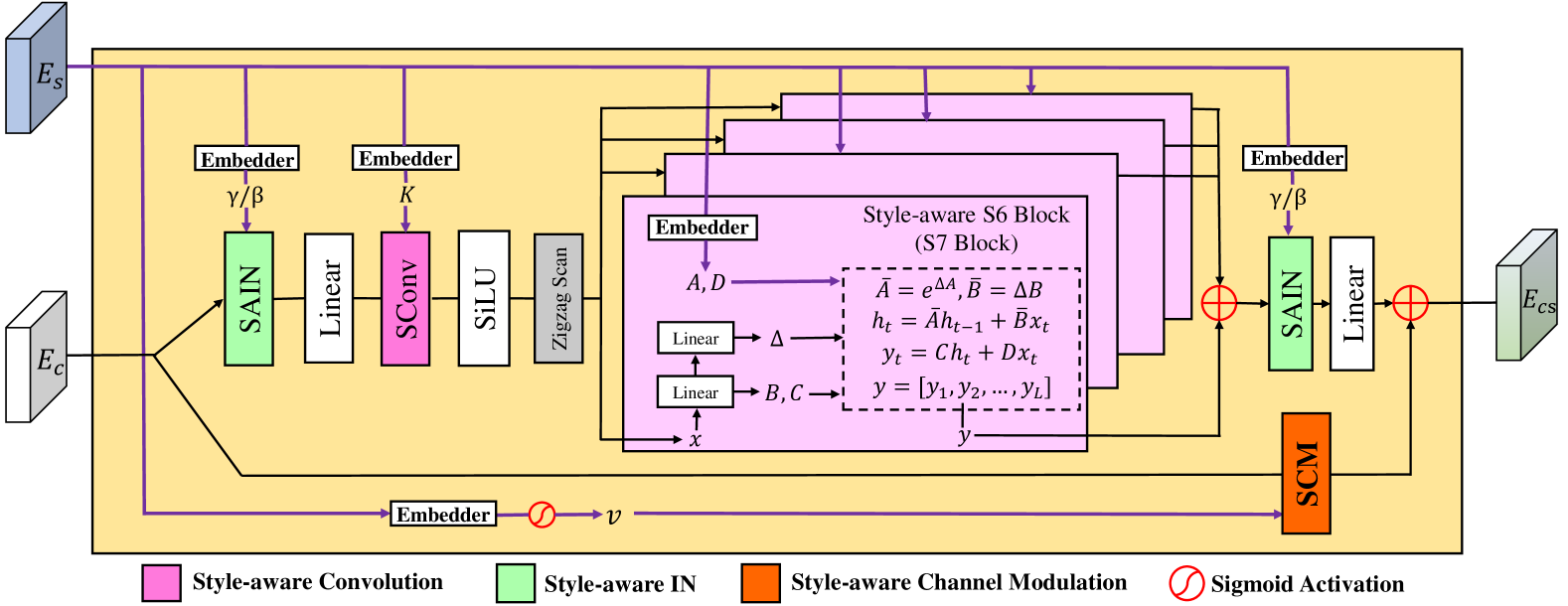

技术框架:SaMam框架主要包含以下几个模块:1) Mamba编码器:用于提取内容和风格信息。2) 风格感知的Mamba解码器:用于根据提取的风格信息,将内容图像进行风格化。3) 局部增强模块:用于增强局部细节,缓解局部像素遗忘问题。4) Zigzag扫描:用于提高空间连续性,减少空间不连续性问题。整体流程是:首先,使用Mamba编码器提取内容和风格特征;然后,将风格特征输入到风格感知的Mamba解码器中,对内容特征进行风格化;最后,通过局部增强模块和Zigzag扫描,进一步提高风格化图像的质量。

关键创新:本文的关键创新在于:1) 将Mamba引入到图像风格迁移任务中,利用其线性复杂度的优势,高效地建模长程依赖关系。2) 设计了风格感知的Mamba解码器,可以灵活地适应各种风格。3) 提出了局部增强和Zigzag扫描,有效地解决了现有SSM在图像处理中存在的局部像素遗忘、通道冗余和空间不连续性等问题。

关键设计:在Mamba编码器和解码器中,使用了多个Mamba块来提取特征。风格感知的Mamba解码器通过将风格特征作为条件输入到Mamba块中,从而实现风格的自适应。局部增强模块采用卷积神经网络来实现,用于增强局部细节。Zigzag扫描通过改变像素的扫描顺序,提高空间连续性。损失函数包括内容损失、风格损失和总变差损失,用于约束风格化图像的内容、风格和光滑度。

🖼️ 关键图片

📊 实验亮点

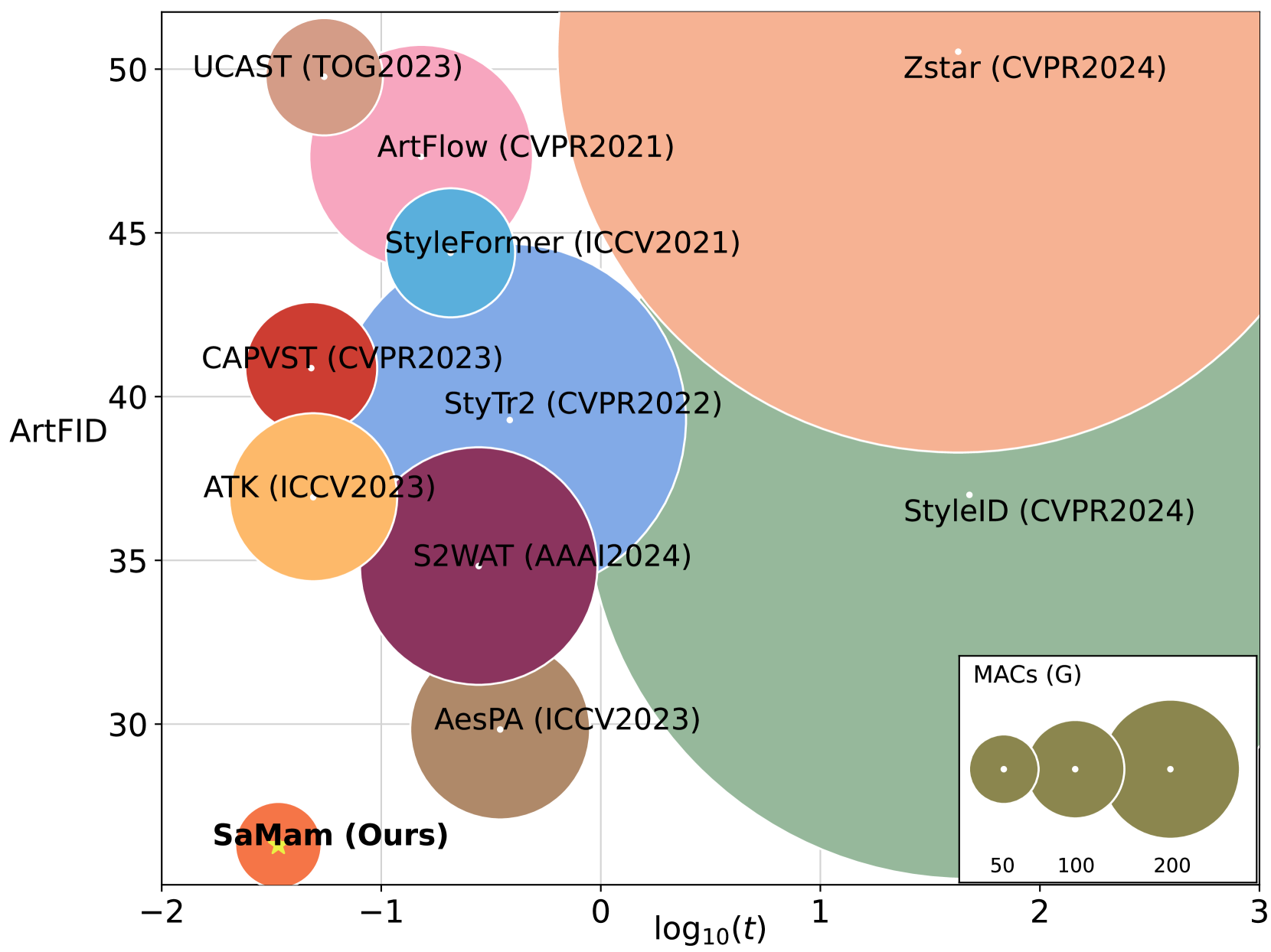

实验结果表明,SaMam在准确性和效率方面均优于最先进的方法。具体来说,SaMam在风格迁移质量上取得了显著提升,同时计算复杂度远低于基于CNN和Transformer的方法。例如,在COCO数据集上,SaMam的风格迁移效果在视觉上更接近目标风格,并且在风格相似度指标上优于其他方法。此外,SaMam的运行速度也明显快于其他方法,使其更适合实际应用。

🎯 应用场景

SaMam在图像风格迁移领域具有广泛的应用前景,可以用于艺术创作、图像编辑、游戏开发等领域。例如,可以将照片转换为油画、水彩画等风格,或者将游戏场景渲染成不同的艺术风格。该研究的实际价值在于提高了风格迁移的效率和质量,为用户提供了更加便捷和高质量的风格迁移服务。未来,SaMam可以进一步扩展到视频风格迁移、三维模型风格迁移等领域。

📄 摘要(原文)

Global effective receptive field plays a crucial role for image style transfer (ST) to obtain high-quality stylized results. However, existing ST backbones (e.g., CNNs and Transformers) suffer huge computational complexity to achieve global receptive fields. Recently, the State Space Model (SSM), especially the improved variant Mamba, has shown great potential for long-range dependency modeling with linear complexity, which offers a approach to resolve the above dilemma. In this paper, we develop a Mamba-based style transfer framework, termed SaMam. Specifically, a mamba encoder is designed to efficiently extract content and style information. In addition, a style-aware mamba decoder is developed to flexibly adapt to various styles. Moreover, to address the problems of local pixel forgetting, channel redundancy and spatial discontinuity of existing SSMs, we introduce both local enhancement and zigzag scan. Qualitative and quantitative results demonstrate that our SaMam outperforms state-of-the-art methods in terms of both accuracy and efficiency.