Learning 3D Scene Analogies with Neural Contextual Scene Maps

作者: Junho Kim, Gwangtak Bae, Eun Sun Lee, Young Min Kim

分类: cs.CV, cs.LG

发布日期: 2025-03-20 (更新: 2025-07-31)

备注: Accepted to ICCV 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出神经上下文场景图,用于学习3D场景类比并实现场景间知识迁移

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting)

关键词: 3D场景理解 场景类比 神经上下文场景图 知识迁移 机器人 增强现实 虚拟现实

📋 核心要点

- 现有方法难以全面概括3D场景布局的多样性,限制了机器在复杂环境中的知识迁移和适应能力。

- 提出神经上下文场景图,通过提取和对齐场景的语义和几何上下文描述符,学习场景间的平滑映射关系。

- 实验证明,该方法在轨迹转移和物体重排等任务中表现出色,验证了其在机器人和AR/VR领域的潜力。

📝 摘要(中文)

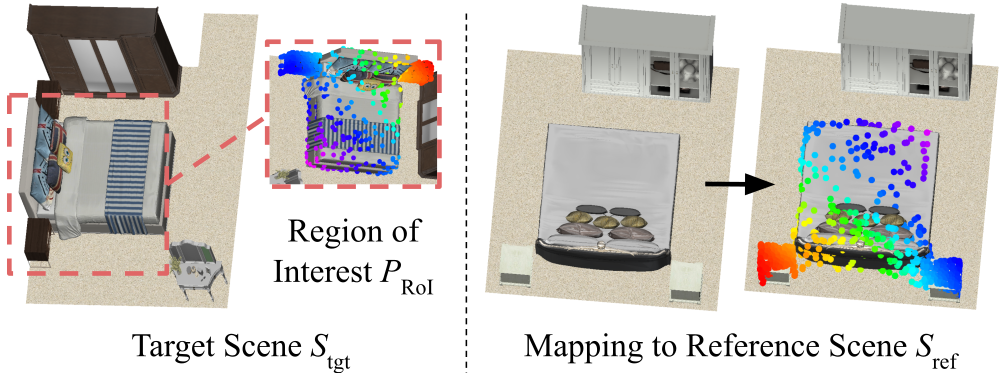

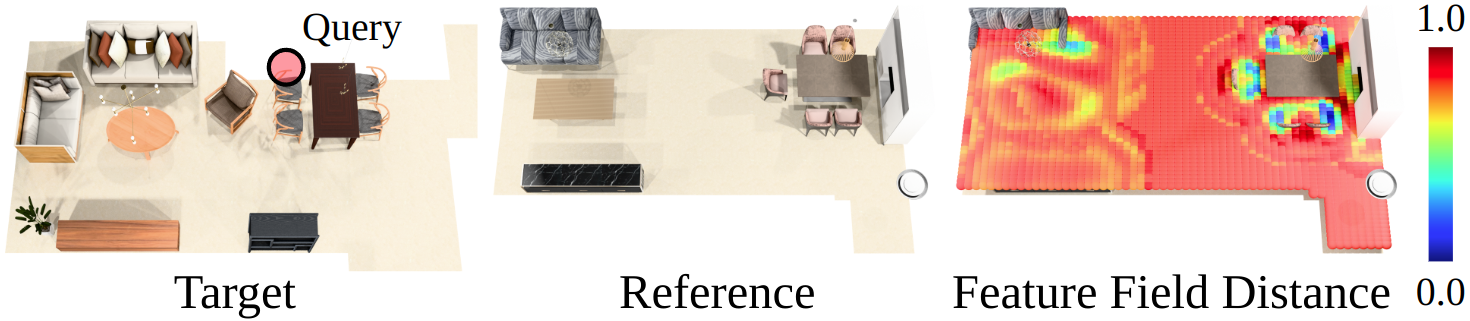

本文提出了一种学习3D场景类比的方法,旨在使机器能够理解场景上下文,并在未见过的或嘈杂的3D环境中执行任务和适应先验知识。由于数据驱动学习难以全面概括各种布局和开放空间,因此本文建议教导机器识别3D空间中的关系共性。该方法不关注点级或对象级表示,而是引入3D场景类比,即对齐空间关系的3D场景区域之间的平滑映射。与研究充分的单实例级映射不同,这些场景级映射平滑地连接大型场景区域,从而可能在AR/VR中的轨迹转移、模仿学习的长时间演示转移以及上下文感知的对象重排中实现独特的应用。为了找到3D场景类比,本文提出了神经上下文场景图,该图提取总结语义和几何上下文的描述符字段,并以由粗到精的方式整体对齐它们以进行地图估计。这种方法减少了对单个特征点的依赖,使其对输入噪声或形状变化具有鲁棒性。实验表明,该方法在识别场景类比以及在各种室内场景中转移轨迹或对象放置方面的有效性,表明其在机器人和AR/VR应用中的潜力。

🔬 方法详解

问题定义:现有方法在理解和利用3D场景上下文方面存在局限性,尤其是在数据驱动学习难以覆盖所有可能的场景布局时。直接依赖点云或物体级别的特征进行匹配,容易受到噪声、遮挡和形状变化的影响,导致泛化能力不足。因此,需要一种更鲁棒、更高效的方法来学习场景之间的关系,实现知识迁移和任务适应。

核心思路:本文的核心思路是通过学习3D场景类比,即场景区域之间的平滑映射,来建立不同场景之间的对应关系。这种方法不依赖于精确的点云或物体匹配,而是关注场景的整体语义和几何上下文,从而提高鲁棒性和泛化能力。通过学习场景类比,可以将一个场景中的知识(例如轨迹或物体布局)迁移到另一个场景中。

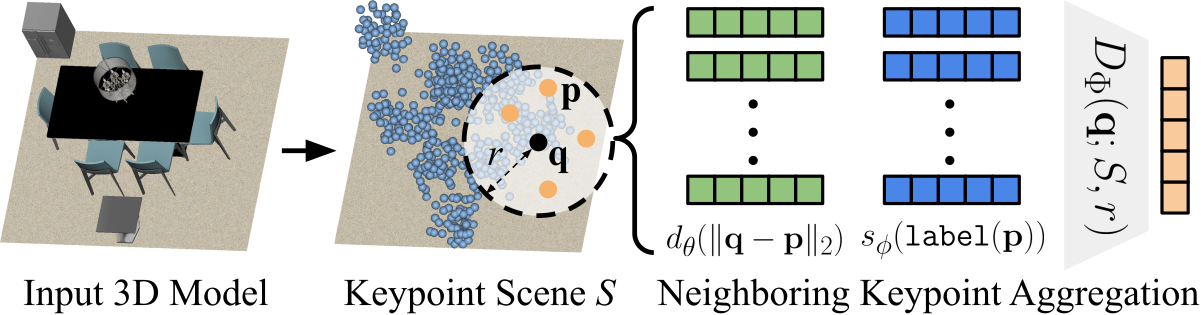

技术框架:该方法主要包含以下几个阶段:1) 上下文描述符提取:使用神经网络提取场景中每个点的语义和几何上下文信息,生成描述符字段。2) 粗略对齐:使用全局匹配算法(例如最优传输)对齐不同场景的描述符字段,建立初始的对应关系。3) 精细对齐:使用迭代最近点(ICP)等方法对初始对应关系进行优化,得到更精确的场景映射。4) 知识迁移:利用学习到的场景映射,将一个场景中的知识(例如轨迹或物体布局)迁移到另一个场景中。

关键创新:该方法的关键创新在于提出了神经上下文场景图,它能够有效地提取和表示场景的语义和几何上下文信息,并以一种鲁棒的方式对齐不同场景。与传统的基于特征点的匹配方法相比,该方法对噪声和形状变化具有更强的鲁棒性。此外,该方法还能够学习场景之间的平滑映射,从而实现更自然的知识迁移。

关键设计:在上下文描述符提取阶段,使用了PointNet++等网络结构来提取点云的局部和全局特征。在粗略对齐阶段,使用了Sinkhorn算法来解决最优传输问题。在精细对齐阶段,使用了ICP算法来优化场景映射。损失函数包括描述符匹配损失、平滑性损失和对应关系一致性损失。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在场景类比识别、轨迹转移和物体放置等任务中取得了显著的成果。与现有的基于特征点的匹配方法相比,该方法在噪声和形状变化较大的场景中表现出更强的鲁棒性。具体性能数据未知,但论文强调了该方法在各种室内场景中转移轨迹或对象放置方面的有效性。

🎯 应用场景

该研究成果可广泛应用于机器人、增强现实(AR)和虚拟现实(VR)等领域。例如,在机器人导航中,可以将一个场景中的导航策略迁移到另一个相似的场景中,从而提高机器人的自主导航能力。在AR/VR中,可以实现虚拟物体在不同场景中的自然放置和交互,增强用户体验。此外,该方法还可以用于三维场景重建、场景理解和场景编辑等任务。

📄 摘要(原文)

Understanding scene contexts is crucial for machines to perform tasks and adapt prior knowledge in unseen or noisy 3D environments. As data-driven learning is intractable to comprehensively encapsulate diverse ranges of layouts and open spaces, we propose teaching machines to identify relational commonalities in 3D spaces. Instead of focusing on point-wise or object-wise representations, we introduce 3D scene analogies, which are smooth maps between 3D scene regions that align spatial relationships. Unlike well-studied single instance-level maps, these scene-level maps smoothly link large scene regions, potentially enabling unique applications in trajectory transfer in AR/VR, long demonstration transfer for imitation learning, and context-aware object rearrangement. To find 3D scene analogies, we propose neural contextual scene maps, which extract descriptor fields summarizing semantic and geometric contexts, and holistically align them in a coarse-to-fine manner for map estimation. This approach reduces reliance on individual feature points, making it robust to input noise or shape variations. Experiments demonstrate the effectiveness of our approach in identifying scene analogies and transferring trajectories or object placements in diverse indoor scenes, indicating its potential for robotics and AR/VR applications. Project page including the code is available through this link: https://82magnolia.github.io/3d_scene_analogies/.