BARD-GS: Blur-Aware Reconstruction of Dynamic Scenes via Gaussian Splatting

作者: Yiren Lu, Yunlai Zhou, Disheng Liu, Tuo Liang, Yu Yin

分类: cs.CV

发布日期: 2025-03-20

备注: CVPR2025. Project page at https://vulab-ai.github.io/BARD-GS/

💡 一句话要点

BARD-GS:提出一种基于高斯溅射的动态场景模糊感知重建方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景重建 高斯溅射 运动模糊 相机姿态估计 物体运动估计

📋 核心要点

- 现有动态场景重建方法难以处理手持相机拍摄造成的运动模糊,导致重建质量下降。

- BARD-GS将运动模糊分解为相机运动模糊和物体运动模糊,分别进行建模和处理,提升重建质量。

- 通过真实世界的运动模糊数据集进行评估,实验结果表明BARD-GS显著优于现有方法。

📝 摘要(中文)

3D高斯溅射(3DGS)在静态场景重建方面表现出卓越的潜力,最近的进展将其应用扩展到动态场景。然而,重建质量严重依赖于高质量的输入图像和精确的相机姿态,这在实际场景中并不容易实现。例如,使用手持单目相机捕获动态场景通常涉及相机和场景内物体的同步运动。这种组合运动经常导致图像模糊,而现有方法无法充分处理。为了应对这些挑战,我们提出了一种新的动态场景鲁棒重建方法BARD-GS,该方法可以有效地处理模糊输入和不精确的相机姿态。我们的方法包括两个主要组成部分:1)相机运动去模糊和2)物体运动去模糊。通过显式地将运动模糊分解为相机运动模糊和物体运动模糊并分别建模,我们在动态区域实现了显著改进的渲染结果。此外,我们收集了一个真实世界的动态场景运动模糊数据集来评估我们的方法。大量的实验表明,BARD-GS在真实条件下有效地重建了高质量的动态场景,显著优于现有方法。

🔬 方法详解

问题定义:现有动态场景重建方法对输入图像质量要求高,特别是当使用手持相机拍摄时,相机和物体的同步运动会导致图像模糊,严重影响重建质量。现有方法无法有效处理这种运动模糊,导致重建结果不准确,尤其是在动态区域。

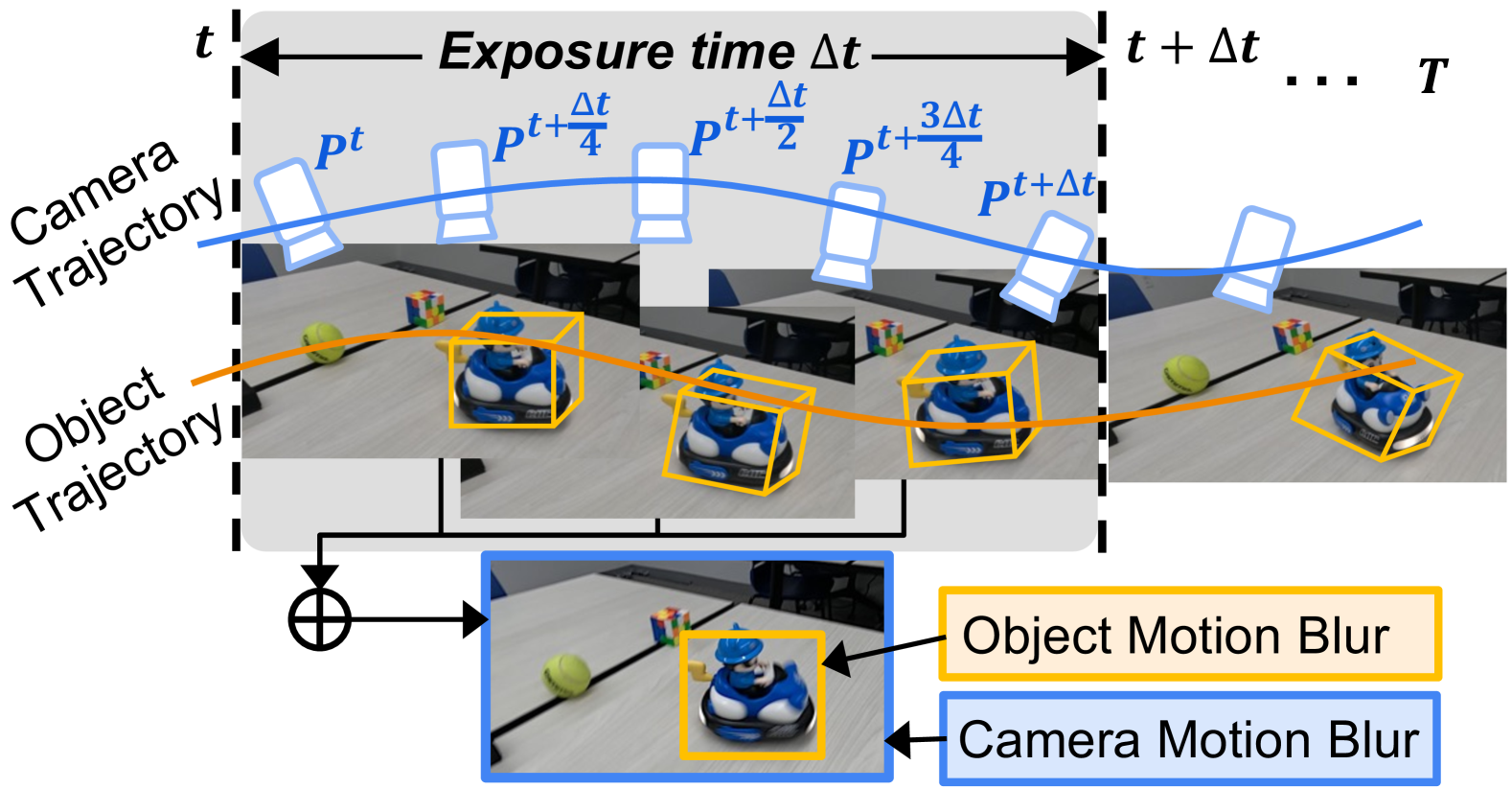

核心思路:BARD-GS的核心思路是将总的运动模糊分解为相机运动引起的模糊和物体运动引起的模糊,然后分别对这两种模糊进行建模和处理。通过这种分解,可以更精确地估计相机姿态和物体运动,从而实现更准确的动态场景重建。

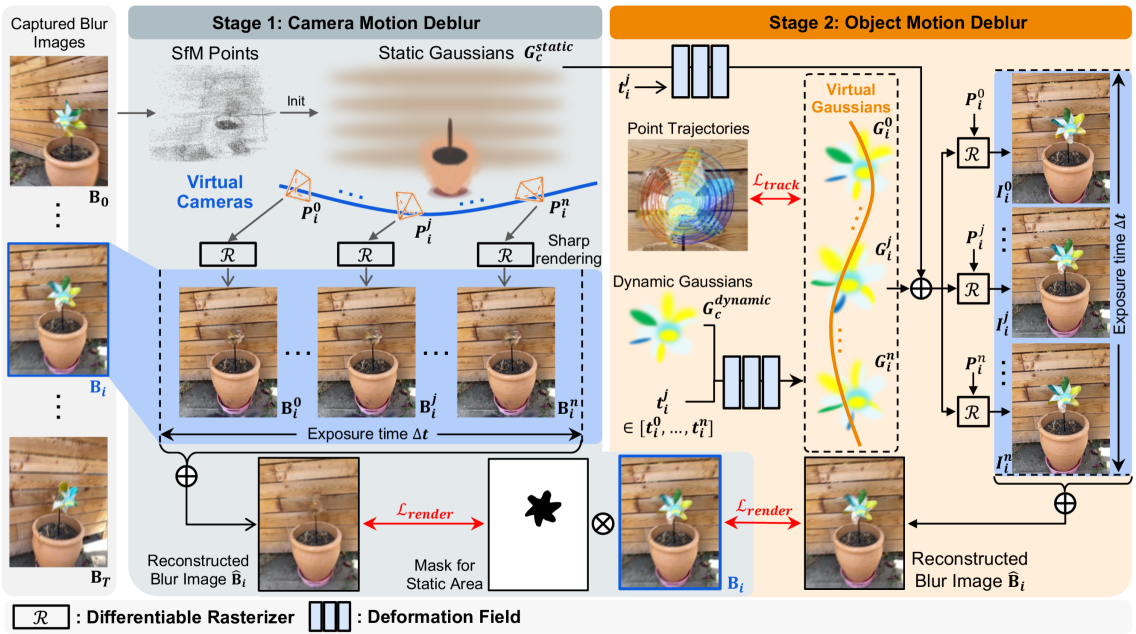

技术框架:BARD-GS包含两个主要模块:相机运动去模糊模块和物体运动去模糊模块。首先,相机运动去模糊模块利用图像信息估计相机的运动轨迹,并对相机运动引起的模糊进行校正。然后,物体运动去模糊模块利用去模糊后的图像和估计的相机姿态,对物体运动引起的模糊进行建模和校正。最后,利用去模糊后的图像和精确的相机姿态,使用3D高斯溅射进行动态场景重建。

关键创新:BARD-GS的关键创新在于显式地将运动模糊分解为相机运动模糊和物体运动模糊,并分别进行建模和处理。这种分解能够更准确地估计相机姿态和物体运动,从而实现更鲁棒和准确的动态场景重建。与现有方法相比,BARD-GS能够更好地处理模糊输入,并获得更高的重建质量。

关键设计:BARD-GS的具体实现细节包括:使用参数化的相机运动模型和物体运动模型来表示模糊核;使用基于优化的方法来估计相机姿态和物体运动参数;使用专门设计的损失函数来约束相机姿态和物体运动的估计,例如,光度一致性损失和几何一致性损失。此外,还收集了一个真实世界的运动模糊数据集,用于训练和评估BARD-GS。

🖼️ 关键图片

📊 实验亮点

BARD-GS在真实世界的运动模糊数据集上进行了评估,实验结果表明,BARD-GS显著优于现有的动态场景重建方法。具体来说,BARD-GS在PSNR、SSIM等指标上取得了显著提升,尤其是在动态区域。这表明BARD-GS能够有效地处理模糊输入,并重建出高质量的动态场景。

🎯 应用场景

BARD-GS可应用于机器人导航、自动驾驶、增强现实等领域。在这些场景中,相机通常会经历快速运动,导致图像模糊。BARD-GS能够有效地处理这些模糊,从而提高系统的鲁棒性和准确性。此外,该方法还可以用于电影制作和游戏开发等领域,以创建更逼真的动态场景。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has shown remarkable potential for static scene reconstruction, and recent advancements have extended its application to dynamic scenes. However, the quality of reconstructions depends heavily on high-quality input images and precise camera poses, which are not that trivial to fulfill in real-world scenarios. Capturing dynamic scenes with handheld monocular cameras, for instance, typically involves simultaneous movement of both the camera and objects within a single exposure. This combined motion frequently results in image blur that existing methods cannot adequately handle. To address these challenges, we introduce BARD-GS, a novel approach for robust dynamic scene reconstruction that effectively handles blurry inputs and imprecise camera poses. Our method comprises two main components: 1) camera motion deblurring and 2) object motion deblurring. By explicitly decomposing motion blur into camera motion blur and object motion blur and modeling them separately, we achieve significantly improved rendering results in dynamic regions. In addition, we collect a real-world motion blur dataset of dynamic scenes to evaluate our approach. Extensive experiments demonstrate that BARD-GS effectively reconstructs high-quality dynamic scenes under realistic conditions, significantly outperforming existing methods.