Physically Grounded Monocular Depth via Nanophotonic Wavefront Prompting

作者: Bingxuan Li, Jiahao Wu, Yuan Xu, Zezheng Zhu, Yunxiang Zhang, Kenneth Chen, Yanqi Liang, Nanfang Yu, Qi Sun

分类: physics.optics, cs.AR, cs.CV

发布日期: 2025-03-20 (更新: 2025-12-16)

💡 一句话要点

利用纳米光子波前调控,实现物理可信的单目深度估计

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 单目深度估计 纳米光子学 超透镜 波前调控 深度学习 物理提示 度量深度

📋 核心要点

- 现有深度基础模型缺乏物理深度线索,导致单目深度估计在度量尺度上存在模糊性,限制了其应用。

- 论文提出一种基于双折射超透镜的物理提示方法,将深度信息嵌入到偏振光波前中,引导深度基础模型学习。

- 通过模拟和物理实验验证,该方法在单目深度估计中实现了更准确和一致的度量深度,优于现有技术。

📝 摘要(中文)

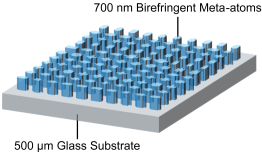

深度基础模型在3D感知方面表现出强大的先验知识,但缺乏物理深度线索,导致度量尺度上的模糊性。本文提出了一种双折射超透镜——一种由亚波长像素组成的平面纳米光子透镜,用于波前整形,厚度为700纳米,直径为3毫米——以物理方式提示深度基础模型。在单次单目拍摄中,我们的超透镜将深度信息物理地嵌入到两个偏振光波前中,我们通过轻量级的提示和微调框架来解码这些信息,使深度基础模型与光学信号对齐。为了扩展训练数据,我们开发了一种光波传播模拟器,该模拟器从RGB-D数据集中合成超透镜响应,并结合关键物理因素以最小化模拟到真实的差距。使用我们制造的二氧化钛超透镜进行的模拟和物理实验证明了比最先进的单目深度估计器更准确和一致的度量深度。该研究表明,纳米光子波前形成为将深度基础模型植根于物理深度感知提供了一个有希望的桥梁。

🔬 方法详解

问题定义:现有的深度基础模型虽然具备强大的先验知识,但在单目深度估计任务中,由于缺乏直接的物理深度线索,难以准确推断场景的绝对尺度信息,导致估计结果在度量尺度上存在不确定性。现有方法通常依赖大量数据进行学习,但难以克服内在的尺度模糊性问题。

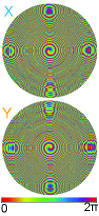

核心思路:论文的核心思路是通过设计一种特殊的纳米光子器件——双折射超透镜,在物理层面将深度信息编码到光波前中。具体来说,超透镜会将入射光分成两个偏振态,不同的深度对应不同的偏振光分布。通过分析这两个偏振态的光强分布,可以提取出场景的深度信息,从而为深度基础模型提供物理约束。

技术框架:整体框架包含三个主要部分:1) 双折射超透镜的设计与制造,用于对入射光进行波前调制,将深度信息编码到两个偏振态的光波中。2) 轻量级的提示和微调框架,用于将深度基础模型与超透镜的光学信号对齐。该框架接收两个偏振图像作为输入,并输出深度估计结果。3) 光波传播模拟器,用于生成大规模的训练数据,以弥合模拟环境和真实环境之间的差距。该模拟器考虑了超透镜的物理特性和光波传播过程。

关键创新:该论文的关键创新在于将纳米光子学与深度学习相结合,利用超透镜在物理层面嵌入深度信息,从而克服了传统单目深度估计方法的尺度模糊性问题。与现有方法相比,该方法不需要复杂的后处理或额外的传感器,仅通过单次拍摄即可获得准确的度量深度。

关键设计:超透镜采用二氧化钛材料,厚度为700纳米,直径为3毫米。其表面刻蚀有亚波长尺度的纳米结构,用于实现对不同偏振态光线的独立调控。光波传播模拟器考虑了超透镜的衍射效应、材料色散和偏振特性。在训练过程中,使用了RGB-D数据集,并设计了专门的损失函数,以确保深度基础模型能够准确地从偏振图像中提取深度信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在模拟和真实场景中均能实现准确的度量深度估计,优于现有的单目深度估计方法。具体而言,在真实场景中,该方法能够显著降低深度估计的误差,并提高深度一致性。与state-of-the-art方法相比,该方法在深度估计精度上取得了显著提升。

🎯 应用场景

该研究成果可应用于机器人导航、增强现实、自动驾驶等领域。通过提供准确的单目深度估计,可以提升机器人对环境的感知能力,改善AR/VR的沉浸式体验,并增强自动驾驶系统的安全性。此外,该技术还可以应用于医学成像、工业检测等领域,具有广泛的应用前景。

📄 摘要(原文)

Depth foundation models offer strong learned priors for 3D perception but lack physical depth cues, leading to ambiguities in metric scale. We introduce a birefringent metalens -- a planar nanophotonic lens composed of subwavelength pixels for wavefront shaping with a thickness of 700 nm and a diameter of 3 mm -- to physically prompt depth foundation models. In a single monocular shot, our metalens physically embeds depth information into two polarized optical wavefronts, which we decode through a lightweight prompting and fine-tuning framework that aligns depth foundation models with the optical signals. To scale the training data, we develop a light wave propagation simulator that synthesizes metalens responses from RGB-D datasets, incorporating key physical factors to minimize the sim-to-real gap. Simulated and physical experiments with our fabricated titanium-dioxide metalens demonstrate accurate and consistent metric depth over state-of-the-art monocular depth estimators. The research demonstrates that nanophotonic wavefront formation offers a promising bridge for grounding depth foundation models in physical depth sensing.