The Change You Want To Detect: Semantic Change Detection In Earth Observation With Hybrid Data Generation

作者: Yanis Benidir, Nicolas Gonthier, Clement Mallet

分类: cs.CV

发布日期: 2025-03-19 (更新: 2025-04-04)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出HySCDG混合数据生成流程,用于提升遥感图像语义变化检测性能

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 遥感图像 变化检测 语义分割 数据生成 混合数据集

📋 核心要点

- 现有基于高分辨率遥感图像的变化检测方法,要么需要大量标注数据,要么仅限于特定数据集,缺乏时空适应性。

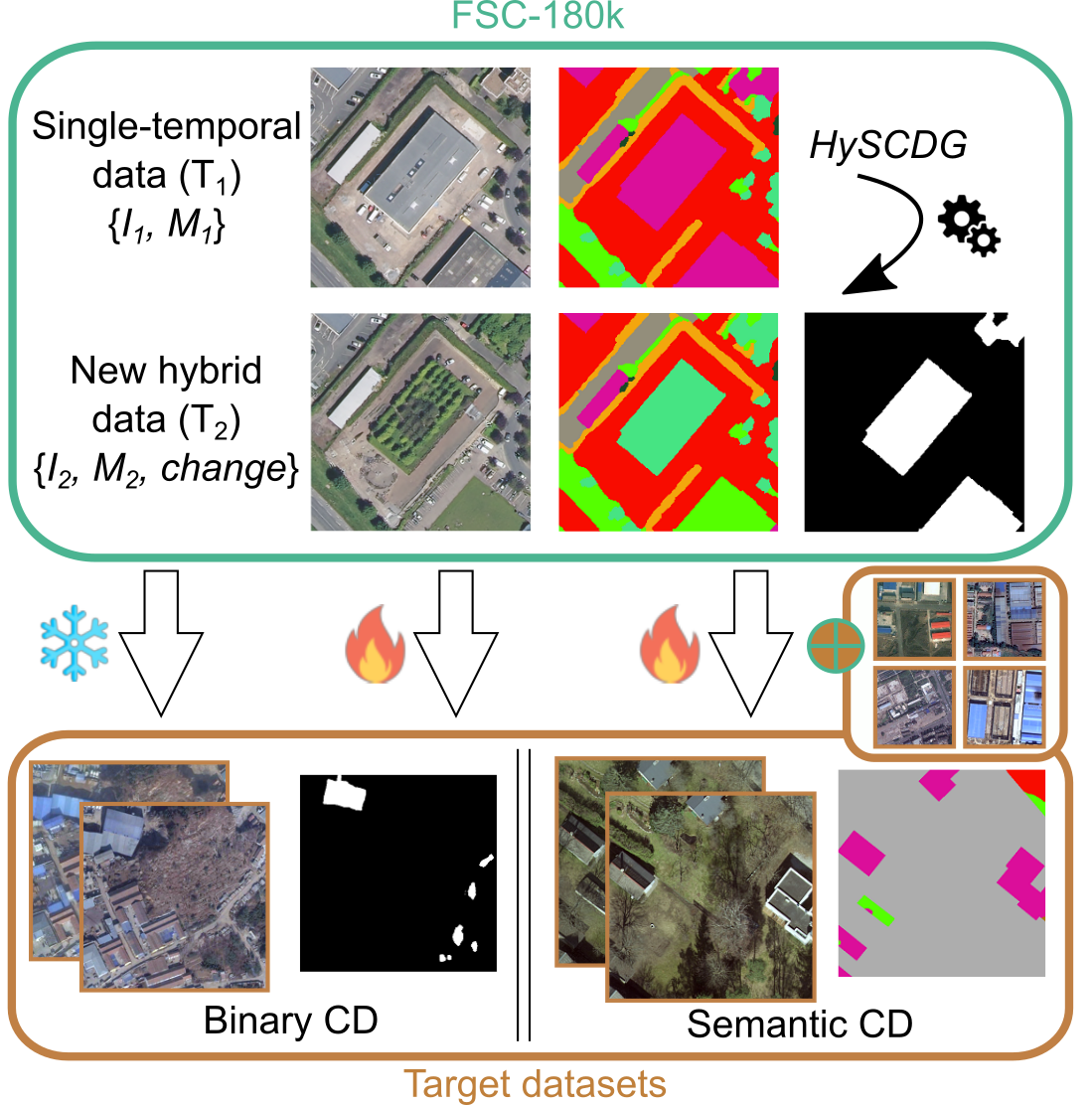

- 论文提出HySCDG,一种混合数据生成流程,结合真实遥感图像和修复图像,生成大规模、逼真的语义变化检测数据集。

- 实验表明,使用HySCDG生成的数据集进行预训练,在多种变化检测任务中均显著优于现有合成数据集,提升了模型性能。

📝 摘要(中文)

本文提出了一种名为HySCDG的生成流程,用于创建大规模混合语义变化检测数据集,该数据集包含真实的高分辨率遥感图像和修复图像,以及两个时间点的土地覆盖语义图和变化图。HySCDG在语义和空间上进行引导,生成逼真的图像,从而产生一个全面的、可迁移的混合数据集FSC-180k。我们在五个变化检测案例(二元和语义)上评估了FSC-180k,从零样本到混合和顺序训练,以及低数据量训练。实验表明,在我们的混合数据集上进行预训练可以显著提高性能,在各种配置中优于完全合成的数据集SyntheWorld。所有代码、模型和数据均已公开。

🔬 方法详解

问题定义:现有基于甚高分辨率(VHR)图像的大规模双时相变化检测方法面临挑战。语义变化检测需要大量标注数据,而现有方法在时空适应性方面存在局限性,无法很好地泛化到不同的地理区域和时间跨度。此外,现有方法在架构设计和预训练数据集方面缺乏通用性,难以适应复杂多样的场景。

核心思路:论文的核心思路是利用混合数据生成方法,结合真实遥感图像和修复图像,生成大规模、逼真的语义变化检测数据集。通过在语义和空间上引导图像生成过程,提高生成图像的真实感和多样性,从而提升模型在真实场景中的泛化能力。

技术框架:HySCDG流程包含以下主要模块:1) 真实VHR图像收集;2) 语义地图生成(包括两个时间点);3) 变化图生成;4) 图像修复(inpainting),用于增强数据集的多样性;5) 数据集整合,生成最终的混合数据集FSC-180k。该数据集包含真实图像、修复图像、语义地图和变化图。

关键创新:HySCDG的关键创新在于其混合数据生成策略,它结合了真实图像和修复图像,并利用语义信息进行引导。这种方法能够生成更逼真、更具多样性的合成数据,从而有效提升模型在真实场景中的性能。与完全合成的数据集相比,HySCDG生成的混合数据集更接近真实遥感图像的分布。

关键设计:HySCDG流程中的关键设计包括:1) 语义引导的图像修复,利用语义地图作为先验信息,提高修复图像的真实感;2) 空间引导的图像生成,考虑空间上下文信息,生成与周围环境一致的图像;3) 数据增强策略,通过随机裁剪、旋转等方式,增加数据集的多样性。损失函数方面,可能使用了对抗损失、像素级损失等,以保证生成图像的质量。网络结构方面,可能使用了生成对抗网络(GAN)或变分自编码器(VAE)等生成模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在FSC-180k数据集上预训练的模型在各种变化检测任务中均优于在SyntheWorld数据集上预训练的模型。例如,在零样本学习场景下,使用FSC-180k预训练的模型性能提升显著。即使在低数据量训练的情况下,FSC-180k也能提供有效的预训练,提升模型性能。

🎯 应用场景

该研究成果可应用于多种遥感图像变化检测场景,例如城市扩张监测、森林砍伐监测、自然灾害评估等。通过使用HySCDG生成的数据集进行预训练,可以显著提升变化检测模型的性能,减少对大量标注数据的依赖,降低人工标注成本。该方法具有广泛的应用前景,有助于实现更高效、更准确的地球观测。

📄 摘要(原文)

Bi-temporal change detection at scale based on Very High Resolution (VHR) images is crucial for Earth monitoring. This remains poorly addressed so far: methods either require large volumes of annotated data (semantic case), or are limited to restricted datasets (binary set-ups). Most approaches do not exhibit the versatility required for temporal and spatial adaptation: simplicity in architecture design and pretraining on realistic and comprehensive datasets. Synthetic datasets are the key solution but still fail to handle complex and diverse scenes. In this paper, we present HySCDG a generative pipeline for creating a large hybrid semantic change detection dataset that contains both real VHR images and inpainted ones, along with land cover semantic map at both dates and the change map. Being semantically and spatially guided, HySCDG generates realistic images, leading to a comprehensive and hybrid transfer-proof dataset FSC-180k. We evaluate FSC-180k on five change detection cases (binary and semantic), from zero-shot to mixed and sequential training, and also under low data regime training. Experiments demonstrate that pretraining on our hybrid dataset leads to a significant performance boost, outperforming SyntheWorld, a fully synthetic dataset, in every configuration. All codes, models, and data are available here: https://yb23.github.io/projects/cywd/