These Magic Moments: Differentiable Uncertainty Quantification of Radiance Field Models

作者: Parker Ewen, Hao Chen, Seth Isaacson, Joey Wilson, Katherine A. Skinner, Ram Vasudevan

分类: cs.CV, cs.RO

发布日期: 2025-03-18 (更新: 2025-03-20)

💡 一句话要点

提出基于高阶矩的辐射场不确定性量化方法,提升下游任务性能。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 辐射场 不确定性量化 高阶矩 神经渲染 视角规划 主动光线采样 可微渲染

📋 核心要点

- 现有辐射场不确定性量化方法在高维和复杂场景中面临计算效率和可微性挑战,限制了其在实时决策任务中的应用。

- 该论文利用渲染过程的概率特性,通过计算辐射场输出的高阶矩,实现了高效且可微的不确定性量化。

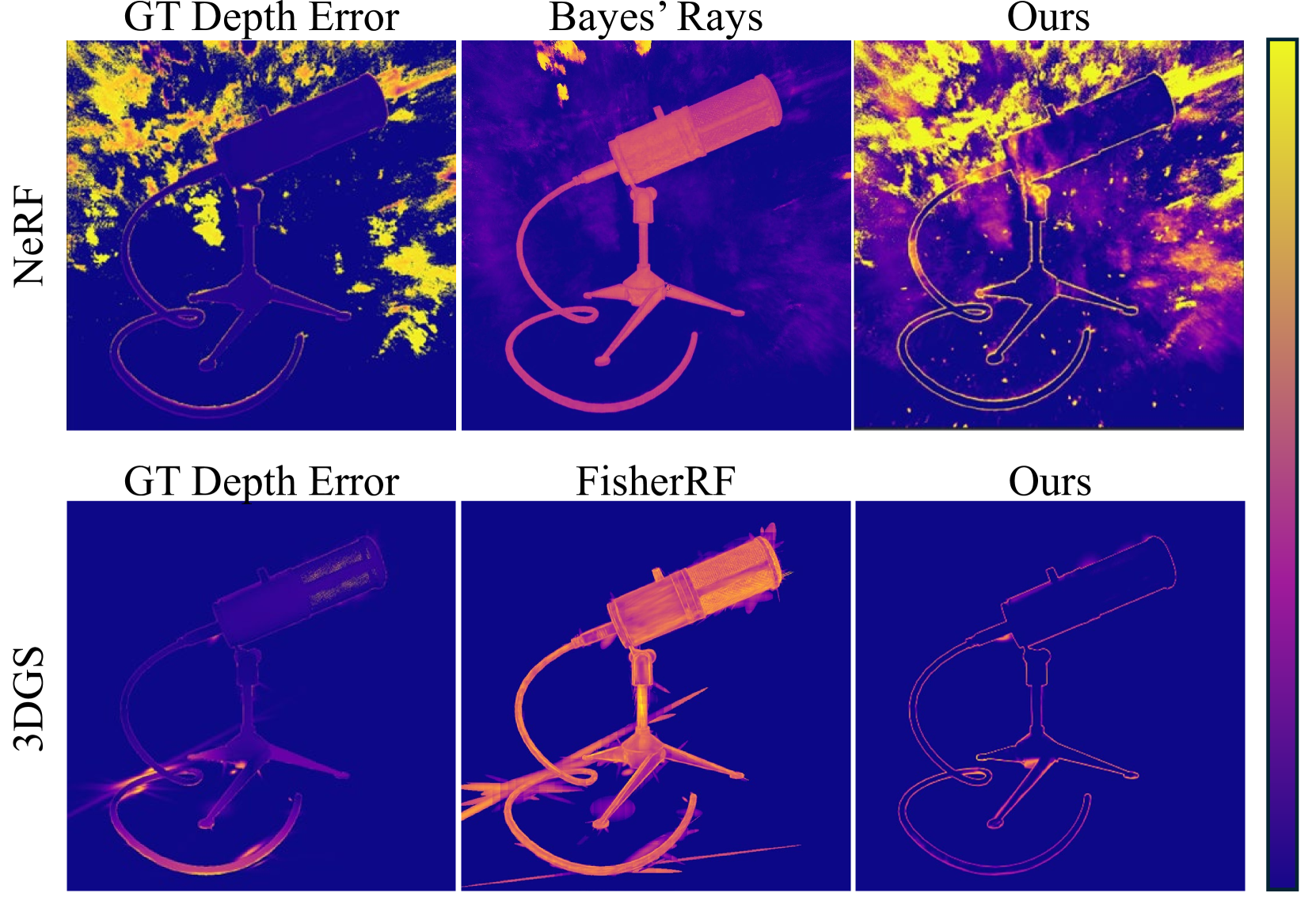

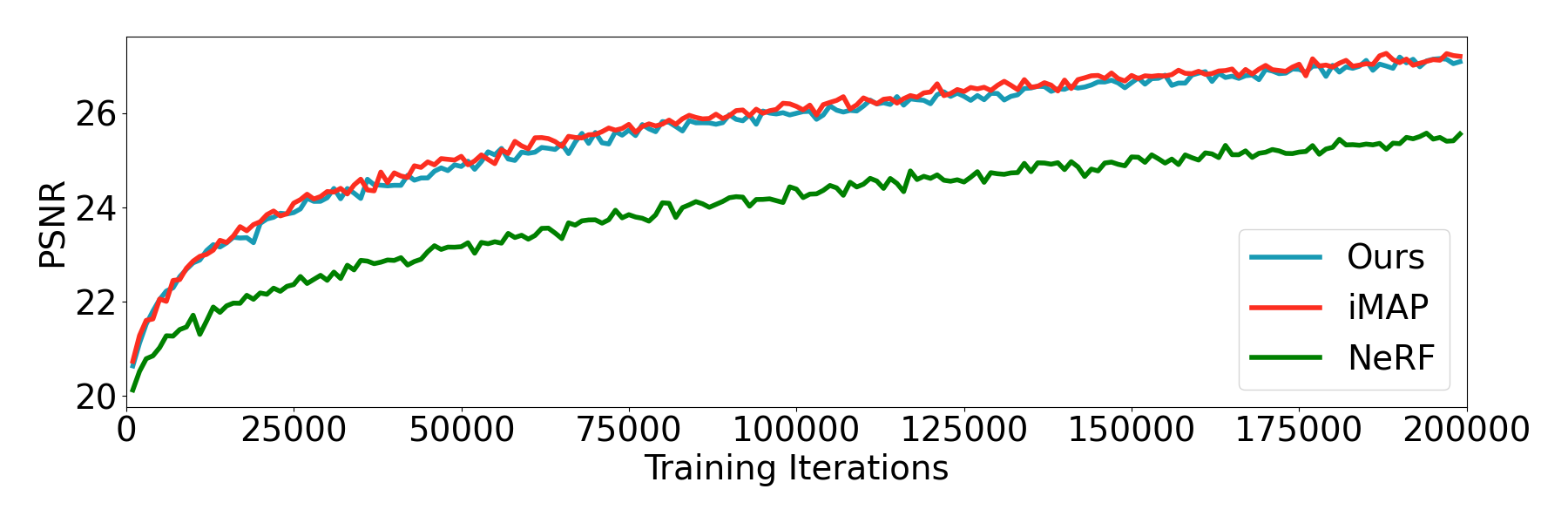

- 实验表明,该方法在不确定性估计方面优于现有技术,并在最佳视角选择和主动光线采样等下游任务中表现出色。

📝 摘要(中文)

本文提出了一种新颖的辐射场不确定性量化方法,该方法利用渲染方程的高阶矩。不确定性量化对于下游任务至关重要,包括视角规划和场景理解,在这些任务中,安全性和鲁棒性至关重要。然而,辐射场的高维度和复杂性对不确定性量化提出了重大挑战,限制了这些不确定性量化方法在高速决策中的应用。我们证明了渲染过程的概率性质能够高效且可微地计算辐射场输出(包括颜色、深度和语义预测)的高阶矩。我们的方法优于现有的辐射场不确定性估计技术,同时提供了一种更直接、计算效率更高且可微的公式,无需后处理。除了不确定性量化之外,我们还展示了我们的方法在下游应用中的效用,例如最佳视角选择(NBV)和用于神经辐射场训练的主动光线采样。在合成和真实场景上的大量实验证实了我们方法的有效性,该方法在保持简单性的同时实现了最先进的性能。

🔬 方法详解

问题定义:现有辐射场的不确定性量化方法,由于辐射场本身的高维度和复杂性,通常计算量大,难以进行端到端优化,并且难以直接应用于需要快速决策的下游任务,例如机器人导航中的视角规划。这些方法通常需要复杂的后处理步骤,进一步增加了计算负担。

核心思路:该论文的核心思路是利用渲染方程的概率特性,将辐射场的渲染过程视为一个概率过程。通过计算渲染输出(如颜色、深度等)的高阶矩(例如方差),可以直接量化辐射场的不确定性。这种方法避免了复杂的采样或近似计算,并且由于矩的计算是可微的,因此可以方便地集成到端到端训练流程中。

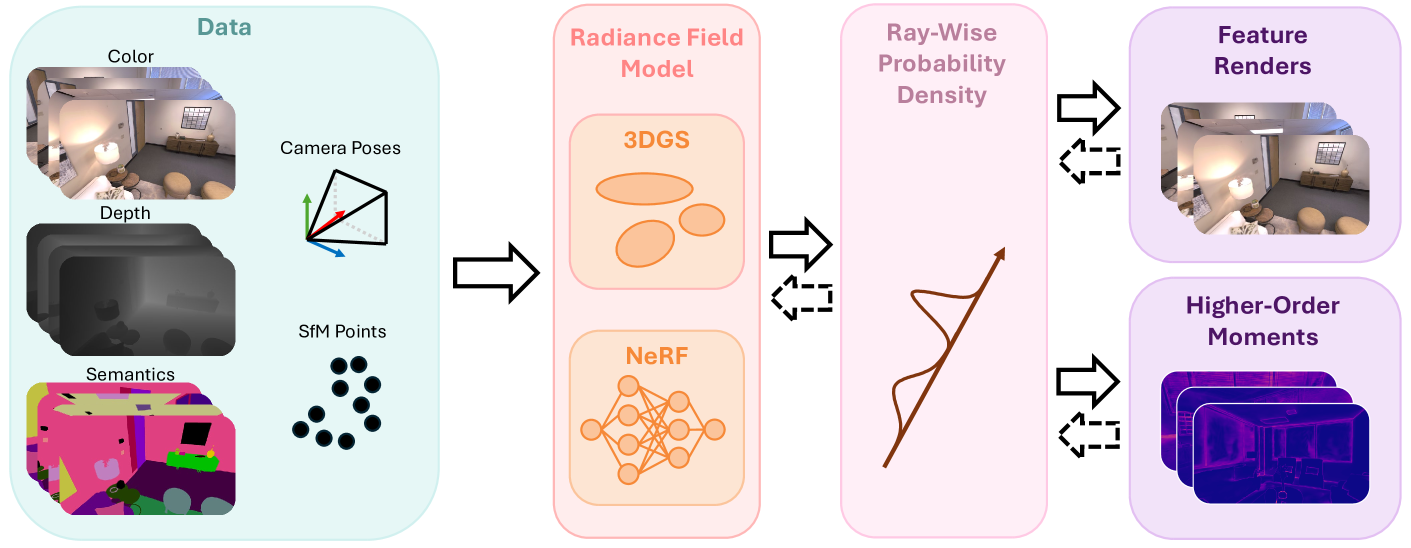

技术框架:该方法主要包含以下几个阶段:1)辐射场的表示:使用神经辐射场(NeRF)或其他辐射场表示方法来建模场景。2)渲染方程的概率建模:将渲染过程建模为一个概率过程,其中辐射场的输出(颜色、深度等)是随机变量。3)高阶矩的计算:利用渲染方程,计算辐射场输出的高阶矩,例如均值和方差。这些矩可以直接反映辐射场的不确定性。4)下游任务的应用:将计算得到的不确定性信息应用于下游任务,例如最佳视角选择(NBV)和主动光线采样。

关键创新:该论文的关键创新在于提出了一种基于高阶矩的辐射场不确定性量化方法。与现有方法相比,该方法具有以下优势:1)计算效率更高:直接计算高阶矩,避免了复杂的采样或近似计算。2)可微性:矩的计算是可微的,可以方便地集成到端到端训练流程中。3)无需后处理:直接得到不确定性估计,无需额外的后处理步骤。

关键设计:该方法的关键设计包括:1)选择合适的高阶矩:通常选择方差作为不确定性的度量。2)设计可微的矩计算方法:利用自动微分技术,实现高阶矩的可微计算。3)设计合适的损失函数:在下游任务中,设计合适的损失函数,利用不确定性信息来指导模型的训练。

🖼️ 关键图片

📊 实验亮点

该方法在合成和真实场景上进行了大量实验,结果表明该方法在不确定性估计方面优于现有的辐射场不确定性估计技术。此外,该方法在最佳视角选择(NBV)和主动光线采样等下游任务中也取得了显著的性能提升,验证了该方法的有效性和实用性。具体性能数据未知,但论文强调了其方法在保持简单性的同时实现了最先进的性能。

🎯 应用场景

该研究成果可广泛应用于机器人导航、自动驾驶、三维重建等领域。通过量化辐射场的不确定性,可以提高下游任务的安全性、鲁棒性和效率。例如,在机器人导航中,可以利用不确定性信息来选择最佳视角,避免碰撞;在自动驾驶中,可以利用不确定性信息来评估感知结果的可靠性,提高决策的准确性。

📄 摘要(原文)

This paper introduces a novel approach to uncertainty quantification for radiance fields by leveraging higher-order moments of the rendering equation. Uncertainty quantification is crucial for downstream tasks including view planning and scene understanding, where safety and robustness are paramount. However, the high dimensionality and complexity of radiance fields pose significant challenges for uncertainty quantification, limiting the use of these uncertainty quantification methods in high-speed decision-making. We demonstrate that the probabilistic nature of the rendering process enables efficient and differentiable computation of higher-order moments for radiance field outputs, including color, depth, and semantic predictions. Our method outperforms existing radiance field uncertainty estimation techniques while offering a more direct, computationally efficient, and differentiable formulation without the need for post-processing. Beyond uncertainty quantification, we also illustrate the utility of our approach in downstream applications such as next-best-view (NBV) selection and active ray sampling for neural radiance field training. Extensive experiments on synthetic and real-world scenes confirm the efficacy of our approach, which achieves state-of-the-art performance while maintaining simplicity.