MusicInfuser: Making Video Diffusion Listen and Dance

作者: Susung Hong, Ira Kemelmacher-Shlizerman, Brian Curless, Steven M. Seitz

分类: cs.CV, cs.AI, cs.LG

发布日期: 2025-03-18 (更新: 2025-12-13)

备注: Project page: https://susunghong.github.io/MusicInfuser

💡 一句话要点

MusicInfuser:使视频扩散模型能够“听”音乐并生成舞蹈视频

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频生成 扩散模型 音乐同步 舞蹈视频 多模态学习

📋 核心要点

- 现有方法难以有效利用预训练视频扩散模型生成与音乐同步的舞蹈视频,需要从头训练多模态模型。

- MusicInfuser通过选择性地调整预训练视频扩散模型的特定层,使其能够根据音乐输入生成同步舞蹈视频。

- 实验表明,MusicInfuser在生成与音乐同步的舞蹈视频方面表现出色,且泛化能力强,训练成本低。

📝 摘要(中文)

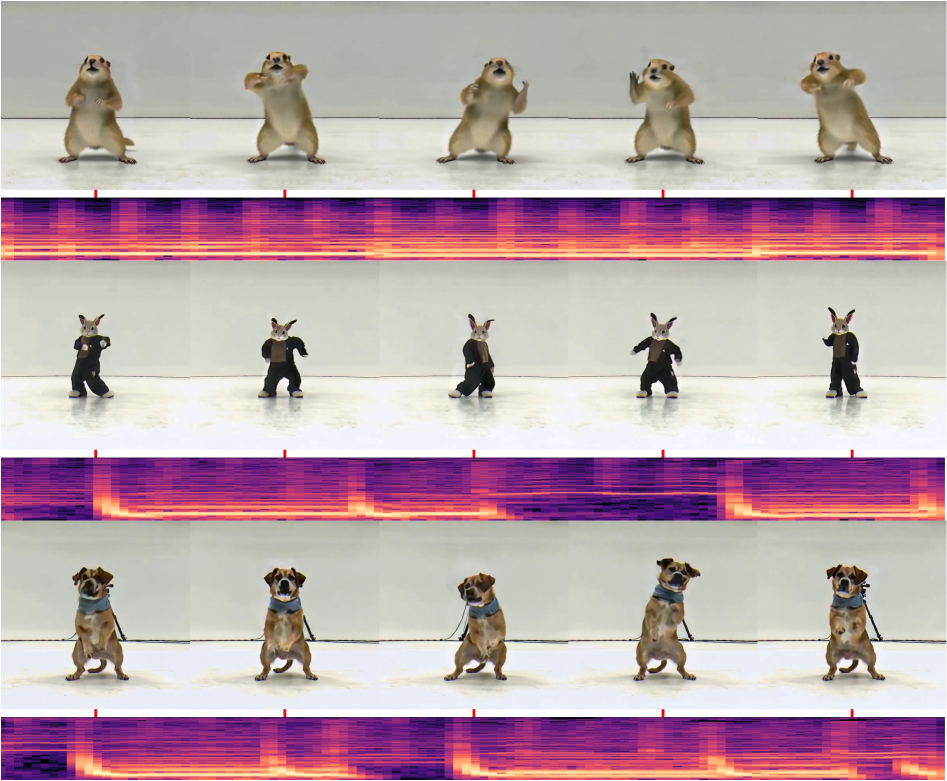

本文提出MusicInfuser,一种将预训练的文本到视频扩散模型与特定音乐轨道对齐,以生成高质量同步舞蹈视频的方法。该方法没有从头开始训练多模态音频-视频或音频-运动模型,而是展示了如何有效地调整现有的视频扩散模型以适应音乐输入。我们提出了一种新颖的、基于层级适应性标准的构造性影响函数,该函数受到引导的启发,用于选择可适应的层,从而显著降低训练成本,同时保留丰富的先验知识,即使在有限的专业数据集上也是如此。实验表明,MusicInfuser有效地弥合了音乐和视频之间的差距,生成新颖多样的舞蹈动作,这些动作能够动态地响应音乐。此外,我们的框架可以很好地推广到未见过的音乐轨道、更长的视频序列和非常规主题,在一致性和同步性方面优于基线模型。所有这些都是在不需要运动数据的情况下实现的,并且训练可以在单个GPU上在一天内完成。

🔬 方法详解

问题定义:现有方法在生成与音乐同步的舞蹈视频时,通常需要从头开始训练多模态模型,这需要大量的计算资源和数据。此外,这些方法难以充分利用预训练视频扩散模型中蕴含的丰富先验知识。因此,如何高效地将预训练的视频扩散模型与音乐对齐,生成高质量的舞蹈视频是一个关键问题。

核心思路:MusicInfuser的核心思路是,并非所有层都对音乐信息的融合同样重要。通过选择性地调整预训练视频扩散模型中对音乐适应性强的层,可以显著降低训练成本,同时保留模型原有的生成能力。这种方法避免了从头开始训练模型的需要,并能够利用预训练模型中已有的知识。

技术框架:MusicInfuser的整体框架包括以下几个主要步骤:1) 选择预训练的文本到视频扩散模型作为基础模型。2) 使用一个新颖的层级适应性标准,基于构造性影响函数,选择模型中对音乐适应性强的层。3) 使用音乐数据对选定的层进行微调,使其能够根据音乐输入生成同步的舞蹈视频。4) 将微调后的模型用于生成新的舞蹈视频。

关键创新:MusicInfuser的关键创新在于提出了一种新颖的层级适应性标准,用于选择预训练视频扩散模型中对音乐适应性强的层。该标准基于构造性影响函数,能够有效地评估不同层对音乐信息的响应程度,从而实现选择性地调整模型。这种方法与现有方法相比,能够显著降低训练成本,并保留模型原有的生成能力。

关键设计:MusicInfuser的关键设计包括:1) 使用预训练的文本到视频扩散模型作为基础模型,以利用其强大的生成能力。2) 提出基于构造性影响函数的层级适应性标准,用于选择模型中对音乐适应性强的层。3) 使用专门的舞蹈数据集对选定的层进行微调,以提高模型生成舞蹈视频的质量。4) 使用合适的损失函数来优化模型的参数,例如,可以使用对抗损失函数来提高生成视频的真实感。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MusicInfuser在生成与音乐同步的舞蹈视频方面表现出色,能够生成新颖多样的舞蹈动作,并且能够很好地推广到未见过的音乐轨道、更长的视频序列和非常规主题。与基线模型相比,MusicInfuser在一致性和同步性方面均有显著提升。此外,MusicInfuser的训练成本较低,可以在单个GPU上在一天内完成。

🎯 应用场景

MusicInfuser具有广泛的应用前景,例如:1) 自动生成舞蹈视频,为音乐创作提供视觉内容。2) 个性化舞蹈教学,根据用户的音乐偏好生成定制化的舞蹈动作。3) 虚拟人物表演,使虚拟人物能够根据音乐进行舞蹈表演。4) 游戏开发,为游戏角色设计与音乐同步的舞蹈动作。该研究有望推动音乐与视频内容的融合,并为相关领域带来新的发展机遇。

📄 摘要(原文)

We introduce MusicInfuser, an approach that aligns pre-trained text-to-video diffusion models to generate high-quality dance videos synchronized with specified music tracks. Rather than training a multimodal audio-video or audio-motion model from scratch, our method demonstrates how existing video diffusion models can be efficiently adapted to align with musical inputs. We propose a novel layer-wise adaptability criterion based on a guidance-inspired constructive influence function to select adaptable layers, significantly reducing training costs while preserving rich prior knowledge, even with limited, specialized datasets. Experiments show that MusicInfuser effectively bridges the gap between music and video, generating novel and diverse dance movements that respond dynamically to music. Furthermore, our framework generalizes well to unseen music tracks, longer video sequences, and unconventional subjects, outperforming baseline models in consistency and synchronization. All of this is achieved without requiring motion data, with training completed on a single GPU within a day.