Comp-Attn: Present-and-Align Attention for Compositional Video Generation

作者: Hongyu Zhang, Yufan Deng, Shenghai Yuan, Yian Zhao, Peng Jin, Xuehan Hou, Chang Liu, Jie Chen

分类: cs.CV, cs.AI

发布日期: 2025-03-18 (更新: 2025-12-21)

💡 一句话要点

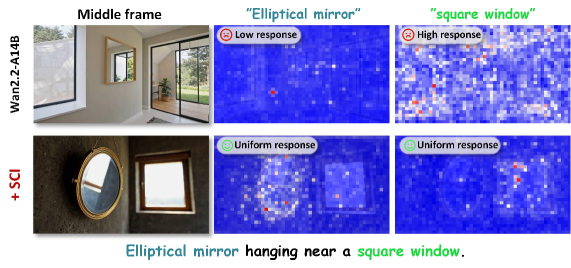

提出Comp-Attn,通过Present-and-Align注意力机制解决组合视频生成中的主体呈现和关系对齐问题。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 文本到视频生成 组合视频生成 注意力机制 主体关系建模 条件插值

📋 核心要点

- 现有文本到视频生成方法难以同时解决组合视频中主体呈现不完整和主体间关系错位的问题。

- Comp-Attn通过Present-and-Align范式,在条件层面保证主体呈现,在注意力层面实现关系对齐。

- 实验表明,Comp-Attn显著提升了组合视频生成的质量,并在多个数据集上取得了SOTA结果。

📝 摘要(中文)

本文针对文本到视频(T2V)生成中,合成包含多个主体和复杂关系的组合内容这一未被充分探索的领域,提出了Comp-Attn方法。该方法遵循Present-and-Align范式,通过在条件层面强制主体呈现,在注意力分布层面实现关系对齐,从而解耦了主体呈现和主体间关系这两个挑战。具体来说,引入了主体感知条件插值(SCI)来增强主体特定的条件,确保每个主体的呈现;提出了布局强制注意力调制(LAM),动态地强制注意力分布与多个主体的关系布局对齐。Comp-Attn可以无缝集成到各种T2V基线中,在Wan2.1-T2V-14B和Wan2.2-T2V-A14B上,T2V-CompBench分数分别提高了15.7%和11.7%,且推理时间仅增加5%。同时,在VBench和T2I-CompBench上也取得了良好的性能,证明了其在通用视频生成和组合文本到图像(T2I)任务中的可扩展性。

🔬 方法详解

问题定义:论文旨在解决文本到视频生成任务中,合成包含多个主体及其复杂关系的组合视频时,主体可能未完全呈现,以及主体间的交互和空间关系无法正确对齐的问题。现有方法如推理时潜在优化或布局控制,无法同时解决这两个问题,导致生成视频的质量下降。

核心思路:论文的核心思路是将主体呈现和关系对齐这两个问题解耦。首先,通过增强主体特定的条件来确保每个主体都出现在视频中。然后,通过动态调整注意力分布,使其与主体间的关系布局对齐,从而实现主体间的正确交互。这种Present-and-Align的范式使得模型能够更好地理解和生成组合视频。

技术框架:Comp-Attn可以无缝集成到现有的文本到视频生成模型中。其主要包含两个模块:主体感知条件插值(SCI)和布局强制注意力调制(LAM)。SCI模块用于增强主体特定的条件,确保每个主体都得到充分的表达。LAM模块则用于动态调整注意力分布,使其与主体间的关系布局对齐。整个框架在训练时无需额外训练,可以直接应用于已有的模型。

关键创新:Comp-Attn的关键创新在于提出了Present-and-Align的范式,将主体呈现和关系对齐这两个问题解耦。通过SCI和LAM两个模块,分别解决了这两个问题。与现有方法相比,Comp-Attn能够更有效地生成包含多个主体及其复杂关系的组合视频。

关键设计:SCI模块通过插值的方式增强主体特定的条件,插值系数可以根据主体的相关性进行调整。LAM模块通过动态调整注意力权重,使得模型更加关注主体间的关系。具体的注意力调制方式可以根据不同的布局信息进行设计。此外,Comp-Attn可以灵活地应用于不同的文本到视频生成模型,具有良好的通用性。

🖼️ 关键图片

📊 实验亮点

Comp-Attn在T2V-CompBench数据集上取得了显著的性能提升,在Wan2.1-T2V-14B和Wan2.2-T2V-A14B上分别提高了15.7%和11.7%,且推理时间仅增加5%。同时,在VBench和T2I-CompBench上也取得了良好的性能,证明了其在通用视频生成和组合文本到图像任务中的有效性。

🎯 应用场景

该研究成果可广泛应用于视频内容创作、游戏开发、虚拟现实等领域。例如,用户可以通过文本描述生成包含多个角色及其交互的动画短片,或者在虚拟现实环境中创建具有复杂关系的虚拟场景。该技术有助于降低视频创作的门槛,并提升用户体验。

📄 摘要(原文)

In the domain of text-to-video (T2V) generation, reliably synthesizing compositional content involving multiple subjects with intricate relations is still underexplored. The main challenges are twofold: 1) Subject presence, where not all subjects can be presented in the video; 2) Inter-subject relations, where the interaction and spatial relationship between subjects are misaligned. Existing methods adopt techniques, such as inference-time latent optimization or layout control, which fail to address both issues simultaneously. To tackle these problems, we propose Comp-Attn, a composition-aware cross-attention variant that follows a Present-and-Align paradigm: it decouples the two challenges by enforcing subject presence at the condition level and achieving relational alignment at the attention-distribution level. Specifically, 1) We introduce Subject-aware Condition Interpolation (SCI) to reinforce subject-specific conditions and ensure each subject's presence; 2) We propose Layout-forcing Attention Modulation (LAM), which dynamically enforces the attention distribution to align with the relational layout of multiple subjects. Comp-Attn can be seamlessly integrated into various T2V baselines in a training-free manner, boosting T2V-CompBench scores by 15.7\% and 11.7\% on Wan2.1-T2V-14B and Wan2.2-T2V-A14B with only a 5\% increase in inference time. Meanwhile, it also achieves strong performance on VBench and T2I-CompBench, demonstrating its scalability in general video generation and compositional text-to-image (T2I) tasks.