LIAM: Multimodal Transformer for Language Instructions, Images, Actions and Semantic Maps

作者: Yihao Wang, Raphael Memmesheimer, Sven Behnke

分类: cs.CV, cs.AI, cs.RO

发布日期: 2025-03-15 (更新: 2025-10-06)

备注: 12 pages, 4 figures, 2 tables, 19th International Conference on Intelligent Autonomous Systems (IAS), Genoa, Italy, June 2025

💡 一句话要点

LIAM:用于语言指令、图像、动作和语义地图的多模态Transformer,提升家务机器人任务执行能力。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 Transformer 家务机器人 语义地图 语言指令 图像理解 动作规划

📋 核心要点

- 现有家务机器人任务执行方法缺乏灵活性,需要针对每个任务单独编程,难以应对家庭环境的多样性。

- LIAM模型通过多模态Transformer,融合语言指令、图像、历史动作和语义地图信息,预测机器人执行动作序列。

- 实验结果表明,预对齐不同模态特征空间以及利用语义地图能显著提升家务机器人在ALFRED数据集上的任务完成度。

📝 摘要(中文)

本文提出LIAM,一个端到端模型,它基于语言、图像、动作和地图输入来预测动作序列,旨在提升家务机器人的灵活性。该模型利用大型语言模型和开放词汇对象感知方法,无需为每个家务任务单独编程。语言和图像输入通过CLIP骨干网络进行编码,并设计了两个预训练任务来微调其权重并预对齐潜在空间。在ALFRED数据集上的评估结果表明,预对齐不同模态的嵌入空间以及整合语义地图的有效性。

🔬 方法详解

问题定义:现有家务机器人任务执行方法通常需要针对特定任务进行单独编程,难以适应家庭环境的复杂性和多样性。痛点在于缺乏一种通用的、能够理解自然语言指令并结合环境信息来完成任务的端到端模型。

核心思路:论文的核心思路是利用多模态Transformer模型,将语言指令、图像、历史动作和语义地图信息融合在一起,从而使机器人能够理解任务目标,并根据环境信息规划出合理的动作序列。通过预训练对齐不同模态的特征空间,提升模型对多模态信息的理解能力。

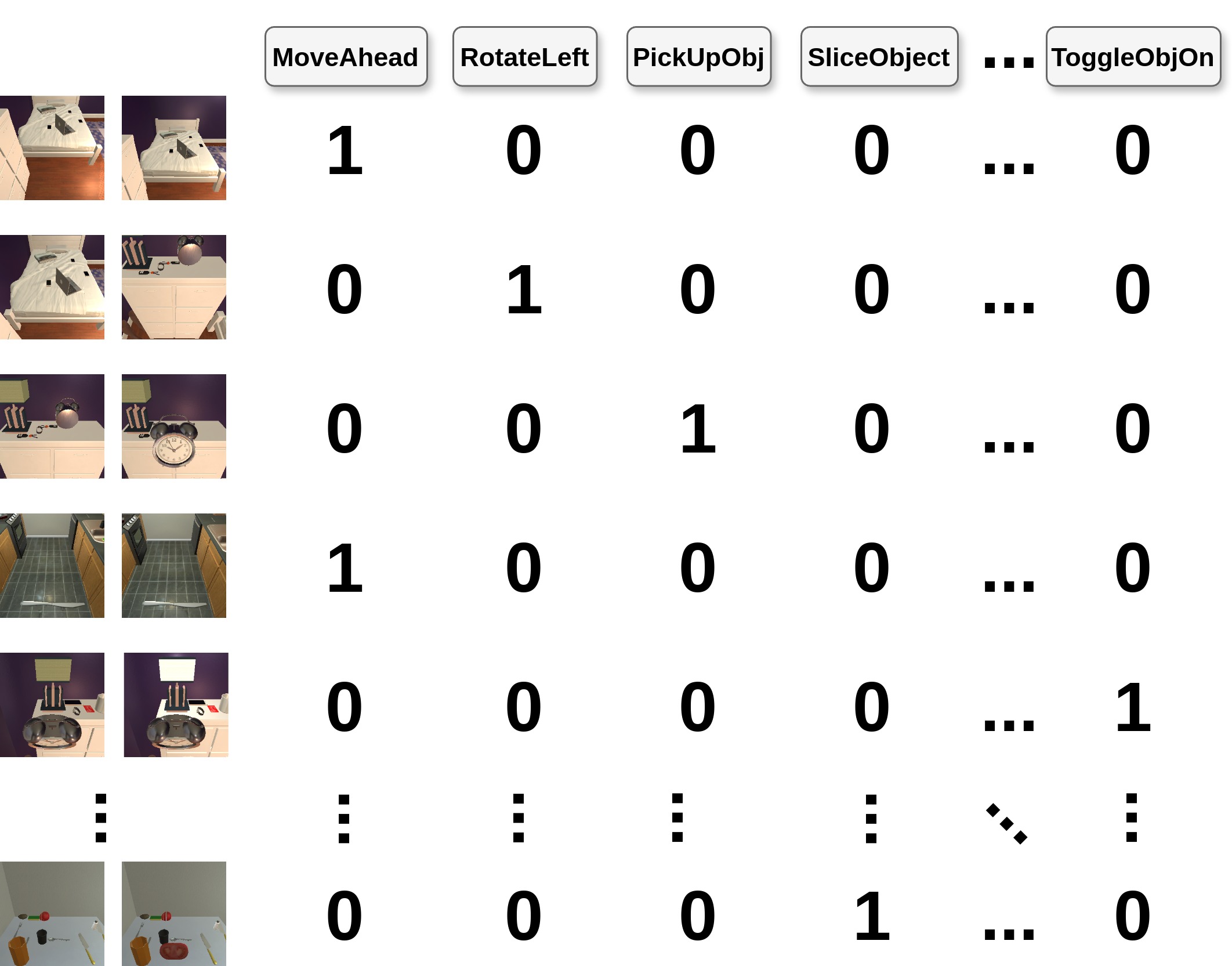

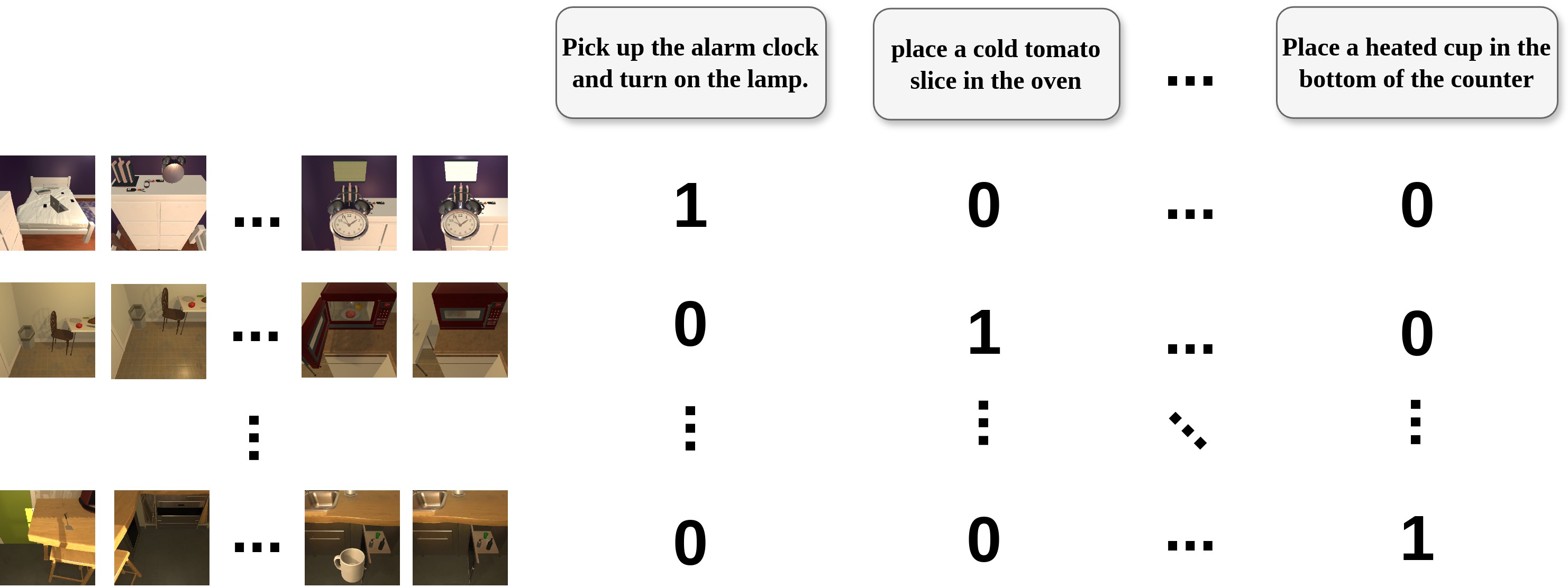

技术框架:LIAM模型的整体框架包括以下几个主要模块:1) CLIP编码器:用于编码语言指令和图像信息。2) 动作嵌入层:用于嵌入历史动作信息。3) 语义地图编码器:用于编码环境的语义地图信息。4) 多模态Transformer:融合来自不同模态的信息,并预测动作序列。模型采用端到端的训练方式,直接从多模态输入到动作序列输出。

关键创新:最重要的技术创新点在于多模态特征空间的预对齐以及语义地图的有效利用。通过设计特定的预训练任务,使得CLIP编码器能够更好地对齐语言和图像的特征空间,从而提升模型对多模态信息的理解能力。同时,将语义地图作为环境信息的重要来源,能够帮助机器人更好地理解环境,并规划出更合理的动作序列。

关键设计:论文设计了两个预训练任务来微调CLIP骨干网络的权重并预对齐潜在空间。具体细节未知。此外,模型使用了Transformer架构来融合多模态信息,并预测动作序列。损失函数未知。

🖼️ 关键图片

📊 实验亮点

论文在ALFRED数据集上进行了实验,结果表明,通过预对齐不同模态的嵌入空间以及整合语义地图,LIAM模型能够显著提升家务机器人的任务完成度。具体的性能数据和对比基线未知,但论文强调了预对齐和语义地图的重要性。

🎯 应用场景

该研究成果可应用于各种家务服务机器人,例如清洁机器人、烹饪机器人和照护机器人。通过理解自然语言指令和感知环境信息,机器人能够更智能、更自主地完成各种家务任务,从而提高人们的生活质量。未来,该技术还可以扩展到其他领域,例如工业自动化、医疗辅助等。

📄 摘要(原文)

The availability of large language models and open-vocabulary object perception methods enables more flexibility for domestic service robots. The large variability of domestic tasks can be addressed without implementing each task individually by providing the robot with a task description along with appropriate environment information. In this work, we propose LIAM - an end-to-end model that predicts action transcripts based on language, image, action, and map inputs. Language and image inputs are encoded with a CLIP backbone, for which we designed two pre-training tasks to fine-tune its weights and pre-align the latent spaces. We evaluate our method on the ALFRED dataset, a simulator-generated benchmark for domestic tasks. Our results demonstrate the importance of pre-aligning embedding spaces from different modalities and the efficacy of incorporating semantic maps.