Cafe-Talk: Generating 3D Talking Face Animation with Multimodal Coarse- and Fine-grained Control

作者: Hejia Chen, Haoxian Zhang, Shoulong Zhang, Xiaoqiang Liu, Sisi Zhuang, Yuan Zhang, Pengfei Wan, Di Zhang, Shuai Li

分类: cs.CV, cs.AI

发布日期: 2025-03-14

备注: Accepted by ICLR'25

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

Cafe-Talk:提出一种多模态粗细粒度控制的3D说话人脸动画生成方法

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D说话人脸动画 多模态控制 扩散模型 Transformer 细粒度控制 动作单元 语音驱动 自然语言控制

📋 核心要点

- 现有语音驱动的3D说话人脸方法缺乏灵活的时空域细粒度面部控制,且通常仅采用离散的情感标签进行全局控制。

- Cafe-Talk模型采用扩散-Transformer架构,通过两阶段训练和交换标签机制,有效解耦语音、粗粒度和细粒度控制条件。

- 实验结果表明,Cafe-Talk在唇形同步和表情表现力方面达到了最先进水平,并在细粒度控制方面获得了用户认可。

📝 摘要(中文)

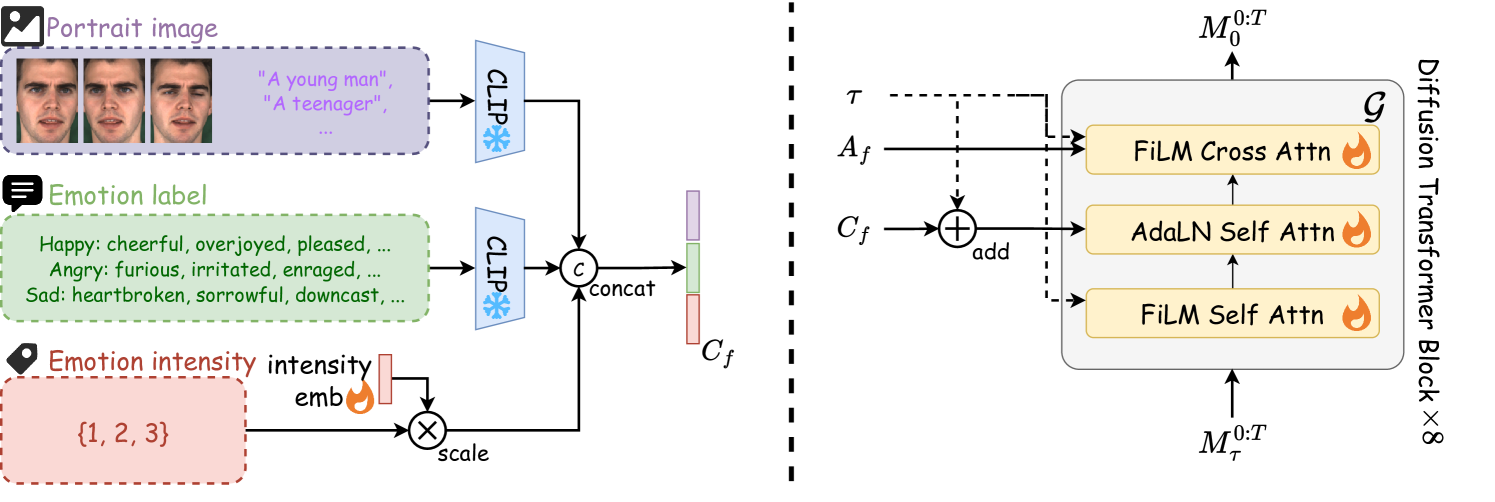

本文提出了一种基于扩散-Transformer的3D说话人脸生成模型Cafe-Talk,该模型同时结合了粗粒度和细粒度的多模态控制条件。为了解耦语音和细粒度条件,采用了两阶段训练流程。Cafe-Talk首先仅使用语音和粗粒度条件进行训练,然后通过提出的细粒度控制适配器逐步添加由动作单元(AUs)表示的细粒度指令,以防止不利的语音-嘴唇同步。为了解耦粗粒度和细粒度条件,设计了一种交换标签训练机制,使细粒度条件占据主导地位。还设计了一种基于掩码的CFG技术来调节细粒度控制的发生和强度。此外,引入了一个基于文本的检测器,通过文本-AU对齐来实现自然语言用户输入,并进一步支持多模态控制。大量实验结果表明,Cafe-Talk实现了最先进的唇形同步和表现力性能,并在用户研究中获得了对细粒度控制的广泛认可。

🔬 方法详解

问题定义:现有语音驱动的3D说话人脸生成方法主要存在两个痛点:一是缺乏在时空域内进行灵活的细粒度面部控制的能力;二是通常使用离散的情感标签来全局控制表情,限制了表情的精细化表达。因此,如何实现既能保证准确的唇形同步,又能实现可控的、细粒度的表情控制,是本文要解决的核心问题。

核心思路:本文的核心思路是设计一个能够同时处理粗粒度和细粒度多模态控制条件的扩散-Transformer模型。为了解决多条件耦合带来的训练难题,采用了两阶段训练策略,并引入了交换标签训练机制和基于掩码的CFG技术,从而实现对不同控制条件的解耦和精细化控制。

技术框架:Cafe-Talk模型主要包含以下几个模块:1) 扩散-Transformer生成器:用于生成3D说话人脸动画;2) 细粒度控制适配器:用于在第二阶段训练中逐步添加细粒度控制信息(AUs);3) 交换标签训练机制:用于解耦粗粒度和细粒度控制条件;4) 基于掩码的CFG技术:用于调节细粒度控制的发生和强度;5) 文本-AU对齐的文本检测器:用于支持自然语言输入,实现更灵活的多模态控制。

关键创新:本文最重要的技术创新点在于提出了一个能够同时处理粗粒度和细粒度多模态控制条件的3D说话人脸生成框架。与现有方法相比,Cafe-Talk不仅能够实现准确的唇形同步,还能够通过细粒度的动作单元(AUs)实现对表情的精细化控制。此外,两阶段训练策略、交换标签训练机制和基于掩码的CFG技术也为解决多条件耦合问题提供了有效的解决方案。

关键设计:在两阶段训练中,第一阶段仅使用语音和粗粒度条件进行训练,第二阶段通过细粒度控制适配器逐步添加AUs信息。交换标签训练机制通过随机交换粗粒度和细粒度标签,强制模型更多地关注细粒度条件。基于掩码的CFG技术通过随机掩盖部分AUs信息,调节细粒度控制的强度。文本-AU对齐的文本检测器利用预训练的语言模型和AU预测模型,将自然语言描述转换为相应的AU序列。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Cafe-Talk在唇形同步和表情表现力方面均达到了最先进水平。用户研究表明,Cafe-Talk在细粒度控制方面获得了广泛认可,能够生成更自然、更具表现力的3D说话人脸动画。项目主页提供了更多实验细节和可视化结果。

🎯 应用场景

Cafe-Talk具有广泛的应用前景,例如虚拟助手、游戏角色动画、在线教育、电影制作等。通过自然语言控制3D人脸表情,可以提升用户交互体验,创造更生动逼真的虚拟形象。该技术还有助于开发更具表现力的虚拟化身,并为远程交流带来更丰富的表达方式。

📄 摘要(原文)

Speech-driven 3D talking face method should offer both accurate lip synchronization and controllable expressions. Previous methods solely adopt discrete emotion labels to globally control expressions throughout sequences while limiting flexible fine-grained facial control within the spatiotemporal domain. We propose a diffusion-transformer-based 3D talking face generation model, Cafe-Talk, which simultaneously incorporates coarse- and fine-grained multimodal control conditions. Nevertheless, the entanglement of multiple conditions challenges achieving satisfying performance. To disentangle speech audio and fine-grained conditions, we employ a two-stage training pipeline. Specifically, Cafe-Talk is initially trained using only speech audio and coarse-grained conditions. Then, a proposed fine-grained control adapter gradually adds fine-grained instructions represented by action units (AUs), preventing unfavorable speech-lip synchronization. To disentangle coarse- and fine-grained conditions, we design a swap-label training mechanism, which enables the dominance of the fine-grained conditions. We also devise a mask-based CFG technique to regulate the occurrence and intensity of fine-grained control. In addition, a text-based detector is introduced with text-AU alignment to enable natural language user input and further support multimodal control. Extensive experimental results prove that Cafe-Talk achieves state-of-the-art lip synchronization and expressiveness performance and receives wide acceptance in fine-grained control in user studies. Project page: https://harryxd2018.github.io/cafe-talk/