Industrial-Grade Sensor Simulation via Gaussian Splatting: A Modular Framework for Scalable Editing and Full-Stack Validation

作者: Xianming Zeng, Sicong Du, Qifeng Chen, Lizhe Liu, Haoyu Shu, Jiaxuan Gao, Jiarun Liu, Jiulong Xu, Jianyun Xu, Mingxia Chen, Yiru Zhao, Peng Chen, Yapeng Xue, Chunming Zhao, Sheng Yang, Qiang Li

分类: cs.CV, cs.RO

发布日期: 2025-03-14

💡 一句话要点

提出基于高斯溅射的工业级传感器仿真框架,用于自动驾驶系统全栈验证。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 传感器仿真 高斯溅射 自动驾驶 神经辐射场 场景编辑 数据增强 全栈测试

📋 核心要点

- 现有基于NeRF的传感器仿真方法在工业应用中面临效率和可扩展性挑战,难以满足自动驾驶系统验证的需求。

- 论文提出基于高斯溅射(GS)的传感器仿真框架,利用GS的显式场景表示和实时渲染能力,实现高效的场景编辑和扩展。

- 实验表明,该方法降低了仿真延迟,提高了几何和光度一致性,并支持可解释的场景编辑,为自动驾驶算法的全栈测试提供了可能。

📝 摘要(中文)

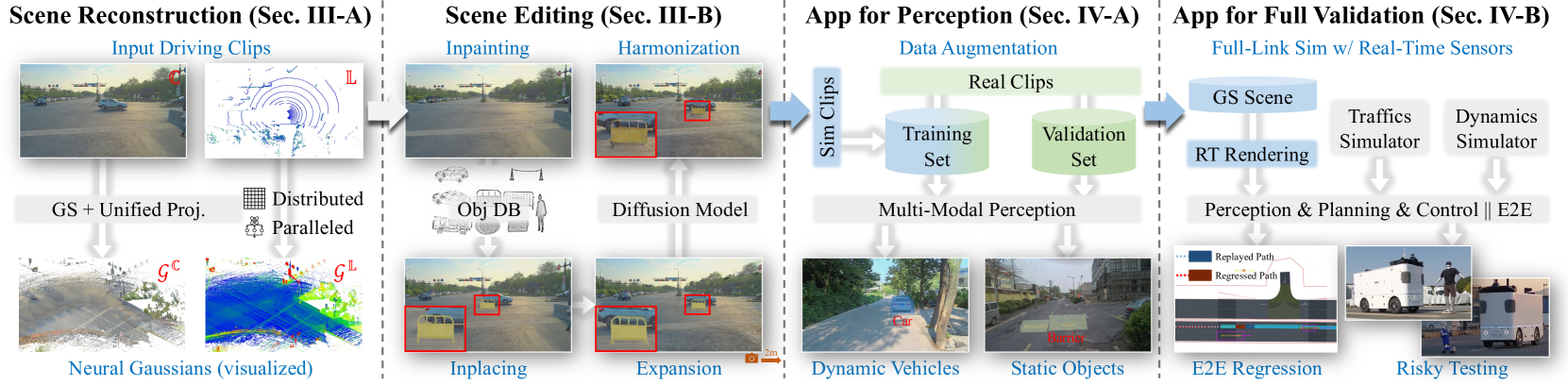

本文提出了一种基于高斯溅射(GS)的传感器仿真系统,旨在解决现有基于神经辐射场(NeRF)的方法在工业工作流程中的适用性和效率挑战。该系统通过GS分解传感器仿真组件,并利用其显式场景表示和实时渲染能力,对三个关键组件进行了重构:(1)选择2D神经高斯表示进行物理兼容的场景和传感器建模;(2)提出场景编辑流程,利用高斯基元库进行数据增强;(3)耦合可控扩散模型进行场景扩展和协调。该框架在自动驾驶数据集上进行了实现,支持相机和激光雷达传感器。实验表明,该方法降低了逐帧仿真延迟,实现了更好的几何和光度一致性,并支持可解释的显式场景编辑和扩展。此外,该系统与交通和动态仿真器集成,实现了端到端自动驾驶算法的全栈测试。该工作为工业级传感器仿真奠定了基础。

🔬 方法详解

问题定义:现有基于NeRF的传感器仿真方法在工业应用中存在效率瓶颈,难以满足自动驾驶系统大规模验证的需求。NeRF渲染速度慢,场景编辑困难,且难以进行物理属性的精确建模,限制了其在工业级应用中的潜力。

核心思路:论文的核心思路是利用高斯溅射(GS)作为场景表示,替代NeRF。GS具有显式的场景表示,可以实现实时渲染和高效的场景编辑。通过将传感器仿真过程分解为场景建模、传感器建模和渲染三个关键组件,并针对每个组件进行优化,从而提高仿真效率和真实感。

技术框架:该框架主要包含以下几个模块:1) 基于2D神经高斯表示的场景和传感器建模模块,用于构建物理兼容的场景和传感器模型;2) 场景编辑模块,利用高斯基元库进行数据增强,实现场景的快速编辑和修改;3) 场景扩展模块,耦合可控扩散模型,用于生成新的场景内容,实现场景的扩展和多样化;4) 渲染模块,利用GS的实时渲染能力,生成传感器数据。整个框架可以与交通和动态仿真器集成,实现端到端自动驾驶算法的全栈测试。

关键创新:该论文的关键创新在于将高斯溅射(GS)引入到传感器仿真领域,并针对工业级应用进行了优化。与NeRF相比,GS具有更快的渲染速度和更强的场景编辑能力。此外,该论文还提出了基于高斯基元库的场景编辑方法和基于可控扩散模型的场景扩展方法,进一步提高了仿真效率和真实感。

关键设计:在场景建模方面,论文采用了2D神经高斯表示,并设计了物理兼容的参数化方法。在场景编辑方面,论文构建了一个高斯基元库,包含各种常见的场景元素,如车辆、行人、道路等。在场景扩展方面,论文使用了一个可控扩散模型,可以根据用户的需求生成新的场景内容。在渲染方面,论文利用了GS的实时渲染能力,并针对传感器特性进行了优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在仿真速度上优于基于NeRF的方法,降低了逐帧仿真延迟。在几何和光度一致性方面,该方法也取得了更好的效果。此外,该方法支持可解释的显式场景编辑和扩展,为自动驾驶算法的测试提供了更大的灵活性。具体数据未在摘要中体现,需查阅论文。

🎯 应用场景

该研究成果可应用于自动驾驶系统的开发和验证,包括感知算法、决策规划算法和控制算法的测试。通过高效、真实的传感器仿真,可以降低自动驾驶系统的开发成本和风险,加速其商业化进程。此外,该技术还可应用于机器人、虚拟现实等领域。

📄 摘要(原文)

Sensor simulation is pivotal for scalable validation of autonomous driving systems, yet existing Neural Radiance Fields (NeRF) based methods face applicability and efficiency challenges in industrial workflows. This paper introduces a Gaussian Splatting (GS) based system to address these challenges: We first break down sensor simulator components and analyze the possible advantages of GS over NeRF. Then in practice, we refactor three crucial components through GS, to leverage its explicit scene representation and real-time rendering: (1) choosing the 2D neural Gaussian representation for physics-compliant scene and sensor modeling, (2) proposing a scene editing pipeline to leverage Gaussian primitives library for data augmentation, and (3) coupling a controllable diffusion model for scene expansion and harmonization. We implement this framework on a proprietary autonomous driving dataset supporting cameras and LiDAR sensors. We demonstrate through ablation studies that our approach reduces frame-wise simulation latency, achieves better geometric and photometric consistency, and enables interpretable explicit scene editing and expansion. Furthermore, we showcase how integrating such a GS-based sensor simulator with traffic and dynamic simulators enables full-stack testing of end-to-end autonomy algorithms. Our work provides both algorithmic insights and practical validation, establishing GS as a cornerstone for industrial-grade sensor simulation.