SpaceSeg: A High-Precision Intelligent Perception Segmentation Method for Multi-Spacecraft On-Orbit Targets

作者: Hao Liu, Pengyu Guo, Siyuan Yang, Zeqing Jiang, Qinglei Hu, Dongyu Li

分类: cs.CV, eess.IV

发布日期: 2025-03-14

🔗 代码/项目: GITHUB

💡 一句话要点

SpaceSeg:针对在轨多航天器目标的高精度智能感知分割方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语义分割 航天器 深空环境 视觉基础模型 多尺度特征融合

📋 核心要点

- 现有方法难以应对深空环境复杂、成像条件多样以及航天器形态多变等挑战,导致分割精度不足。

- SpaceSeg通过多尺度分层注意力、连通分量分析和空间域自适应变换等技术,提升分割精度和鲁棒性。

- 在自建数据集SpaceES上,SpaceSeg的mIoU达到89.87%,mAcc达到99.98%,显著优于现有方法。

📝 摘要(中文)

随着人类深空探索的不断推进,在轨多航天器目标的智能感知和高精度分割技术已成为确保现代空间任务成功的关键因素。然而,复杂的深空环境、多样的成像条件以及航天器形态的高度可变性给传统分割方法带来了重大挑战。本文提出了SpaceSeg,一种基于视觉基础模型的创新分割框架,具有四个核心技术创新:首先,多尺度分层注意力细化解码器(MSHARD)通过分层注意力进行跨分辨率特征融合,实现高精度特征解码。其次,多航天器连通分量分析(MS-CCA)有效地解决了密集目标中的拓扑结构混淆问题。第三,空间域自适应变换框架(SDAT)通过复合增强策略消除跨域差异并抵抗空间传感器扰动。最后,创建了一个定制的多航天器分割任务损失函数,以显着提高深空场景中的分割鲁棒性。为了支持算法验证,我们构建了第一个多尺度在轨多航天器语义分割数据集SpaceES,该数据集涵盖四种类型的空间背景和17个典型的航天器目标。在测试中,SpaceSeg实现了最先进的性能,mIoU为89.87%,mAcc为99.98%,超过现有最佳方法5.71个百分点。数据集和代码已在https://github.com/Akibaru/SpaceSeg上开源,为下一代空间态势感知系统提供关键技术支持。

🔬 方法详解

问题定义:论文旨在解决深空环境下多航天器目标的高精度语义分割问题。现有方法在处理复杂背景、光照变化和目标遮挡时,分割精度和鲁棒性不足,难以满足空间任务的需求。此外,密集目标间的拓扑结构混淆也是一个挑战。

核心思路:论文的核心思路是利用视觉基础模型,并结合针对深空环境特点设计的模块,提升分割性能。通过多尺度特征融合、连通分量分析和空间域自适应变换,增强模型对复杂场景的适应性和对密集目标的区分能力。

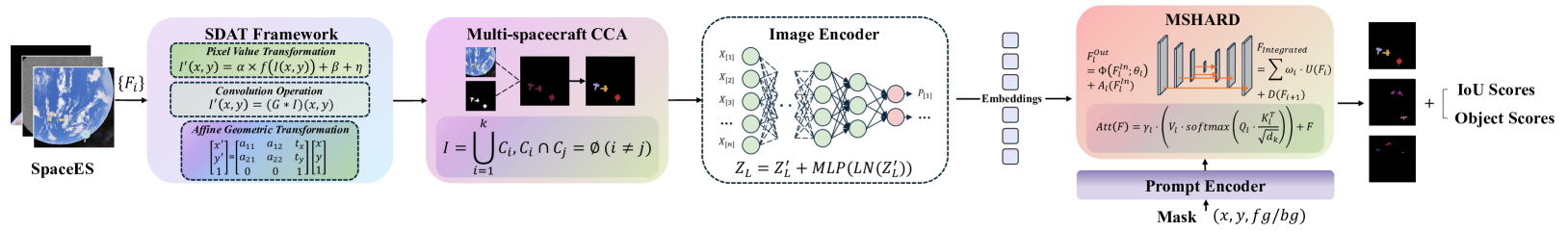

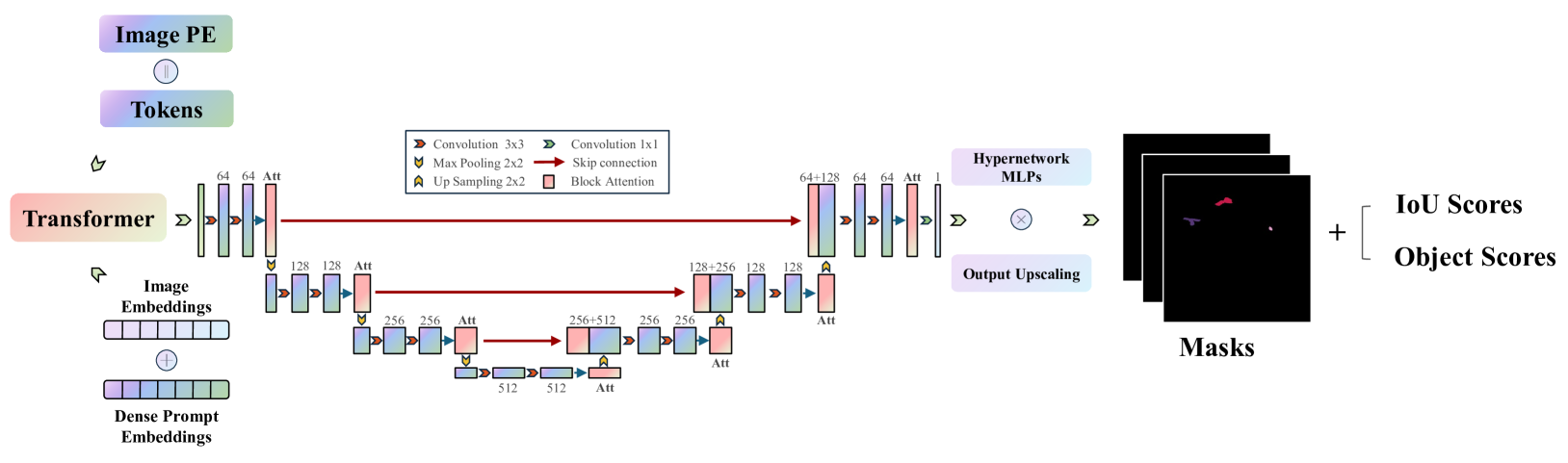

技术框架:SpaceSeg框架主要包含以下几个模块:1) 多尺度分层注意力细化解码器(MSHARD):用于高精度特征解码。2) 多航天器连通分量分析(MS-CCA):用于解决密集目标拓扑结构混淆。3) 空间域自适应变换框架(SDAT):用于消除跨域差异和抵抗空间传感器扰动。4) 多航天器分割任务损失函数:用于提高分割鲁棒性。整体流程是从输入图像开始,经过特征提取、特征融合、分割预测和损失计算,最终得到分割结果。

关键创新:论文的关键创新在于针对深空环境和多航天器目标的特点,设计了MSHARD、MS-CCA和SDAT三个模块。MSHARD通过分层注意力机制实现跨分辨率特征融合,提升分割精度。MS-CCA通过连通分量分析解决密集目标拓扑结构混淆。SDAT通过空间域自适应变换消除跨域差异,增强模型的泛化能力。

关键设计:MSHARD采用分层注意力机制,逐层融合不同分辨率的特征,并使用残差连接加速收敛。MS-CCA利用连通分量分析提取每个航天器目标,并进行独立分割。SDAT采用复合增强策略,包括几何变换、颜色扰动和噪声添加,模拟不同的空间环境。损失函数结合了交叉熵损失和Dice损失,平衡精度和召回率。

🖼️ 关键图片

📊 实验亮点

SpaceSeg在自建的多尺度在轨多航天器语义分割数据集SpaceES上取得了显著的性能提升,mIoU达到89.87%,mAcc达到99.98%,超过现有最佳方法5.71个百分点。实验结果表明,SpaceSeg在深空环境下具有优异的分割精度和鲁棒性。

🎯 应用场景

该研究成果可应用于下一代空间态势感知系统,为航天器自主导航、目标识别、空间碎片监测等任务提供关键技术支持。高精度的航天器分割能力有助于提高空间任务的安全性、可靠性和效率,并为未来的深空探索提供保障。

📄 摘要(原文)

With the continuous advancement of human exploration into deep space, intelligent perception and high-precision segmentation technology for on-orbit multi-spacecraft targets have become critical factors for ensuring the success of modern space missions. However, the complex deep space environment, diverse imaging conditions, and high variability in spacecraft morphology pose significant challenges to traditional segmentation methods. This paper proposes SpaceSeg, an innovative vision foundation model-based segmentation framework with four core technical innovations: First, the Multi-Scale Hierarchical Attention Refinement Decoder (MSHARD) achieves high-precision feature decoding through cross-resolution feature fusion via hierarchical attention. Second, the Multi-spacecraft Connected Component Analysis (MS-CCA) effectively resolves topological structure confusion in dense targets. Third, the Spatial Domain Adaptation Transform framework (SDAT) eliminates cross-domain disparities and resist spatial sensor perturbations through composite enhancement strategies. Finally, a custom Multi-Spacecraft Segmentation Task Loss Function is created to significantly improve segmentation robustness in deep space scenarios. To support algorithm validation, we construct the first multi-scale on-orbit multi-spacecraft semantic segmentation dataset SpaceES, which covers four types of spatial backgrounds and 17 typical spacecraft targets. In testing, SpaceSeg achieves state-of-the-art performance with 89.87$\%$ mIoU and 99.98$\%$ mAcc, surpassing existing best methods by 5.71 percentage points. The dataset and code are open-sourced at https://github.com/Akibaru/SpaceSeg to provide critical technical support for next-generation space situational awareness systems.