Falcon: A Remote Sensing Vision-Language Foundation Model (Technical Report)

作者: Kelu Yao, Nuo Xu, Rong Yang, Yingying Xu, Zhuoyan Gao, Titinunt Kitrungrotsakul, Yi Ren, Pu Zhang, Jin Wang, Ning Wei, Chao Li

分类: cs.CV

发布日期: 2025-03-14 (更新: 2025-10-16)

🔗 代码/项目: GITHUB

💡 一句话要点

Falcon:遥感领域的视觉-语言基础模型,实现多任务统一处理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感 视觉-语言模型 基础模型 提示学习 多任务学习

📋 核心要点

- 现有遥感任务通常依赖于特定模型,缺乏通用性和灵活性,难以适应复杂指令和多任务需求。

- Falcon通过构建统一的视觉-语言模型,利用提示学习范式,实现对遥感图像的理解和推理,从而解决上述问题。

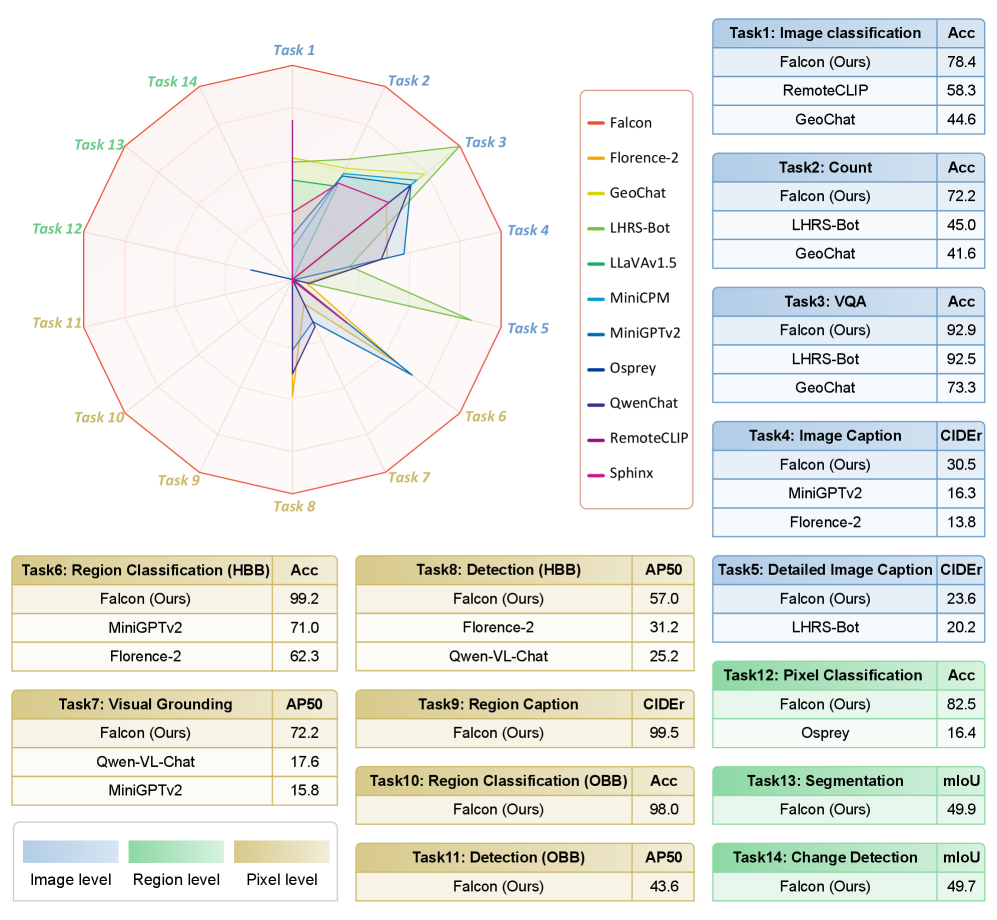

- 实验表明,Falcon在多个遥感任务上取得了优异性能,证明了其有效性和泛化能力,且模型参数量较小。

📝 摘要(中文)

本文介绍了一种专为遥感设计的整体视觉-语言基础模型,名为Falcon。Falcon提供了一种统一的、基于提示的范式,可以有效地执行全面而复杂的遥感任务。Falcon在图像、区域和像素级别上展示了强大的理解和推理能力。具体来说,给定简单的自然语言指令和遥感图像,Falcon可以在14个不同的任务(即图像分类、目标检测、分割、图像描述等)中以文本形式产生令人印象深刻的结果。为了促进Falcon的训练并增强其表示能力以编码丰富的空间和语义信息,我们开发了Falcon_SFT,这是一个大规模、多任务、指令调优的遥感领域数据集。Falcon_SFT数据集包含约7800万个高质量数据样本,涵盖560万个具有不同指令的多空间分辨率和多视角遥感图像。它具有分层注释,并经过人工抽样验证,以确保高数据质量和可靠性。大量的对比实验验证了Falcon在67个数据集和14个任务上取得了显著的性能,尽管只有0.7B参数。我们在https://github.com/TianHuiLab/Falcon发布了完整的数据集、代码和模型权重,希望有助于进一步发展开源社区。

🔬 方法详解

问题定义:遥感领域存在大量任务,如图像分类、目标检测、图像分割和图像描述等,传统方法通常需要为每个任务训练特定的模型,导致模型数量庞大,难以维护和扩展。此外,现有模型难以处理复杂的自然语言指令,限制了其在实际应用中的灵活性。

核心思路:Falcon的核心思路是构建一个统一的视觉-语言基础模型,通过提示学习(Prompt Learning)范式,将不同的遥感任务转化为文本生成任务。这样,只需要一个模型就可以处理多种任务,并且可以通过自然语言指令来控制模型的行为。这种方法可以提高模型的通用性和灵活性,并降低模型的维护成本。

技术框架:Falcon的整体架构包含视觉编码器和语言解码器两个主要模块。视觉编码器负责将遥感图像转换为视觉特征表示,语言解码器则根据视觉特征和自然语言指令生成相应的文本输出。训练过程中,Falcon使用大规模的遥感数据集Falcon_SFT进行指令调优,以提高模型对不同任务和指令的理解能力。

关键创新:Falcon最重要的技术创新点在于其统一的视觉-语言框架和基于提示学习的范式。与传统的针对特定任务的模型相比,Falcon可以处理多种任务,并且可以通过自然语言指令来控制模型的行为。此外,Falcon_SFT数据集的构建也为模型的训练提供了高质量的数据支持。

关键设计:Falcon使用了Transformer架构作为其视觉编码器和语言解码器的基础。视觉编码器可以使用预训练的视觉Transformer(例如ViT)进行初始化,以提高模型的性能。语言解码器则使用自回归的Transformer模型,例如GPT。在训练过程中,Falcon使用了交叉熵损失函数来优化模型的参数。Falcon_SFT数据集包含了多种类型的遥感图像和指令,以及相应的文本输出。为了保证数据的质量,作者进行了人工抽样验证。

🖼️ 关键图片

📊 实验亮点

Falcon在67个数据集和14个遥感任务上取得了显著的性能,证明了其有效性和泛化能力。值得注意的是,Falcon仅使用了0.7B参数,相比于其他大型模型,具有更高的效率和可部署性。Falcon_SFT数据集的发布也为遥感领域的视觉-语言研究提供了宝贵的数据资源。

🎯 应用场景

Falcon在遥感图像解译领域具有广泛的应用前景,例如城市规划、灾害监测、农业估产、环境评估等。通过自然语言指令,用户可以方便地控制模型执行各种遥感任务,从而提高遥感数据分析的效率和准确性。未来,Falcon有望成为遥感领域的基础设施,促进遥感技术的普及和应用。

📄 摘要(原文)

This paper introduces a holistic vision-language foundation model tailored for remote sensing, named Falcon. Falcon offers a unified, prompt-based paradigm that effectively executes comprehensive and complex remote sensing tasks. Falcon demonstrates powerful understanding and reasoning abilities at the image, region, and pixel levels. Specifically, given simple natural language instructions and remote sensing images, Falcon can produce impressive results in text form across 14 distinct tasks, i.e., image classification, object detection, segmentation, image captioning, and etc. To facilitate Falcon's training and empower its representation capacity to encode rich spatial and semantic information, we developed Falcon_SFT, a large-scale, multi-task, instruction-tuning dataset in the field of remote sensing. The Falcon_SFT dataset consists of approximately 78 million high-quality data samples, covering 5.6 million multi-spatial resolution and multi-view remote sensing images with diverse instructions. It features hierarchical annotations and undergoes manual sampling verification to ensure high data quality and reliability. Extensive comparative experiments are conducted, which verify that Falcon achieves remarkable performance over 67 datasets and 14 tasks, despite having only 0.7B parameters. We release the complete dataset, code, and model weights at https://github.com/TianHuiLab/Falcon, hoping to help further develop the open-source community.