OuroMamba: A Data-Free Quantization Framework for Vision Mamba

作者: Akshat Ramachandran, Mingyu Lee, Huan Xu, Souvik Kundu, Tushar Krishna

分类: cs.CV, cs.AI

发布日期: 2025-03-13 (更新: 2025-11-26)

备注: Accepted to ICCV 2025

🔗 代码/项目: GITHUB

💡 一句话要点

OuroMamba:首个面向Vision Mamba模型的免数据量化框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Vision Mamba 免数据量化 后训练量化 对比学习 动态异常值检测

📋 核心要点

- Vision Mamba模型量化面临长程依赖捕获不足和激活异常值动态变化两大挑战,导致传统量化方法效果不佳。

- OuroMamba通过对比学习生成语义丰富的合成数据,并结合动态异常值检测的混合精度量化,有效提升量化性能。

- 实验表明,OuroMamba在多种视觉任务上超越了现有数据驱动的量化方法,并实现了显著的推理加速。

📝 摘要(中文)

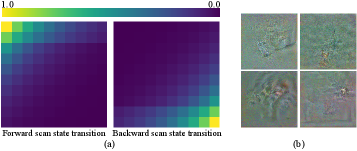

本文提出了OuroMamba,这是首个用于Vision Mamba模型(VMMs)的免数据后训练量化(DFQ)方法。我们发现为VMMs启用DFQ存在两个关键挑战:(1)VMM的循环状态转换限制了长程交互的捕获,导致生成的合成数据语义较弱;(2)VMM激活在时间步长上表现出动态的异常值变化,使得现有的静态PTQ技术失效。为了应对这些挑战,OuroMamba提出了一个两阶段框架:(1)OuroMamba-Gen,用于生成语义丰富且有意义的合成数据。它对通过潜在状态空间中的邻域交互生成的patch级别VMM特征应用对比学习;(2)OuroMamba-Quant,采用混合精度量化,并在推理过程中进行轻量级的动态异常值检测。具体来说,我们提出了一种基于阈值的激活异常通道选择策略,该策略在每个时间步长都会更新。在视觉和生成任务上的大量实验表明,我们的免数据OuroMamba超越了现有的数据驱动PTQ技术,在不同的量化设置中实现了最先进的性能。此外,我们实现了高效的GPU内核,以实现高达2.36倍的实际延迟加速。代码和合成数据集可在此处获得:https://github.com/georgia-tech-synergy-lab/ICCV-OuroMamba

🔬 方法详解

问题定义:论文旨在解决Vision Mamba模型在后训练量化(PTQ)中面临的挑战,即如何在不使用真实数据的情况下,有效地将VMM量化到低精度,同时保持模型性能。现有PTQ方法在VMM上表现不佳,主要原因是VMM的循环结构难以生成高质量的合成数据,且激活值存在动态的异常值,导致量化精度损失。

核心思路:论文的核心思路是分阶段解决VMM量化的两个关键问题。首先,通过对比学习生成更具代表性的合成数据,以弥补VMM循环结构带来的信息损失。其次,采用动态异常值检测和混合精度量化,以适应VMM激活值的动态变化,从而提高量化精度。

技术框架:OuroMamba框架包含两个主要阶段:OuroMamba-Gen和OuroMamba-Quant。OuroMamba-Gen负责生成高质量的合成数据,它利用VMM的中间特征,通过对比学习增强数据的语义信息。OuroMamba-Quant则利用生成的合成数据进行量化,并采用动态异常值检测和混合精度量化策略,以进一步提高量化性能。

关键创新:论文的关键创新在于提出了一个免数据的VMM量化框架,该框架能够有效地生成高质量的合成数据,并自适应地处理VMM激活值的动态变化。对比学习和动态异常值检测是该框架的核心技术创新。

关键设计:OuroMamba-Gen使用对比学习损失来训练生成器,该损失鼓励生成的合成数据在特征空间中与真实数据相似。OuroMamba-Quant采用基于阈值的通道选择策略来检测异常值,并对不同的通道采用不同的量化精度。具体的阈值和量化精度是根据合成数据统计信息确定的。

🖼️ 关键图片

📊 实验亮点

OuroMamba在多个视觉任务上取得了显著的性能提升,超越了现有的数据驱动PTQ方法。实验结果表明,OuroMamba能够在保持模型精度的前提下,实现高达2.36倍的推理加速。此外,该方法无需真实数据,降低了量化过程的成本和风险。

🎯 应用场景

OuroMamba可应用于各种需要低延迟和低功耗的视觉任务,例如移动设备上的图像识别、视频分析和生成式AI应用。该方法能够有效减小VMM模型的尺寸和计算复杂度,使其更易于部署在资源受限的平台上,从而推动VMM在实际应用中的普及。

📄 摘要(原文)

We present OuroMamba, the first data-free post-training quantization (DFQ) method for vision Mamba-based models (VMMs). We identify two key challenges in enabling DFQ for VMMs, (1) VMM's recurrent state transitions restricts capturing of long-range interactions and leads to semantically weak synthetic data, (2) VMM activations exhibit dynamic outlier variations across time-steps, rendering existing static PTQ techniques ineffective. To address these challenges, OuroMamba presents a two-stage framework: (1) OuroMamba-Gen to generate semantically rich and meaningful synthetic data. It applies contrastive learning on patch level VMM features generated through neighborhood interactions in the latent state space, (2) OuroMamba-Quant to employ mixed-precision quantization with lightweight dynamic outlier detection during inference. In specific, we present a thresholding based outlier channel selection strategy for activations that gets updated every time-step. Extensive experiments across vision and generative tasks show that our data-free OuroMamba surpasses existing data-driven PTQ techniques, achieving state-of-the-art performance across diverse quantization settings. Additionally, we implement efficient GPU kernels to achieve practical latency speedup of up to 2.36x. Code and synthetic dataset are available here: https://github.com/georgia-tech-synergy-lab/ICCV-OuroMamba