TARS: Traffic-Aware Radar Scene Flow Estimation

作者: Jialong Wu, Marco Braun, Dominic Spata, Matthias Rottmann

分类: cs.CV

发布日期: 2025-03-13 (更新: 2025-07-25)

💡 一句话要点

TARS:交通感知雷达场景流估计,提升自动驾驶感知能力

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 雷达场景流 自动驾驶 交通感知 目标检测 运动估计

📋 核心要点

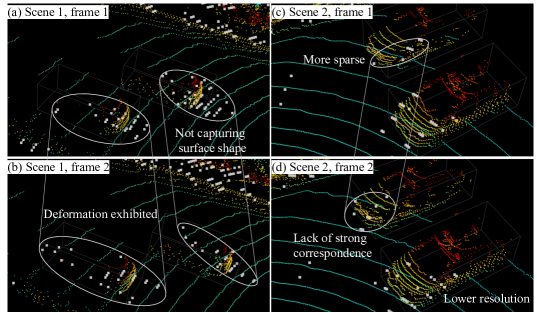

- 现有激光雷达场景流方法依赖实例级别的刚体假设,不适用于稀疏雷达点云,限制了雷达在自动驾驶中的应用。

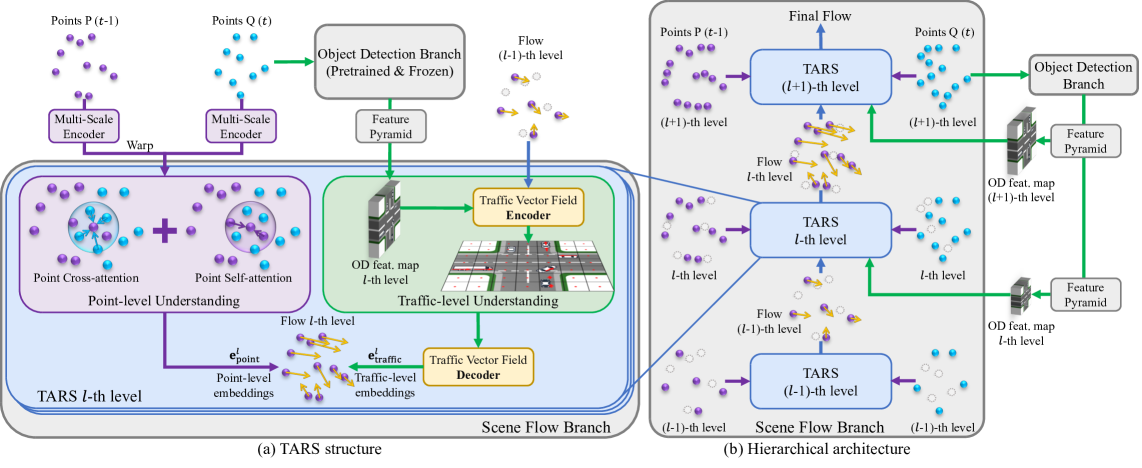

- TARS通过联合目标检测和场景流估计,引入交通矢量场(TVF)在特征空间中实现交通级别的场景理解,提升雷达场景流估计的准确性。

- 实验结果表明,TARS在专有数据集和View-of-Delft数据集上均取得了显著的性能提升,分别提高了23%和15%。

📝 摘要(中文)

场景流为自动驾驶提供关键的运动信息。现有的激光雷达场景流模型通常在实例级别利用刚体运动假设,但这些方法不适用于稀疏的雷达点云。本文提出了一种新的交通感知雷达场景流(TARS)估计方法,该方法在交通级别利用运动刚性。为了解决雷达场景流中的挑战,我们联合执行目标检测和场景流估计,并促进后者。我们将目标检测器的特征图(通过检测损失训练)结合起来,使雷达场景流能够感知环境和道路使用者。由此,我们在特征空间中构建了一个交通矢量场(TVF),以实现场景流分支中整体的交通级别场景理解。在估计场景流时,我们同时考虑来自点邻域的点级别运动线索和空间内刚体运动的交通级别一致性。TARS在专有数据集和View-of-Delft数据集上优于现有技术,分别将基准提高了23%和15%。

🔬 方法详解

问题定义:现有的场景流估计方法,特别是针对激光雷达点云的方法,通常依赖于实例级别的刚体运动假设。然而,雷达点云的稀疏性使得这些方法难以直接应用。因此,如何有效地利用稀疏雷达点云进行准确的场景流估计,成为了一个关键问题。现有方法无法有效利用交通环境的上下文信息,导致估计精度受限。

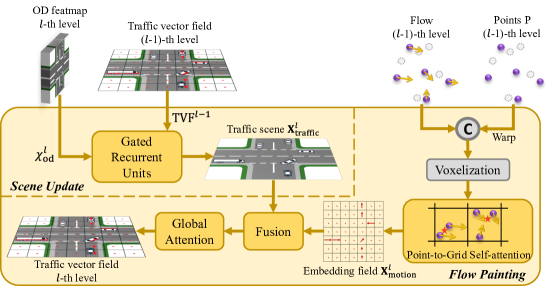

核心思路:TARS的核心思路是在交通级别上利用运动刚性。这意味着,与其关注单个物体的运动,不如关注整个交通流的运动模式。通过将目标检测信息融入场景流估计中,TARS能够感知周围的交通环境,并利用这些信息来约束场景流的估计,从而提高精度和鲁棒性。

技术框架:TARS的整体框架包括以下几个主要模块:首先,使用一个目标检测器来检测场景中的车辆和其他道路使用者。然后,将目标检测器的特征图输入到场景流估计分支中,以实现交通感知。在场景流估计分支中,构建了一个交通矢量场(TVF),用于捕捉交通流的整体运动模式。最后,在估计场景流时,同时考虑点级别的运动线索和交通级别的运动一致性。

关键创新:TARS最重要的创新点在于其交通感知的场景流估计方法。通过将目标检测信息融入场景流估计中,TARS能够利用交通环境的上下文信息来约束场景流的估计,从而提高精度和鲁棒性。与现有方法相比,TARS不再局限于实例级别的刚体运动假设,而是能够在交通级别上进行场景理解。

关键设计:TARS的关键设计包括:1) 使用目标检测器的特征图作为场景流估计的输入,以实现交通感知;2) 构建交通矢量场(TVF)来捕捉交通流的整体运动模式;3) 在损失函数中,同时考虑点级别的运动一致性和交通级别的运动一致性。具体的网络结构和参数设置在论文中有详细描述,例如目标检测器的选择,TVF的构建方式,以及损失函数的权重等。

🖼️ 关键图片

📊 实验亮点

TARS在专有数据集和View-of-Delft数据集上都取得了显著的性能提升。在专有数据集上,TARS的性能比现有技术提高了23%。在View-of-Delft数据集上,TARS的性能比现有技术提高了15%。这些结果表明,TARS是一种有效的雷达场景流估计方法,能够显著提高自动驾驶车辆的感知能力。

🎯 应用场景

TARS在自动驾驶领域具有广泛的应用前景。它可以用于感知周围环境的运动信息,从而帮助自动驾驶车辆做出更安全、更合理的决策。例如,TARS可以用于预测其他车辆的运动轨迹,从而避免碰撞。此外,TARS还可以用于构建高精度的地图,从而提高自动驾驶车辆的定位精度。该研究的成果也有潜力应用于智能交通系统,例如交通流量预测和优化。

📄 摘要(原文)

Scene flow provides crucial motion information for autonomous driving. Recent LiDAR scene flow models utilize the rigid-motion assumption at the instance level, assuming objects are rigid bodies. However, these instance-level methods are not suitable for sparse radar point clouds. In this work, we present a novel Traffic-Aware Radar Scene-Flow (TARS) estimation method, which utilizes motion rigidity at the traffic level. To address the challenges in radar scene flow, we perform object detection and scene flow jointly and boost the latter. We incorporate the feature map from the object detector, trained with detection losses, to make radar scene flow aware of the environment and road users. From this, we construct a Traffic Vector Field (TVF) in the feature space to achieve holistic traffic-level scene understanding in our scene flow branch. When estimating the scene flow, we consider both point-level motion cues from point neighbors and traffic-level consistency of rigid motion within the space. TARS outperforms the state of the art on a proprietary dataset and the View-of-Delft dataset, improving the benchmarks by 23% and 15%, respectively.