Isolated Channel Vision Transformers: From Single-Channel Pretraining to Multi-Channel Finetuning

作者: Wenyi Lian, Patrick Micke, Joakim Lindblad, Nataša Sladoje

分类: cs.CV

发布日期: 2025-03-12 (更新: 2025-10-13)

备注: Paper has been accepted by BMVC as an Oral presentation

🔗 代码/项目: GITHUB

💡 一句话要点

提出IC-ViT,通过单通道预训练和多通道微调,提升ViT在多通道图像处理任务中的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉Transformer 多通道图像 预训练 微调 细胞显微镜 遥感图像 通道隔离 自监督学习

📋 核心要点

- 现有ViT在多通道图像处理中面临挑战,直接训练忽略了通道间的互补信息,导致性能下降。

- IC-ViT通过对每个通道独立进行patch划分,实现单通道预训练和多通道微调,有效捕获通道间依赖。

- 实验表明,IC-ViT在细胞显微镜和卫星图像任务上,相比现有方法性能提升4-14个百分点。

📝 摘要(中文)

视觉Transformer (ViT) 在标准RGB图像处理任务中取得了显著成功。然而,将ViT应用于多通道成像 (MCI) 数据,例如医学和遥感应用,仍然是一个挑战。特别是,MCI数据通常由从不同模态获取的层组成。直接在此类数据上训练ViT可能会模糊互补信息并损害性能。本文提出了一种简单而有效的用于大规模MCI数据集的预训练框架。我们的方法,称为Isolated Channel ViT (IC-ViT),单独对图像通道进行patch划分,从而能够对多模态多通道任务进行预训练。我们表明,这种通道式patch划分是MCI处理的关键技术。更重要的是,可以在单个通道上预训练IC-ViT,并在下游多通道数据集上对其进行微调。此预训练框架捕获patch之间以及通道之间的依赖关系,并产生鲁棒的特征表示。在各种任务和基准上的实验,包括用于细胞显微镜成像的JUMP-CP和CHAMMI,以及用于卫星成像的So2Sat-LCZ42,表明所提出的IC-ViT比现有的通道自适应方法提高了4-14个百分点的性能。此外,其高效的训练使其成为在异构数据上大规模预训练基础模型的合适选择。我们的代码可在https://github.com/shermanlian/IC-ViT 获得。

🔬 方法详解

问题定义:论文旨在解决视觉Transformer (ViT) 在多通道图像 (MCI) 数据处理中的性能瓶颈。现有方法直接将多通道数据输入ViT,忽略了不同通道之间的独立性和互补信息,导致模型难以有效学习特征,性能受到限制。尤其是在医学成像和遥感等领域,多通道数据包含来自不同模态的信息,直接训练会模糊这些信息,影响最终结果。

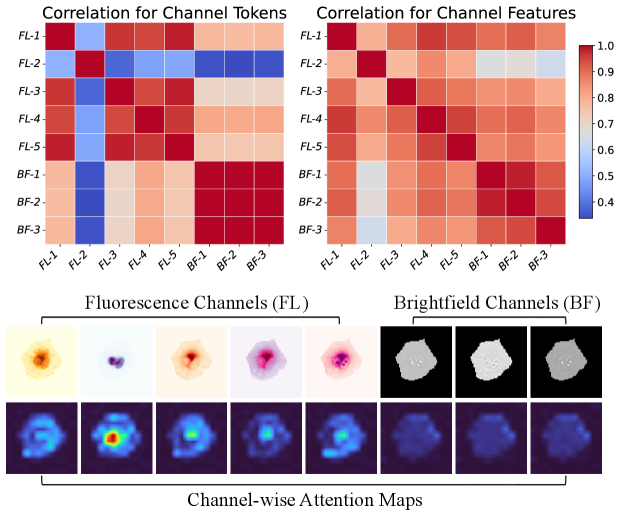

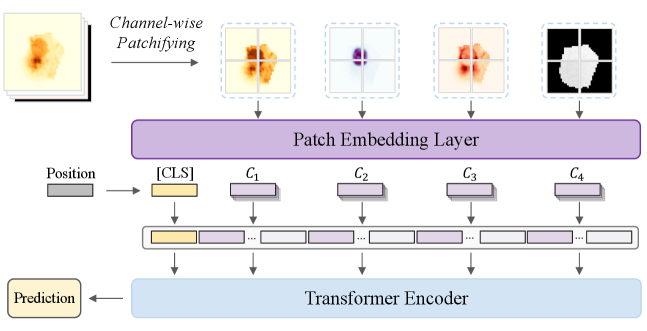

核心思路:论文的核心思路是“隔离通道”进行预训练,即Isolated Channel ViT (IC-ViT)。通过对每个通道单独进行patch划分,使得模型能够独立学习每个通道的特征表示。这种方式避免了在预训练阶段就将不同通道的信息混合在一起,从而更好地保留了每个通道的独特性。之后,在下游任务中,再将学习到的单通道特征进行融合,以利用通道间的互补信息。

技术框架:IC-ViT的整体框架包含两个主要阶段:预训练阶段和微调阶段。在预训练阶段,IC-ViT对每个通道的图像数据进行独立的patch划分,然后将这些patch输入到Transformer编码器中进行特征提取。每个通道都有一个独立的Transformer编码器。在微调阶段,将预训练好的IC-ViT应用于下游的多通道图像任务。此时,将多通道图像的每个通道分别输入到对应的预训练好的Transformer编码器中,然后将所有通道的输出特征进行融合,例如通过拼接或加权平均等方式,最后输入到分类器或其他任务相关的模块中。

关键创新:IC-ViT最重要的创新点在于其“隔离通道”的预训练策略。与传统的直接在多通道数据上进行预训练的方法不同,IC-ViT通过对每个通道独立进行patch划分和特征提取,使得模型能够更好地学习每个通道的独立特征表示。这种方法能够有效地保留每个通道的独特性,避免了在预训练阶段就将不同通道的信息混合在一起,从而提高了模型的性能。

关键设计:IC-ViT的关键设计包括:1) 通道独立的patch划分:每个通道的图像数据都被独立地划分为patch,每个patch的大小和数量可以根据具体任务进行调整。2) Transformer编码器:每个通道都使用一个独立的Transformer编码器进行特征提取,编码器的结构可以采用标准的ViT结构或其他变体。3) 特征融合:在微调阶段,需要将所有通道的输出特征进行融合,可以使用拼接、加权平均或其他更复杂的融合方法。4) 损失函数:预训练阶段可以使用自监督学习的损失函数,例如掩码图像建模 (Masked Image Modeling, MIM) 等。微调阶段可以使用任务相关的损失函数,例如交叉熵损失等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,IC-ViT在JUMP-CP和CHAMMI细胞显微镜图像数据集以及So2Sat-LCZ42卫星图像数据集上均取得了显著的性能提升。具体而言,IC-ViT相比现有的通道自适应方法,在这些数据集上分别取得了4-14个百分点的性能提升,验证了其有效性。此外,IC-ViT的高效训练使其适合大规模预训练,为构建多模态基础模型提供了可能。

🎯 应用场景

IC-ViT在医学图像分析(如细胞显微镜图像分类)、遥感图像处理(如土地覆盖分类)等领域具有广泛的应用前景。通过有效利用多通道图像信息,可以提升疾病诊断的准确率,提高遥感图像的解译精度,为相关领域的科研和实际应用带来价值。未来,IC-ViT有望扩展到更多多模态数据处理任务中。

📄 摘要(原文)

Vision Transformers (ViTs) have achieved remarkable success in standard RGB image processing tasks. However, applying ViTs to multi-channel imaging (MCI) data, e.g., for medical and remote sensing applications, remains a challenge. In particular, MCI data often consist of layers acquired from different modalities. Directly training ViTs on such data can obscure complementary information and impair the performance. In this paper, we introduce a simple yet effective pretraining framework for large-scale MCI datasets. Our method, named Isolated Channel ViT (IC-ViT), patchifies image channels individually and thereby enables pretraining for multimodal multi-channel tasks. We show that this channel-wise patchifying is a key technique for MCI processing. More importantly, one can pretrain the IC-ViT on single channels and finetune it on downstream multi-channel datasets. This pretraining framework captures dependencies between patches as well as channels and produces robust feature representation. Experiments on various tasks and benchmarks, including JUMP-CP and CHAMMI for cell microscopy imaging, and So2Sat-LCZ42 for satellite imaging, show that the proposed IC-ViT delivers 4-14 percentage points of performance improvement over existing channel-adaptive approaches. Further, its efficient training makes it a suitable candidate for large-scale pretraining of foundation models on heterogeneous data. Our code is available at https://github.com/shermanlian/IC-ViT.