DitHub: A Modular Framework for Incremental Open-Vocabulary Object Detection

作者: Chiara Cappellino, Gianluca Mancusi, Matteo Mosconi, Angelo Porrello, Simone Calderara, Rita Cucchiara

分类: cs.CV, cs.LG

发布日期: 2025-03-12 (更新: 2025-10-22)

备注: Accepted at the 39th Conference on Neural Information Processing Systems (NeurIPS 2025)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出DitHub框架以解决开放词汇物体检测的适应性问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 开放词汇检测 模块化学习 物体检测 深度学习 适应性模块 版本控制系统 性能评估

📋 核心要点

- 现有的开放词汇物体检测方法在适应稀有类别和多个专业领域时存在局限性,通常依赖单一权重的整体适应策略。

- 论文提出的DitHub框架采用模块化深度学习,允许构建和管理高效的适应模块,灵活应对不同的检测需求。

- 在ODinW-13和ODinW-O基准测试中,DitHub展示了优越的性能,标志着在物体检测领域的重大进展。

📝 摘要(中文)

开放词汇物体检测器能够通过简单的文本提示对无限制类别进行泛化。然而,如何将这些模型适应于稀有类别或在多个专业领域中增强其能力仍然至关重要。尽管近期方法依赖于单一权重的整体适应策略,我们采用了模块化深度学习。我们引入了DitHub,一个旨在构建和维护高效适应模块库的框架。受版本控制系统的启发,DitHub将专家模块管理为可根据需要提取和合并的分支。这种模块化方法使我们能够深入探索适应模块的组合特性,标志着物体检测领域首次进行此类研究。我们的方法在ODinW-13基准和新引入的ODinW-O基准上实现了最先进的性能。

🔬 方法详解

问题定义:本论文旨在解决开放词汇物体检测中模型适应性不足的问题,尤其是在处理稀有类别和多样化领域时,现有方法往往依赖于单一的权重集,缺乏灵活性和效率。

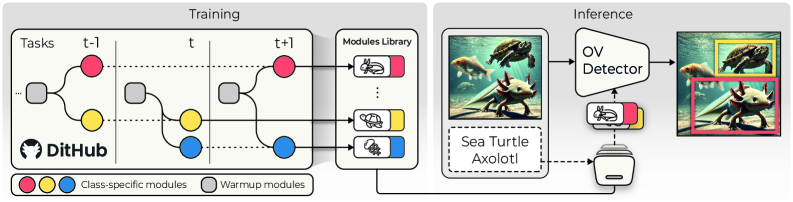

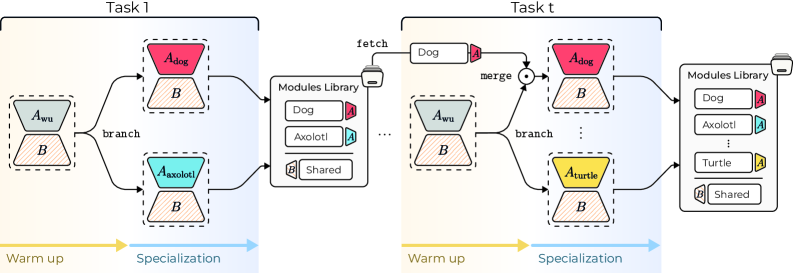

核心思路:我们提出的DitHub框架通过模块化设计,允许构建和维护适应模块库,灵活地根据需求提取和合并模块,从而增强模型的适应能力和泛化能力。

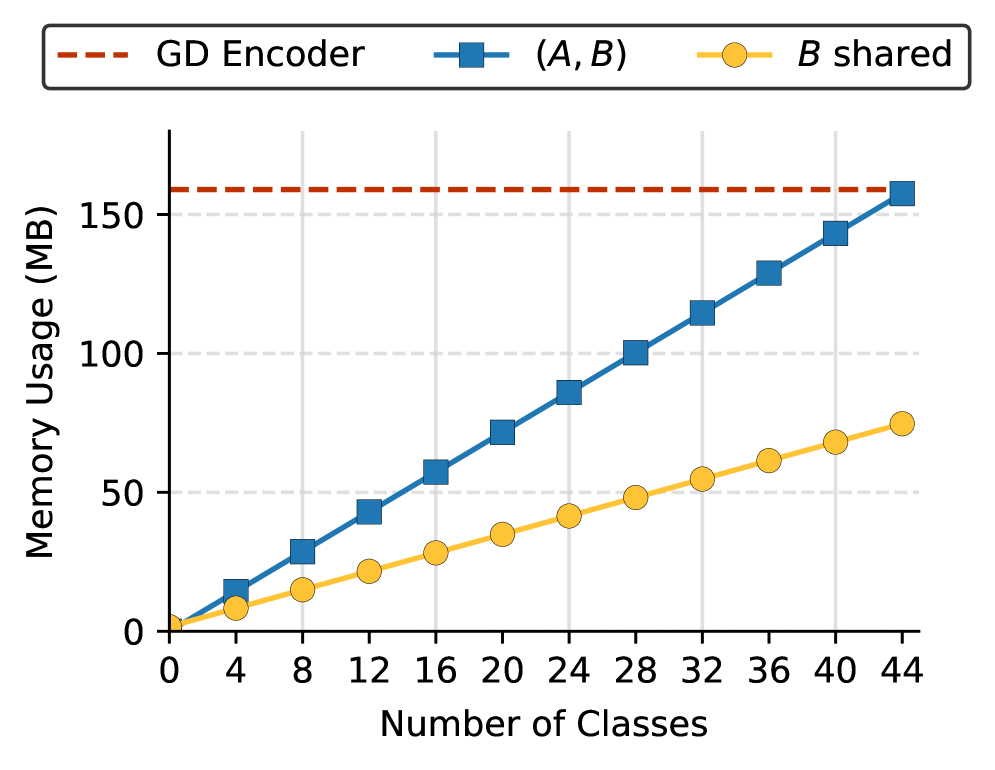

技术框架:DitHub的整体架构包括模块库管理、模块提取与合并、以及适应性评估等主要模块。每个模块可以独立开发和优化,支持快速迭代和实验。

关键创新:DitHub的最大创新在于其模块化的适应策略,允许对适应模块进行深入的组合特性探索,这在物体检测领域尚属首次,显著提高了模型的灵活性和性能。

关键设计:在技术细节上,DitHub采用了特定的损失函数和网络结构,以优化模块的适应性和性能,同时确保模块之间的兼容性和可重用性。

🖼️ 关键图片

📊 实验亮点

在ODinW-13基准测试中,DitHub实现了最先进的性能,具体提升幅度未知。同时,在新引入的ODinW-O基准上,DitHub也展现了卓越的检测能力,标志着对类重现能力的有效评估。

🎯 应用场景

DitHub框架的潜在应用领域包括智能监控、自动驾驶、机器人视觉等,能够有效提升物体检测系统在复杂环境中的适应能力。其模块化设计也为未来的研究提供了灵活的实验平台,推动开放词汇物体检测技术的进一步发展。

📄 摘要(原文)

Open-Vocabulary object detectors can generalize to an unrestricted set of categories through simple textual prompting. However, adapting these models to rare classes or reinforcing their abilities on multiple specialized domains remains essential. While recent methods rely on monolithic adaptation strategies with a single set of weights, we embrace modular deep learning. We introduce DitHub, a framework designed to build and maintain a library of efficient adaptation modules. Inspired by Version Control Systems, DitHub manages expert modules as branches that can be fetched and merged as needed. This modular approach allows us to conduct an in-depth exploration of the compositional properties of adaptation modules, marking the first such study in Object Detection. Our method achieves state-of-the-art performance on the ODinW-13 benchmark and ODinW-O, a newly introduced benchmark designed to assess class reappearance. For more details, visit our project page: https://aimagelab.github.io/DitHub/