MagicInfinite: Generating Infinite Talking Videos with Your Words and Voice

作者: Hongwei Yi, Tian Ye, Shitong Shao, Xuancheng Yang, Jiantong Zhao, Hanzhong Guo, Terrance Wang, Qingyu Yin, Zeke Xie, Lei Zhu, Wei Li, Michael Lingelbach, Daquan Zhou

分类: cs.CV

发布日期: 2025-03-07

备注: MagicInfinite is publicly accessible at https://www.hedra.com/. More examples are at https://magicinfinite.github.io/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

MagicInfinite:提出一种扩散Transformer框架,用于生成无限长度的逼真说话视频。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 扩散模型 Transformer 人像动画 说话视频生成 多模态融合 唇音同步 蒸馏训练

📋 核心要点

- 现有的人像动画方法难以生成具有时间连贯性和高质量的无限长度视频,并且在角色类型和姿势上存在局限性。

- MagicInfinite 采用扩散Transformer框架,通过3D全注意力机制、两阶段课程学习和区域特定掩码来实现无限视频生成和多模态控制。

- 实验表明,MagicInfinite 在音频-唇音同步、身份保持和运动自然度方面优于现有方法,并且通过蒸馏技术显著提高了推理速度。

📝 摘要(中文)

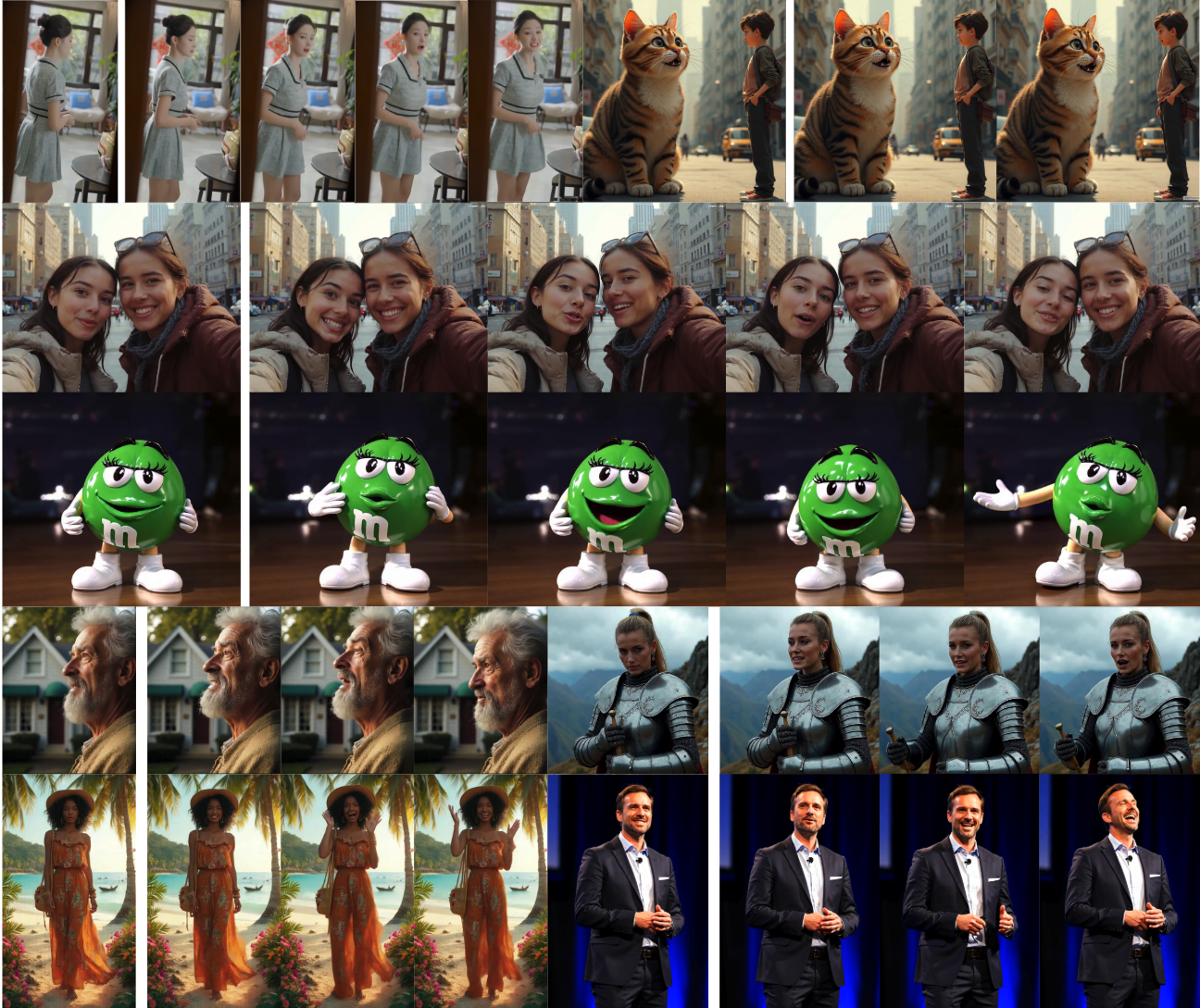

MagicInfinite 提出了一种新颖的扩散Transformer (DiT) 框架,克服了传统人像动画的局限性,在各种角色类型(包括逼真的人类、全身人物和风格化的动漫角色)中提供高保真结果。它支持各种面部姿势,包括背对视图,并为单个或多个角色制作动画,使用输入掩码来精确指定多角色场景中的说话者。我们的方法通过三项创新解决了关键挑战:(1) 具有滑动窗口去噪策略的 3D 全注意力机制,支持无限视频生成,并在各种角色风格中实现时间连贯性和视觉质量;(2) 两阶段课程学习方案,集成音频以实现唇音同步,集成文本以实现富有表现力的动态,并集成参考图像以实现身份保持,从而实现对长序列的灵活多模态控制;(3) 具有自适应损失函数的区域特定掩码,以平衡全局文本控制和局部音频指导,支持特定于说话者的动画。通过我们创新的统一步骤和 cfg 蒸馏技术,效率得到提高,与基本模型相比,推理速度提高了 20 倍:在 8 个 H100 GPU 上,在 10 秒内生成 10 秒的 540x540p 视频,或在 30 秒内生成 720x720p 视频,而不会损失质量。在我们新的基准上的评估表明,MagicInfinite 在各种场景中的音频-唇音同步、身份保持和运动自然度方面都具有优越性。

🔬 方法详解

问题定义:现有的人像动画方法在生成长视频时,存在时间连贯性差、视觉质量不高的问题。同时,对于不同类型的角色(如动漫角色)以及复杂的姿势(如背对视图)的支持不足。此外,在多角色场景中,难以实现对特定说话者的精确控制。

核心思路:MagicInfinite 的核心思路是利用扩散Transformer (DiT) 的强大生成能力,结合3D全注意力机制来保证时间连贯性,并采用两阶段课程学习来融合音频、文本和参考图像等多模态信息,从而实现对长视频的灵活控制。通过区域特定掩码和自适应损失函数,可以实现对不同说话者的精细化动画控制。

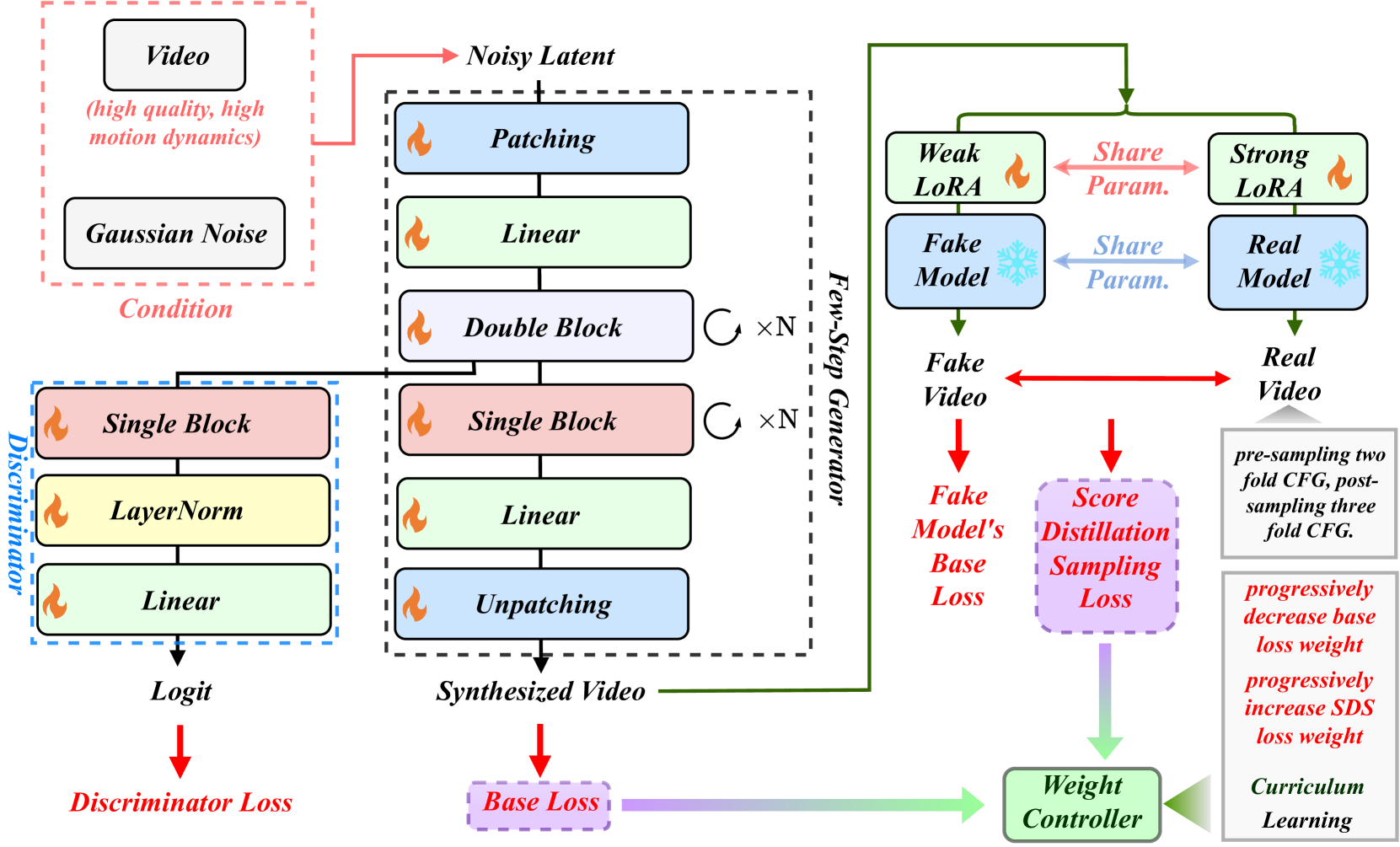

技术框架:MagicInfinite 的整体框架是一个基于扩散Transformer的生成模型。它包含以下主要模块:1) 3D全注意力模块,用于捕捉视频中的时间依赖关系;2) 两阶段课程学习模块,用于融合音频、文本和参考图像等多模态信息;3) 区域特定掩码模块,用于控制不同区域的动画效果。整个流程包括:输入参考图像、音频和文本,通过扩散过程生成视频,然后通过去噪过程提高视频质量。

关键创新:MagicInfinite 的关键创新在于以下几个方面:1) 提出了3D全注意力机制,能够有效地捕捉视频中的时间依赖关系,从而保证生成视频的时间连贯性;2) 采用了两阶段课程学习方案,能够有效地融合音频、文本和参考图像等多模态信息,从而实现对长视频的灵活控制;3) 提出了区域特定掩码和自适应损失函数,能够实现对不同说话者的精细化动画控制。此外,还采用了统一的步骤和CFG蒸馏技术,显著提高了推理速度。

关键设计:在3D全注意力机制中,采用了滑动窗口去噪策略,以降低计算复杂度。在两阶段课程学习中,第一阶段侧重于音频-唇音同步,第二阶段侧重于文本驱动的表情和动作。区域特定掩码根据说话者进行划分,自适应损失函数根据区域的重要性进行调整。蒸馏训练通过最小化学生模型和教师模型之间的差异来提高推理速度。

🖼️ 关键图片

📊 实验亮点

MagicInfinite 在音频-唇音同步、身份保持和运动自然度方面均优于现有方法。通过统一的步骤和CFG蒸馏技术,推理速度提高了 20 倍,在 8 个 H100 GPU 上,可以在 10 秒内生成 10 秒的 540x540p 视频,或在 30 秒内生成 720x720p 视频,而不会损失质量。

🎯 应用场景

MagicInfinite 可应用于虚拟主播、数字人生成、电影制作、游戏开发等领域。它可以根据用户的语音和文本输入,生成逼真的说话视频,从而降低内容创作的成本和门槛。未来,该技术有望应用于个性化教育、智能客服等领域,实现更自然、更智能的人机交互。

📄 摘要(原文)

We present MagicInfinite, a novel diffusion Transformer (DiT) framework that overcomes traditional portrait animation limitations, delivering high-fidelity results across diverse character types-realistic humans, full-body figures, and stylized anime characters. It supports varied facial poses, including back-facing views, and animates single or multiple characters with input masks for precise speaker designation in multi-character scenes. Our approach tackles key challenges with three innovations: (1) 3D full-attention mechanisms with a sliding window denoising strategy, enabling infinite video generation with temporal coherence and visual quality across diverse character styles; (2) a two-stage curriculum learning scheme, integrating audio for lip sync, text for expressive dynamics, and reference images for identity preservation, enabling flexible multi-modal control over long sequences; and (3) region-specific masks with adaptive loss functions to balance global textual control and local audio guidance, supporting speaker-specific animations. Efficiency is enhanced via our innovative unified step and cfg distillation techniques, achieving a 20x inference speed boost over the basemodel: generating a 10 second 540x540p video in 10 seconds or 720x720p in 30 seconds on 8 H100 GPUs, without quality loss. Evaluations on our new benchmark demonstrate MagicInfinite's superiority in audio-lip synchronization, identity preservation, and motion naturalness across diverse scenarios. It is publicly available at https://www.hedra.com/, with examples at https://magicinfinite.github.io/.