EvolvingGS: High-Fidelity Streamable Volumetric Video via Evolving 3D Gaussian Representation

作者: Chao Zhang, Yifeng Zhou, Shuheng Wang, Wenfa Li, Degang Wang, Yi Xu, Shaohui Jiao

分类: cs.CV

发布日期: 2025-03-07

💡 一句话要点

EvolvingGS:通过演化3D高斯表示实现高保真可流式传输的体视频

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景重建 3D高斯溅射 体视频 时间一致性 可流式传输 高保真 演化模型 视频压缩

📋 核心要点

- 现有动态场景重建方法难以处理长时间、剧烈运动和复杂交互的序列,导致时间不稳定和存储效率低。

- EvolvingGS通过两阶段策略,先变形高斯模型粗略对齐,再通过增量式点调整进行细化,提升重建质量。

- 实验表明,EvolvingGS在质量和时间一致性上优于现有方法,并提出了一种高效压缩算法,压缩率超过50倍。

📝 摘要(中文)

本文提出了一种名为EvolvingGS的两阶段策略,旨在解决动态场景(如长时间复杂人体表演)重建的挑战。现有方法难以对具有剧烈运动、频繁拓扑变化或与道具交互的长序列进行建模,通常将整个序列分割成独立处理的帧组,从而损害了时间稳定性,导致不愉快的观看体验和低效的存储占用。EvolvingGS首先变形高斯模型以粗略地与目标帧对齐,然后通过最小的点添加/删除来细化它,尤其是在快速变化的区域。由于增量演化表示的灵活性,我们的方法在每帧和时间质量指标方面都优于现有方法,同时通过其纯粹的显式表示保持快速渲染。此外,通过利用连续帧之间的时间一致性,我们提出了一种简单而有效的压缩算法,实现了超过50倍的压缩率。在公共基准和具有挑战性的自定义数据集上的大量实验表明,我们的方法显著推进了动态场景重建的最新技术,特别是对于具有复杂人体表演的扩展序列。

🔬 方法详解

问题定义:现有动态场景重建方法,尤其是在处理长时间、复杂运动和交互的视频时,面临着时间一致性差、存储效率低的问题。将长序列分割成独立帧组处理,忽略了帧间的时间相关性,导致重建质量下降和存储空间浪费。

核心思路:EvolvingGS的核心在于利用3D高斯表示的灵活性,通过演化而非完全重建的方式来适应动态场景的变化。它通过变形和局部调整现有高斯模型,而非每次都从头开始重建,从而保持了时间一致性,并减少了计算和存储开销。

技术框架:EvolvingGS包含两个主要阶段:1) 高斯模型变形:将上一帧的高斯模型变形,使其与当前帧粗略对齐。这可以通过光流估计或其他运动估计方法实现。2) 高斯模型细化:在变形后的高斯模型基础上,通过添加或删除高斯点,以及调整现有高斯点的参数(如位置、颜色、不透明度等),来精细化重建结果。该过程主要集中在快速变化的区域。

关键创新:EvolvingGS的关键创新在于其增量式的演化策略。与传统的从头重建方法相比,EvolvingGS充分利用了帧间的时间相关性,通过变形和局部调整来适应场景变化,从而显著提高了重建质量和效率。此外,该方法还提出了一种基于时间一致性的高效压缩算法。

关键设计:具体的技术细节包括:1) 使用基于梯度的优化方法来调整高斯模型的参数,以最小化重建误差。2) 设计了一种自适应的点添加/删除策略,根据局部场景的变化程度来动态调整高斯点的数量。3) 提出了一种基于时间一致性的压缩算法,通过编码帧间差异来减少存储空间。

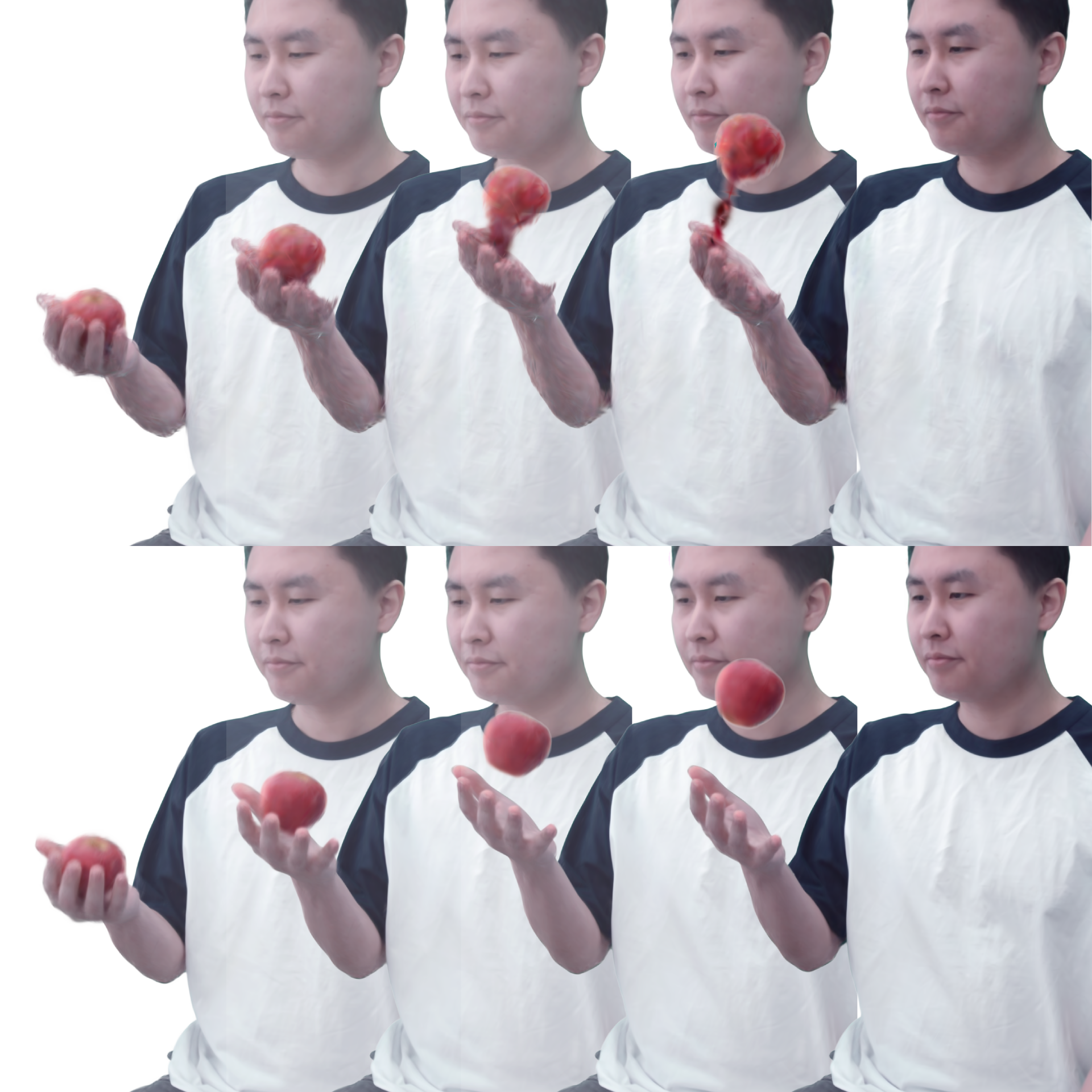

🖼️ 关键图片

📊 实验亮点

EvolvingGS在多个数据集上取得了显著的性能提升。在复杂人体表演数据集上,EvolvingGS在重建质量和时间一致性方面均优于现有方法。此外,该方法提出的压缩算法实现了超过50倍的压缩率,大大降低了存储和传输成本。这些实验结果表明,EvolvingGS在动态场景重建领域具有显著的优势。

🎯 应用场景

EvolvingGS在虚拟现实、增强现实、数字内容创作等领域具有广泛的应用前景。它可以用于创建高质量、可流式传输的动态3D场景,例如虚拟人物、运动捕捉、远程呈现等。该技术能够提升用户体验,降低存储和传输成本,并为相关产业带来新的发展机遇。

📄 摘要(原文)

We have recently seen great progress in 3D scene reconstruction through explicit point-based 3D Gaussian Splatting (3DGS), notable for its high quality and fast rendering speed. However, reconstructing dynamic scenes such as complex human performances with long durations remains challenging. Prior efforts fall short of modeling a long-term sequence with drastic motions, frequent topology changes or interactions with props, and resort to segmenting the whole sequence into groups of frames that are processed independently, which undermines temporal stability and thereby leads to an unpleasant viewing experience and inefficient storage footprint. In view of this, we introduce EvolvingGS, a two-stage strategy that first deforms the Gaussian model to coarsely align with the target frame, and then refines it with minimal point addition/subtraction, particularly in fast-changing areas. Owing to the flexibility of the incrementally evolving representation, our method outperforms existing approaches in terms of both per-frame and temporal quality metrics while maintaining fast rendering through its purely explicit representation. Moreover, by exploiting temporal coherence between successive frames, we propose a simple yet effective compression algorithm that achieves over 50x compression rate. Extensive experiments on both public benchmarks and challenging custom datasets demonstrate that our method significantly advances the state-of-the-art in dynamic scene reconstruction, particularly for extended sequences with complex human performances.