Omnidirectional Multi-Object Tracking

作者: Kai Luo, Hao Shi, Sheng Wu, Fei Teng, Mengfei Duan, Chang Huang, Yuhang Wang, Kaiwei Wang, Kailun Yang

分类: cs.CV, cs.RO, eess.IV

发布日期: 2025-03-06 (更新: 2025-03-23)

备注: Accepted to CVPR 2025. The established dataset and source code are available at https://github.com/xifen523/OmniTrack

🔗 代码/项目: GITHUB

💡 一句话要点

提出OmniTrack框架,解决全景图像多目标跟踪中的畸变和运动挑战。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 全景图像 多目标跟踪 目标检测 机器人视觉 运动估计

📋 核心要点

- 现有MOT算法难以直接应用于全景图像,因为全景图像存在分辨率损失、几何变形和光照不均等问题。

- OmniTrack通过引入Tracklet Management、FlexiTrack Instances和CircularStatE模块,有效缓解了全景图像的失真问题。

- 在JRDB和QuadTrack数据集上的实验表明,OmniTrack的性能优于现有方法,并在QuadTrack数据集上实现了显著的性能提升。

📝 摘要(中文)

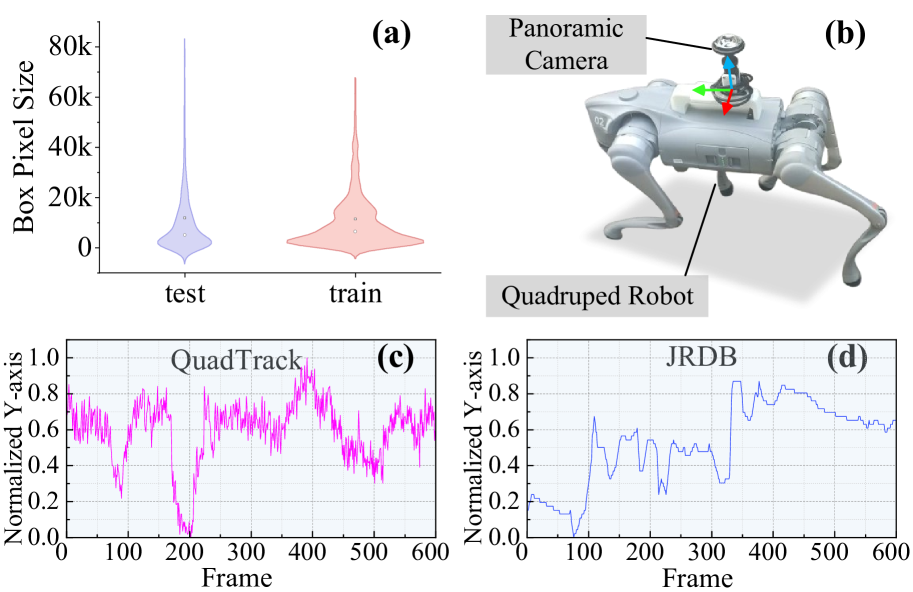

全景图像凭借其360°的视野,为多目标跟踪(MOT)提供了捕捉周围物体空间和时间关系的全面信息。然而,大多数MOT算法是为视野有限的针孔图像设计的,这损害了它们在全景环境中的有效性。此外,全景图像的失真,如分辨率损失、几何变形和不均匀的光照,阻碍了现有MOT方法的直接应用,导致性能显著下降。为了应对这些挑战,我们提出了OmniTrack,一个全景MOT框架,它结合了Tracklet Management来引入时间线索,FlexiTrack Instances用于物体定位和关联,以及CircularStatE模块来缓解图像和几何失真。这种集成使得在全景视野场景中进行跟踪成为可能,即使在快速传感器运动下也能实现。为了缓解全景MOT数据集的缺乏,我们推出了QuadTrack数据集——一个由四足机器人收集的综合全景数据集,具有全景视野、剧烈运动和复杂环境等多种挑战。在公共JRDB数据集和新推出的QuadTrack基准上的大量实验证明了所提出的框架的先进性能。OmniTrack在JRDB上实现了26.92%的HOTA得分,提高了3.43%,并在QuadTrack上进一步实现了23.45%的HOTA得分,超过了基线6.81%。已建立的数据集和源代码可在https://github.com/xifen523/OmniTrack获得。

🔬 方法详解

问题定义:论文旨在解决全景图像下的多目标跟踪问题。现有方法主要针对传统相机拍摄的图像,无法有效处理全景图像固有的几何畸变、分辨率不均以及剧烈运动带来的挑战,导致跟踪精度显著下降。

核心思路:论文的核心思路是设计一个专门针对全景图像的MOT框架,通过引入时间信息、灵活的实例表示以及畸变校正模块,来提升全景图像下的目标跟踪性能。框架的核心在于缓解全景图像的几何和图像失真,并充分利用时间信息来提高跟踪的鲁棒性。

技术框架:OmniTrack框架主要包含三个核心模块:Tracklet Management、FlexiTrack Instances和CircularStatE Module。Tracklet Management负责维护和更新目标轨迹,引入时间线索。FlexiTrack Instances用于目标定位和关联,采用灵活的实例表示方法。CircularStatE Module用于缓解全景图像的几何畸变和图像失真。整体流程是:首先利用FlexiTrack Instances进行目标检测和初步关联,然后通过Tracklet Management进行轨迹维护和更新,最后利用CircularStatE Module进行畸变校正,提升跟踪精度。

关键创新:OmniTrack的关键创新在于针对全景图像的特性,设计了CircularStatE Module来缓解图像和几何畸变。该模块能够有效地校正全景图像中的目标形变,从而提高目标检测和跟踪的准确性。此外,FlexiTrack Instances采用灵活的实例表示方法,能够更好地适应全景图像中目标形状的变化。

关键设计:CircularStatE Module的具体实现细节未知,但其核心思想是利用统计信息来建模全景图像的畸变,并进行相应的校正。FlexiTrack Instances的具体网络结构和损失函数未知,但其目标是学习一种能够适应全景图像中目标形状变化的实例表示。

🖼️ 关键图片

📊 实验亮点

OmniTrack在JRDB数据集上实现了26.92%的HOTA得分,相较于基线方法提升了3.43%。更重要的是,在作者提出的QuadTrack数据集上,OmniTrack取得了23.45%的HOTA得分,超越基线方法6.81%,验证了该框架在全景图像多目标跟踪方面的有效性和优越性。QuadTrack数据集的发布也为该领域的研究提供了宝贵资源。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、智能监控等领域。全景多目标跟踪技术能够帮助机器人或车辆更好地感知周围环境,提高其在复杂环境下的自主导航能力。在智能监控领域,该技术可以实现对更大范围内的目标进行跟踪和分析,提升监控效率。

📄 摘要(原文)

Panoramic imagery, with its 360° field of view, offers comprehensive information to support Multi-Object Tracking (MOT) in capturing spatial and temporal relationships of surrounding objects. However, most MOT algorithms are tailored for pinhole images with limited views, impairing their effectiveness in panoramic settings. Additionally, panoramic image distortions, such as resolution loss, geometric deformation, and uneven lighting, hinder direct adaptation of existing MOT methods, leading to significant performance degradation. To address these challenges, we propose OmniTrack, an omnidirectional MOT framework that incorporates Tracklet Management to introduce temporal cues, FlexiTrack Instances for object localization and association, and the CircularStatE Module to alleviate image and geometric distortions. This integration enables tracking in panoramic field-of-view scenarios, even under rapid sensor motion. To mitigate the lack of panoramic MOT datasets, we introduce the QuadTrack dataset--a comprehensive panoramic dataset collected by a quadruped robot, featuring diverse challenges such as panoramic fields of view, intense motion, and complex environments. Extensive experiments on the public JRDB dataset and the newly introduced QuadTrack benchmark demonstrate the state-of-the-art performance of the proposed framework. OmniTrack achieves a HOTA score of 26.92% on JRDB, representing an improvement of 3.43%, and further achieves 23.45% on QuadTrack, surpassing the baseline by 6.81%. The established dataset and source code are available at https://github.com/xifen523/OmniTrack.