GaussianVideo: Efficient Video Representation and Compression by Gaussian Splatting

作者: Inseo Lee, Youngyoon Choi, Joonseok Lee

分类: cs.CV

发布日期: 2025-03-06

💡 一句话要点

GaussianVideo:基于高斯溅射的高效视频表示与压缩方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱八:物理动画 (Physics-based Animation)

关键词: 视频压缩 高斯溅射 隐式神经表示 视频表示 时空编码 轻量级解码 可变形模型

📋 核心要点

- NeRV等隐式神经视频表示方法虽然性能优越,但模型体积大,编解码速度慢,内存消耗高,限制了实际应用。

- 提出基于2D高斯溅射的视频表示方法,通过动态调整高斯函数,结合时空编码器和轻量级解码器,高效处理视频数据。

- 实验结果表明,该方法显著降低了GPU内存使用,加快了视频处理速度,训练速度提升5.5倍,解码速度提升12.5倍。

📝 摘要(中文)

视频隐式神经表示(NeRV)为视频表示和压缩引入了一种新范式,优于传统编解码器。然而,随着模型尺寸的增长,编码和解码速度慢以及高内存消耗阻碍了其在实践中的应用。为了解决这些限制,我们提出了一种基于2D高斯溅射的新的视频表示和压缩方法,以有效地处理视频数据。我们提出的可变形2D高斯溅射动态地调整每帧中2D高斯函数的变换,从而显著降低内存成本。该方法配备了基于多平面的时空编码器和轻量级解码器,可以预测给定时间步长下初始高斯函数的颜色、坐标和形状的变化。通过利用时间梯度,我们的模型以可忽略的成本有效地捕获时间冗余,从而显著提高视频表示效率。我们的方法将GPU内存使用量降低高达78.4%,并显著加快了视频处理速度,与最先进的NeRV方法相比,训练速度提高了5.5倍,解码速度提高了12.5倍。

🔬 方法详解

问题定义:现有基于隐式神经表示的视频压缩方法,如NeRV,虽然在压缩率上表现出色,但模型体积庞大,导致编码和解码速度慢,同时需要大量的GPU内存,难以在实际应用中部署。因此,需要一种更高效的视频表示和压缩方法,能够在保证压缩性能的同时,降低计算复杂度和内存占用。

核心思路:论文的核心思路是利用2D高斯溅射来表示视频帧,并动态调整高斯函数的参数(颜色、坐标、形状)以适应视频内容的变化。通过这种方式,可以用更少的参数来表示视频,从而降低内存占用和计算复杂度。同时,利用时间梯度来捕获时间冗余,进一步提高压缩效率。

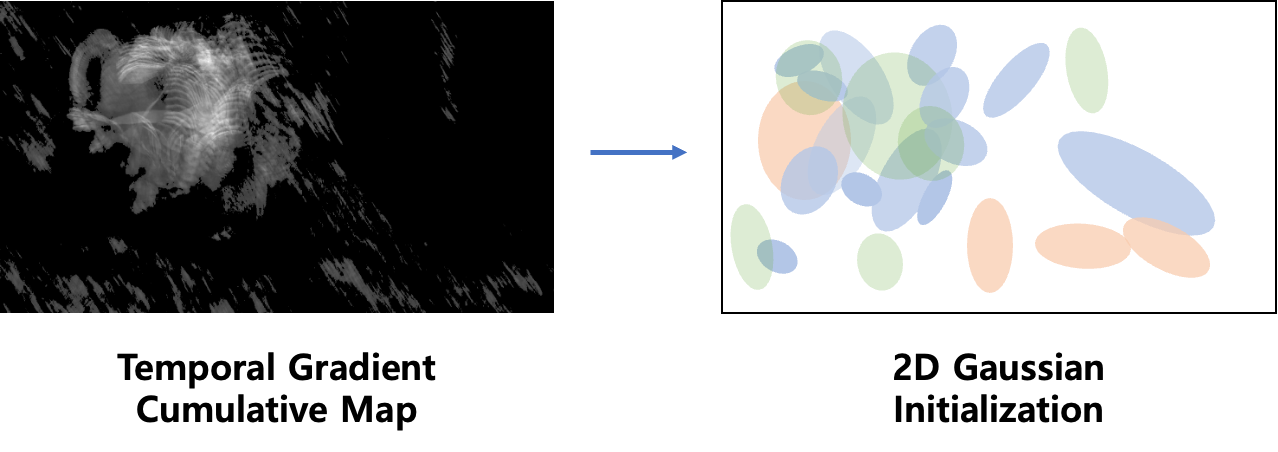

技术框架:该方法主要包含以下几个模块:1) 初始化2D高斯函数:在视频的第一帧初始化一组2D高斯函数。2) 多平面时空编码器:利用多平面特征提取器提取视频帧的时空特征,并将其编码为隐向量。3) 轻量级解码器:解码器根据隐向量预测每个高斯函数的参数变化(颜色、坐标、形状)。4) 可变形2D高斯溅射:根据预测的参数变化,动态调整高斯函数,并将其渲染成视频帧。

关键创新:该方法的关键创新在于使用可变形的2D高斯溅射来表示视频。与传统的基于像素或体素的视频表示方法相比,高斯溅射可以更有效地表示视频内容,并且可以通过动态调整高斯函数的参数来适应视频的变化。此外,利用时间梯度来捕获时间冗余也是一个重要的创新点。

关键设计:该方法使用多平面特征提取器来提取视频帧的时空特征。具体来说,它将视频帧投影到多个平面上,并在每个平面上提取特征。这种方法可以有效地捕获视频中的运动信息。此外,该方法还使用了一种轻量级的解码器,以降低计算复杂度。损失函数可能包含重建损失(衡量重建视频与原始视频的差异)以及正则化项(防止过拟合)。具体的网络结构和参数设置在论文中应该有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在视频表示和压缩方面取得了显著的性能提升。与最先进的NeRV方法相比,该方法将GPU内存使用量降低高达78.4%,训练速度提高了5.5倍,解码速度提高了12.5倍。这些数据表明,该方法在效率方面具有显著优势。

🎯 应用场景

该研究成果可应用于视频压缩、视频流媒体、视频编辑、视频监控等领域。更高效的视频表示和压缩方法可以降低存储成本、提高传输效率,并为实时视频处理提供支持。未来,该方法有望在移动设备、嵌入式系统等资源受限的平台上得到广泛应用。

📄 摘要(原文)

Implicit Neural Representation for Videos (NeRV) has introduced a novel paradigm for video representation and compression, outperforming traditional codecs. As model size grows, however, slow encoding and decoding speed and high memory consumption hinder its application in practice. To address these limitations, we propose a new video representation and compression method based on 2D Gaussian Splatting to efficiently handle video data. Our proposed deformable 2D Gaussian Splatting dynamically adapts the transformation of 2D Gaussians at each frame, significantly reducing memory cost. Equipped with a multi-plane-based spatiotemporal encoder and a lightweight decoder, it predicts changes in color, coordinates, and shape of initialized Gaussians, given the time step. By leveraging temporal gradients, our model effectively captures temporal redundancy at negligible cost, significantly enhancing video representation efficiency. Our method reduces GPU memory usage by up to 78.4%, and significantly expedites video processing, achieving 5.5x faster training and 12.5x faster decoding compared to the state-of-the-art NeRV methods.