Robust Computer-Vision based Construction Site Detection for Assistive-Technology Applications

作者: Junchi Feng, Giles Hamilton-Fletcher, Nikhil Ballem, Michael Batavia, Yifei Wang, Jiuling Zhong, Maurizio Porfiri, John-Ross Rizzo

分类: cs.CV

发布日期: 2025-03-06 (更新: 2025-09-23)

💡 一句话要点

提出基于计算机视觉的稳健施工现场检测系统,辅助视障人士安全导航。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 计算机视觉 施工现场检测 辅助技术 视障人士 YOLO 对象检测 光学字符识别 智能导航

📋 核心要点

- 视障人士在城市中面临施工区域带来的安全挑战,现有导航工具难以有效识别。

- 提出一种基于计算机视觉的辅助系统,融合对象检测、YOLO和OCR模块,识别施工现场元素。

- 实验表明,该系统在静态和动态测试中均表现出较高的准确率,能够有效检测施工现场。

📝 摘要(中文)

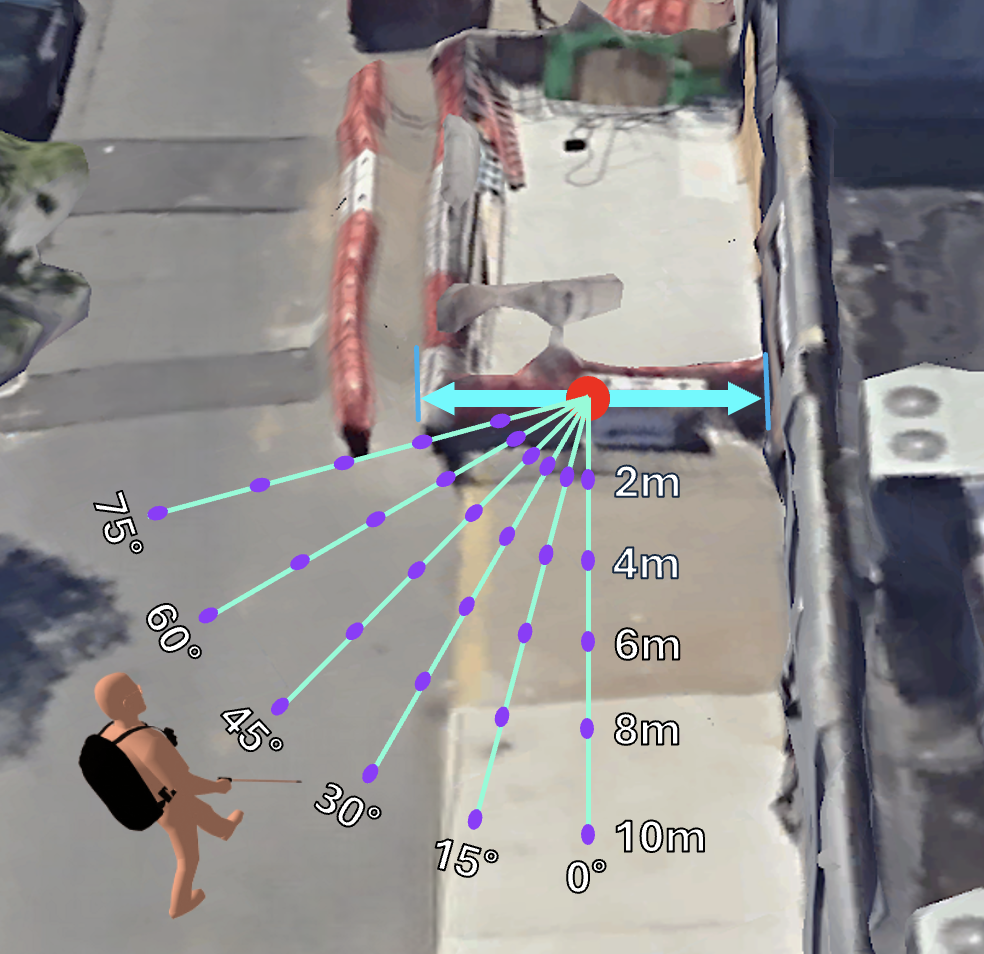

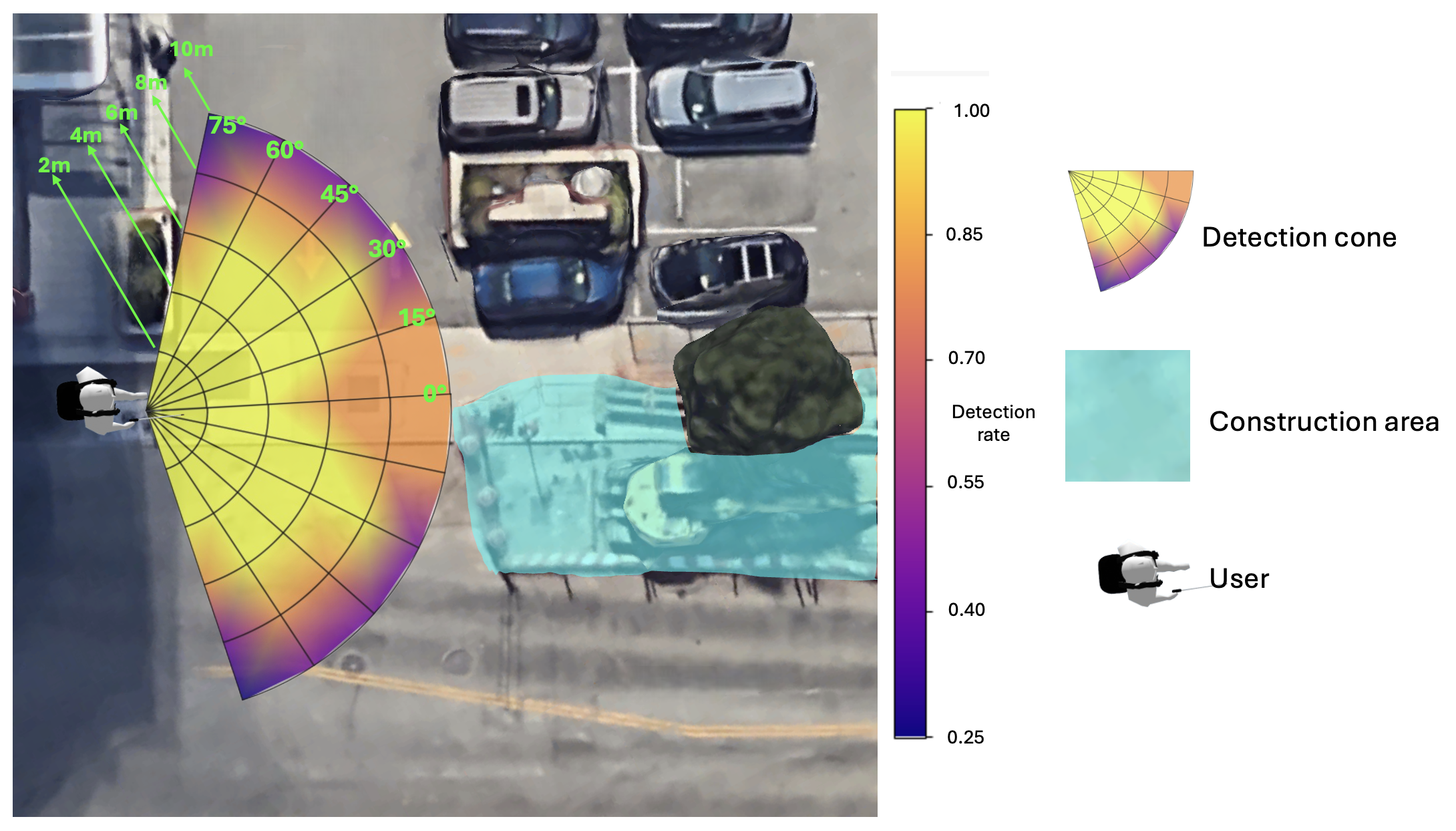

本文旨在解决视障人士在城市环境中导航时面临的施工区域障碍问题。施工区域存在不平整路面、障碍物、危险材料、噪音和路线变更等风险。现有导航工具和危险检测系统难以应对施工现场的视觉多样性。为此,我们开发了一种基于计算机视觉的辅助系统,集成了三个模块:一个开放词汇对象检测器,用于识别各种施工相关元素;一个基于YOLO的模型,专门用于检测脚手架和杆子;以及一个光学字符识别模块,用于识别施工标志。静态测试表明,该系统在七个施工现场的多视角图像中实现了88.56%的总体准确率,在2-10米范围内和高达75°的接近角度内都能稳定识别相关物体。动态测试表明,该系统在包含八个施工现场的0.5英里城市路线的第一人称步行视频中,区分施工区域和非施工区域的准确率为87.26%,通过50帧多数投票滤波器后提高到92.0%。该系统能够实时且在足够远的距离可靠地检测施工现场,为视障人士提供提前预警,使其能够做出更安全的移动决策。

🔬 方法详解

问题定义:论文旨在解决视障人士在城市环境中导航时,由于施工现场的复杂性和视觉多样性,导致现有导航工具和危险检测系统无法有效识别施工区域的问题。现有方法难以应对施工现场的视觉变化,无法提供及时有效的预警,从而影响视障人士的出行安全。

核心思路:论文的核心思路是利用计算机视觉技术,构建一个能够准确、稳健地检测施工现场的辅助系统。该系统通过集成多种视觉模块,识别施工现场的各种元素,包括物体、结构和标志,从而为视障人士提供全面的环境感知信息。

技术框架:该系统包含三个主要模块:1) 开放词汇对象检测器:用于识别各种施工相关的物体,例如锥桶、警示牌等。2) YOLO-based模型:专门用于检测脚手架和杆子等结构性元素。3) 光学字符识别(OCR)模块:用于识别施工标志上的文字信息。系统首先通过摄像头获取图像或视频,然后分别输入到这三个模块进行处理,最后将结果进行融合,判断是否存在施工现场。

关键创新:该系统的关键创新在于其综合利用了多种计算机视觉技术,针对施工现场的特点进行了优化。开放词汇对象检测器能够识别各种不同的施工相关物体,YOLO模型能够高效地检测结构性元素,OCR模块能够提取标志信息。这种多模块融合的方法提高了系统对施工现场的检测准确性和鲁棒性。

关键设计:在对象检测器方面,论文可能采用了预训练的视觉模型,并针对施工现场的特定物体进行了微调。YOLO模型的训练数据集包含了大量的脚手架和杆子图像,以提高检测精度。OCR模块可能采用了基于深度学习的方法,能够识别各种字体和排版的施工标志。此外,系统还可能采用了后处理技术,例如卡尔曼滤波,来平滑检测结果,提高系统的稳定性。

🖼️ 关键图片

📊 实验亮点

该系统在静态测试中达到了88.56%的总体准确率,在2-10米范围内和高达75°的接近角度内都能稳定识别相关物体。在动态测试中,区分施工区域和非施工区域的准确率为87.26%,通过50帧多数投票滤波器后提高到92.0%。这些结果表明,该系统能够有效地检测施工现场,并为视障人士提供可靠的预警信息。

🎯 应用场景

该研究成果可应用于开发智能辅助设备,帮助视障人士在城市环境中安全导航。通过实时检测施工现场,系统可以提前预警,引导视障人士避开危险区域或选择更安全的路线。此外,该技术还可应用于智能交通系统,为自动驾驶车辆提供施工区域信息,提高行驶安全性。未来,该技术有望与语音交互、触觉反馈等技术结合,提供更全面的辅助功能。

📄 摘要(原文)

Purpose: Navigating urban environments poses significant challenges for individuals who are blind or have low vision, especially in areas affected by construction. Construction zones introduce hazards such as uneven surfaces, barriers, hazardous materials, excessive noise, and altered routes that obstruct familiar paths and compromise safety. Although navigation tools assist in trip planning, they often overlook these temporary obstacles. Existing hazard detection systems also struggle with the visual variability of construction sites. Methods: We developed a computer vision--based assistive system integrating three modules: an open-vocabulary object detector to identify diverse construction-related elements, a YOLO-based model specialized in detecting scaffolding and poles, and an optical character recognition module to interpret construction signage. Results: In static testing at seven construction sites using images from multiple stationary viewpoints, the system achieved 88.56% overall accuracy. It consistently identified relevant objects within 2--10 meters and at approach angles up to 75$^{\circ}$. At 2--4 meters, detection was perfect (100%) across all angles. Even at 10 meters, six of seven sites remained detectable within a 15$^{\circ}$ approach. In dynamic testing along a 0.5-mile urban route containing eight construction sites, the system analyzed every frame of a first-person walking video. It achieved 87.26% accuracy in distinguishing construction from non-construction areas, rising to 92.0% with a 50-frame majority vote filter. Conclusion: The system can reliably detect construction sites in real time and at sufficient distances to provide advance warnings, enabling individuals with visual impairments to make safer mobility decisions such as proceeding with caution or rerouting.