EgoLife: Towards Egocentric Life Assistant

作者: Jingkang Yang, Shuai Liu, Hongming Guo, Yuhao Dong, Xiamengwei Zhang, Sicheng Zhang, Pengyun Wang, Zitang Zhou, Binzhu Xie, Ziyue Wang, Bei Ouyang, Zhengyu Lin, Marco Cominelli, Zhongang Cai, Yuanhan Zhang, Peiyuan Zhang, Fangzhou Hong, Joerg Widmer, Francesco Gringoli, Lei Yang, Bo Li, Ziwei Liu

分类: cs.CV

发布日期: 2025-03-05

备注: Accepted to CVPR 2025. Project Page: https://egolife-ai.github.io/. Code: https://github.com/EvolvingLMMs-Lab/EgoLife

💡 一句话要点

EgoLife:构建基于可穿戴AI眼镜的以自我为中心的生活助手

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 以自我为中心视觉 生活助手 多模态学习 长上下文问答 视频理解

📋 核心要点

- 现有方法在处理以自我为中心的、长时间跨度的、多模态的日常生活数据时面临挑战,难以构建有效的个人生活助手。

- EgoLife项目通过构建大规模数据集EgoLife和集成系统EgoButler,旨在解决以自我为中心的生活助手中的关键技术挑战。

- 实验结果表明,EgoGPT在以自我为中心的视频理解方面取得了领先性能,EgoRAG能够有效支持超长上下文的问答。

📝 摘要(中文)

本文介绍了EgoLife项目,旨在开发一款以自我为中心的生活助手,通过AI驱动的可穿戴眼镜陪伴并提高个人效率。为了给该助手奠定基础,我们进行了一项全面的数据收集研究,其中六名参与者共同生活了一周,使用AI眼镜连续记录他们的日常活动——包括讨论、购物、烹饪、社交和娱乐——进行多模态的以自我为中心的视频捕获,以及同步的第三人称视角视频参考。这项工作产生了EgoLife数据集,这是一个全面的300小时的以自我为中心、人际关系、多视角和多模态的日常生活数据集,带有密集的注释。利用该数据集,我们引入了EgoLifeQA,这是一套长上下文、面向生活的问答任务,旨在通过解决实际问题(例如回忆过去的相关事件、监控健康习惯和提供个性化建议)来提供有意义的日常帮助。为了解决(1)开发用于以自我为中心数据的鲁棒视觉-音频模型,(2)实现身份识别,以及(3)促进对大量时间信息的长上下文问答的关键技术挑战,我们引入了一个集成系统EgoButler,它包括EgoGPT和EgoRAG。EgoGPT是一个在以自我为中心的数据集上训练的全模态模型,在以自我为中心的视频理解方面实现了最先进的性能。EgoRAG是一个基于检索的组件,支持回答超长上下文问题。我们的实验研究验证了它们的工作机制,并揭示了关键因素和瓶颈,指导未来的改进。通过发布我们的数据集、模型和基准,我们旨在激发以自我为中心的人工智能助手方面的进一步研究。

🔬 方法详解

问题定义:论文旨在构建一个以自我为中心的生活助手,能够理解用户的日常生活并提供个性化帮助。现有方法在处理长时间、多模态的以自我为中心数据时,面临着鲁棒的视觉-音频模型构建、身份识别以及长上下文问答等挑战。

核心思路:论文的核心思路是构建一个大规模的以自我为中心数据集EgoLife,并在此基础上训练一个集成的系统EgoButler。EgoButler包含EgoGPT和EgoRAG两个模块,分别负责视频理解和长上下文问答。通过数据驱动和模块化设计,解决以自我为中心生活助手中的关键技术难题。

技术框架:EgoButler系统包含两个主要模块:EgoGPT和EgoRAG。EgoGPT是一个全模态模型,用于理解以自我为中心的视频数据,包括视觉和音频信息。EgoRAG是一个基于检索的组件,用于支持回答超长上下文的问题。整个流程是:首先,EgoGPT对视频进行理解,提取特征;然后,EgoRAG根据用户的问题,从EgoLife数据集中检索相关信息;最后,EgoRAG结合检索到的信息和EgoGPT提取的特征,生成答案。

关键创新:论文的关键创新在于构建了EgoLife数据集和EgoButler系统。EgoLife数据集是一个大规模的、多模态的以自我为中心数据集,为研究提供了数据基础。EgoButler系统通过集成EgoGPT和EgoRAG,实现了对以自我为中心数据的有效理解和长上下文问答,为构建实用的生活助手提供了技术方案。

关键设计:EgoGPT是一个全模态模型,具体结构未知,但强调了在以自我为中心数据集上的训练。EgoRAG是一个基于检索的组件,其关键设计在于如何有效地从大规模数据集中检索相关信息,以及如何将检索到的信息与EgoGPT提取的特征进行融合。具体的参数设置、损失函数、网络结构等技术细节未知。

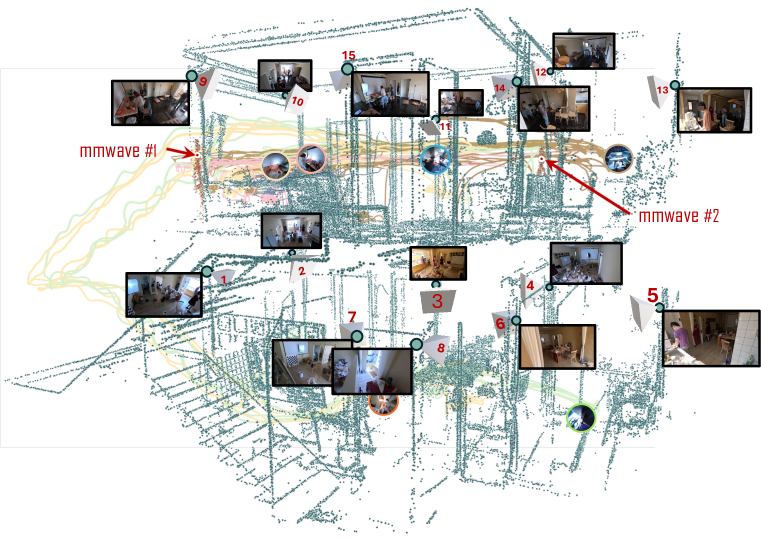

🖼️ 关键图片

📊 实验亮点

EgoGPT在以自我为中心的视频理解方面取得了最先进的性能(具体指标未知)。EgoRAG能够有效支持超长上下文的问答,验证了其在处理长时间跨度信息方面的能力。实验结果揭示了关键因素和瓶颈,为未来的改进提供了指导。

🎯 应用场景

该研究成果可应用于开发个性化的生活助手,帮助用户回忆重要事件、监控健康习惯、提供个性化推荐等。潜在应用领域包括智能家居、健康管理、教育培训等。未来,该技术有望提升人们的生活质量和工作效率。

📄 摘要(原文)

We introduce EgoLife, a project to develop an egocentric life assistant that accompanies and enhances personal efficiency through AI-powered wearable glasses. To lay the foundation for this assistant, we conducted a comprehensive data collection study where six participants lived together for one week, continuously recording their daily activities - including discussions, shopping, cooking, socializing, and entertainment - using AI glasses for multimodal egocentric video capture, along with synchronized third-person-view video references. This effort resulted in the EgoLife Dataset, a comprehensive 300-hour egocentric, interpersonal, multiview, and multimodal daily life dataset with intensive annotation. Leveraging this dataset, we introduce EgoLifeQA, a suite of long-context, life-oriented question-answering tasks designed to provide meaningful assistance in daily life by addressing practical questions such as recalling past relevant events, monitoring health habits, and offering personalized recommendations. To address the key technical challenges of (1) developing robust visual-audio models for egocentric data, (2) enabling identity recognition, and (3) facilitating long-context question answering over extensive temporal information, we introduce EgoButler, an integrated system comprising EgoGPT and EgoRAG. EgoGPT is an omni-modal model trained on egocentric datasets, achieving state-of-the-art performance on egocentric video understanding. EgoRAG is a retrieval-based component that supports answering ultra-long-context questions. Our experimental studies verify their working mechanisms and reveal critical factors and bottlenecks, guiding future improvements. By releasing our datasets, models, and benchmarks, we aim to stimulate further research in egocentric AI assistants.