BEVMOSNet: Multimodal Fusion for BEV Moving Object Segmentation

作者: Hiep Truong Cong, Ajay Kumar Sigatapu, Arindam Das, Yashwanth Sharma, Venkatesh Satagopan, Ganesh Sistu, Ciaran Eising

分类: cs.CV

发布日期: 2025-03-05

备注: In Proceedings of the 20th International Joint Conference on Computer Vision, Imaging and Computer Graphics Theory and Applications (2025)

💡 一句话要点

BEVMOSNet:融合相机、激光雷达和雷达数据,实现BEV视角下移动物体分割

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: BEV感知 运动分割 多模态融合 自动驾驶 可变形注意力

📋 核心要点

- 现有基于视觉的BEV运动分割方法在光照不足和恶劣天气下性能显著下降,限制了自动驾驶系统的可靠性。

- BEVMOSNet通过端到端的多模态融合,结合相机、激光雷达和雷达数据,提升了BEV视角下移动物体分割的精度。

- 在nuScenes数据集上的实验表明,BEVMOSNet相比现有方法,在IoU指标上取得了显著提升,成为新的SOTA。

📝 摘要(中文)

为了确保自动驾驶车辆可靠的避障系统和平稳的路径规划,准确理解鸟瞰图(BEV)中动态物体的运动至关重要。然而,与物体检测和分割相比,这项任务的研究相对有限。现有的基于视觉的方法在弱光、夜间和雨天等恶劣天气条件下性能显著下降。相反,激光雷达和雷达传感器在这些情况下几乎不受影响,并且雷达提供了物体的关键速度信息。因此,我们提出了BEVMOSNet,据我们所知,这是第一个利用相机、激光雷达和雷达进行端到端多模态融合,以精确预测BEV中移动物体的网络。此外,我们进行了更深入的分析,以找出用于可变形交叉注意力引导的传感器融合的最佳策略,从而实现BEV中的跨传感器知识共享。在nuScenes数据集上评估BEVMOSNet时,我们发现与基于视觉的单模态基线BEV-MoSeg相比,IoU得分总体提高了36.59%,与扩展到运动分割任务的多模态SimpleBEV相比,提高了2.35%,从而确立了该方法在BEV运动分割领域的领先地位。

🔬 方法详解

问题定义:论文旨在解决自动驾驶场景下,在BEV视角中准确分割移动物体的问题。现有方法,特别是基于视觉的方法,在弱光、夜间和恶劣天气条件下的性能会显著下降,无法满足自动驾驶对环境感知的鲁棒性要求。

核心思路:论文的核心思路是利用多模态融合的优势,将相机提供的图像信息、激光雷达提供的精确深度信息以及雷达提供的速度信息结合起来,从而克服单一模态的局限性,提高在各种复杂环境下的运动物体分割精度。

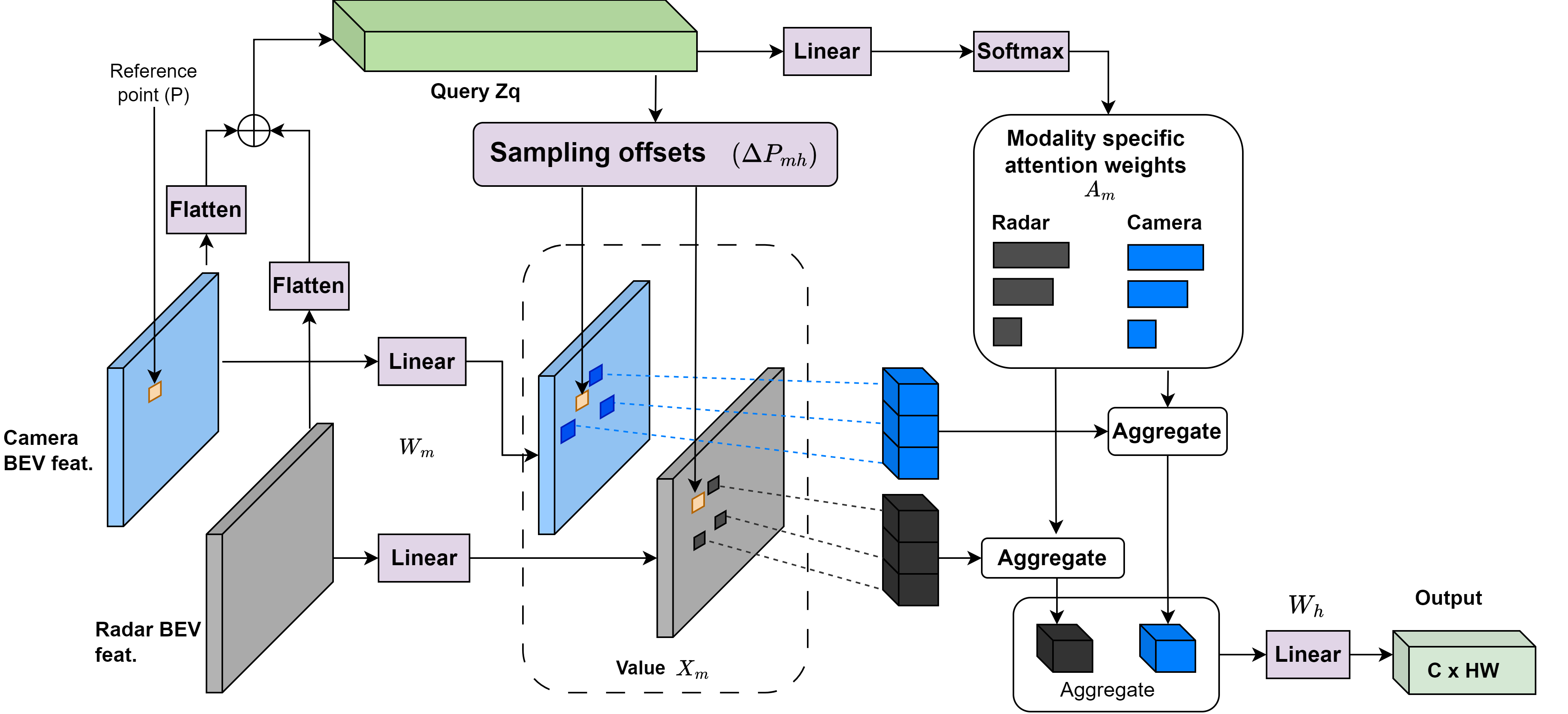

技术框架:BEVMOSNet采用端到端的网络结构。首先,对来自相机、激光雷达和雷达的原始数据进行特征提取。然后,利用可变形交叉注意力机制进行跨模态特征融合,将不同传感器的数据映射到统一的BEV空间。最后,通过分割头预测BEV视角下的移动物体。

关键创新:该论文的关键创新在于首次将相机、激光雷达和雷达三种模态的数据进行端到端融合,用于BEV运动分割。此外,论文还深入分析了可变形交叉注意力机制在多模态融合中的作用,并探索了最佳的融合策略。

关键设计:论文使用了可变形交叉注意力机制来实现跨模态特征融合。具体来说,对于每个模态的特征,网络学习一组偏移量,用于从其他模态的特征图中采样相关的信息。这种方法可以自适应地关注不同模态之间的关联性,从而提高融合效果。损失函数方面,使用了标准的交叉熵损失函数来训练分割头。

🖼️ 关键图片

📊 实验亮点

BEVMOSNet在nuScenes数据集上取得了显著的性能提升。与基于视觉的单模态基线BEV-MoSeg相比,IoU得分提高了36.59%。与扩展到运动分割任务的多模态SimpleBEV相比,IoU得分提高了2.35%。这些结果表明,BEVMOSNet在BEV运动分割任务上达到了最先进的水平。

🎯 应用场景

BEVMOSNet在自动驾驶领域具有广泛的应用前景,可以用于提高车辆对周围环境的感知能力,从而实现更安全、更可靠的自动驾驶。例如,它可以用于障碍物检测、路径规划和决策制定。此外,该技术还可以应用于机器人、智能交通等领域。

📄 摘要(原文)

Accurate motion understanding of the dynamic objects within the scene in bird's-eye-view (BEV) is critical to ensure a reliable obstacle avoidance system and smooth path planning for autonomous vehicles. However, this task has received relatively limited exploration when compared to object detection and segmentation with only a few recent vision-based approaches presenting preliminary findings that significantly deteriorate in low-light, nighttime, and adverse weather conditions such as rain. Conversely, LiDAR and radar sensors remain almost unaffected in these scenarios, and radar provides key velocity information of the objects. Therefore, we introduce BEVMOSNet, to our knowledge, the first end-to-end multimodal fusion leveraging cameras, LiDAR, and radar to precisely predict the moving objects in BEV. In addition, we perform a deeper analysis to find out the optimal strategy for deformable cross-attention-guided sensor fusion for cross-sensor knowledge sharing in BEV. While evaluating BEVMOSNet on the nuScenes dataset, we show an overall improvement in IoU score of 36.59% compared to the vision-based unimodal baseline BEV-MoSeg (Sigatapu et al., 2023), and 2.35% compared to the multimodel SimpleBEV (Harley et al., 2022), extended for the motion segmentation task, establishing this method as the state-of-the-art in BEV motion segmentation.