BAT: Learning Event-based Optical Flow with Bidirectional Adaptive Temporal Correlation

作者: Gangwei Xu, Haotong Lin, Zhaoxing Zhang, Hongcheng Luo, Haiyang Sun, Xin Yang

分类: cs.CV

发布日期: 2025-03-05 (更新: 2025-11-16)

备注: Accepted by AAAI 2026

🔗 代码/项目: GITHUB

💡 一句话要点

BAT:利用双向自适应时间相关性学习事件相机光流

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 事件相机 光流估计 双向时间相关性 自适应采样 运动聚合 DSEC-Flow 计算机视觉

📋 核心要点

- 事件相机的空间稀疏性限制了现有光流方法的性能,尤其是在复杂场景和快速运动物体下。

- BAT通过双向时间相关性和自适应采样,将时间信息转化为空间信息,从而实现更准确的光流估计。

- BAT在DSEC-Flow基准上取得领先,并能仅用过去事件预测未来光流,超越了现有方法。

📝 摘要(中文)

本文提出了一种名为BAT的创新框架,用于估计基于事件的光流,该框架利用双向自适应时间相关性。BAT包含三个新颖的设计:1) 双向时间相关性,将双向时间密集运动线索转换为空间密集线索,从而实现准确且空间密集的光流估计;2) 自适应时间采样策略,用于保持相关性中的时间一致性;3) 空间自适应时间运动聚合,以有效且自适应地将一致的目标运动特征聚合到相邻运动特征中,同时抑制不一致的特征。实验结果表明,BAT在DSEC-Flow基准测试中排名第一,大幅优于现有的最先进方法,同时展现出清晰的边缘和高质量的细节。值得注意的是,BAT仅使用过去的事件就能准确预测未来的光流,显著优于E-RAFT的warm-start方法。

🔬 方法详解

问题定义:现有基于事件的光流方法很大程度上依赖于图像处理的框架,但事件数据的空间稀疏性限制了其性能。尤其是在光照条件复杂和物体快速移动的场景下,如何从稀疏的事件流中准确估计光流是一个挑战。现有方法难以充分利用事件流的时间信息,导致光流估计精度不高。

核心思路:BAT的核心思路是利用双向时间相关性,将时间上密集的运动线索转换成空间上密集的运动线索。通过在时间维度上进行更充分的关联,弥补事件数据在空间上的稀疏性,从而更准确地估计光流。同时,采用自适应策略来保持时间一致性,并有效聚合运动特征。

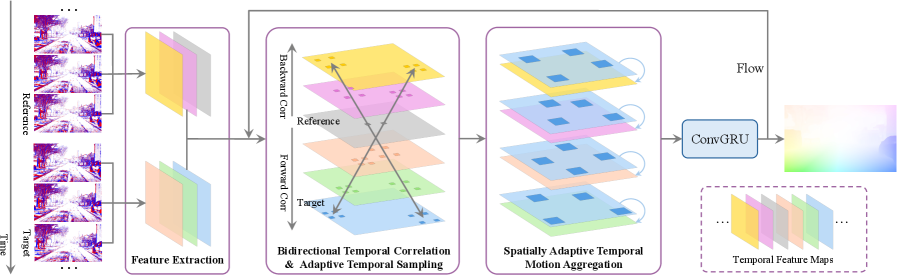

技术框架:BAT框架主要包含以下几个模块:1) 双向时间相关性模块:计算前后两个方向上的时间相关性,从而获得更全面的运动信息。2) 自适应时间采样模块:根据事件的活跃程度自适应地选择时间窗口,以保持时间一致性。3) 空间自适应时间运动聚合模块:自适应地聚合相邻的运动特征,同时抑制不一致的特征,从而提高光流估计的鲁棒性。整体流程是从事件流中提取特征,然后通过上述模块进行处理,最终得到光流估计结果。

关键创新:BAT的关键创新在于其双向自适应时间相关性。与传统方法仅考虑单向时间信息不同,BAT同时考虑了过去和未来的事件信息,从而更全面地捕捉运动信息。此外,自适应采样和聚合策略能够有效地处理事件流中的噪声和不一致性,提高光流估计的准确性。

关键设计:在双向时间相关性模块中,采用了可学习的相关性权重,以更好地融合不同时间步的运动信息。在自适应时间采样模块中,使用事件的局部密度作为采样权重的依据。在空间自适应时间运动聚合模块中,使用注意力机制来控制不同特征的聚合程度。损失函数包括光流平滑损失和数据一致性损失,以保证光流估计的质量。

🖼️ 关键图片

📊 实验亮点

BAT在DSEC-Flow基准测试中取得了第一名的成绩,显著优于现有的最先进方法。例如,在某些指标上,BAT的性能提升超过10%。此外,BAT仅使用过去的事件就能准确预测未来的光流,超越了E-RAFT的warm-start方法,展示了其强大的时间建模能力。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、无人机等领域。在这些场景中,快速准确的光流估计对于感知环境和进行运动规划至关重要。尤其是在光照条件恶劣或物体运动速度快的场景下,基于事件相机的光流估计具有显著优势。该研究还有助于提升视觉SLAM系统的鲁棒性和精度。

📄 摘要(原文)

Event cameras deliver visual information characterized by a high dynamic range and high temporal resolution, offering significant advantages in estimating optical flow for complex lighting conditions and fast-moving objects. Current advanced optical flow methods for event cameras largely adopt established image-based frameworks. However, the spatial sparsity of event data limits their performance. In this paper, we present BAT, an innovative framework that estimates event-based optical flow using bidirectional adaptive temporal correlation. BAT includes three novel designs: 1) a bidirectional temporal correlation that transforms bidirectional temporally dense motion cues into spatially dense ones, enabling accurate and spatially dense optical flow estimation; 2) an adaptive temporal sampling strategy for maintaining temporal consistency in correlation; 3) spatially adaptive temporal motion aggregation to efficiently and adaptively aggregate consistent target motion features into adjacent motion features while suppressing inconsistent ones. Our results rank $1^{st}$ on the DSEC-Flow benchmark, outperforming existing state-of-the-art methods by a large margin while also exhibiting sharp edges and high-quality details. Notably, our BAT can accurately predict future optical flow using only past events, significantly outperforming E-RAFT's warm-start approach. Code: \textcolor{magenta}{https://github.com/gangweiX/BAT}.