CADDI: An in-Class Activity Detection Dataset using IMU data from low-cost sensors

作者: Luis Marquez-Carpintero, Sergio Suescun-Ferrandiz, Monica Pina-Navarro, Miguel Cazorla, Francisco Gomez-Donoso

分类: cs.CV, cs.HC

发布日期: 2025-03-04

💡 一句话要点

CADDI:提出一个基于低成本IMU的课堂活动检测数据集,促进教育场景下的活动识别。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 课堂活动检测 IMU传感器 教育数据集 多模态数据 活动识别 智能课堂

📋 核心要点

- 现有课堂活动识别方法缺乏大规模标注数据集,限制了算法的开发和性能提升。

- 论文提出CADDI数据集,包含IMU和视觉数据,旨在促进教育场景下活动识别算法的研究。

- 该数据集包含19种课堂活动,由12名参与者完成,为多模态算法开发提供全面资源。

📝 摘要(中文)

为了解学生课堂参与度和提升教学效果,对课堂活动进行监测和预测至关重要。准确检测这些活动能帮助教师实时调整课程,减少学生的负面情绪,提升整体学习体验。利用智能手表等非侵入式设备中的惯性测量单元(IMU)是一种可行的解决方案。然而,缺乏大型、带标签的教育数据集限制了可靠预测系统的开发。为此,我们提出了一个使用经济型IMU传感器进行课堂活动检测的新数据集。该数据集包含19种不同的活动(瞬时和连续的),由12名参与者在典型的课堂场景中完成。它包括加速度计、陀螺仪、旋转向量数据以及同步的立体图像,为开发使用传感器和视觉数据的多模态算法提供了全面的资源。该数据集是朝着教育环境中可扩展的活动识别解决方案迈出的关键一步。

🔬 方法详解

问题定义:现有课堂活动识别研究面临缺乏大规模、高质量数据集的挑战。虽然IMU传感器具有非侵入性和低成本的优点,但缺乏针对教育场景的、包含多种活动的、同步多模态的数据集,阻碍了相关算法的开发和性能评估。现有方法难以有效利用IMU数据进行准确的课堂活动识别。

核心思路:论文的核心思路是通过构建一个包含多种课堂活动、多名参与者、多模态传感器数据的CADDI数据集,为教育场景下的活动识别研究提供基础。该数据集旨在促进基于IMU传感器和视觉数据的多模态算法的开发,从而提高课堂活动识别的准确性和鲁棒性。

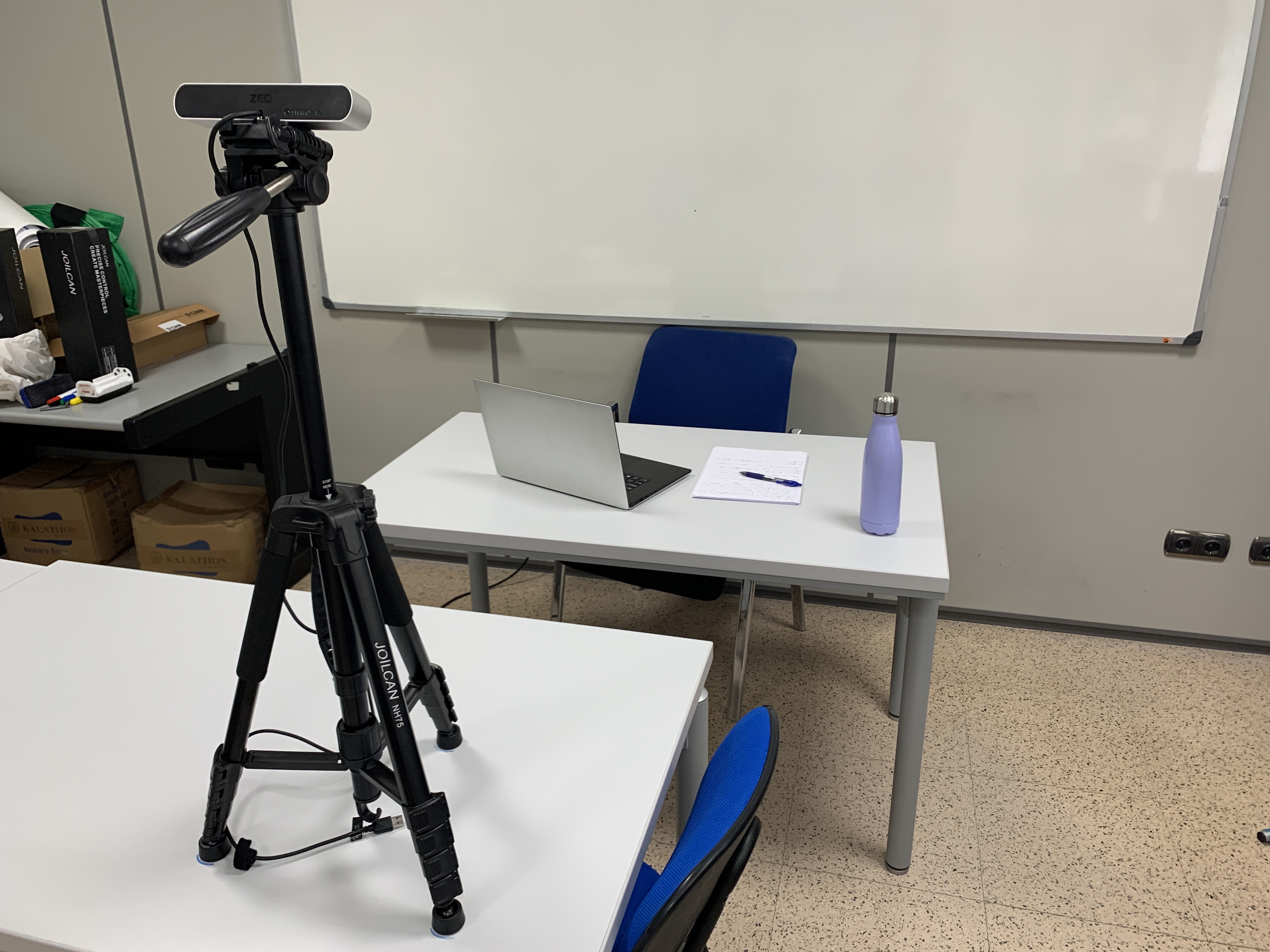

技术框架:CADDI数据集的构建流程主要包括以下几个阶段:1) 活动设计:选择19种具有代表性的课堂活动,包括瞬时活动和连续活动。2) 数据采集:招募12名参与者,在模拟课堂环境中佩戴配备IMU传感器的智能手表,并使用立体相机同步记录视觉数据。3) 数据标注:对采集到的IMU数据和视觉数据进行精确标注,标记每个活动的起始时间和类型。4) 数据集发布:将标注后的数据整理成统一的格式,并公开发布。

关键创新:该数据集的关键创新在于:1) 针对教育场景:数据集专门针对课堂环境设计,包含多种典型的课堂活动。2) 多模态数据:数据集包含IMU传感器数据(加速度计、陀螺仪、旋转向量)和同步的立体图像,为多模态算法的开发提供了可能。3) 大规模:数据集包含12名参与者的数据,数据量相对较大,有助于训练更鲁棒的算法。

关键设计:在数据采集方面,论文使用了低成本的智能手表作为IMU传感器,降低了数据采集的成本。在数据标注方面,论文采用了人工标注的方式,保证了标注的准确性。数据集中包含了加速度计、陀螺仪和旋转向量数据,采样频率未知。立体图像的分辨率和帧率未知。具体的数据格式和存储方式也未知。

🖼️ 关键图片

📊 实验亮点

该论文的主要贡献在于构建了一个包含19种课堂活动、12名参与者的多模态数据集CADDI。该数据集包含IMU传感器数据(加速度计、陀螺仪、旋转向量)和同步的立体图像,为教育场景下的活动识别研究提供了宝贵资源。论文未提供具体的实验结果和性能数据,但该数据集的发布将促进相关算法的开发和性能评估。

🎯 应用场景

该研究成果可应用于智能课堂、个性化教学等领域。通过实时监测学生的课堂活动,教师可以及时调整教学策略,提高教学效果。此外,该数据集还可以用于开发智能辅导系统,为学生提供个性化的学习建议。未来,该研究有望推动教育领域的智能化发展。

📄 摘要(原文)

The monitoring and prediction of in-class student activities is of paramount importance for the comprehension of engagement and the enhancement of pedagogical efficacy. The accurate detection of these activities enables educators to modify their lessons in real time, thereby reducing negative emotional states and enhancing the overall learning experience. To this end, the use of non-intrusive devices, such as inertial measurement units (IMUs) embedded in smartwatches, represents a viable solution. The development of reliable predictive systems has been limited by the lack of large, labeled datasets in education. To bridge this gap, we present a novel dataset for in-class activity detection using affordable IMU sensors. The dataset comprises 19 diverse activities, both instantaneous and continuous, performed by 12 participants in typical classroom scenarios. It includes accelerometer, gyroscope, rotation vector data, and synchronized stereo images, offering a comprehensive resource for developing multimodal algorithms using sensor and visual data. This dataset represents a key step toward scalable solutions for activity recognition in educational settings.