VideoA11y: Method and Dataset for Accessible Video Description

作者: Chaoyu Li, Sid Padmanabhuni, Maryam Cheema, Hasti Seifi, Pooyan Fazli

分类: cs.CV, cs.HC

发布日期: 2025-02-27

备注: ACM CHI 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

VideoA11y:提出了一种利用多模态大语言模型生成可访问视频描述的方法与数据集。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频描述生成 多模态大语言模型 可访问性 盲人与低视力 无障碍设计

📋 核心要点

- 现有视频描述生成模型受限于训练数据集中人工标注质量,无法充分满足盲人和低视力用户的需求。

- VideoA11y利用多模态大语言模型和视频可访问性指南,生成更符合盲人和低视力用户需求的视频描述。

- 实验表明,VideoA11y生成的描述在多个指标上优于新手标注,并与专业人员标注水平相当。

📝 摘要(中文)

视频描述对于盲人和低视力(BLV)用户访问视觉内容至关重要。然而,目前用于生成描述的人工智能模型常常因为训练数据集中人工标注质量的限制而表现不佳,导致生成的描述不能完全满足BLV用户的需求。为了解决这个问题,我们引入了VideoA11y,一种利用多模态大语言模型(MLLMs)和视频可访问性指南,为BLV个体量身定制描述的方法。使用这种方法,我们整理了VideoA11y-40K,这是最大、最全面的包含40,000个为BLV用户描述的视频的数据集。在15个视频类别中进行的严格实验,包括347名视力正常参与者、40名BLV参与者和7名专业描述员,表明VideoA11y描述在清晰度、准确性、客观性、描述性和用户满意度方面优于新手人工标注,并且与训练有素的人工标注相当。我们使用标准和自定义指标在VideoA11y-40K上评估了模型,证明在此数据集上微调的MLLM可以生成高质量的可访问描述。代码和数据集可在https://people-robots.github.io/VideoA11y获得。

🔬 方法详解

问题定义:论文旨在解决现有视频描述生成模型无法为盲人和低视力用户提供高质量、可访问的视频描述的问题。现有方法依赖的人工标注数据集质量不高,导致模型生成的描述不够清晰、准确、客观,难以满足BLV用户的实际需求。

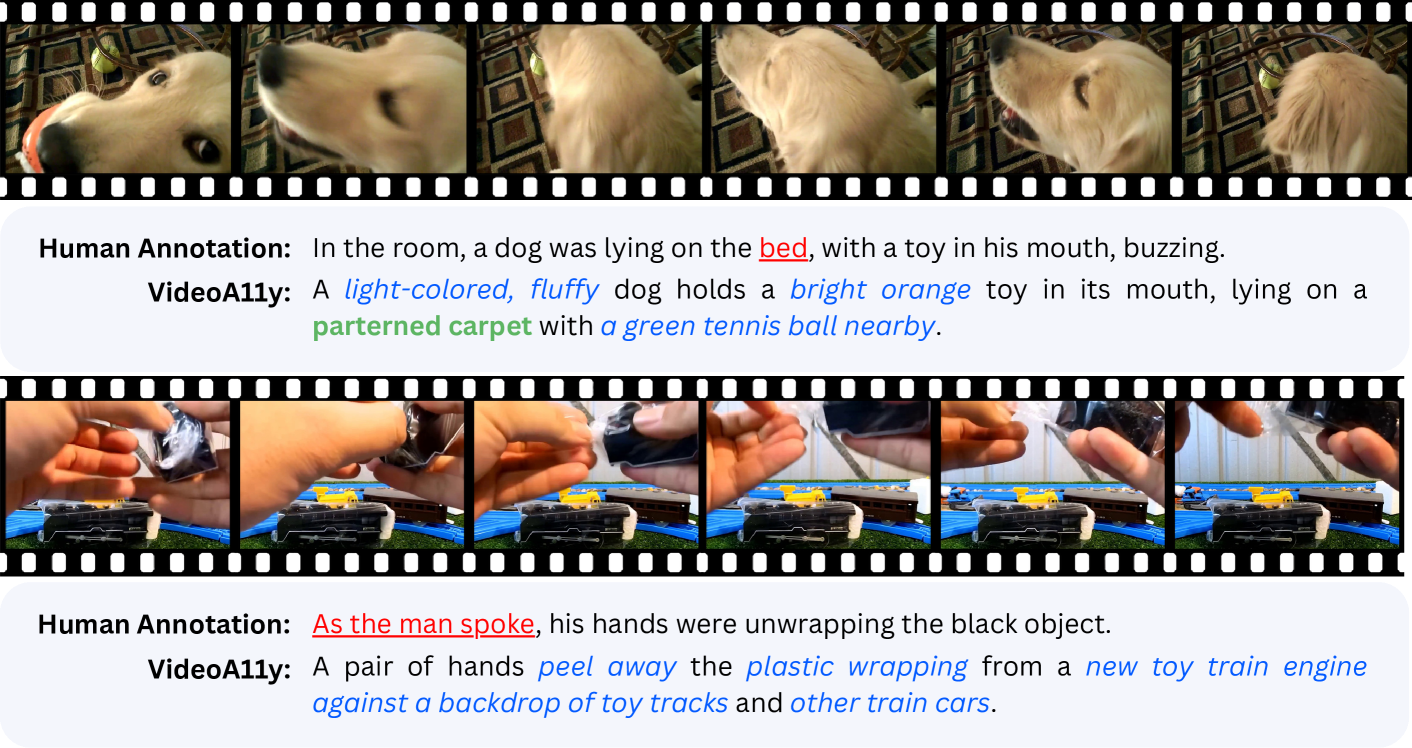

核心思路:论文的核心思路是利用多模态大语言模型(MLLMs)的强大能力,结合视频可访问性指南,自动生成更符合BLV用户需求的视频描述。通过引入可访问性指南,可以引导模型生成更关注BLV用户所需信息的描述,例如场景中的关键人物、物体、动作和环境信息。

技术框架:VideoA11y方法主要包含以下几个阶段:1) 利用MLLMs对视频内容进行初步理解和特征提取;2) 结合视频可访问性指南,对提取的特征进行筛选和重组,突出BLV用户关心的信息;3) 生成最终的视频描述。整个流程旨在确保生成的描述既准确反映视频内容,又符合BLV用户的阅读习惯和信息需求。

关键创新:该论文的关键创新在于将多模态大语言模型与视频可访问性指南相结合,用于生成面向BLV用户的视频描述。与传统的视频描述生成方法相比,VideoA11y方法更加关注BLV用户的特定需求,能够生成更清晰、准确、客观的描述。

关键设计:论文中使用了特定的MLLM架构(具体架构未知),并针对视频描述任务进行了微调。损失函数的设计可能包含对描述的清晰度、准确性和客观性的约束(具体细节未知)。同时,论文还设计了一套评估指标,用于衡量生成的描述是否符合BLV用户的需求。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VideoA11y生成的视频描述在清晰度、准确性、客观性、描述性和用户满意度方面均优于新手人工标注,并与训练有素的人工标注水平相当。在包含347名视力正常参与者、40名BLV参与者和7名专业描述员的评估中,VideoA11y展现了显著的优势,证明了其在生成高质量可访问视频描述方面的有效性。具体性能提升数据未知。

🎯 应用场景

该研究成果可广泛应用于视频平台、教育资源、社交媒体等领域,为盲人和低视力用户提供更好的视频内容访问体验。通过自动生成高质量的视频描述,可以显著提升BLV用户获取信息、参与社会活动的能力,促进社会包容性。未来,该技术还可应用于其他无障碍场景,例如图像描述、语音助手等。

📄 摘要(原文)

Video descriptions are crucial for blind and low vision (BLV) users to access visual content. However, current artificial intelligence models for generating descriptions often fall short due to limitations in the quality of human annotations within training datasets, resulting in descriptions that do not fully meet BLV users' needs. To address this gap, we introduce VideoA11y, an approach that leverages multimodal large language models (MLLMs) and video accessibility guidelines to generate descriptions tailored for BLV individuals. Using this method, we have curated VideoA11y-40K, the largest and most comprehensive dataset of 40,000 videos described for BLV users. Rigorous experiments across 15 video categories, involving 347 sighted participants, 40 BLV participants, and seven professional describers, showed that VideoA11y descriptions outperform novice human annotations and are comparable to trained human annotations in clarity, accuracy, objectivity, descriptiveness, and user satisfaction. We evaluated models on VideoA11y-40K using both standard and custom metrics, demonstrating that MLLMs fine-tuned on this dataset produce high-quality accessible descriptions. Code and dataset are available at https://people-robots.github.io/VideoA11y.